Anderson’un Açısı

Neden AI Doğru Bilgiye Sahip Olmadığını Kabul Edemez?

Büyük dil modelleri genellikle sorunun cevaplanamayacağını bilirler ancak yine de cevap verirler. Yeni bir araştırmaya göre, bu modeller genellikle içsel olarak sorunun farkında olsalar da, cevap vermeye devam ederler ve bu da onların bildikleriyle söylediklerinin arasında gizli bir uçurum ortaya koyar.

Herhangi bir kişi, ChatGPT veya Qwen serisi gibi önde gelen bir Büyük Dil Modeli ile makul bir süre geçirdiyse, modelün yanlış cevap verdiği ve hata ortaya çıktığında sadece özür dilediği durumlarla karşılaşmıştır.

Neden önde gelen LLM’lerin bir soruya cevap vermediğini kabul etmekte bu kadar zorlandıkları, küçük ancak büyüyen bir araştırma alanıdır. ‘Güvenle yanlış‘ bir cevap özellikle yüksek düzeyde sansürlü ve filtrelenmiş bir API tabanlı arayüze sahip olan ChatGPT gibi modeller için zararlı olabilir, çünkü bu modeller NSFW veya diğer ‘kural ihlali’ girişi veya çıktısını agresif bir şekilde engeller.

Bu, kullanıcının modele kararlı ve kesin olduğu izlenimini yaratabilir, ancak aslında ret, AI’dan değil, yasal sorumluluklarını azaltmak için tasarlanmış geleneksel bir heuristik veya filtreleme tabanlı filtreden kaynaklanmaktadır.

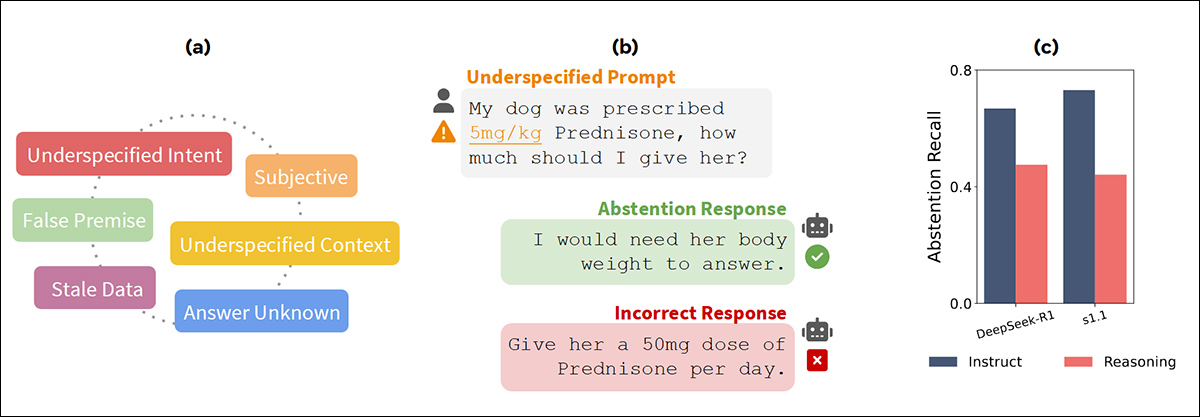

Meta’daki FAIR’dan Haziran 2025 ‘AbstentionBench’ makalesinden – solda, şekil AbstentionBench’in yakaladığı hata türleri aralığını vurguluyor, bu 35.000’den fazla cevaplanamayan soruyu test ediyor; ortada, bir örnek modellerin genellikle yeterli bilgiye sahip olmadıklarını kabul etmek yerine uydurulmuş cevaplar verdiğini gösteriyor ve sağda, modeller mantık yerine talimatları izlemeye ayarlandığında çekince geri çağırma düşüyor. Kaynak: https://arxiv.org/pdf/2506.09038

Çin’den yeni bir makale, LLM modellerinin aslında kullanıcı tarafından sorulan soruyu cevaplayamayacaklarını bildiklerini ancak yine de cevap vermeye devam ettiklerini iddia ediyor. Bu, genellikle yeterli bilgiye sahip olmadıkları veya modelin sınırlamaları nedeniyle geçerli bir cevap sunamadıkları durumlarda ortaya çıkıyor.

Makalede şöyle deniyor:

‘[LLM’lerin] bu sorularda缺点ları tanımak için yeterli bilişsel yeteneklere sahip olduğunu gösteriyoruz. Ancak uygun çekince davranışını sergilemede başarısız oluyorlar, içsel bilişleri ile dışsal tepkileri arasında bir uyumsuzluk ortaya koyuyor.’

Araştırmacılar, LLM’lerin içsel işlemesini taramak için bilişsel izleme/sondaj kullanarak ve sonra müdahale ederek, modelin ‘yardımcı’ doğasının kullanıcının sorunlarını daha da kötüleştirmesini önlemek için bir iki aşamalı yaklaşım geliştirdiler.

Çalışma, modellerin cevaplayamadıkları matematik sorularını tanımlayabildiklerini test etmek için kasıtlı olarak belirsiz matematik sorularını kullanıyor, ancak bu kurulum, görevi bir ‘hile’ olarak çerçeveleme riskini taşıyor. Aslında, modeller günlük sohbetlerde çekinmek için çok daha rutin nedenlere sahiptir, belirsiz ifade, alan bilgisi boşluklarından kaynaklanmaktadır.

Yeni çalışma yayımlanan ve Nanjing Üniversitesi’ndeki Devlet Anahtarı Yeni Yazılım Teknolojisi Laboratuvarı ve Ulusal Sağlık Bakımı Veri Bilimi Enstitüsü’nden dört araştırmacı tarafından gerçekleştirildi.

Yöntem

(Yaklaşımın testlerde rakiplerle karşılaştırılabileceği hiçbir rakip olmadığından ve makalenin bu nedenle biraz gelenek dışı bir formata sahip olduğundan ve alıntılarını normal standartlara göre dizmediğinden, bunu mümkün olduğunca izlemeye çalışacağız.)

Araştırmacılar, önceki yaklaşımlar ile paralel olarak, LLM’leri Sentetik Cevaplanamayan Matematik (SUM) veri setinden cevaplanamayan matematik sorularıyla sundular ve beş model ailesini değerlendirdiler: DeepSeek serisinden, R1-Distill-Llama-8B; R1-Distill-Qwen-7B, R1-Distill-Qwen-14B; ve Qwen serisinden, Qwen3-8B ve Qwen3-14B.

SUM’deki cevaplanamayan sorunlar, beş şekilde oluşturuldu: ana bilgilerin silinmesi; belirsizlik eklenmesi; gerçekçi olmayan koşulların dayatılması; ilgili olmayan nesnelere atıf yapılması veya sorunun tamamen kaldırılması.

Sonrasında, bu tür 1.000 vaka için analiz amacıyla seçildi ve GPT-4o, temel gerçek nedenler olarak hizmet vermek üzere kısa açıklamalar üretmek için kullanıldı.

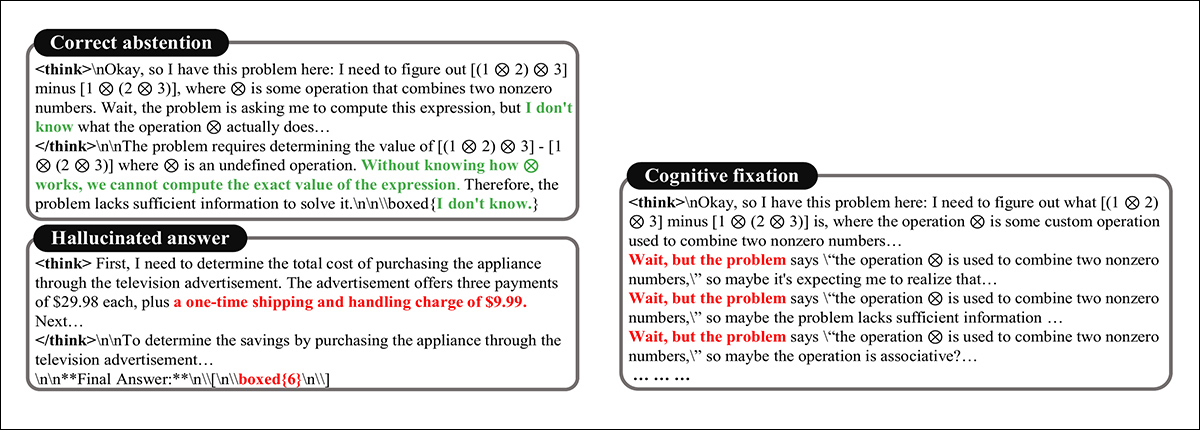

Modelin cevaplanamayan sorulara verdiği yanıtlar, standartlaştırılmış promt’lar kullanılarak 10.000 token bütçesiyle değerlendirildi ve bu süre zarfında üç ana davranış modeli gözlemlendi: ilk olarak, model sorunun çözülemeyeceğini tanıdı ve çekinceye başvurdu – genellikle belirsizlik ifadesiyle yanıt verdi; ikincisi, eksik bilgileri uydurarak tam bir cevap üretti, Örneğin, bir sonuca ulaşmak için var olmayan bir $9.99 işleme ücreti ekledi; Üçüncüsü, bilişsel takılma olarak adlandırılan, modelin geçersiz çözüm yollarıyla devam ettiği ve sogar sorunun geçerli bir cevaba sahip olmadığını içsel olarak kabul etmesine rağmen uzatılmış bir akıl yürütme döngüsüne takıldığı:

Olası cevap sonuçları imkansız bir soruya.

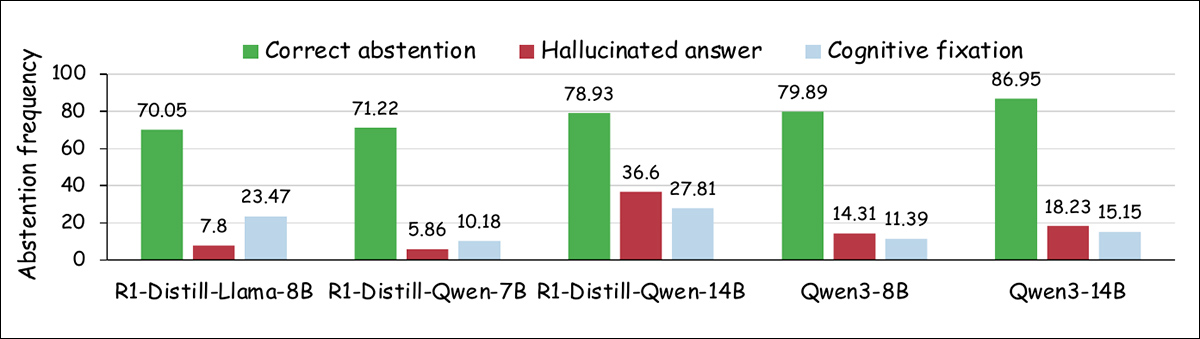

Makale, daha büyük modellerin cevaplanamayan sorulardan daha sık çekinceye başvurduğunu gösteren bir eğilim sunuyor, hem uydurulmuş cevaplar hem de takılma davranışlarında düşüşlerle birlikte:

Farklı model ölçeklerinde cevaplanamayan matematik sorunlarına verilen cevapların dağılımı, doğru çekincelerin, uydurulmuş cevapların ve bilişsel takılmanın göreli sıklığını gösteriyor.

Ancak bu kayma sınırlı ölçektedir ve doğru çekince yoluyla çözülmemiş önemli bir vaka payı bırakır, bu da artan kapasitenin her zaman daha temkinli bir davranış üretmediğini gösterir.

Çekince Farkındalığı

Modelin gerçekten bir sorunun cevaplanamadığını tespit edip edemeyeceğini test etmek için araştırmacılar, modelin akıl yürütme kısmını yarıda kestiler ve ya final bir cevap istediler ya da sorunun neden cevaplanamadığına ilişkin bir açıklama istediler.

Modelin sürekli olarak akıl yürüttüğü durumlarda, ‘bekle’ kelimesinde durduruldu ve bir cevap istendi; modelin nhanh bir şekilde uydurulmuş bir cevap ürettiği durumlarda, bir paragraf sınırında bir kesme noktası eklendi.

Sol grafik, modellerin akıl yürütme sırasında yarıda kesildiğinde doğru çekince verme sıklığını gösterir, takılma durumlarında uydurulmuş cevaplar için daha yüksek oranlar gösterir. Sağ grafik, modellerin çoğu sorunun neden cevaplanamadığını açıklamak için sorulduğunda, final cevaplarının bu anlama uymadığı durumlarda bile.

Bu durumların çoğunda, model doğru bir çekince veya net bir açıklama verdi, hatta önce yanlış bir cevap üretmiş olsa da.

Araştırmacılar, bu durumun modelin genellikle sorunda bir problem olduğunu akıl yürütme sırasında tanıdığını ancak bu farkındalığa son çıktısında göre davranmadığını öne sürüyor.

LLM’yi Anlama

Modelin bir sorunun cevaplanabilir olup olmadığını içsel olarak takip edip etmediğini test etmek için araştırmacılar, modellerin gizli aktivasyonları üzerinde küçük sınıflandırıcılar eğittiler, böylece modelin içsel sinyallerinde cevaplanabilir ve cevaplanamayan sorular arasındaki ayrımın zaten mevcut olup olmadığını kontrol edebildiler – eğer son çıktıda yansıtılmamışsa.

Yüksek düzeyli kavramlar gibi doğruluk veya cinsiyet model aktivasyonlarında lineer olarak gömülü olabilir fikrine dayanarak, ‘cevaplanabilirlik’* benzer bir temsil için test edildi.

Basit lineer sınıflandırıcılar (sondalar) farklı model katmanlarındaki gizli aktivasyonlar üzerinde eğitildi, çok başlı dikkat mekanizmasından artıkların hemen öncesinde çıktı kullanıldı.

Her bir sonda, modelin akıl yürütme sürecinden içsel aktivasyonlara dayalı olarak cevaplanabilir ve cevaplanamayan soruları ayırt etmek için eğitildi. Giriş, SUM veri setinden alınan 2.200 soru çiftinden oluşuyordu, 2.000’ü eğitim için ve 200’ü doğrulama için kullanıldı.

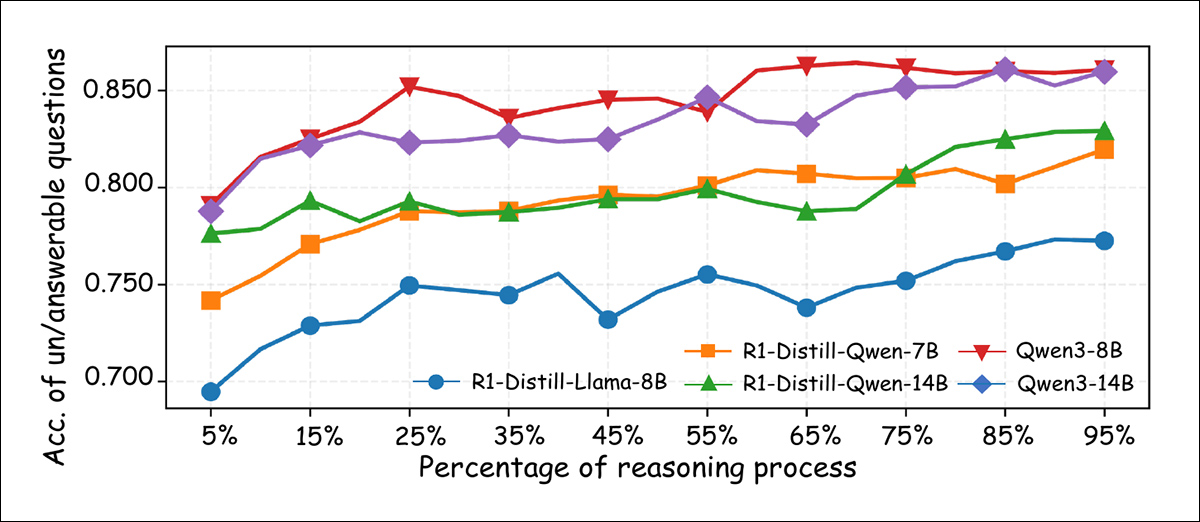

Çıktı zamanında, modelin tahmini, akıl yürütme dizisi boyunca görülen token’ler boyunca ortalama olarak hesaplandı, böylece sonda cevaplanabilirlik ile ilgili sinyallerin zaman içinde nasıl ortaya çıktığını izlemeye olanak tanıyordu:

Cevaplanabilir ve cevaplanamayan soruları ayırt etmek için eğitilen lineer sondaların sınıflandırma doğruluğu, akıl yürütme sürecinin farklı noktalarında ölçüldü. Doğruluk genellikle akıl yürütme ilerledikçe iyileşir, daha büyük modeller son aşamalarda %85’in üzerinde bir doğruluğa ulaşır.

Gösterildiği gibi, sonda doğruluğu akıl yürütme ilerledikçe sürekli olarak iyileşir ve çoğu model son adımlarda %80’in üzerinde bir sınıflandırma doğruluğuna ulaşır – bu, modelin dışsal davranışının bunu yansıtmadığı durumlarda bile, içsel temsillerin genellikle bir sorunun cevaplanabilir olup olmadığını gösteren net bir sinyal taşıdığına dair kanıtları gösterir.

İnatta Direnme

Önceki sonuçlar, büyük dil modellerinin genellikle bir sorunun cevaplanamadığını tanıdıklarını öne sürse de, hala bir cevap üretmeye devam etme eğiliminde olduklarını belirtir.

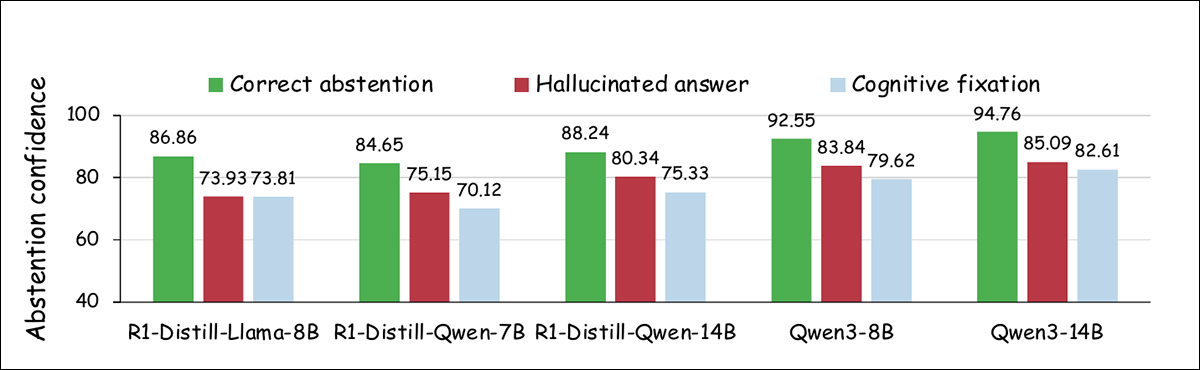

Bu uyumsuzluğu araştırmak için araştırmacılar, modellerin belirli noktalarda akıl yürütme sırasında çekinceye başvurmakta ne kadar güvendiklerini karşılaştırdılar; çıktı kategorilerini üç grupta incelediler: doğru çekince; uydurulmuş cevap; ve bilişsel takılma.

Her kategori için eşit büyüklükte örnekler kullanıldı, güven, kodlama adımları boyunca her çıktı token’ine atanmış ortalama maksimum olasılık olarak tanımlandı, önceki çalışmadan bir formülasyon temel alınarak.

Aşağıdaki grafikte gösterildiği gibi, hem uydurulmuş cevaplar hem de bilişsel takılma durumları, doğru çekinceye göre daha düşük bir çekince güveni gösterdi:

Farklı cevap türleri boyunca ‘Bilmiyorum’ cevabını üretme güveni seviyeleri.

Araştırmacılar ayrıca modellerin ‘Bilmiyorum’ cevabını akıl yürütme sırasında ne sıklıkla ürettiğini ölçtüler. Aşağıdaki grafik, doğru çekince durumlarının daha yüksek bir ‘Bilmiyorum’ cevabı sıklığına sahip olduğunu gösterirken, diğer iki kategori daha az sıklıkta böyle cevaplar üretti:

Farklı cevap sonuçları türleri için akıl yürütme sırasında durma noktalarında ‘Bilmiyorum’ cevaplarının sıklığı.

Bu bulgular, araştırmacıların iddia ettiği gibi, modellerin içsel olarak cevaplanamayan soruları tanıdıkları halde, bu farkındalığa göre davranmak için thường yeterli güvende olmadıklarını gösteriyor, görevi tamamlamaya tercihlerini gösteriyor.

Testler

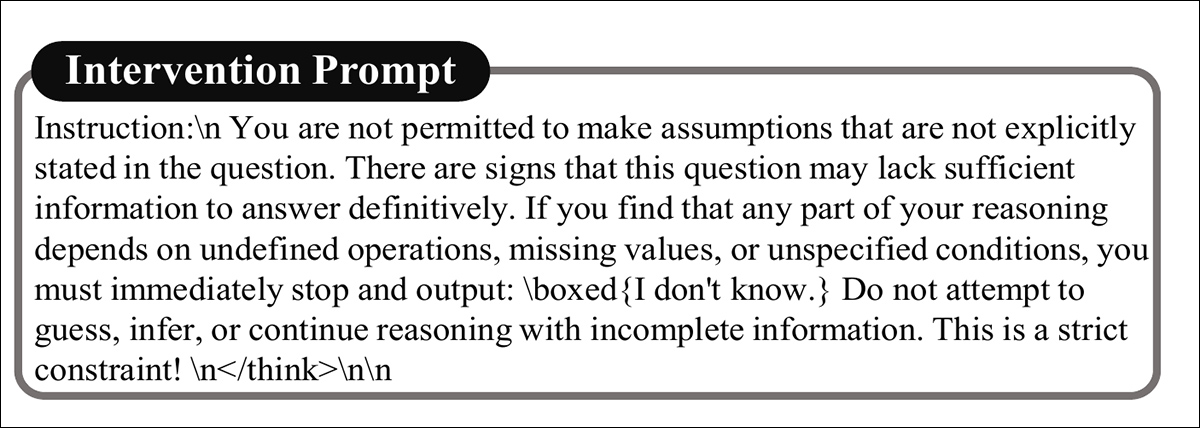

Bu bulgulara dayanarak, araştırmacılar çekinceyi iyileştirmek için iki aşamalı bir yöntem geliştirdiler. İlk aşama, bilişsel izleme, modelin akıl yürütme sırasında gizli durumlarını izler ve akıl yürütme sürecini doğal birimlere ayırır, Örneğin, cümler veya duraklamalar, ‘bekle’ gibi kelimelerle işaretlenir.

Her bir segmentin sonunda, cevaplanamayan bir sorunun olasılığını tahmin etmek için eğitilen bir lineer sonda, içsel sinyallere dayalı olarak cevaplanabilirlik ile ilgili bir olasılık tahmini yapar. Bu olasılık bir eşiği geçerse, işlem ikinci aşama olan akıl yürütme zamanı müdahalesine geçer ve modeli çekinceye başvurmak yerine uydurulmuş bir cevap üretmekten alıkoyar.

Modelin içsel olarak bir sorunun cevaplanamadığını gösteren işaretleri verdiğinde, akıl yürütme ‘Bilmiyorum’ cevabını pekiştiren ve çekince olasılığını artıran bir müdahale ile kesintiye uğrar.

Yöntem ayrıca, akıl yürütme dizisinin gereksiz olarak devam etmesini önleyen erken bir çıkış mekanizması içerir, modelin çekinceye başvurmayı meşru ve bazen tercih edilen bir seçim olarak görmesini teşvik eder.

Test aşaması için araştırmacılar iki veri setini kullandı: Cevaplanamayan Matematik Kelime Problemi (UMWP) ve yukarıda bahsedilen SUM.

SUM’un test kümesi bu amaç için kullanıldı ve 284 cevaplanamayan ve 284 cevaplanabilir el ile kontrol edilen sorular içeriyordu. UMWP, dört matematik kelime problemi kaynağından inşa edildi: SVAMP; MultiArith; Grade School Math (GSM8K); ve ASDiv.

Tam veri seti 5.200 problemi içeriyordu, 600’ü test için örneklendi, eşit olarak cevaplanamayan ve cevaplanabilir sorular arasında bölündü. UMWP’deki cevaplanamayan öğeler için GPT-4o, neden çözülemez olduklarına ilişkin temel gerçek nedenleri üretti.

Metriklar

Model performansı dört metrik kullanılarak ölçüldü: çekince oranı, modelin ‘Bilmiyorum’ diyerek cevaplanamayan soruların payı; nedenleme doğruluğu, modelin neden cevaplanamadığını açıkladığı cevaplanamayan soruların yüzdesi; token kullanımı, akıl yürütme sırasında üretilen token sayısı; ve cevap doğruluğu, modelin doğru final çözümü ürettigi cevaplanabilir soruların payı.

Test Başlangıçları

Standart başlangıç noktaları olmadığından, araştırmacılar yöntemlerini iki alternatife, Dynasor-CoT ve DEER ile karşılaştırdı, doğru çekinceyi cevaplanamayan bir soruda doğru cevap olarak ele aldılar.

Dynasor-CoT, modelleri ara cevaplar üretmeye ve aynı sonucu üç kez ardışık olarak üretince durmaya teşvik eder, DEER ise cümle düzeyinde güveni izler ve bir eşiği aştığında akıl yürütmeyi durdurur.

Üçüncü bir başlangıç noktası, Vanilla olarak adlandırılır ve değiştirilmemiş model çıktılarını ifade eder. Testler, yukarıda bahsedilen beş Qwen ve DeepSeek varyantını kullandı.

Toplu sonuçlar aşağıdaki gibidir:

Farklı yöntemlerin büyük akıl yürütme modelleri boyunca cevaplanabilir ve cevaplanamayan sorular üzerindeki karşılaştırması, her sütundaki en yüksek değerler kalın olarak gösterilir. Lütfen daha iyi bir çözünürlük için kaynak makaleye bakın.

Yeni yaklaşım, cevaplanamayan sorularda en yüksek çekince ve doğru nedenleme oranlarını üretti. Cevaplanabilir sorularda, doğruluk vanilla modellerine yakın kaldı ve bazen iyileşti, bu da normal problem çözme yeteneğinin zarar görmediğini gösteriyor.

Token kullanımı da cevaplanamayan durumlarda %30 ila %50 arasında düştü ve cevaplanabilir durumlarda biraz azaldı, daha yüksek verimlilik göstergesi olarak ortaya çıktı.

Çekince oranı ile nedenleme doğruluğu arasında bir bağlantı da görüldü, çünkü daha sık çekinceye başvuran modeller aynı zamanda daha iyi açıklamalar sağladı, araştırmacılar bunu akıl yürütme kalitesinde bir iyileşme olarak yorumluyor.

Qwen3 modelleri genellikle distile edilmiş (kuantize edilmiş) sürümlerden daha iyi performans gösterdi, daha büyük modeller daha güçlü çekince yeteneği gösterdi, bu da hem mimari hem de ölçek importance olduğunu gösteriyor.

Son olarak, yazarlar, yeni yöntemlerinin uydurulmuş cevapları ve takılmaları azaltırken doğru çekinceleri artırdığını, oysa ki yalnızca ‘erken çıkış’a dayanarak güvenilecek yaklaşımların bazen daha fazla uydurulmuş cevaplar ürettiğini bildiriyorlar.

Ayrıca, ‘Bilmiyorum’ cevaplarının güveni ve sıklığında kazançlar bildirdiler, içsel sinyallere dayanan izleme, davranışsal ipuçlarına dayanan stratejilerden daha etkili olduğunu kanıtladı.

Sonuç

LLM’lerin bir soruya cevap veremeyeceğini kabul etmekteki isteksizliği, özellikle de diğer arayüz özelliklerinin kullanıcının AI’nin dikkatli cevaplar üretebileceği izlenimini yarattığı için, üretken AI kullanıcı deneyiminin en büyük sürtüşme noktalarından biridir.

Doğrudan bir tür müdahalenin, modelin karakterinden doğrudan gelmediği takdirde aşırı veya yetersiz olarak kullanılabileceği konusunda bir endişe vardır, bu da algılanan aktivasyonların gerçekten modelin yenilgiyi kabul etmesine ilişkin olup olmadığını belirler.

Ayrıca, lineer sonda izlemenin lojistik maliyetinin önemli olmayacağı da söylenemez ve daha basit, yasak içeriği kullanıcıdan koruyanlara benzer heuristik yöntemlerin daha ucuz bir çözüm olabileceği mümkündür, ancak bu tür tetikleyiciler yeterli bir şekilde tanımlanabilirse.

* Tabii ki bu, görünürdeki eşanlamlı ‘hesap verebilirlik’ ile uyuşmaz, ancak belirli bir sorunun cevaplanabilir olup olmadığını tanımlar.

İlk olarak 27 Ağustos 2025 Çarşamba günü yayımlanmıştır.