Anderson’un Açısı

AI Modellerini Sansürleme İyi Çalışmıyor, Araştırma Açıkladı

AI görüntü oluşturucularını sansürlemek için yasaklanmış içerikleri (örneğin pornografi, şiddet veya telif hakkı içeren stiller) eğitimli modellerden silme girişimleri başarısız oluyor: yeni bir araştırma, mevcut kavram silme yöntemlerinin “yasaklanmış” özniteliklerin ilgili olmayan görsellere sızmalarına izin verdiğini ve ayrıca sözde “silinen” içeriğin yakından ilgili sürümlerinin görünmesini durdurmayı başaramadığını ortaya koyuyor.

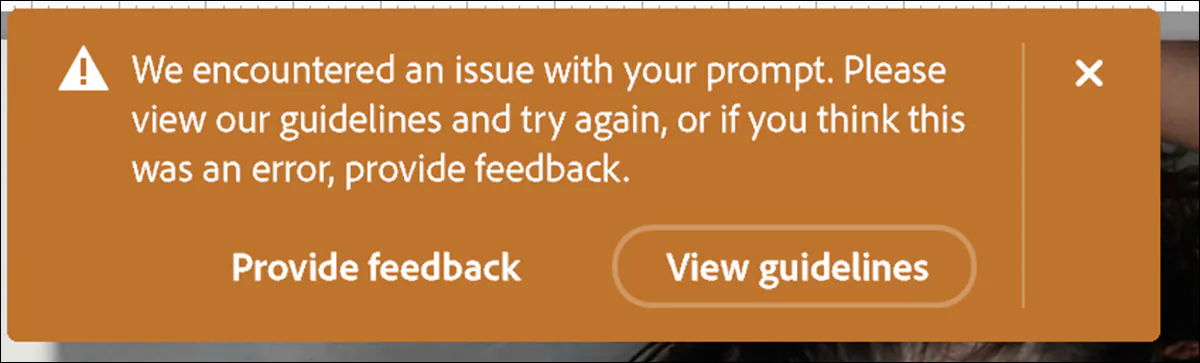

Şirketler temel AI modellerini üretip de bunları objectionable veya yasadışı materyal üretmek için kötüye kullanılmasını önleyemezse, dava edilmesi ve/veya kapatılma riski ile karşı karşıya kalabilirler. Buna karşılık, yalnızca API aracılığıyla modellerini sunan satıcılar, Adobe’un Firefly üretken motoru gibi, modellerinin ne oluşturabileceğinden endişe etmezler, çünkü hem kullanıcıların promt’ları hem de oluşan çıktı denetlenir ve sterilize edilir:

Adobe’un Firefly sistemi, Photoshop gibi araçlarda kullanılır ve bazen bir üretken isteği hemen reddeder, hiçbir şey yaratılmadan önce promt’u engeller. Bazen de görüntüyü üretir, ancak sonra sonucu gözden geçirir ve engeller. Bu tür orta-süreli ret, ChatGPT’de de olabilir, model bir yanıt başlattıktan sonra bir politika ihlalini tanıyarak onu kesintiye uğratır – ve bazen bu süreçte iptal edilen görüntüyü kısa bir süre için görebilirsiniz.

Ancak, bu tür API-style filtreleri, genellikle yerel olarak kurulan modellerde, kullanıcılar tarafından nötralize edilebilir, bu modeller arasında VLM’ler (görme-dil modelleri) de bulunur ve kullanıcılar bunları yerel olarak özel veri üzerinde eğitim yoluyla özelleştirmek isteyebilirler.

Bu tür işlemleri devre dışı bırakmak genellikle basittir ve Python’da bir işlev çağrısını yorumlamak (ancak bu tür hileler genellikle çerçeve güncellemelerinden sonra tekrar edilmeli veya yeniden icat edilmelidir) içerir.

Bir iş perspektifinden, bu bir sorun olarak nasıl anlaşılabilir, çünkü API yaklaşımı kullanıcıların iş akışındaki kurumsal kontrolü en üst düzeye çıkarır. Ancak, kullanıcıların perspektifinden, API-only modellerin maliyeti ve yanlış veya aşırı sansür riski, onları açık kaynaklı alternatiflerin yerel kurulumlarını indirmeye ve özelleştirmeye zorlayacaktır – en azından, FOSS lisansı lehine olduğunda.

Son önemli model, self-sansürleme içermeyen son sürüm, Stable Diffusion V1.5 idi, yaklaşık üç yıl önce. Daha sonra, eğitim corpora’sının CSAM verilerini içerdiği ortaya çıkması, erişiminin yasaklanması için artan çağrılar ve 2024’te Hugging Face deposundan kaldırılmasıyla sonuçlandı.

Kes!

Kırgınlar, bir şirketin yerel olarak kurulabilir üretken AI modellerini sansürleme ilgisi, yalnızca yasal sorumluluk endişelerine dayalı olduğunu iddia ediyorlar, eğer çerçeveleri yasadışı veya objectionable içerik oluşturmak için kullanıldığını kamuoyuna duyururlarsa.

Aslında, bazı ‘yerel dostu’ açık kaynaklı modeller sansürden kurtulmak o kadar zor değil (örneğin, Stable Diffusion 1.5 ve DeepSeek R1).

Karşılaştırıldığında, Black Forest Lab’ın Flux Kontext model serisinin yakın zamanda piyasaya sürülmesi, şirketin tüm Kontext serisini sansürleme taahhüdünü vurguladı. Bu, özenli veri kürasyonu ve eğitim sonrası hedeflenen ince ayar ile gerçekleştirildi ve NSFW veya yasaklanmış içeriğe yönelik herhangi bir arta kalan eğilimini ortadan kaldırmak için tasarlandı.

Bu, araştırmalar sahnesinde son 2-3 yıl içinde eylem locus’u burada olmuştur: veri kürasyonu不足 olan modellerin sonradan düzeltilmesiyleemphasis.

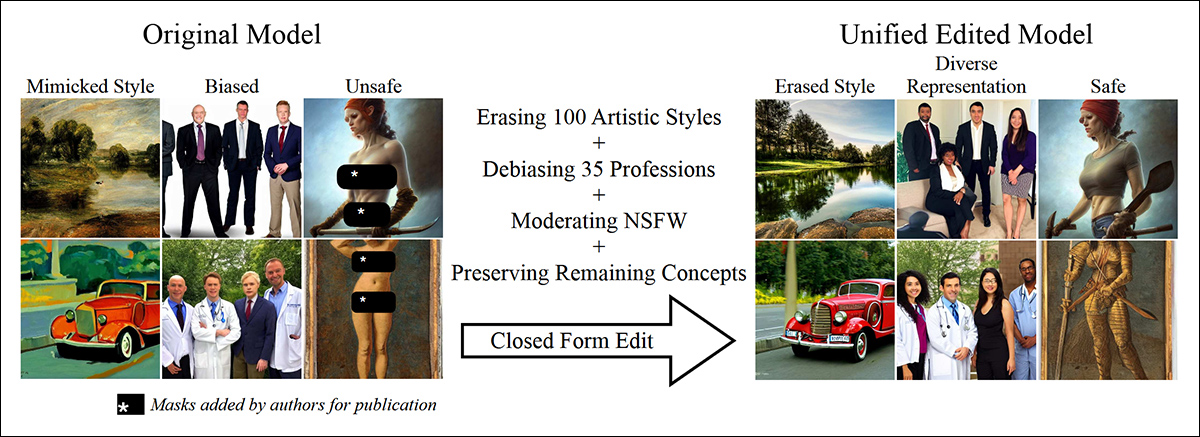

Bu tür teklifler arasında Unified Concept Editing in Diffusion Models (UCE); Reliable and Efficient Concept Erasure of Text-to-Image Diffusion Models (RECE); Mass Concept Erasure in Diffusion Models (MACE); ve concept-Semi-Permeable structure is injected as a Membrane (SPM):

2024 makalesi ‘Unified Concept Editing in Diffusion Models’, metin-görsel modellerinde birden fazla kavramın verimli bir şekilde düzenlenmesini sağlayan kapalı-form düzenleme sunuyor. Ancak bu yöntem incelemeye dayanabilir mi? Kaynak: https://arxiv.org/pdf/2308.14761

Bu, verimli bir yaklaşım (hiperscale koleksiyonları gibi LAION çok büyük ve elle küratörlüğü zor), ancak mutlaka etkili bir yaklaşım değil: yeni bir ABD araştırması, yukarıda bahsedilen düzenleme prosedürlerinin hiçbiri aslında çok iyi çalışmıyor.

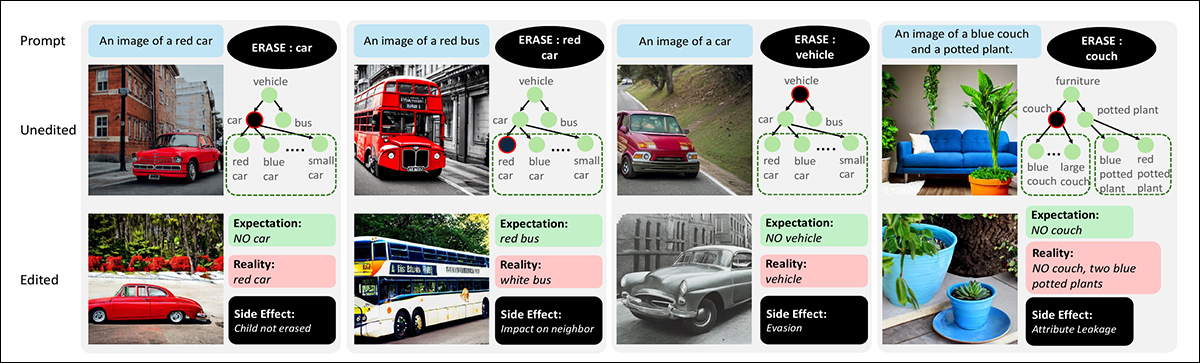

Araştırmacılar, bu Kavram Silme Tekniklerinin (CET) genellikle kolayca atlatılabileceğini ve etkili olduklarında bile önemli yan etkileri olduğunu buldular:

Metin-görsel modellerinde kavram silmenin etkileri. Her sütun, bir promt ve silinecek kavramı gösterir, ayrıca düzenlemeden önce ve sonra oluşturulan çıktıları da içerir. Hiyerarşiler, kavramlar arasındaki ebeveyn-çocuk ilişkilerini gösterir. Örnekler, çocuk kavramlarını silmeyi başaramama, komşu kavramlarını bastırma, yeniden ifade yoluyla kaçınma ve silinen özniteliklerin ilgili olmayan nesnelere aktarılması gibi yaygın yan etkileri vurgular.

Araştırmacılar, önde gelen mevcut kavram silme tekniklerinin kompozisyonel promtleri (örneğin, kırmızı araba veya küçük ahşap sandalye) engellemekte başarısız olduğunu buldular; genellikle, bir üst kavramı sildikten sonra bile alt sınıfları kaçırmaya devam etti (örneğin, araba veya otobüs gibi araç silindikten sonra hala görünmeye devam ediyor); ve yeni sorunlar ortaya çıkardı, örneğin öznitelik sızıntısı (örneğin, mavi kanepe silindiğinde, modelin mavi sandalye gibi ilgili olmayan nesneleri üretmesine neden olabilir).

Test edilen vakaların %80’inde, geniş bir kavramı (araç gibi) silmek, modelin daha spesifik araç örneklerini (araba veya otobüs gibi) üretmesini durdurmadı.

Düzenleme, makaleye göre, ayrıca dikkat haritalarını (görselin hangi kısmına odaklanacağına karar veren modelin parçaları) dağınık hale getirir ve çıktı kalitesini zayıflatır.

İlginç bir şekilde, makale, ilgili eğitimli kavramları birer birer silmenin, hepsini aynı anda silmeye çalışmaktan daha iyi çalıştığını buldu – ancak bu, incelenen düzenleme yöntemlerinin tüm eksikliklerini ortadan kaldırmaz:

Sürekli ve bir defada silme stratejilerinin karşılaştırması. Tüm ‘teddy bear’ varyantları aynı anda silindiğinde, model hala ayı benzeri nesneleri üretmeye devam eder. Adım adım silmek daha etkili olur ve modelin hedef kavramı daha güvenilir bir şekilde bastırmasına yol açar.

Araştırmacılar şimdilik bu sorunlara bir çözüm sunamazlar, ancak gelecekteki araştırmaların kendi ‘sansürlü’ modellerinin beklendiği gibi çalışıp çalışmadığını anlamalarına yardımcı olacak yeni bir veri kümesi ve benchmark geliştirdiler.