Anderson’un Açısı

Görsel Benzerliklerin Yapay Zekaya Getirilmesi

Şu anki yapay zeka modelleri, Dünya’nın katmanlarının bir şeftaliye benzerliği gibi ‘ilişkisel’ görüntü benzerliklerini tanımakta başarısız olurlar, bu da insanların görüntüleri nasıl algıladıklarının önemli bir yönünü kaçırır.

Birçok bilgisayarlı görme modeli, görüntüleri karşılaştırma ve aralarında benzerlikler bulma konusunda yeteneklidir, ancak karşılaştırmalı sistemlerin mevcut nesli, hayal gücü açısından çok az veya hiç yeteneğe sahip değildir. 1960’ların klasik şarkısı Ruhun Yel Değirmenleri中的 bazı sözleri düşünün:

Ayın etrafında halkalar çizerek dönen bir karusel gibi

Saat yüzünün dakika işaretlerinin geçtiğine tanık olan bir saat gibi

Ve dünya, sessizce uzayda dönen bir elma gibi

Bu tür karşılaştırmalar, insanlara sanatsal ifade ötesinde anlamlı olan bir şiirsel imanın alanını temsil eder; aslında, bu, algısal sistemlerimizi geliştirmemiz ve ‘nesne’ alanımızı oluşturmamızla bağlantılıdır, böylece görsel benzerlik kapasitesi geliştiririz, böylece – örneğin – bir şeftali ve Dünya gezegeninin kesitleri veya kahve spiral ve galaksi dalları gibi fraktal tekrarları, bizimle benzer olarak kaydedilir.

Bu şekilde, görünüşte bağlantısız nesneler ve nesne türleri arasındaki bağlantılar çıkarabilir ve sistemleri çıkarabiliriz (örneğin yerçekimi, momentum ve yüzey yapışkanlığı) ve çeşitli ölçeklerde çeşitli alanlara uygulanabilir.

Görüntüleri Görmek

Hatta son nesil görüntü karşılaştırma yapay zeka sistemleri, chẳng hạn LPIPS ve DINO, insan geri bildirimi ile bilgilendirilir, ancak yalnızca yüzey karşılaştırmaları yapar.

Var olmayan yüzleri bulma yetenekleri – yani pareidolia – insanların geliştirdiği görsel benzerlik mekanizmalarını temsil etmez, ancak yüz arama algoritmalarının düşük seviye yüz yapısı özelliklerine dayanması ve bazen rastgele nesnelerle uyumlu olması nedeniyle gerçekleşir:

Yüz tanıma için ‘Şeylerle Yüzler’ veri setindeki yanlış pozitif örnekleri. Kaynak

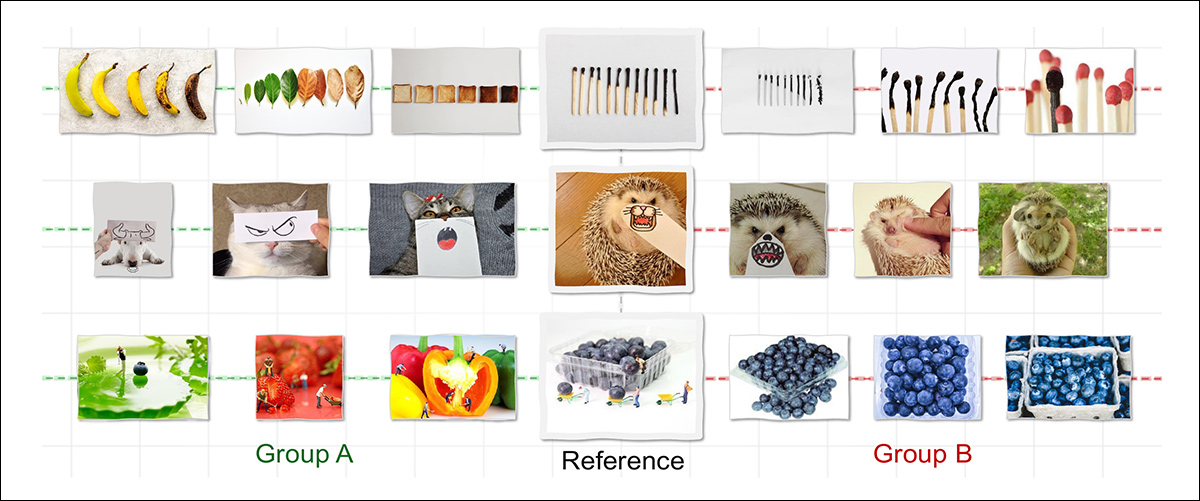

Makinelerin gerçekten bizim görsel benzerliği tanıma yeteneğimizi geliştirebileceğini belirlemek için, ABD’li araştırmacılar bir çalışma gerçekleştirdiler. İlişkisel Görsel Benzerlik hakkında, soyut ilişkiler oluşturmak için tasarlanmış ve eğitilmiş yeni bir veri seti oluşturdular:

Çoğu yapay zeka modeli yalnızca yüzey özelliklerini paylaştıkları için yalnızca Grup B’yi (yukarıda) referansla bağlar. İnsanlar ise Grup A’yı da benzer olarak görür – çünkü görüntüler benzer görünmese de aynı temel mantığı takip ederler, örneğin zaman içinde bir dönüşümü gösterir. Yeni çalışma, bu tür yapısal veya ilişkisel benzerliği yeniden üretmeyi amaçlar, böylece makine algısını insan muhakemesine yaklaştırır. Kaynak: https://arxiv.org/pdf/2512.07833

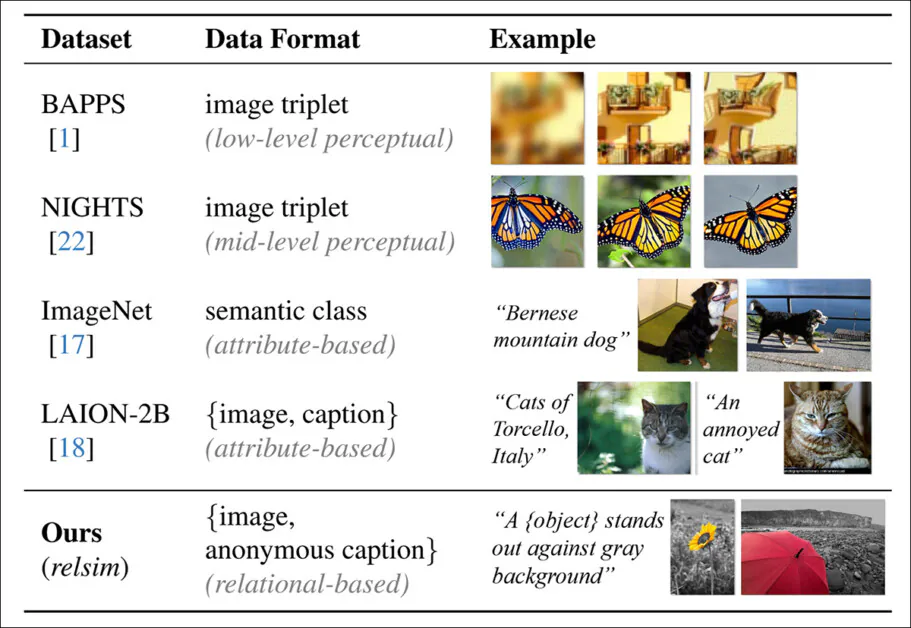

Veri seti için geliştirilen kaptiyon sistemi, yapay zeka sistemlerinin yerel ayrıntılara odaklanmak yerine temel özelliklere odaklanmalarını sağlamak için alışılmadık şekilde soyut açıklamalar içerir:

Yazarların ‘relsim’ ölçütüne katkıda bulunan tahmin edilen ‘anonim’ açıklamalar.

Toplanan koleksiyon ve alışılmadık açıklama stili, yazarların yeni önerilen relsim ölçütünü besler, bu ölçütü yazarlar ince ayarlamışlardır ve bir görme-dil modeline (VLM) dönüştürmüşlerdir.

Tipik veri setlerinin açıklama stilini (öznitelik benzerliğine odaklanma) ve relsim yaklaşımını (ilişkisel benzerliğe vurgulama) karşılaştırma.

Yeni yaklaşım, bilişsel bilimden metodolojilere dayanır, özellikle Dedre Gentner’in Yapı-Haritalama teorisi (bir analoji çalışması) ve Amos Tversky’nin tanımı ilişkisel benzerlik ve öznitelik benzerliği.

İlişkisel benzerlik örneği. Kaynak

Yazarlar şunları belirtir:

‘İnsanlar öznitelik benzerliğini algısal olarak işler, ancak ilişkisel benzerlik kavramsal soyutlama gerektirir, genellikle dil veya önceden edinilmiş bilgi ile desteklenir. Bu, ilişkisel benzerliği tanımak için önce görüntüyü anlamak, bilgiye dayanmak ve altta yatan yapısını soyutlamak gerektiğini gösterir.’

Yeni makale İlişkisel Görsel Benzerlik olarak adlandırılmıştır ve bir proje web sitesi ile birlikte gelir (bu makalenin sonunda gömülü videoyu görün).

Yöntem

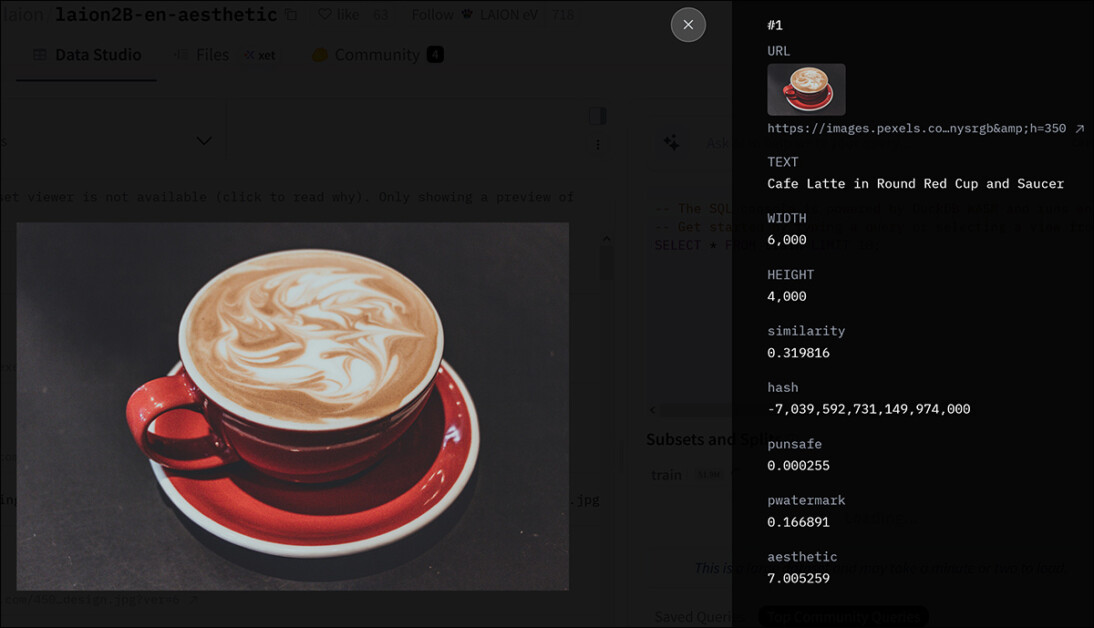

Araştırmacılar, kendi koleksiyonları için başlangıç noktası olarak en iyi bilinen hiperscale veri setlerinden birini kullandılar – LAION-2B:

LAION-2B koleksiyonundaki bir girişin meta verileri. Kaynak

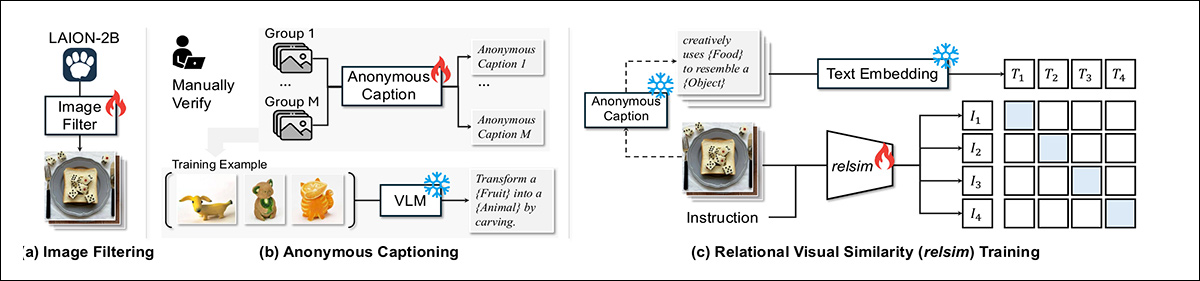

Esnek ilişkisel yapılar içeren 114.000 görüntü, LAION-2B’den çıkarıldı ve bu, birçok düşük kaliteli görüntünün bulunduğu minimally-curated veri setinin süzülmesini içeriyordu.

Seçim süreci pipeline’ı oluşturmak için, yazarlar Qwen2.5-VL-7B kullandılar, 1.300 pozitif ve 11.000 negatif insan-etiketli örnekleri kullanarak:

relsim sistemi üç aşamada eğitilir: LAION-2B’den ilişkisel içerik için görüntüleri süzme; her gruba altta yatan mantığı yakalayan paylaşılan bir anonim açıklama atama; ve karşıtlık kaybı kullanarak görüntüleri açıklamalara eşleme.

Makalede şunlar belirtilir:

‘Annotatörler talimat aldı: “Bu görüntüde başka bir görüntüyle bağlantı kurmak veya oluşturmak için yararlı olabilecek herhangi bir ilişkisel kalıp, mantık veya yapı görüyor musunuz?” İnce ayarlanmış model, insan yargılarıyla %93 anlaşma sağlar ve LAION-2B’ye uygulandığında N = 114k görüntüyü ilişkisel olarak ilginç olarak tanımlar.’

İlişkisel etiketler oluşturmak için, araştırmacılar Qwen modelini, belirli nesneleri adlandırmadan, görüntülerin paylaştığı mantığı açıklamaya davet ettiler. Bu soyutlama, model yalnızca bir görüntü gördüğünde elde edilmesi zordu, ancak birden fazla örnek altta yatan kalıbı gösterdiğinde mümkün hale geldi.

Sonuçlanan grup düzeyindeki açıklamalar, ‘{Subject}’ veya ‘{Type of Motion}’ gibi yer tutucularla özel terimleri değiştirdi, böylece geniş olarak uygulanabilir hale geldi.

İnsan doğrulamasının ardından, her açıklama grubundaki tüm görüntülerle eşleştirildi. 500’den fazla grup, modeli eğitmek için kullanıldı ve daha sonra 114.000 süzülmüş görüntüye uygulanarak büyük bir soyut, ilişkisel olarak açıklanmış örnek kümesi üretildi.

Veri ve Testler

Qwen2.5-VL-7B ile ilişkisel özelliklerin çıkarılmasının ardından, model LoRA kullanılarak 15.000 adımda, sekiz A100 GPU ile ince ayarlandı*. Metin tarafında, ilişkisel açıklamalar all-MiniLM-L6-v2 kullanılarak Sentence-Transformers kitaplığı ile gömüldü.

114.000 açıklamalı görüntü veri seti, 100.000 eğitim ve 14.000 değerlendirme için bölündü. Sistemi test etmek için, bir geri çağırma kurulumu kullanıldı: verilen bir sorgu görüntüsüne, 28.000 öğelik bir havuzdan aynı ilişkisel fikri ifade eden farklı bir görüntü bulması gerekiyordu. Geri çağırma havuzu, 14.000 değerlendirme görüntüsünü ve LAION-2B’den 14.000 ek örnekleri içeriyordu, 1.000 sorgu, benchmarking için değerlendirme kümesinden rastgele seçildi.

Geri çağırma kalitesini değerlendirmek için, GPT-4o kullanılarak her sorgu ve alınan görüntü arasında ilişkisel benzerlik 0 ile 10 arasında puanlandı. Ayrıca, kullanıcı tercihini değerlendirmek için ayrı bir insan çalışması yürütüldü (aşağıya bakınız).

Her katılımcı, anonimleştirilmiş bir sorgu görüntüsü ile birlikte, önerilen yöntem tarafından alınan bir aday ve bir temel çizgi tarafından alınan bir aday gösterildi. Katılımcılardan, hangisinin sorgu ile daha ilişkisel olarak benzer olduğu veya her ikisinin de eşit derecede yakın olup olmadığı soruldu. Her temel çizgi için, en az üç kişi tarafından her biri 300 triplet oluşturuldu ve puanlandı, yaklaşık 900 yanıt elde edildi.

relsim yaklaşımı, LPIPS, DINO, dreamsim ve CLIP-I dahil olmak üzere several kurulan görüntü-görüntü benzerliği yöntemleriyle karşılaştırıldı.

Mevcut Ölçütler ve İlişkisel Benzerlik

Yazarlar ilk olarak mevcut ölçütlerin ilişkisel benzerliği yakalayabileceğini test ettiler:

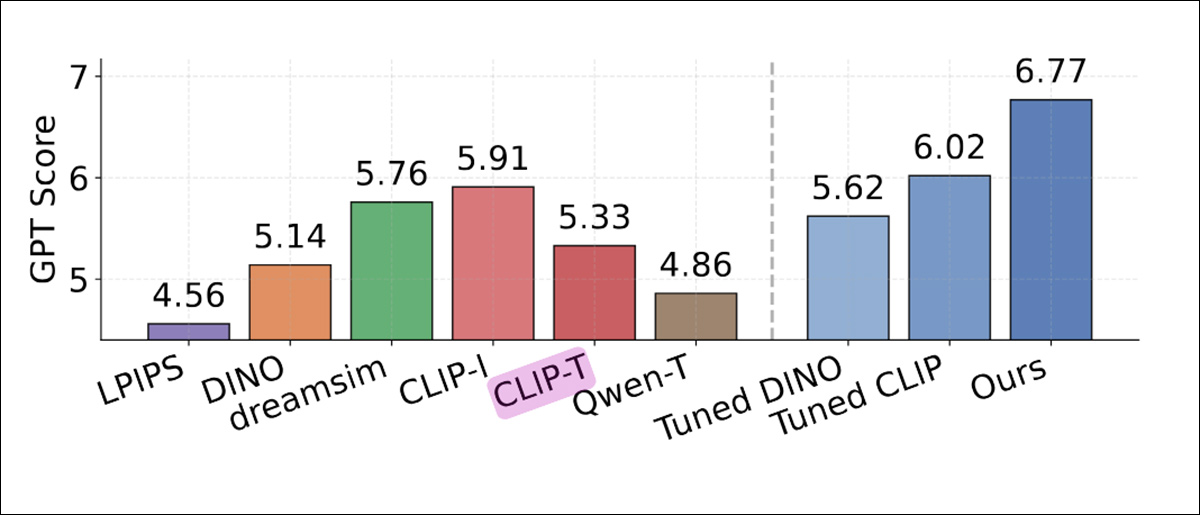

GPT-4o tarafından verilen ortalama ilişkisel benzerlik puanı. LPIPS, DINO ve CLIP-I gibi geleneksel benzerlik ölçütleri daha düşük puanlar aldı, hatta ayarlanmış sürümlerinde bile. Açıklama tabanlı temel çizgiler Qwen-T ve CLIP-T de düşük performans gösterdi. En yüksek puan, relsim tarafından (6,77, sağdaki mavi sütun) elde edildi, bu da grup tabanlı ilişkisel kalıplara ince ayarlanmanın GPT-4o değerlendirmeleriyle uyumlu olduğunu gösterdi.

Bu sonuçlarla ilgili olarak, yazarlar şunları belirtir:

‘[LPIPS], yalnızca algısal benzerliğe odaklanan, en düşük puanı (4,56) elde etti. [DINO] yalnızca biraz daha iyi performans gösterdi (5,14), muhtemelen yalnızca kendi kendine eğitimli bir şekilde görüntü verilerine dayandığı için. [CLIP-I] en güçlü sonuçları veren temel çizgidir (5,91), muhtemelen bazı soyutlama bazen görüntü açıklamalarında mevcut olduğu için.

‘Ancak CLIP-I hala bizim yöntemimize göre daha düşük performans gösterir, çünkü daha iyi bir puan elde etmek, daha yüksek düzeyde soyutlamalar elde etme yeteneği gerektirebilir, örneğin anonim açıklamalar gibi.’

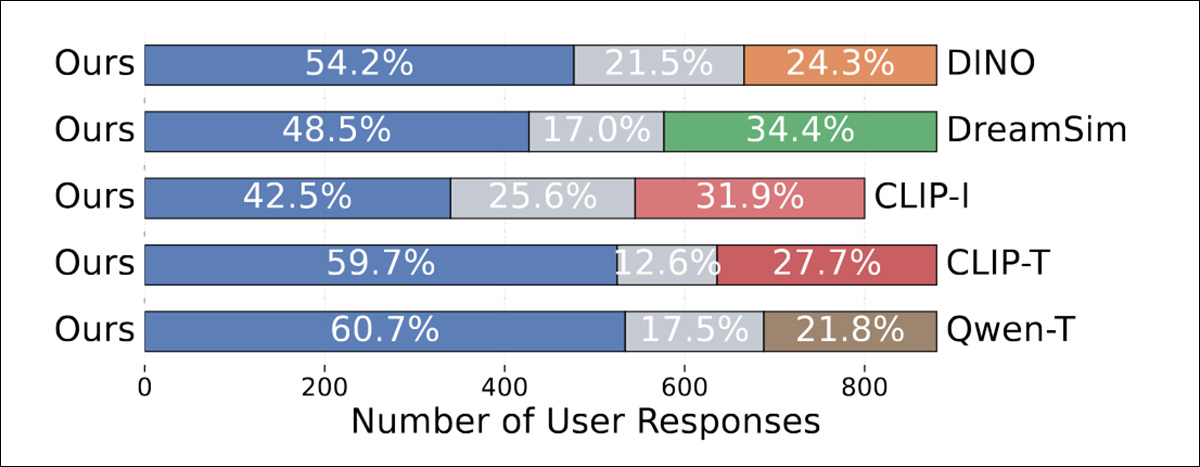

İnsan çalışmasında, insanlar tutarlı bir şekilde tüm temel çizgilerde relsim yöntemini tercih etti:

Her yöntem için GPT-4o tarafından verilen ilişkisel benzerlik puanları. LPIPS, DINO ve CLIP-I gibi standart benzerlik ölçütleri daha düşük puanlar aldı, açıklama tabanlı varyantlar Qwen-T ve CLIP-T yalnızca biraz daha iyi performans gösterdi. DINO ve CLIP’in ayarlanmış sürümleri bile farkı kapatmadı. En yüksek puan, grup tabanlı gözetimle eğitilen önerilen model tarafından (6,77) elde edildi.

Yazarlar şunları belirtir:

‘Bu çok cesaret verici, çünkü sadece bizim modelimizin, relsim, ilişkisel olarak benzer görüntüleri başarılı bir şekilde alabileceğini göstermekle kalmaz, aynı zamanda tekrar tekrar insanların ilişkisel benzerliği algıladıklarını teyit eder – yalnızca öznitelik benzerliği değil!’

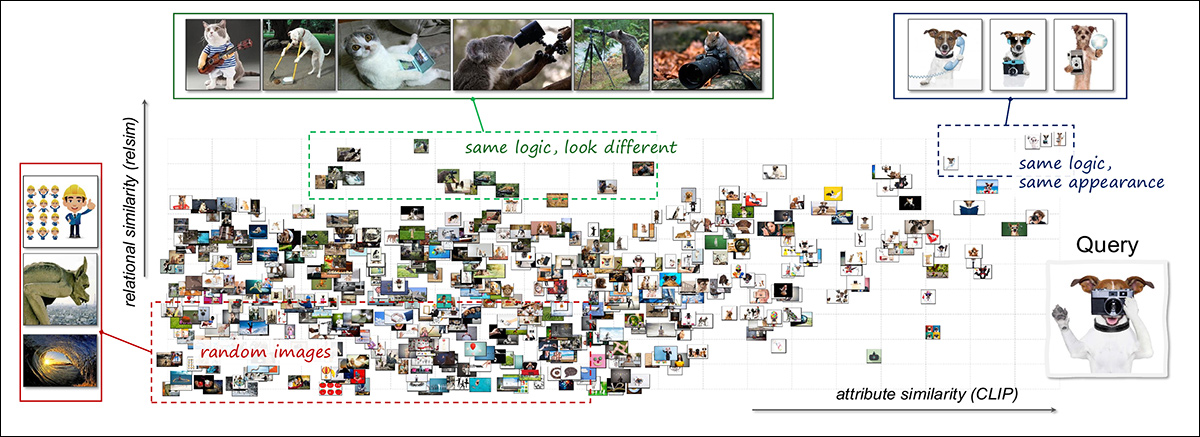

İlişkisel ve öznitelik benzerliklerinin birbirini tamamlamak için nasıl kullanılabileceğini keşfetmek için, araştırmacılar birleşik bir görselleştirme yöntemi kullandı. Tek bir sorgu görüntüsü (‘Kamera tutan bir köpek‘) 3.000 rastgele görüntüye karşı karşılaştırıldı ve benzerlik her iki model kullanılarak hesaplandı:

Görsel benzerlik uzayının ilişkisel (dikey) ve öznitelik (yatay) eksenlerle birleşik görselleştirilmesi. Tek bir sorgu görüntüsü, 3.000 diğer görüntüye karşı karşılaştırıldı. Sonuçlar ilişkisel benzerlik (dikey) ve öznitelik benzerliği (yatay) ile organize edildi. Sağ üst bölge, sorgu ile hem mantık hem de görünüş bakımından benzer görüntüleri içerir, örneğin diğer köpeklerin araçlar kullanması gibi. Sol üst bölge, görsel olarak farklı ancak semantik olarak ilişkili örnekleri içerir, örneğin farklı hayvanların kamera ile ilgili eylemler gerçekleştirmesi gibi. Kalan örneklerin çoğu uzayda daha düşük seviyelerde kümelendi, daha zayıf benzerliği yansıtıyor. Düzen, ilişkisel ve öznitelik modellerinin görsel verilerin farklı yönlerini vurguladığını gösteriyor. Lütfen daha iyi bir çözünürlük için kaynak makaleye bakınız.

Sonuçlar, farklı benzerlik türlerine karşılık gelen kümeleri ortaya çıkardı: bazı görüntüler hem ilişkisel hem de görsel olarak benzerdi, örneğin diğer köpeklerin insan benzeri pozlarda; diğerleri mantıksal olarak benzerdi ancak görünüş olarak farklıydı, örneğin farklı hayvanların insan eylemlerini taklit etmesi gibi; kalanı ise hiçbirini göstermedi.

Bu analiz, iki benzerlik türünün ayrı rollerde görev yaptığını ve birleştirildiğinde daha zengin bir yapıya yol açtığını gösterir.

Kullanım Durumları

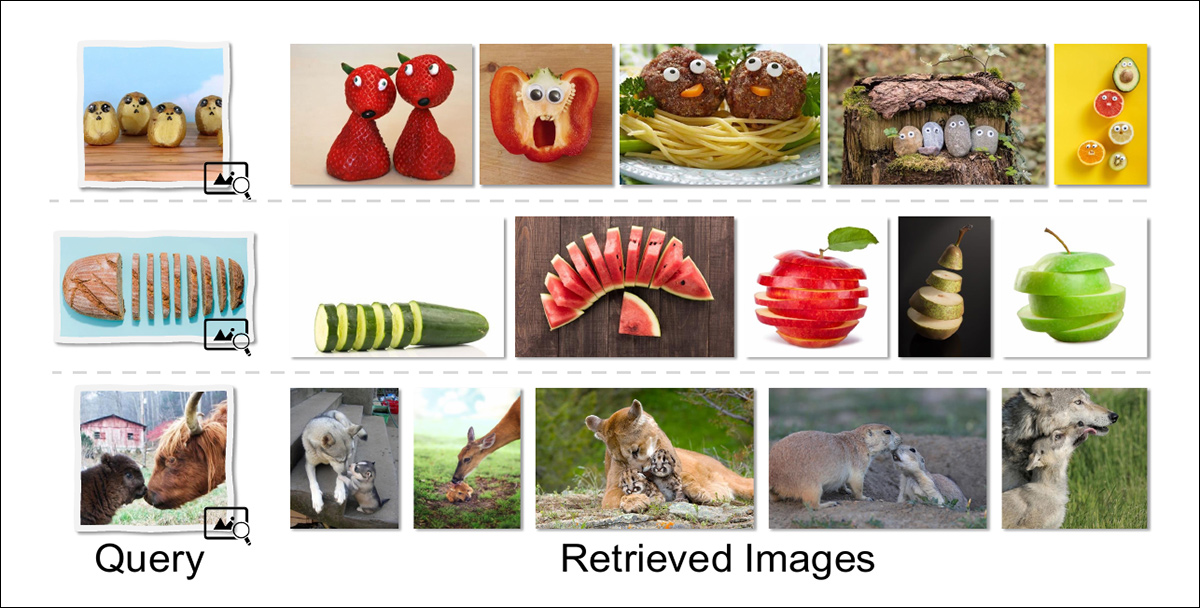

Makale, ilişkisel benzerlik için olası bazı son kullanım durumlarını da araştırır, bunlar arasında ilişkisel görüntü geri çağırma bulunur, bu da görüntüleri insanların kendi yaratıcı şekilde dünyaya bakma yoluna daha uygun bir şekilde arama yapılmasına olanak tanır:

İlişkisel geri çağırma, sorgu ile daha derin bir kavramsal yapı paylaşan görüntüleri döndürür, yüzey özelliklerine uymak yerine. Örneğin, yüz gibi tasarlanmış bir yiyecek, diğer antropomorfik yemekleri geri getirir; bir dilimlenmiş nesne, diğer dilimlenmiş formları verir; ve yetişkin-çocuk etkileşimi sahneleri, tür ve kompozisyon farklılıklarına rağmen benzer ilişkisel rolleri gösteren görüntüleri döndürür.

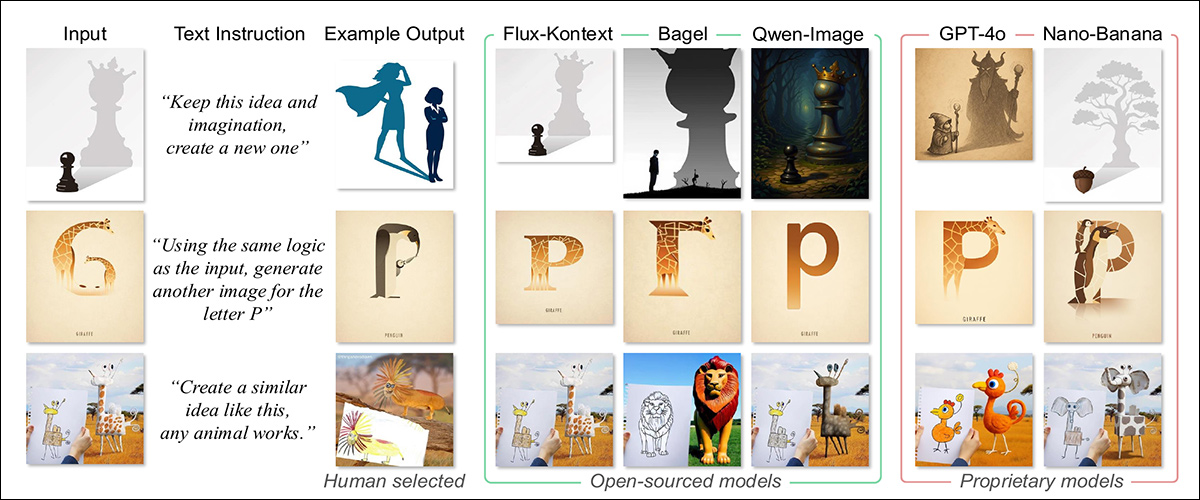

Bir başka olasılık, analojik görüntü oluşturma olabilir, bu da sorguların ilişkisel yapılar kullanmasını değil, doğrudan açıklamalarını sağlar. Mevcut nesil devlet-sanatlı metin-görüntü modellerinin sonuçlarıyla karşılaştırıldığında, böyle bir yaklaşımın daha çeşitli sonuçlar üretebileceği görülür:

Giriş görüntüsü ve ilişkisel bir.prompt verildiğinde, modellere aynı temel kavramı ifade eden yeni bir görüntü oluşturmaları istendi. Özel modeller daha sadık analojiler üretti, büyük şekil değişiklikleri boyunca yapısal mantığı korurken, açık kaynaklı modeller literal veya stilistik eşleşmelere geriledi ve daha derin fikri aktarmayı başaramadı. Çıktılar, amaçlanan dönüşümü örnekleyen insan tarafından oluşturulan analojilerle karşılaştırıldı.

Sonuç

Yapay zeka sistemleri, soyut temsilleri kavramalarına olanak tanıyan bir yetenekle önemli ölçüde geliştirilebilir gibi görünüyor. Şimdiki durumda, ‘öfke’ veya ‘mutluluk’ gibi kavram tabanlı görüntüler istemek, bu ilişkilerin en popüler veya en kalabalık görüntülerinden üretilen görüntülere dönüşmeye eğilimlidir; bu, soyutlama değil, hafızaya almadır.

Bu ilkenin, özellikle analitik, spekülatif veya kurgusal çıktılar için, oluşturucu yazıya uygulanması daha da faydalı olabilir.

Oynatmak için basın. Kaynak

* Bir A100, 40Gb veya 80GB VRAM’a sahip olabilir; bu, makalede belirtilmemiştir.

** Yazarların alıntıları gereksiz ve çıkarılmıştır.

İlk olarak 16 Aralık 2025 Salı günü yayımlandı