Anderson’un Açısı

Uzunluk Azaltma, Büyük Dil Modellerindeki Doğruyu Arttırıyor

Yeni bir araştırmaya göre, Büyük Dil Modellerinin daha kısa cevaplar vermesi için zorlanması, cevaplarının doğruluğunu ve kalitesini önemli ölçüde artırıyor.

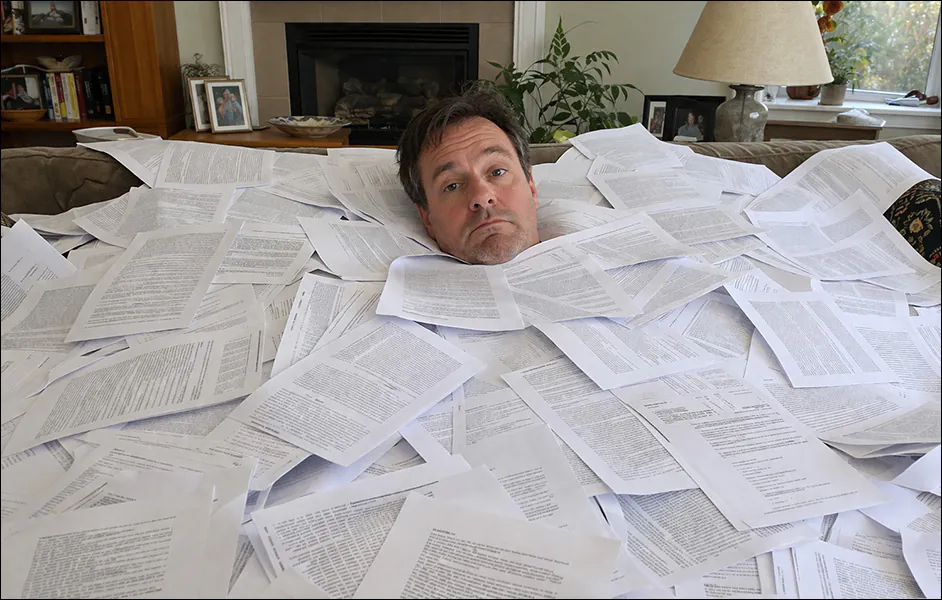

Herhangi bir chatbot’un ‘söylentilerini’ durdurmaya çalışan herkes, yeni araştırmanın sonuçlarını tanıyacaktır: AI’ya daha kısa cevaplar vermesi için zorlamak, daha doğru cevaplar vermesini sağlar.

Büyük AI sohbet botlarının, belirli durumlarda (ters ölçekleme olarak bilinen) küçük olanlardan daha kötü performans göstermesinin nedenlerini araştıran araştırma, 31 popüler Büyük Dil Modelinin (LLM) daha kısa cevaplar vermesi için zorlanmasıyla, cevaplarının doğruluğunda %26,3’e varan bir iyileşme olduğunu buldu:

‘Sonuçlar, kısalık kısıtlamalarının büyük model doğruluğunu %26,3 puan artırdığını ve ters ölçekleme açığını %67 ( %44,2’den %14,8’e ) azalttığını gösteren güçlü nedenler sunuyor; çift t-testi: t = 7,80, p < 0,0001 '

Fazla lafazanlık, özellikle ticari sınıf modelleri kullananlar arasında sıkça şikayet edilen bir husustur; örneğin ChatGPT’de destek forumları bu konuyu sıkça içerir.

En çok etkilenen alan, Aİ’lerin 50 kelimeden az cevaplar vermesi gereken matematik olurken, okuma anlama görevleri için ise sadece 10 kelimelik cevaplar vermesi istendi.

Makale, AI’nın lafazanlığa eğilimini aşırı düşünme olarak tanımlar; burada merkezi mesaj sadece lafazanlıkla gizlenmekle kalmaz, bazen de bundan olumsuz etkilenir. Makaleye göre, model ne kadar küçükse, bu çözümün uygulanmasına gerek duyulmaz veya çalışmaz.

Araştırma, bu çözümü sistematik olarak uygulamak için mimari olarak ele alınması gereken hiçbir şey olmadığını kếtüller; ancak, bir kullanıcı oturumunda, lafazanlığa karşı bir yönlendirme muhtemelen tekrarlanacaktır, oysa bir platformda genel olarak uygulanacak bir sistem ipucu – örneğin ChatGPT gibi platformlarda – daha kısa cevapları varsayılan davranış haline getirebilir.

Şiddetli Rüzgarlar

Bununla birlikte, daha büyük modellerin neden lafazanlığa eğilimli olduğu tam olarak açıklanmıyor, çünkü bu durum açık kaynaklı modelleri de etkiliyor. Makale, İnsan Geri Bildiriminden Takviye Öğrenimi (RLHF) tekniklerinde kullanılan protokoller ve ortak uygulamaların bir açıklama sunabileceğini öne sürüyor:

‘Makul bir açıklama, RLHF hizalama eğitimi olabilir, burada insan annotatörleri daha büyük modellerde daha büyük kapasiteye sahip olanları daha uzun cevaplar için ödüllendiriyor – instruction-tuned varyantlarda lafazanlığın daha büyük olduğuyla tutarlı olarak.’

‘Önceki çalışmalar, ödül modellerinde ve modellerinde sistemli uzunluk önyargısı belgeliyor, burada annotatörler uzunluğu kaliteyle karıştırıyor.’

‘Daha büyük modeller, uzunluk-ödül sinyallerine cevap verebilecek daha büyük kapasiteye sahip olarak, lafazanlığı küçük modellerden daha derine internalize edebilir ve gözlemlediğimiz ölçek bağımlı aşırı düşünmeyi üretebilir.’

İnsanlarda lafazanlık, suskunluğu doldurmak için, garip hissetmemek için, ruhsal hastalık nedeniyle veya bilgi eksikliğini gizlemek için ortaya çıkabilir. Aslında, bir AI yalnızca bu özelliklerin ortaya çıktığı eğitim verilerini emerek bu faktörlerden etkilenabilir.

Veri setlerinde, lafazan cevaplar için diğer motivasyonlar da vardır; örneğin, SEO teşviki daha uzun metin içeriği üretmek için, örneğin tarif gönderilerinde, burada uzunluk genellikle (sıkça yanlış bir şekilde) otorite ile ilişkilendirilir.

API tabanlı platformların, lafazanlığı teşvik ettiği veya denetlemediği için token kullanımını artırması ve daha yüksek bir abonelik tierine kullanıcıları itmekte olduğu düşünülmemelidir; bu, doğruluğun düşmesine neden olur ve bu ‘itme’yi kabul etmeleri makul değildir.

Lafazanlığın nereden geldiğini belirlemek için herhangi bir ampirik yöntem çok ilginç olurdu. Herhangi bir sohbet botunun gerçekten sohbet etmesi yerine, kullanıcıya karşı ‘blog’ gibi lafazan ve çok adımlı cevaplar vermesi gerektiğini fark eden herkes, modelin eğitim verisinde ‘her şeyi bir arada’ kullanıcı kılavuzları ve ‘kabul edilen çözümler’ ile ağır bir şekilde işlendiğini fark edecektir.

Aslında, adım adım sohbetlere özgü bir modelin lafazan ve özetleme eğiliminden kaçınabileceğini görmek çok ilginç olurdu. Ancak, modelin ‘karara varmak’ için verilen ağırlığa, sohbet tabanlı konuşmalarda açıkça bulunan açık akıl yürütme üzerine doğrudan eğitim vermesi için bazı kısıtlamalar veya filtrelerin yerleştirilmesi gerekeceği görünüyor.

Bu tür verilerin muhtemelen nadir olacağından, bu yaklaşım için ilerlemek için sentetik verilere başvurmak gerekebilir; burada ‘bileşik’ nihai sonuçlar sohbet yoluyla parçalanır – ironik olarak, Google NotebookLM’nin plain metin girdisinden yorumlayabildiği AI podcast’leri gibi.

* Yazarların satır içi alıntılarını hiperlinklere dönüştürmem.

† Ancak şunu kabul edelim, AI sağlama maliyetleri ile abonelik ücretleri arasındaki açık, bu durumun ekonomisini bu aşamanın ‘dönüşümü’ ve ‘birleşmesi’ aşamasında çözmeden çözülmesini engelleyecektir.

İlk olarak 5 Nisan 2026 Pazar günü yayımlandı