Anderson’un Açısı

‘Rogue’ Veri Kirliliği, Üretken AI Performansını Bozuyor

Yeni bir çalışma, üretken AI sistemlerini eğitmek için kullanılan popüler görüntü veri setlerinin çoğunun test görüntüleri veya gần-duplicate’lerle kirlendiğini buldu. Bu, modellerin cevapları ezberlemek yerine öğrenmeye çalışmak yerine hile yapmasına olanak tanır. Sızıntı yaygın ancak genellikle tespit edilemez ve sessizce puanları şişirir ve web ölçekli verilerle eğitilen modellere haksız avantajlar sağlar.

Sürüş testine girdiğinizde, test için kullanılacak exact yolları genellikle önceden bilmezsiniz. Eğer bilseydiniz (ve biraz da dürüstlükten yoksunsanız), test için optimize etmek yerine daha geniş sürüş becerileri geliştirmek yerine o rotaya tekrar tekrar pratik yapabilirsiniz.

Makine öğrenimi modellerinin eğitilmesinde, bu, bir test split için makul bir benzetmedir – eğitim seti verilerinin (genellikle) %70’lik bir bölünme için kullanılacak veri ile geri kalan %30’un ‘vahşi’ veri olarak kullanılması.

Vahşi veri, model tarafından daha önce görülmediğinden, model bu veri üzerinde iyi performans gösterirse etkili ve performanslı olduğu varsayılabilir; değilse, model overfitted olabilir veya veri ek curatorluk ve tanımlamaya ihtiyaç duyabilir.

Her iki durumda da, not modelleri eğitim verilerine göre değerlendirmemek, AI araştırmalarında ve geliştirmesinde geçerli yöntemin temel taşıdır.

Same Again, Please

Japonya’dan yeni bir araştırma kağıdına göre, bilgisayar vizyonu ve üretken AI araştırmaları, test verilerinin eğitim verilerine bulaşmasını önlemek için LLM araştırmacılarının gösterdiği çabayı uzaktan yakalamamıştır; testlerde, araştırmacılar, inceledikleri her hiperskala vizyon veri setinin, bazı büyük üretken AI sistemlerini güçlendirerek,某 dereceye kadar test verilerinin eğitim verilerine geçmesine izin verdiğini buldu – bu, modellerin eğitimdeki bölünmelerine göre benchmark’ları ve performans raporlarının, sınav salonundaki bir kopya kullanandan daha doğru olmayacağı ve gerçek dünya performansını yansıtmayacağı anlamına gelir.

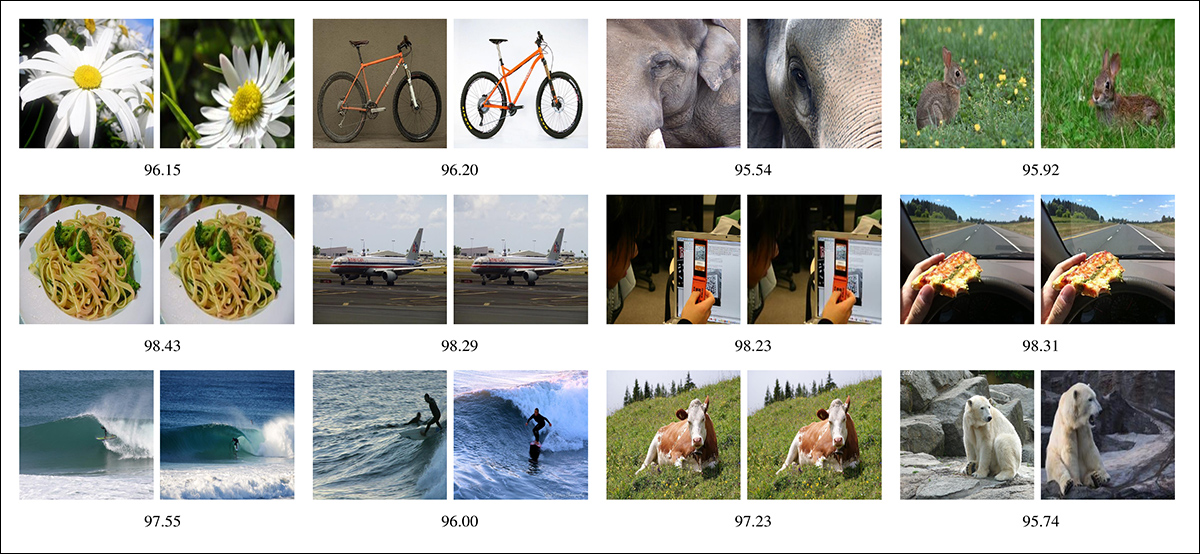

Araştırmacılar tarafından bulunan veri kirlenmesi örnekleri, eğitim ve test veri setlerinde benzer veya gần-duplicate veri noktaları bulunan durumlar. Kaynak: https://arxiv.org/pdf/2508.17416

Yukarıdaki resim, yeni çalışmadan, çeşitli modellerin çekirdek eğitim verisi ve test verisi arasında bulunan benzer veya gần-duplicate veri noktaları örneklerini gösterir – bu, modelin bu veri üzerindeki performansını geçersiz kılar ve genel puanlarını hafifçe şişirir, modelin aslında elde etmediği bir genelleme düzeyi izlenimi verir.

Durum daha da karmaşık hale geliyor, çünkü kirlenme, ‘pre-training‘ dahil olmak üzere çeşitli senaryolarda meydana gelebilir, burada daha eski atasal modellerin ağırlıkları yeni bir modeli ‘başlatmak’ için kullanılır. Eğer yukarı akım, daha eski model bazı aynı verileri yeni veri setiyle paylaşıyorsa, o zaman kirlenme meydana gelebilir, hatta %70/30 veya %80/20 bölünme temiz olsa bile.

Cumulative Effect

Bu, son veri setlerinde de meydana gelmesi neredeyse kesin: vizyon/dil veri setlerinin kapsamı son beş yılda enorm olarak büyüdü, sadece en yeni görüntü verilerini değil, aynı zamanda tarihi, eski veri setlerini de içererek.

Ayrıca, milyarlarca görüntüyü kopya ve gần-duplicate’leri için tarayan ve süzgeçleyen otomatik rutinler, artık böyle bir görevin zaman ve para açısından maliyetini dikkate almaları gerekir.

Görüntü kopyalama, Common Crawl gibi büyük koleksiyonların arkasındaki türden web taramasının bir sonucu olarak kaçınılmazdır, çünkü görüntüler yeniden yayınlanır, yeniden sıkıştırılır ve düzenleme gibi kırpma,.flip (izinsiz kullanıldığında, örneğin) gibi düzenleme yapılır.

Yazarlar gözlemliyor*:

‘Veri sızıntısı, çoğu görsel veri setinde yaygın bir sorundur. Sızıntı, modellerin genelleme yeteneğini gizleyebilir, bu özellikle modeller farklı veri setlerinde eğitildiğinde karşılaştırıldığında sorunlu olur, haksız karşılaştırmalara yol açar.

‘Veri seti tasarımcılarının bu değerlendirmelerin etkilerini dikkatlice dikkate almalarını teşvik ediyoruz. Daha adil model değerlendirmesi için, hem sert hem de yumuşak sızıntıları dikkate alan kopya dedektörlerinin kullanılmasını öneriyoruz.

‘İdeal olarak, sızdırılmış görüntüler eğitim setinden çıkarılmalıdır ve eğer mümkünse en azından test setinden çıkarılmalıdır.’

Makale, araştırmacıların büyük ve popüler veri setleri üzerinde gerçekleştirdiği bir dizi test hakkında detaylandırıyor – her biri某 düzeyde kirlenme gösterdi.

Yeni çalışma, Görsel Veri Setlerinde Veri Sızıntısı başlığını taşıyor ve Osaka Üniversitesi’nden üç araştırmacının eseridir.

Method

Makalenin yazarları, sızıntıyı üç boyutta tanımlar: modality, coverage ve degree.

Modality, yalnızca görüntülerin mi yoksa hem görüntülerin hem de etiketlerin mi sızdırıldığını ayırt eder; coverage, örtüşmenin aynı veri seti içinde mi yoksa farklı veri setleri arasında mı meydana geldiğini tanımlar; ve degree, kopyalanan içeriğin aynı mı yoksa yalnızca komşu mu olduğunu tanımlar.

Sızıntıya ilişkin olarak, çalışmada iki senaryo dikkate alınmıştır: intra-dataset leakage (değerlendirme görüntüleri aynı veri setinin eğitim bölünmesinde yeniden ortaya çıkar), ve inter-dataset leakage (bir veri setinden değerlendirme görüntüleri başka bir veri setinde eğitim için kullanılır).

Derece açısından, iki seviye tanımlanmıştır: soft leakage (görüntüler aynı değil, ancak küçük varyasyonlar gösterir), ve hard leakage (görüntüler eğitim ve değerlendirme boyunca aynıdır).

Araştırmacılar, sızıntının tespitini image retrieval açısından ele alır, her görüntüyü bir özellik vektörü olarak temsil etmek için görüntü kodlayıcısını kullanır. Sorgu seti, değerlendirme verilerini temsil ederken, toplama eğitim setini temsil eder.

Küçük veri setleri için, her sorgu vektörü doğrudan tüm eğitim vektörlerine cosine benzerliği kullanarak karşılaştırıldı. Daha büyük veri setleri için, Faiss dizini daha hızlı K-Nearest Neighbors (KNN) aramasını ermöglemek için oluşturuldu.

Görüntü kodlayıcının, sızıntıyı tespit etmek için yeterli görsel bilgiyi yakalaması, ancak aynı zamanda çok yüksek veri hacmine karşı verimli kalması gerekir, yazarlar, LAION koleksiyonunun altında yatan Stable Diffusion ve daha sonraki projeler için veri seti oluşturucuları tarafından sağlanan önceden hesaplanmış CLIP özelliklerine güvendiler.

Yazarlar, CLIP’in veri setinin distile edilmiş anlayışını kullanmasına (asıl dosyaları ölçekte sorgulamak yerine) proceso hızını önemli ölçüde hızlandırarak ve karşılaştırmalar boyunca tutarlılığı iyileştirdiğini belirtiyorlar.

Data and Tests

Testlerde kullanılan CLIP görüntü kodlayıcısı, yeni çalışmada CLIP ViT-B/32 di ve aslen LAION’ı süzmek için kullanılmıştı. Veri setlerinin çeşitli görüntülerin birbirleriyle ilgili olup olmadığını belirlemek için KNN AutoFaiss altında kullanıldı.

Veri setleri, üç türe ayrıldı: pretraining veri setleri – büyük, web tarayıcı koleksiyonlar, genelci modelleri eğitmek için kullanılır; training veri setleri – daha küçük, genellikle etiketlenmiş koleksiyonlar, doğrudan model ayarlaması için kullanılır; ve benchmark veri setleri – elle etiketlenmiş ve yalnızca değerlendirme için kullanılır.

Analiz, yedi veri seti boyunca yirmi bölünmeyi kapsadı: Microsoft COCO, hem eğitim hem de değerlendirme seti olarak kullanıldı, eğitim, doğrulama, test ve etiketsiz bölünmeleri içeriyordu; Flickr30k, yalnızca bir benchmark olarak hizmet etti; ve Google Conceptual Captions (GCC) koleksiyonu, bir pretraining kaynağı olarak kullanıldı, onun doğrulama kısmı da değerlendirme için kullanıldı.

Ek olarak, ImageNet hem eğitim hem de benchmark için kullanıldı, जबक LAION-400M veri seti yalnızca pretraining için kullanıldı.

OpenImages v4 hem eğitim hem de benchmark verileri sağladı ve TextCaps eğitim ve test bölünmeleri için değerlendirme sağladı.

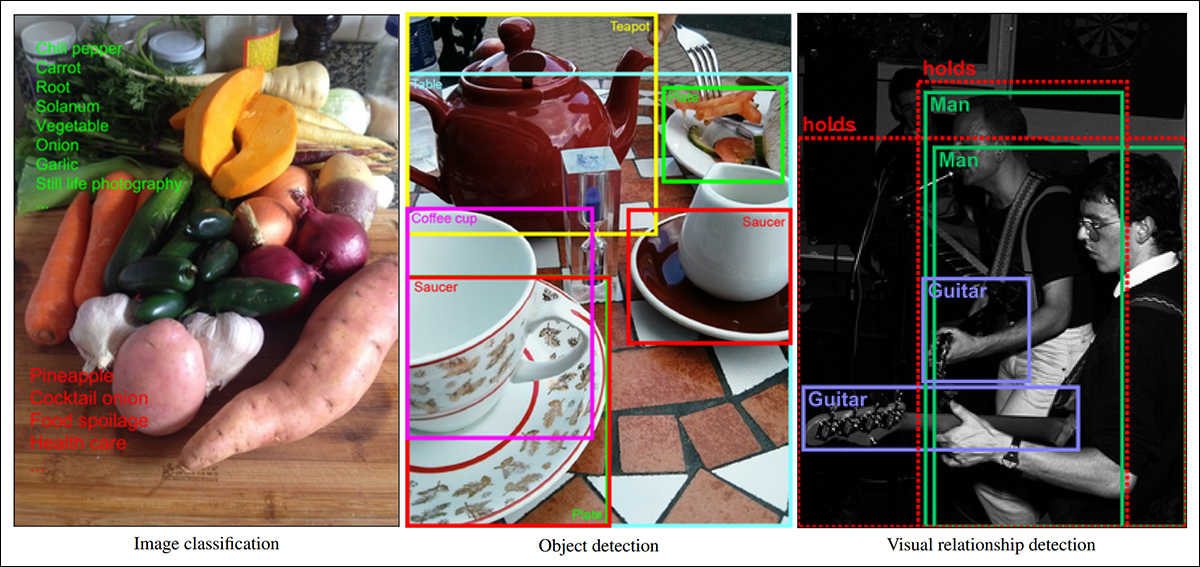

Yeni çalışmada incelenen Google Open Images veri setinden görüntü açıklamaları örnekleri. Kaynak: https://arxiv.org/pdf/1811.00982

Görüntü kopyalama ve gần-duplicate’lerin saptanması için, araştırmacılar Flickr30k’de 5.000 görüntüyü sorgu olarak seçti ve tüm veri setini referans koleksiyonu olarak kullandı.

Her sorgu görüntüsü, kodlanmadan önce dönüştürüldü (yani, bir non-semantik değişiklik gibi yeniden boyutlandırma veya kırpma uygulandı) ve sonra koleksiyondaki en benzer öğeye cosine benzerliği kullanarak eşleştirildi; bir eşleşme, yalnızca orijinal görüntü en iyi sonuç olarak geri alındığında sayılır.

Hard and Soft Leakage

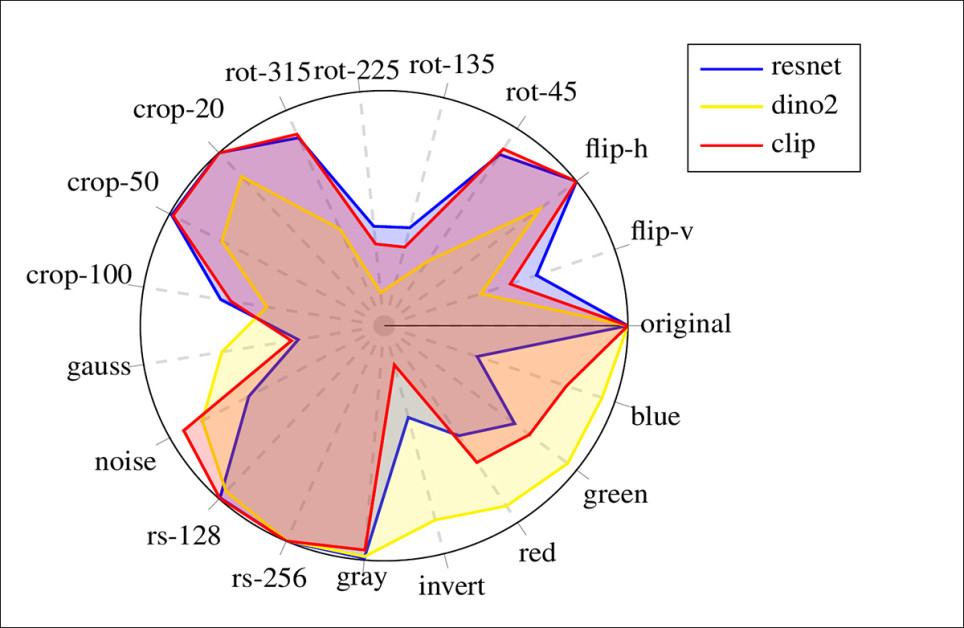

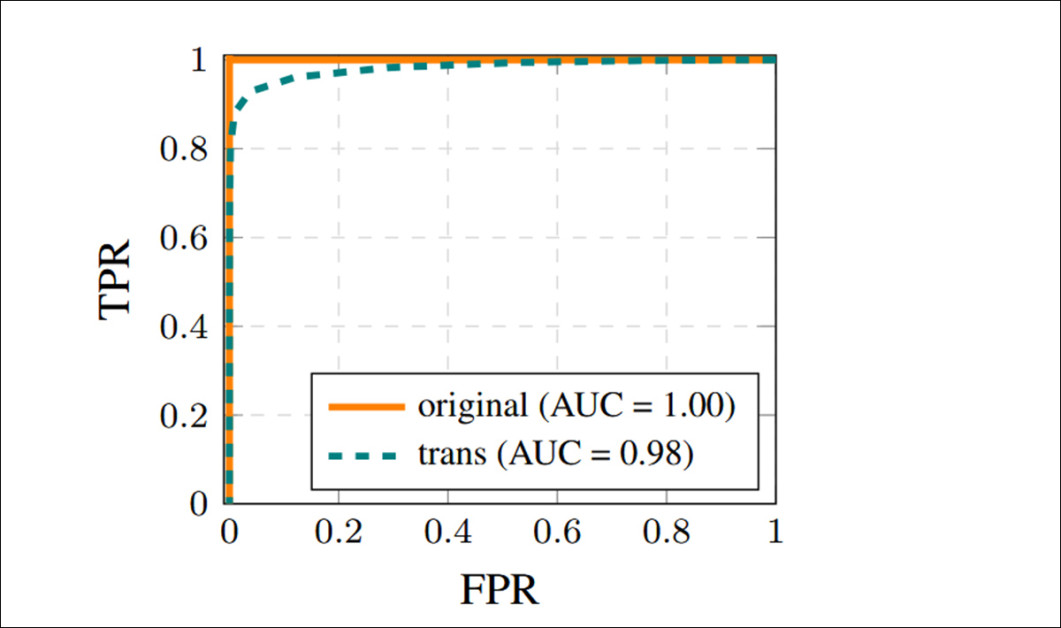

Performans, hard ve soft sızıntı arasındaki ayrımı yapmak için farklı cosine benzerliği eşiği üzerinden değerlendirildi.

0,98’lik bir eşiğin hard sızıntı için seçilmesi, yanlış pozitif olmadan tanımlı ve aynı görüntülerin mükemmel tespitini sağladı.

Yumuşak sızıntı için 0,95’lik bir eşiğin seçilmesi, daha fazla gần-duplicate’nin geri alınmasına izin verdi ve neredeyse sıfır yanlış pozitif oranıyla birlikte.

Önceliği duyarlılığa değil, kesinliğe verildi ve bulgular因此 muhafazakar bir şekilde tahmin edildi:

Alıcı işletim karakteristikleri, hard ve soft sızıntı için eşiğin seçimini yönlendirmek için kullanıldı. Her iki transformed ve untransformed koşullar altında yüksek AUC puanları, gần-duplicate’lerin gerçekten ilişkisiz görüntülerden güvenilir bir şekilde ayırt edilebileceğini gösteriyor, hatta minimal değişiklikler olduğunda bile.

Intra-Dataset Leakage

Intra-dataset sızıntı, aynı veri seti içindeki eğitim ve değerlendirme bölünmeleri arasındaki görüntü örtüşmesi olarak hesaplandı. Sadece hem benchmark hem de eğitim veya pretraining bölünmeleri olan veri setleri analiz için uygun kabul edildi, bu da analizi COCO, GCC, ImageNet, OpenImages ve TextCaps ile sınırladı.

COCO için, test seti eğitim seti, değerlendirme seti ve etiketsiz alt kümelerine karşı karşıya geldi ve doğrulama seti eğitim ve etiketsiz alt kümelerine karşı.

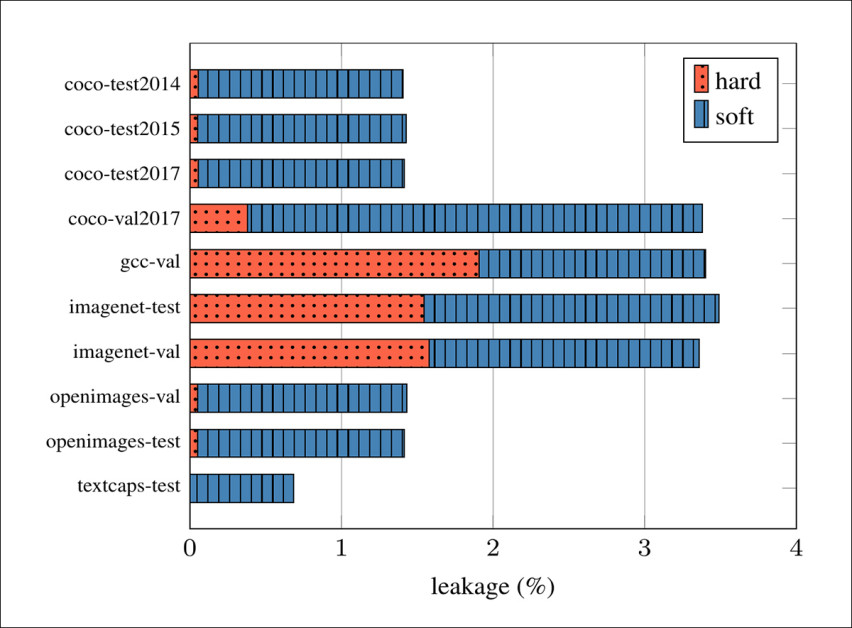

En yüksek intra-dataset sızıntı oranları, ImageNet test ve doğrulama bölünmelerinde gözlemlendi, hard sızıntı %1,58’e ulaştı ve soft sızıntı %2’nin biraz altına düştü. GCC ve COCO takip etti, COCO val2017 %3’lük soft sızıntı gösterdi ve test bölünmeleri %1,35 ile %1,38 arasında değişti. OpenImages düşük hard sızıntı gösterdi, %0,05’te, ancak soft sızıntı her iki test ve doğrulama setlerinde %1,3’ü aştı. TextCaps genel olarak en düşük sızıntı gösterdi, %0,69’da ve hard sızıntı tespit edilmedi:

Intra-dataset sızıntı oranları, her bir değerlendirme bölünmesinin eğitim verisiyle örtüşen oranını gösterir.

Bu sonuçlar hakkında, yazarlar şunları belirtirler†:

‘Bu sonuçlar, intra-dataset sızıntısının tüm analiz edilen veri setlerinde, ya hard ya da soft derecesinde meydana geldiğini gösterir.

‘Veri sızıntısı model değerlendirmesini tehlikeye atabilir ve veri setleri bu amaç için özel olarak tasarlandığından, intra-dataset sızıntısı, tasarım gereği var olmaması gereken bir risktir.

‘Ancak, birden fazla örnekte bulduk.’

Inter-Dataset Leakage

Inter-dataset sızıntı (bir modelin bir veri setinde eğitildiği ve başka bir veri setinde değerlendirildiği durumda), dört veri seti eğitim verisi kaynağı olarak kullanıldı: GCC train, ImageNet train, OpenImages train ve LAION.

Bunlar, COCO 2014 test ve doğrulama bölünmesinden, Flickr30K’den, TextCaps testinden, OpenImages test ve doğrulama bölünmesinden ve ImageNet test ve doğrulama bölünmesinden alınan değerlendirme verilerine karşı eşleştirildi.

CLIP ViT-B/32 özelliklerini, LAION hariç tüm veri setleri için çıkardılar, çünkü LAION kendi önceden hesaplanmış özelliklerini sağlar, ancak bu özellikler resmi CLIP uygulamasıyla üretilenlerden biraz farklıdır, bu nedenle sorgu görüntüleri, clip-retrieval deposunda kullanılan yönteme göre yeniden boyutlandırıldı.

KNN araması, AutoFaiss altında gerçekleştirildi, ancak LAION’un ölçeği, milyonluk görüntü bloklarına bölünmesini ve her birine ayrı ayrı dizin oluşturulmasını gerektirdi:

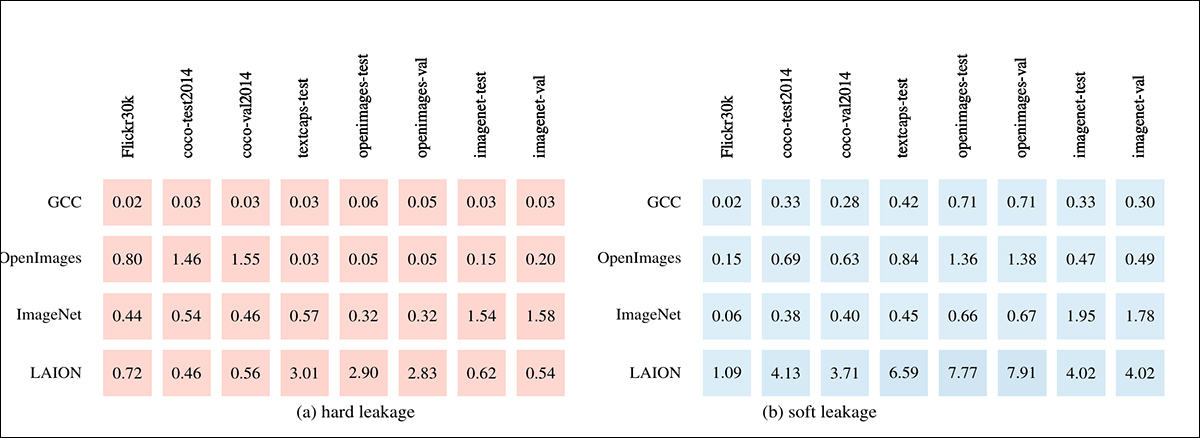

Benchmark veri setleri (sütunlar) ile pretraining veri setleri (satırlar) arasındaki inter-dataset sızıntı. Sol tarafta hard sızıntı (aynı görüntüler), sağ tarafta soft sızıntı (gần-duplicate’ler) görülüyor.

Çapraz veri seti sızıntısı, tüm benchmark veri setlerinde gözlemlendi, çeşitli düzeylerde ciddiyetle. LAION, özellikle OpenImages ve TextCaps test verisi için, her biri %3’ü aşan hard sızıntı oranlarıyla en yüksek oranları gösterdi.

OpenImages de diğer benchmark’lara daha küçük bir hard sızıntı katkısı sağladı. ImageNet, her bir benchmark için hard kopyalama içeriyordu, ancak genel hard sızıntı %1’in altında kaldı. GCC, genel olarak en düşük hard sızıntı gösterdi, %1’in altında kaldı.

Yumuşak sızıntı (gần-duplicate’ler) daha yaygın olarak gözlemlendi: LAION yine en yüksek oranları üretti, belirli benchmark’lar için %7,9’a ulaştı; OpenImages ve TextCaps, genel olarak en çok etkilenen benchmark’lardı; ve Flickr30k en düşük sızıntıyı gösterdi.

Bu tür örtüşmeler, değerlendirme setlerinin sadece küçük bir bölümünü oluştursa da, yazarlar, bunların varlığının hafızaya izin verebileceğini ve test geçerliliğini tehlikeye atabileceğini belirtiyorlar:

Sızdırılmış görüntülerin örnekleri. Sol tarafta, hard sızıntı örnekleri, aynı görüntülerin bir veri seti içinde (üstte) veya veri setleri arasında (altta) bulunduğu durumlar; sağ tarafta, soft sızıntı örnekleri, görsel olarak gần-identik görüntüler.

Effect on Downstream Evaluation

Makale, sızıntının aşağı akış değerlendirmeleri (yani, önceden eğitilmiş modellerin, sızdırılmış eğitim verisi içeren benchmark’lar üzerinde test edildiğinde performans) üzerindeki etkisini dikkate alır.

Üç görev dikkate alındı: zero-shot classification; supervised classification; ve text-image retrieval.

Her görev için, model performansı, önceden sızdırılmış örneklerin zaten tanımlanmış olduğu bir benchmark veri seti üzerinde değerlendirildi. Sonuçlar, dört alt küme boyunca karşılaştırıldı: tam benchmark; sızdırılmış örneklerin bir alt kümesi; sızdırılmamış örneklerin bir alt kümesi; ve aynı boyutta, sızdırılmış gruba rastgele seçilmiş bir alt küme (kontrol olarak kullanıldı).

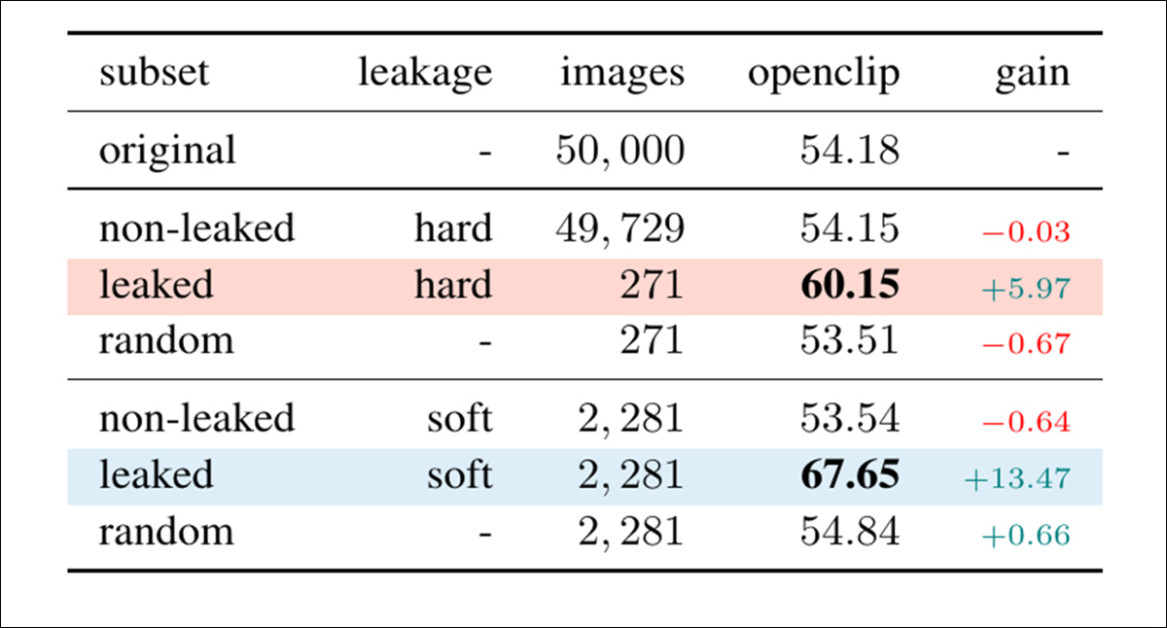

Sızıntının, üç aşağı akış görevi üzerindeki etkisi, sızdırılmış örneklerin zaten tanımlanmış olduğu benchmark alt kümeleri üzerinde ölçüldü. Zero-shot classification’da, LAION’da eğitilmiş bir model, ImageNet değerlendirme setindeki sızdırılmış görüntüler üzerinde daha yüksek doğruluk elde etti, bu da eğitim sırasında даже gần-duplicate’lerin maruz kalmasının ölçülebilir bir avantaj sağladığını doğruladı:

ImageNet validation setinde zero-shot classification doğruluğu, sızıntı ve sızıntısız alt kümeler boyunca. Son sütun, tam sete göre doğruluk kazancını rapor eder ve vurgulanan satırlar sızdırılmış alt kümeleri gösterir.

Supervised classification’da, ImageNet’te sızıntı, sızdırılmış görüntü aynı etikete sahip olduğunda neredeyse mükemmel doğruluk elde edilmediği sürece performansın dramatik bir düşüşüne neden oldu, bu da güçlü bir hafıza etkisi ortaya koydu:

ImageNet validation setinde supervised classification doğruluğu, sızıntı ve sızıntısız alt kümeler boyunca. Kazanç sütunları, tam sete göre değişimi gösterir. Sızdırılmış alt kümeler vurgulanmıştır.

Görüntüden metne geri çağırma’da, sızdırılmış örnekler için performans yine arttı, hem hard hem de soft sızıntı daha yüksek geri çağırma oranlarına yol açtı ve sızdırılmış alt kümeler aynı zamanda daha tutarlı sonuçlar verdi:

Flickr30k’de görüntü-metne geri çağırma performansı, sızıntı ve sızıntısız alt kümeler boyunca, sızdırılmış alt kümeler vurgulanmıştır.

Yazarlar şöyle kếtüller:

‘Genel olarak, sızıntının adil model değerlendirmesine ciddi bir tehdit oluşturduğunu, makine öğreniminin en temel ilkelerinden birini tehlikeye atan görsel veri setlerinde gösteriyoruz: modelleri eğitim verilerine göre değerlendirmemek.’

Conclusion

Bu çalışmanın şaşırtıcı bir yönü, LAION’daki devasa görüntü verisi için CLIP’i kullanarak özelliklere ulaşma ihtiyacıdır, bu, insan denetimi veya herhangi bir tür elle curatorluk ötesinde bir ölçekte artık başka bir şekilde ele alınamaz.

Bu, vizyon-dil modellerinin eğitiminin kesinlikle insan denetimi veya herhangi bir tür elle curatorluk yeteneklerinin sınırlarını aşmış olduğunu gösteren çarpıcı bir illüstrasyondur.

* Belki biraz karışıklıkla, kopyalama problemi makalede ‘sızıntı’ olarak tanımlanmaktadır.

† Yazarların vurgusu.

İlk olarak 26 Ağustos 2025 Salı günü yayımlandı