Anderson’un Açısı

Yağ Kazanmanın AI ile Sağlanan Avantajları

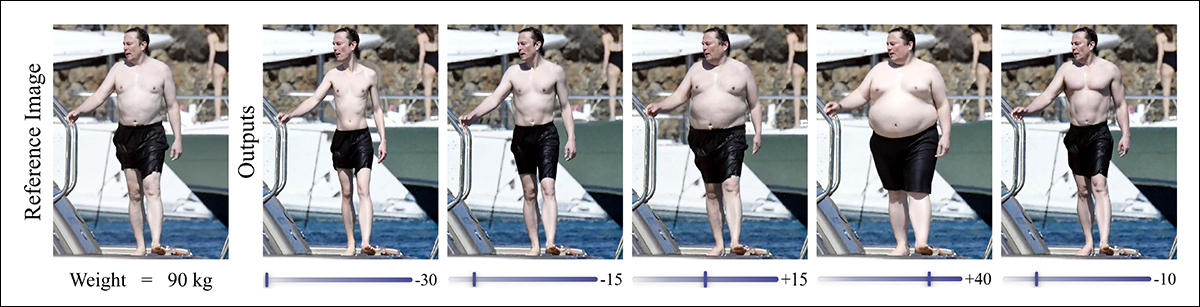

Yeni bir AI sistemi, insanların fotoğraflarını gerçekçi bir şekilde yeniden şekillendirebiliyor, onları daha şişman, daha zayıf veya daha kaslı hale getirebiliyor, yüz, kıyafet veya arka planı değiştirmeden.

AI’nin vücut şeklini sosyal ağlarda iyileştirme yöntemi olarak artan kullanımı veya (potansiyel olarak) VFX amaçları için vücut türlerini değiştirmek için makine öğreniminin kullanılması dışında, bireylerin görünümünü değiştirmek için makine öğreniminin kullanılması, daha önemli bir işlevi yerine getirebilir: yeme bozukluğu olan bireylerin kendilerini anlamalarına yardımcı olmak ve ayrıca daha genel spor ve fitness amaçları için potansiyel bir motivasyon aracı sunmak:

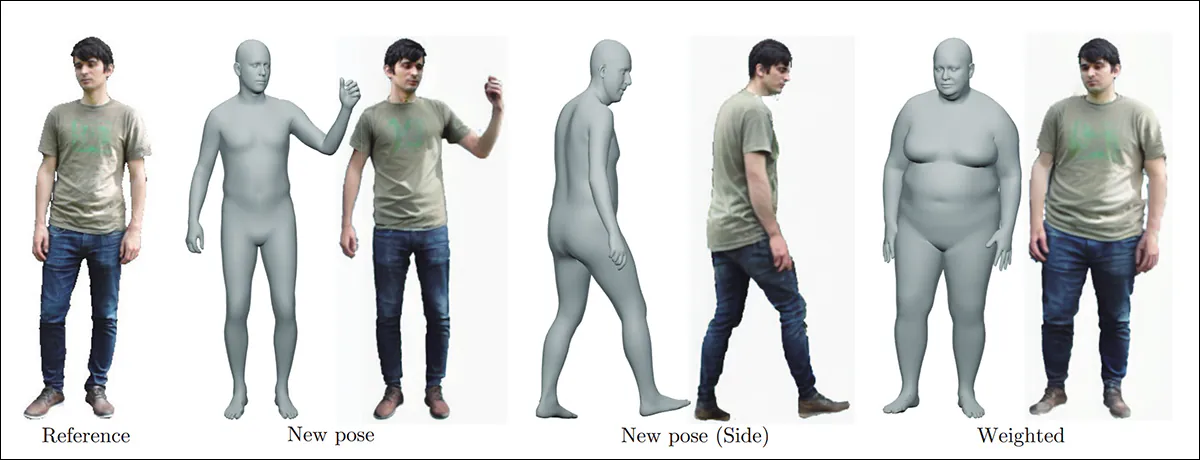

Anoreksiya nervoza ve sağlıklı kontrollerde 3D avatarlar kullanarak kadınların vücut boyutu tahmini’ başlıklı çalışmadan, vücut şekli değişikliklerini görselleştirmek için bir GUI. Vücut dismorfisi olan kişiler, benzer bir görüntüye gerçekçi bir yorumunu ilişkilendirmekte zorlanabilir, böylece klinisyenlere dismorfik yanıtlar için bir ölçüt sağlar, diğer amaçlar için. Kaynak: https://www.nature.com/articles/s41598-017-15339-z.pdf

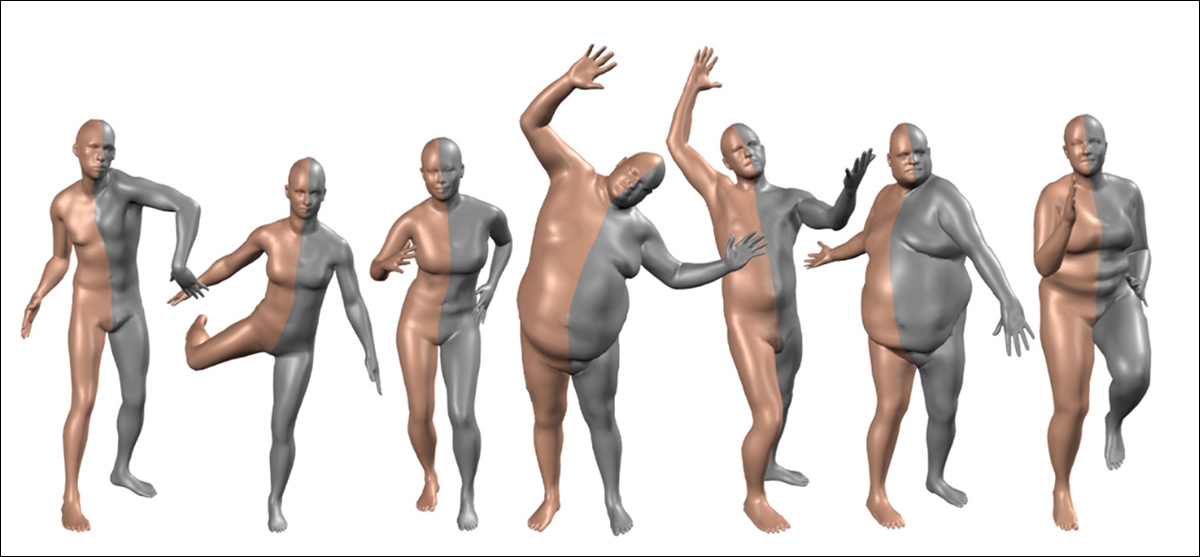

Ayrıca, bilgisayar görüşünde moda deneme alt dalı da çeşitli vücut şekilleri boyunca doğru görselleştirmeler sağlamakla ilgileniyor. Bu arada, 2024 DiffBody gibi çerçeveler, Japonya’nın Tsukuba Üniversitesi’nden, bu alanda bazı göz alıcı işlevler oluşturdu:

Önceki DiffBody tekniği ile mümkün olan bazı dönüşümler. Kaynak: https://arxiv.org/pdf/2401.02804

AI temel modelleri geleneksel olarak çekici veya yaygın vücut şekillerine optimize edildiğinden, olağandışı boyutlar gibi ‘obez’ standart modellerde minimum düzeyde mevcuttur veya cezai önyargılar ile gelir.

Çift Gereksinimler

İnsanların resimlerini gerçekçi bir şekilde yağ veya kas ekleyerek veya çıkararak değiştirebilen AI sistemleri oluşturmanın en büyük zorluklarından biri, bu işlemin çift eğitimi içerdiği gerçeğidir, burada AI sistemi etkili bir şekilde ‘önce’ ve ‘sonra’ görüntüleri öğrenir ve modelin gerçekleştirmek istediği dönüşümü tanımlar.

Bu tür eğitim, Black Forest Labs’in Kontext serisi görüntü düzenleme modellerinin başarısı nedeniyle yaz boyunca yeniden ön plana çıktı, burada bu tür çift veri kullanıldı ve modellere bir dizi dönüşüm öğretildi:

Flux Kontext sitesinden, modeli büyük değişiklikler uygularken görüntü bütünlüğünü korurken gerekli olan kaynak verilerin bir örneği. Kaynak: https://bfl.ai/models/flux-kontext

Elbette, bir kişinin görünümünü önemli ölçüde değiştirebilen bir model geliştirmek için, gerçek dünyada tamamen imkansız olan şeylere ihtiyacınız vardır: sadece saniyeler içinde çekilen radikal ‘önce’ ve ‘sonra’ resimleri.

Tek çare sentetik veri kullanmaktır. Bu tür projelerin bazıları, manuel olarak Photoshop’ta oluşturulan bireysel, yüksek çaba gerektiren kontrastlı çiftler kullanmıştır; ancak bu, ölçeklendirilebilir değildir ve çiftleri oluşturmak için artık otomatik veya yarı otomatik, AI destekli bir işlem tercih edilmektedir.

GAN tabanlı ve çoğu SMPL/X tabanlı yaklaşımların (sanal bir CGI figürü, gerçek görüntüler ve istenilen dönüşümler arasında bir tür değişim mekanizması olarak kullanılır) ve görüntü bükmeyi kullanan yaklaşımların sorunu, arka plan ve kimliğin dönüşüm sürecinde zarar görmesidir.

SMPL ve SMPL-X (diğerleri arasında) gibi parametrik, vektör tabanlı CGI modelleri, bilgisayar görüşü çerçevelerine dahil edilebilecek ve yorumlanabilecek tanımlı geleneksel fiziksel 3B koordinatlar sağlar. Kaynak: https://files.is.tue.mpg.de/black/papers/SMPL2015.pdf

AI’nin yalnızca istenilen yönleri değiştirmesini öğrenmesi, arka planları bükmeyi ve diğer istenmeyen hataları tekrarlamayı öğrenmemesi önemlidir, bu nedenle hiçbir vücut değiştirme sistemi mükemmel bir çözüm bulmamıştır.

Ancak Hindistan’dan bir makale, daha iyi bir sentetik veri seti kullanarak ve ikincil yaklaşımları entegre ederek, eski Flux difüzyon model çerçevesini kullanarak durumun state-of-the-art’ını önemli bir şekilde geliştirmeyi öneriyor:

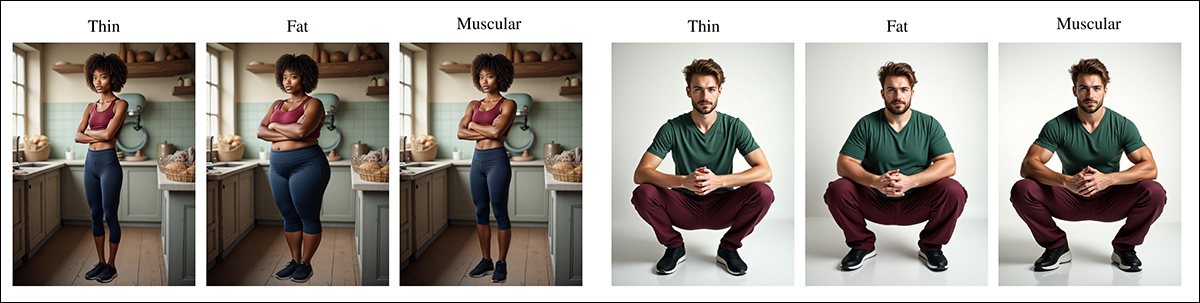

Yeni projenin veri seti örnekleri. Kaynak: https://arxiv.org/pdf/2508.13065

Proje, yeni ve geniş bir çift veri setini; Odo, bu verilerde eğitilen bir generatif difüzyon modelini ve insan şekli düzenleme performansını nicel olarak değerlendirmek için özel olarak tasarlanmış bir referans çerçevesini içerir. Testlerde, yazarlar benzer modeller tarafından elde edilen standartlara önemli bir ilerleme kaydettiğini iddia ediyorlar.

Yeni makale, Odo: Kimlik Koruyucu Vücut Yeniden Şekillendirme için Derinlik Kılavuzlu Difüzyon başlığını taşıyor ve Bangalore’deki Fast Code AI Pvt. Ltd’den üç araştırmacı tarafından geliyor.

Veri ve Yöntem

Araştırmacılar tarafından oluşturulan veri seti, her hedef vücut tipi için (şişman, zayıf ve kaslı) 7.615 yüksek çözünürlüklü (960x1280px) görüntü içeriyor.

İlk olarak 1.523 insan yüzü, 12 milyar parametreli difüzyon modeli FLUX.1-dev aracılığıyla oluşturuldu, ancak Pexels ve Unsplash’tan belirsiz bir số lisanssız referans yüzünü kullanarak çeşitliliği artırmak için.

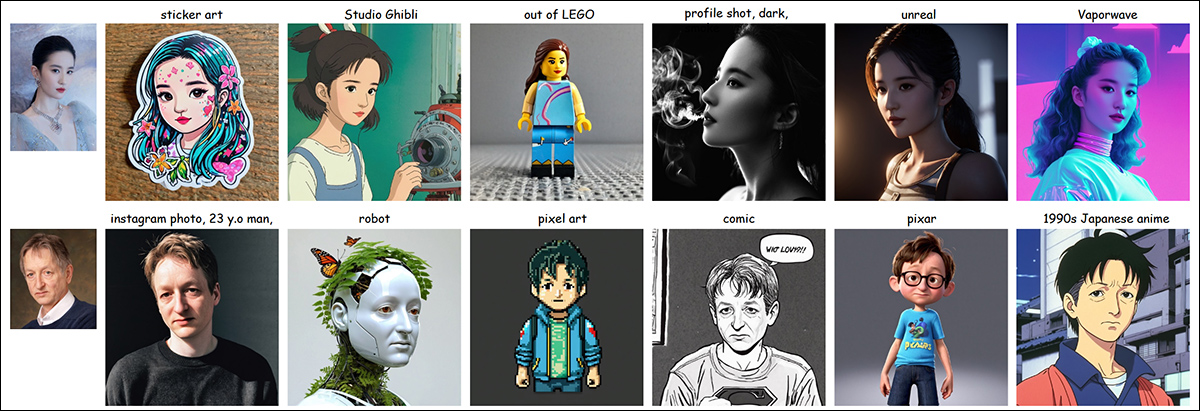

Bu yüzleri tam vücut görüntülerine entegre etmek için araştırmacılar, ByteDance’in 2024 sunumu PuLID‘i kullandı, bu bir karşıt ID kaybı ile donatılmış, temel Flux üzerinde fine-tuned bir kontrol noktasıydı ve yüz kimliğini dönüşüm süreçlerinde korumaya yardımcı olmak için tasarlandı:

PuLID projesinden örnekler. Kaynak: https://arxiv.org/pdf/2404.16022

Model, bir yüz görüntüsü ve cinsiyet, kıyafet, poz, sahne ve zayıf, şişman veya kaslı gibi vücut tipi gibi standartlaştırılmış bir.prompt aldığında.

Her bir kimliğin üç vücut tipi görüntüleri bazen difüzyon modellerinin stokastik davranışından kaynaklanan arka plan hizalaması ve algılanan konu boyutunda küçük kaymalar gösterdi, her bir поколasyon yeni bir gürültü tohumu ile başlardı. Even slight changes to the prompt, such as modifying the body type description, can influence the model’s trajectory in latent space, and cause visual drift.

Bu varyasyonu düzeltmek için dört aşamalı bir otomatik post-işleme.pipeline uygulandı, her bir tripletin zayıf görüntüsü referans olarak seçildi, çünkü daha küçük silüeti daha fazla arka planı ortaya çıkardı.

Kişi algılama, RT-DETRv2 ile gerçekleştirildi, ardından SAM 2.1 ile tüm üç vücut tipi için konu maskeleri çıkarıldı. zayıf referans görüntüsü, arka planı temiz bir versiyonunu üretmek için FLUX.1 Kontext Pro (daha yeni görüntü düzenleme sistemi) için arka planı boyamak için geçirildi.

şişman ve kaslı varyantları, zayıf referans maskesinin yüksekliğine eşleştirmek için uniform ölçeklendirme kullanılarak yeniden boyutlandırıldı ve aynı alt hizalamada temiz arka plana kompozitlendi, tüm görüntüler boyunca tutarlı bir çerçeveleme sağlanarak.

Yazarlar şöyle diyor:

‘Sonuç olarak, dönüşüm üçlüleri (zayıf, şişman ve kaslı) aynı arka plana ve uniform konu ölçeğine sahiptir. Bu, sonraki eğitimi veya değerlendirmeyi olumsuz yönde etkileyebilecek alakasız varyasyonları kaldırır.’

Her bir zayıf, şişman ve kaslı görüntü üçlüsü, altı olası dönüşüm çifti sağladı, 7.615 kimlik boyunca teorik olarak 45.690 kombinasyon oluşturdu.

Uygun olmayan kıyafetler, doğal olmayan pozlar, bozulmuş uzuvlar, kimlik kayması veya minimal şekil değişikliği olan örnekleri çıkardıktan sonra, 18.573 yüksek kaliteli çift kaldı. Bazı küçük poz farklılıkları kaldı, ancak model bu varyasyonlara karşı güçlü çıktı.

Eğitim ve Testler

Sonuç olarak elde edilen görüntüler, Odo modelini eğitmek için kullanıldı – bir difüzyon tabanlı yaklaşım, Skinned Multi-Person Linear Model (SMPL, yani ara CGI) haritaları kullanarak insanları yeniden şekillendirmek için.

2024 Neural Localizer’s yöntemleri tarafından bilgilendirilen veriler, her bir birey için SMPL figürüne uyumlu hale getirildi, elde edilen optimize parametreler değiştirilen görüntüleri üretmek için derinlik haritaları oluşturabiliyordu:

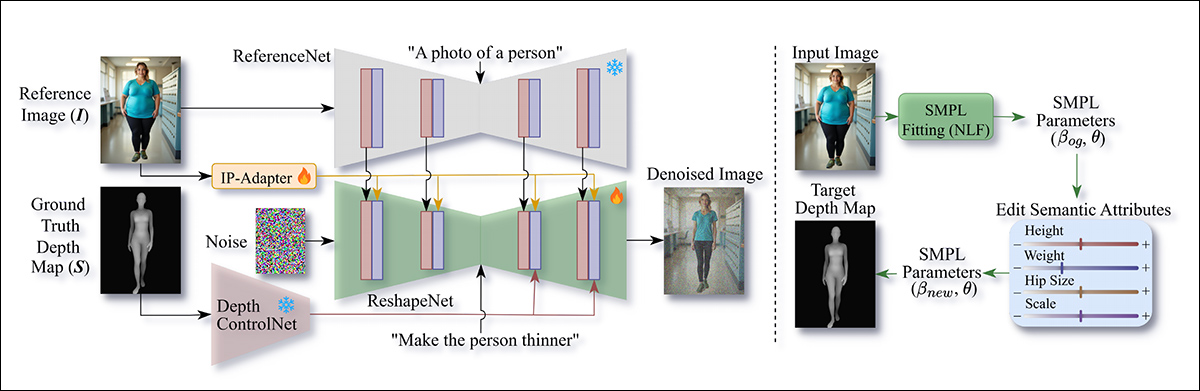

Eğitim pipeline şeması. Sol taraf, eğitim kurulumunu gösterir, burada hedef görüntüsünden SMPL derinlik haritaları, ReshapeNet’i ControlNet aracılığıyla vücut dönüşümünü gerçekleştirmek için yönlendirir. Kaynak görüntüsünden ReferenceNet tarafından çıkarılan özellikler, ReshapeNet’e spatial self-attention kullanarak birleştirilir. Sağ taraf, çıkarımı gösterir, где SMPL parametreleri girişi görüntüsünden tahmin edilir, anlamsal öznitelikler tarafından değiştirilir ve hedef derinlik haritasına render edilir, bu da ReshapeNet’i transformed görüntüyü üretmek için gürültü giderirken koşullandırır.

Model (yukarıdaki şemaya bakınız) ReshapeNet modülünden oluşur, üç yardımcı modülle desteklenir: ReferenceNet; bir IP-Adapter modülü; ve bir derinlik tabanlı ControlNet modülü.

ReferenceNet, arka plan, kıyafet ve kimlik gibi ayrıntılı özellikleri girdi görüntüsünden çıkarır ve bunları ReshapeNet’e geçirir. IP-Adapter, yüksek seviyeli özellik rehberliği sağlar, mentre derinlik ControlNet, SMPL tabanlı koşullandırma uygular ve vücut dönüşümünü yönlendirir. Önceki çalışmalar ile aynı doğrultuda, SDXL tabanlı dondurulmuş UNet kullanıldı ve ara özellikleri çıkarmak için kullanıldı.

IP-Adapter modülü, girdi görüntüsünü CLIP aracılığıyla kodlar, elde edilen gömme ler ReferenceNet’e çapraz dikkat kullanarak entegre edilir.

Derinlik ControlNet modülü, ReshapeNet’in orta ve decoder katmanlarını kalıntı bağlantılar kullanarak yönlendirir. Ardından, hedef SMPL parametrelerinden render edilen bir derinlik haritasını alır ve hedef görüntüsü ile hizalar.

ReshapeNet, SDXL UNet temelinde oluşturulan modelin çekirdeğidir. Eğitim sırasında, hedef görüntüleri bir variational autoencoder ile latent uzaya kodlanır, zaman içinde gürültüye maruz kalır ve ardından ReshapeNet tarafından ControlNet ve ReferenceNet’ten alınan özellikler kullanılarak gürültü giderilir.

Kategoriye özgü metin promt’ları, zoals ‘Kişiyi daha şişman yapın’, ‘Kişiyi daha zayıf yapın’ veya ‘Kişiyi daha kaslı yapın’, dönüşümleri yönlendirmek için eklendi. Derinlik haritaları kaba vücut şekillerini yakalarken, promt’lar muscle tanımlama gibi değişiklikler için gerekli olan anlamsal ayrıntıyı sağladı, böylece model daha doğru ve gerçekçi değişiklikler üretebildi.

Eğitim Uygulaması

Odo, projenin sentetik veri setiyle birleştirilen DeepFashion-MultiModal veri setinin bir alt kümesiyle eğitildi, toplam 20.000 görüntü çifti elde edildi.

DeepFashion-MultiModal verileri, kıyafet ve yüz özelliklerinde çeşitlilik sağladı, görüntüler kendileri ile eşleştirildi. Tüm SMPL derinlik haritaları verimlilik için önceden hesaplandığından, eğitim tek bir NVIDIA A100 GPU ile 80GB VRAM’de 60 epoch için çalıştı.

Giriş görüntüleri 768×1024’e yeniden boyutlandırıldığında, Adam optimizatörü, 1×10⁻⁵’lik bir öğrenme oranı ile kullanıldı. ReshapeNet, SDXL UNet ağırlıkları ile başlatıldı ve IP-Adapter ile birlikte fine-tune edildi.

ReferenceNet, SDXL ağırlıkları ile başlatıldı ve donduruldu, mentre derinlik ControlNet, önceden eğitilmiş ağırlıkları kullandı ve donduruldu.

Son model yaklaşık 23GB GPU belleği gerektiriyordu, tek görüntü çıkarımı için 18 saniye sürüyordu.

Yeni Bir Metric

Bu tür projeler için gereken veri setlerinin eksikliği nedeniyle, mevcut hiçbir metric bu zorluğu gerçekten ele almadı. Bu nedenle yazarlar, 3.600 görüntü çiftinden oluşan bir novel benchmark geliştirdiler, gerçek yüz görüntüleri, arka plan açıklamaları ve çeşitli vücut şekil varyasyonları içeriyordu.

Diğer kullanılan metric’ler Structural Similarity Index (SSIM); Peak Signal-to-Noise Ratio (PSNR); Learned Perceptual Image Patch Similarity (LPIPS); ve Scale Corrected Per-Vertex Euclidean error in neutral (T-)pose (PVE-T-SC).

İlk olarak, yazarlar yöntemlerini eğitim sırasında görmediği gerçek dünya görüntüleri ile nitel olarak test etti:

Nitel testler. Örnekler, orijinal görüntüden daha zayıf, daha şişman ve daha kaslı vücut tiplerine, farklı pozlar dahil olmak üzere geçişleri gösterir. Lütfen daha iyi tanımlama ve ayrıntı için kaynak makaleye bakınız.

Bu sonuçlar hakkında makale şöyle diyor:

‘[Bizim] yöntem, çeşitli pozlar, arka planlar ve kıyafetler जबक person kimliğini korurken etkili bir şekilde işler.

‘SMPL hedef şekillerine ek olarak, ‘Kişiyi daha şişman yapın’, ‘Kişiyi daha zayıf yapın’ veya ‘Kişiyi daha kaslı yapın’ gibi metin promt’ları veririz, böylece istenilen dönüşümleri açıkça yönlendirebiliriz…

…'[Aşağıdaki görüntü] modelimizin diverse şekil dönüşümleri gerçekleştirebileceğini daha da gösterir. Model, SMPL derinlik haritalarını takip ederek referans görüntüsünden daha zayıf ve daha şişman varyasyonlar üretir.’

Hedef vücut tiplerinin tümünü kapsayan daha fazla nitel test. Lütfen daha iyi tanımlama ve ayrıntı için kaynak makaleye bakınız.

Yazarlar ayrıca şunları söylüyor:

‘Sonuçlarımız, hedef ağırlığa göre daha gerçekçi dönüşümleri gösterir, çünkü modelimiz aynı zamanda genel vücut şeklini, uzuv oranlarını ve kıyafetleri ayarlayarak, anatomik olarak tutarlı ve görsel olarak inandırıcı değişiklikler sağlar.’

Nicel testler için yazarlar, sistemlerini açık kaynaklı Flux Kontext [dev] modeli, FLUX.1 ve 2022 çıkış Structure-Aware Flow Generation for Human Body Reshaping ile karşılaştırdı.

FLUX.1 Kontext [dev] için promt’lar, ‘Kişiyi daha şişman yapın’, ‘Kişiyi daha zayıf yapın’ veya ‘Kişiyi daha kaslı yapın’ şeklinde tasarlandı, hedef ağırlıkları belirtildi – ancak ince ayar kontrollerinin eksikliği performansı sınırladı:

![Odo ile Structure-Aware Flow Generation for Human Body Reshaping ve FLUX.1 Kontext [dev] arasındaki test seti karşılaştırması, ayrıca ReshapeNet'te promt koşullandırması olmadan, yalnızca IP-Adapter kullanarak ReferenceNet olmadan ve yalnızca BR-5K veri setine bağlı eğitim için soykırım sonuçları.](https://www.unite.ai/wp-content/uploads/2025/08/table-2-1.jpg)

Odo ile Structure-Aware Flow Generation for Human Body Reshaping ve FLUX.1 Kontext [dev] arasındaki test seti karşılaştırması, ayrıca ReshapeNet’te promt koşullandırması olmadan, yalnızca IP-Adapter kullanarak ReferenceNet olmadan ve yalnızca BR-5K veri setine bağlı eğitim için soykırım sonuçları.

Sonuç

Bu yıl Flux Kontext’in çıkışı ve daha最近 Qwen Image Edit’in nicelleştirilmemiş ağırlıklarının yayınlanması, çift görüntü verilerini tekrar hobi ve profesyonel toplulukların ön planına getirdi. Generatif AI’nin doğruluğuna ilişkin artan eleştiri ve sabırsızlık ikliminde, bu tür modeller daha yüksek bir doğruluğa sahip olması amaçlanmaktadır (ancak daha küçük ölçekli modeller bazen çok özel eğitim hedefleri tarafından engellenmektedir).

Bu durumda, bir vücut şekillendirme sisteminin faydası, psikolojik, tıbbi ve moda tabanlı alanlarda olabilir. Bununla birlikte, bu tür sistemlerin daha yüksek bir düzeyde ön plana çıkması ve belki de daha casual ve potansiyel olarak endişe verici bir dizi kullanım alanı olabilir.

İlk olarak 25 Ağustos 2025 Pazartesi günü yayınlandı