Anderson’un Açısı

AI Oluşturulan Görselleri HDR İle Aydınlatma

AI görseller ve videolar etkileyici olabilir, ancak ‘profesyonel’ standartta değil – bu sorunu ele almak için yeni bir araştırma projesi başlatıldı.

Profesyonel ses-görüntü topluluğunda, AI’nin ilerlemesine karşı en sık karşılaşılan itirazlardan biri, şu anda görüntü ve video yeniden üretiminde profesyonel standartların eksikliğidir. Bunların en azından biri, Yüksek Dinamik Aralıklı (HDR) görüntüler ve videolarla çalışabilme yeteneğidir.

HDR görüntüler, 19. ve 20. yüzyıllarda kullanılan bir fotoğraf uygulaması olan bracketingnın modern eşdeğeridir. Burada aynı resim birden fazla kez artan miktarda ışık filme ulaşmasına izin verilerek çekilir:

Üstte, kısa bir bracketed dizisi. Altta, bu fotoğraflardan tek bir görüntüye çıkarılabilen yüksek dinamik aralık. Kaynak

Geleneksel fotoğrafçılıkta, bu, birden fazla resimle sonuçlanıyordu ve bu resimler, bazı uzmanlık ve çabayla, tüm farklı açıklık seviyeleri boyunca mevcut olan tüm ayrıntıları içeren tek bir baskı haline getirilebilirdi. Ancak bu, basit veya kolay bir işlem değildi.

Bu günlerde, ‘oto-bracketed’ bir görüntü dizisi, ya birden fazla görüntü üretebilir ya da tek bir HDR görüntüsüne birleştirilebilir – efektif olarak bir görüntüde çoklu açıklık seviyeleri, ki bu, HDR özellikli görüntü düzenleme uygulamaları gibi Photoshop tarafından işlenip, fotoğrafçının ideal bir çıktı görüntüsü oluşturmasını sağlayabilir.

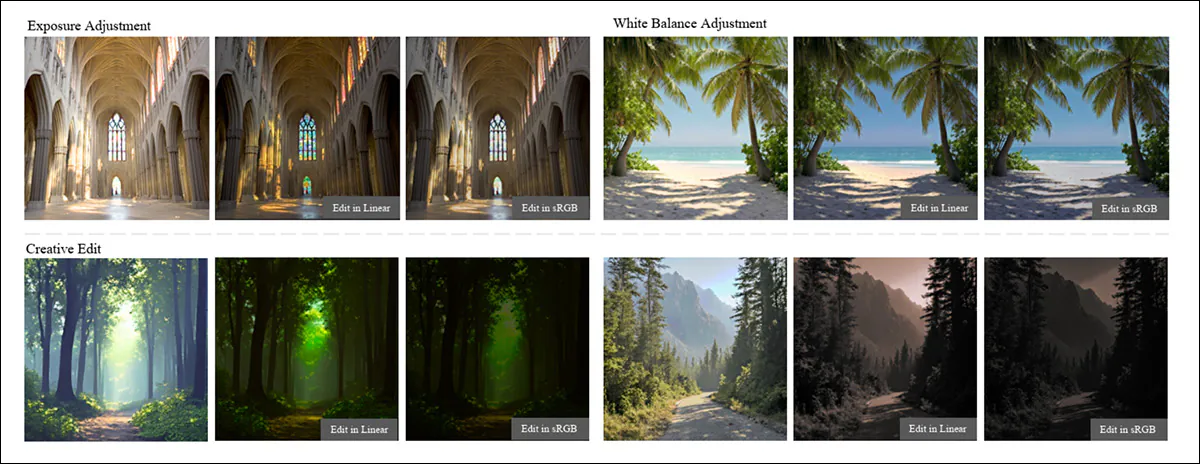

Neden endişe edeceğinizi veya bu tür şeylerin kendi fotoğrafçılığınıza nasıl etki ettiğini merak ediyorsanız, bu makalenin illüstrasyonu, bunu size tanıdık bir şekilde göstermek içindir:

Üstte, solda tipik bir sRGB (yani non-HDR) görüntü görüyoruz. Sadece aydınlatmayı (sağda gösterildiği gibi) artırmak, dolapta olan canavarı göstermez, çünkü bu ayrıntı fotoğrafçı ve kameranın otomatik işlemleri tarafından fotoğrafta öncelikli olan şeyleri belirlerken atıldı:

Aşağıda, ön planın ‘solgun’ olması gerektiği (solda) bir gösterimi ve (sağda) canavarın, ön planın iyi aydınlatılmış konularına uygun bir pozlama yapıldığında karanlığa gömüldüğü bir gösterim vardır:

Aşağıda, bir HDR görüntüsünden veya görüntü dizisinden ‘kurtarılabilen’ türden ayrıntıları görüyoruz. Bu durumda, canavar, geri kalan içeriğin ‘beyazlara’ yakın bir seviyede olacağı bir seviyede, HDR dizisinin çok düşük görsel kayıtlarında ‘gizleniyordu’ (üstte, sol). Geniş bir parlaklık aralığının, seçilerek aynı görüntüde ifade edilmesini belirterek, bu uyumsuz öğeler birleştirilebilir:

Bir non-HDR görüntü, görüntüye atıfta bulunan görüntü olarak bilinir ve yüksek gamlı bir HDR görüntü, sahneye atıfta bulunan görüntü olarak bilinir.

HDR video da mevcut ve bu tür tonal esneklik ve ductility, film yapımcılarına, çekimleri çeşitli yaratıcı ve tutarlı şekillerde kurtarma, derecelendirme ve yorumlama konusunda önemli bir özgürlük sağlıyor; bu nedenle, yaratıcıların, çoğu generatif AI çerçevelerinin tipik olduğu gibi ‘düzleştirilmiş’ sRGB çıkışıyla çalışmak istememeleri şaşırtıcı değil.

HDR ve AI

Doğal olarak, araştırma sahası, AI oluşturulan çerçeveleri HDR dönemine getirmekle ilgileniyor. Ancak, bu, hem difüzyon tabanlı generatif sistemlerin temel mimarisi nedeniyle hem de iyi HDR verilerinin büyük miktarda disk alanını işgal etmesi ve bu nedenle kullanışsız koleksiyonlar oluşturması nedeniyle basit bir görev değil; dolayısıyla, bu görev için uygun veri setleri nadirdir.

Bununla birlikte, Singapur’daki bir üniversite ve Adobe Research arasındaki bir işbirliği, HDR görüntü dizileri oluşturmak için bir yöntem sunuyor; bu, teorik olarak videoya da uygulanabilir:

Yeni çalışmanın proje sitesinden, metin-görsel çıkışının ‘bracketed’ örnekleri. Kaynak

Yeni sistem, aynı görüntünün farklı parlaklık seviyelerinde birden fazla hizalı versiyonunu oluşturur ve sahnenin gerçekten ne kadar parlak olduğunu öğrenir, ardından bunları, hem gölgelerde hem de vurgularda ayrıntı tutan tek bir sonuca birleştirir; bu, daha sonraki pozlama veya renk ayarlarının, tam işlenmiş bir görüntüye karşı değil, gerçek bir kamera yakalama ayarlarına benzer bir şekilde davranmasına olanak tanır.

Sistem, Qwen ve Flux gibi çeşitli modelleri görev için kullanıyor:

Yeni makaleden örnekler, sistemin aynı sahnenin çok darktan çok parlak ayarlarına kadar tutarlı görüntüler üretebilmesini gösteriyor. Basit bir kenar haritasından başlayan model, güneş ışığı, gün batımı veya hatta bir balon gibi küçük bir nesne olsun, ay ışığını tarif eden bir.prompt ile tutarlı görüntüler üretebiliyor ve konuyu ve kompozisyonu sabit tutarken sadece aydınlatma değişiyor. Yöntem, kamera benzeri bir şekilde, yeni içerik üreterek veya sürüklenerek değil, parlaklığı kontrol edilebilir bir şekilde değiştirebiliyor. Kaynak

Yazarlar şunları belirtiyor:

‘Doğrusal görüntüler oluşturmak zor, çünkü ön eğitimli VAE’ler latent difüzyon modellerinde, daha yüksek dinamik aralık ve bit derinliği nedeniyle hem aşırı vurguları hem de gölgeleri aynı anda korumak için mücadele ediyor.’

‘Bu amaçla, bir doğrusal görüntüyü, her biri dinamik aralığın belirli bir bölümünü yakalayan maruz kalma kuyruklarının bir dizisi olarak temsil ediyoruz ve metin koşullu maruz kalma kuyruğu oluşturma için DiT tabanlı akış eşleme mimarisi öneriyoruz.’

‘Ayrıca, metin yönlendirmeli doğrusal görüntü düzenleme ve yapı koşullu oluşturma dahil olmak üzere aşağı akış uygulamalarını gösteriyoruz.’

Yeni çalışma, Maruz Kalma Kuyruklarını Sentezleyerek Doğrusal Görüntü Oluşturma başlığını taşıyor ve S-Lab at Nanyang Teknoloji Üniversitesi, Adobe NextCam ve Adobe Research’tan dört yazar tarafından gerçekleştirildi. Bahsedilen proje sayfası ve yayınla birlikte gelen YouTube videosu dışında, ayrıca (şu anda boş) bir GitHub deposu ve bir veri seti yayınlama vaadi bulunuyor.

Yazarlar, sistemin çıkış örneklerini içeren projenin sayfasını sağlasa da, okuyucuların bunları gerçekten ayırt edebilmek için HDR özellikli bir monitöre ihtiyacı olacaktır. Yine de, lütfen araştırıcıların YouTube özetinin bu makalenin sonunda eklenmesini bulun – ancak gösterilen örnekler arasındaki farklılıklar, HDR olmayan bir monitörde net olmayabileceğini bilin.

Yöntem ve Veri

Yazarlar, bu özel takibin ne kadar zorlu bir challenge olduğunu vurguluyor:

‘Büyük miktarda doğrusal görüntü elde etmek uygulamada son derece zor. Ayrıca, çoğu kamu HDR veri setleri ya panoramik (böylece neredeyse yalnızca büyük ölçekli sahne içeriğine odaklanıyor) ya da gerçek doğrusal görüntüler sunmuyor, bu nedenle bizim amaçlarımız için uygun değil.’

‘Bu nedenle, temel olarak eğitim için RAW görüntü veri setlerini kullanıyoruz.’

Araştırmacılar, eldeki birkaç seçeneği yaratıcı bir şekilde kullandı, RAISE veri setinı gerçek eğitim verileri olarak ve MIT-Adobe FiveK veri setini değerlendirme verileri olarak kullandılar*.

Kullanılabilir HDR eğitim verilerini oluşturmak için, araştırmacılar RAW kamera dosyalarını, kamera özgü tuhaflıkları gideren ve görüntüleri tutarlı, sahneye atıfta bulunan doğrusal bir formata dönüştüren standart bir işlem hattından geçirdiler:

Yazarların iş akışının şeması: sistem, aynı sahnenin dört maruz kalma seviyesini temsil eden gürültü, bir metin promtu ve bir parlaklık jetonu ile başlar ve bunları, farklı maruz kalmaları hizalı tutarken aydınlatma için ayarlayan yığınlanmış transformer bloklarından geçirir. Ardından, maruz kalma görüntülerinin kümesini ve genel bir parlaklık ölçeğini öngörür ve bunları, hem gölgelerde hem de vurgularda ayrıntı tutan tek bir sahneye atıfta bulunan görüntüye dönüştürür.

Bu, tam RGB’yi sensör verisinden yeniden oluşturmayı, renk düzeltmesi uygulamayı, beyaz dengesini normalize etmeyi ve briefly algısal renk uzayına gürültü azaltma için geçmeyi ve sonra temiz bir doğrusal sinyale dönmesini içeriyordu. Sahnedeki gerçek ışık, kameranın maruz kalma ayarları kullanılarak geri kazanıldı, böylece her piksel gerçek bir parlaklığı yansıtıyordu, değil de görüntüye hazır bir yaklaşıma.

Bu değerlerin geniş bir şekilde değişebileceği için, veri daha sonra her görüntünün kendi parlaklık dağılımına göre ölçeklendirilerek stabilize edildi, orta ve vurgu istatistiklerini kullanarak hem solgun görüntülerin hem de vurguların önlenmesi için, sonunda sahnedeki gerçek parlaklık aralığını koruyan ve eğitim için yeterli derecede stabilize edilmiş bir doğrusal görüntü elde edildi.

Görüntüler için metin etiketleri, Qwen2.5-VL 7B modeli ile oluşturuldu, promt’lar, oluşturma zamanında kullanılacak olan Flux modelinin özelliklerine uygun şekilde tasarlandı.

Her görüntü, maruz kalma ‘dilimleri’ne bölündü ve paylaşılan bir VAE kodlayıcıdan geçirildi, tüm maruz kalmaları, tam parlaklık aralığını yakalayan ortak bir latent uzaya dönüştürdü. Latent’ler daha sonra gürültüden rafine edildi ve görüntülere geri dönüştürüldü, böylece karanlık ve parlak bölgeler boyunca tutarlı bir şekilde yeniden oluşturulmasına izin verildi, bunları ‘düzleştirilmiş’ bir maruz kalma seviyesine çökertmeden.

LoRA fine-tuning, ön eğitimli Flux omurgasını, minimum ek parametrelerle doğrusal-görüntü verilerine uyarlamak için kullanıldı, bu da Single-Diffusion Transformers (single-DiT) modelinin, parlaklık değişse bile ổnil kalmasına yardımcı oldu.

Maruz Kalma Modülasyonu Kendi Dikkati (şema illüstrasyonunun orta sütunu), tüm kuyrukları ortak olarak işlemek için tanıtıldı, böylece her maruz kalma için parlaklık ayarlanırken yapı ve ince ayrıntı hizalı tutulabildi.

3D Rotary Positional Embedding (3D-R[o]PE), hem uzaysal konumu hem de maruz kalma kimliğini kodlamak için kullanıldı, böylece modelin, hangi kuyruğun hangi tokena ait olduğunu ayırt edebilmesi ve aynı zamanda uzaysal tutarlılığı koruması sağlandı, bu da parlaklık değişiminin sahne içeriğinden temiz bir şekilde ayrılmasını sağladı.

Çalışmada kullanılan veri setinin bir özeti, görüntülerin içerik türleri ve iç mekan vs dış mekan sahneleri boyunca dağılımını ve işlenen verideki parlaklık değerlerinin dağılımını gösteriyor. Histogramlar, log uzayında parlaklık ve radyans ölçeğini grafikleştiriyor ve gerçek dünya parlaklığının ne kadar geniş bir şekilde değişebileceğini gösteriyor, daha yüksek radyans değerlerinin fiziksel olarak daha parlak sahnelere karşılık geldiğini ve modelin ele almayı öğrendiği güçlü dinamik aralığı vurguluyor.

3D-RoPE, nerede bir özelliğin olduğu ve ‘hangi maruz kalma olduğunu’ ayrı sinyallere ayırdı, böylece parlaklık değişimi, uzaysal ayrıntı bozulmadan bağımsız olarak ayarlanabildi.

Testler

Araştırmacılar, Flux-dev‘i generatif çerçeve olarak kullandı, eğitim dört NVIDIA A100 GPU’sunda, her biri 80GB VRAM ile gerçekleşti. Batch boyutu, her GPU için 4 olarak ayarlandı, 10.000 iterasyon üzerinden.

LoRA fine-tuning, rank 64 olarak ayarlandı. AdamW optimizatörü, maruz kalma modülasyonu yönünden 2×102 öğrenme hızında kullanıldı.

Yazarlar, iki önceki çalışmanın benzer bir kapsamda olduğunu, ancak hiçbirinin test aşaması için açık bir aday olmadığını belirtiyorlar. Max Planck liderliğindeki 2022 çalışması GlowGAN, belirli görüntü kategorilerini üretmeye sınırlıdır, mentre 2025’teki Bracket Diffusion (yine Max Planck Enstitüsü tarafından yönetiliyor), yalnızca 256x256px’de bir HDR görüntüsü üretebilir ve bunu yapmak birkaç dakika sürer.

Orijinal GlowGAN makalesinden, tipik düşük dinamik aralık (LDR) görüntülerin gölgelerde ve vurgularda ayrıntı kaybettiği, modelin ise yüksek dinamik aralık (HDR) versiyonları ürettiği ve parlaklık seviyeleri boyunca ayrıntı tutabildiği ve doygun bölgelerin ters ton eşlemesi yoluyla kurtarılmasına olanak tanıdığı gösteriliyor. Kaynak

Dolayısıyla, HDR görüntü oluşturma için doğrudan referansların olmaması nedeniyle, yazarlar yöntemlerini, uyarlanmış mevcut güçlü modellerle karşılaştırdı, özel olarak tasarlanmış alternatifler yerine.

Bir dizi deney (‘T2I Fine-Tuning’), metin-görüntü difüzyon modeli Flux’u LoRA ile fine-tuning ederek, doğrusal görüntüler oluşturmak için eğitildi ve bir T2I modelinin bu alana nasıl adapte olduğu değerlendirildi.

İkinci bir karşılaştırma (‘T2V fine-tuning’), metin-görüntü modeli Wan 2.1‘i kullandı, VAE’sı birden fazla kareyi paylaşılan bir latent’e sıkıştırır; bu kurulumda, dört maruz kalma kuyruğu tek bir latent temsiline kodlandı ve sonra geri çözüldü, bir video tarzı pipeline’nin maruz kalma değişimini modelleyip modelleyemeyeceği test edildi.

Üçüncü dizi deney (‘T2I Model Inflation’), CameraCtrl ve Generative Photography ile karşılaştırmayı içeriyordu; bunlar, görüntü difüzyon modellerini, çoklu kare çıkışları üretmek için temporal modüllerle genişleten yöntemlerdir. Bunlar da aynı veri üzerinde fine-tune edildi, tutarlı bir karşılaştırma için.

Kullanılan metrikler Fréchet Inception Distance (FID); Estetik Skor (AS); Doğallık Görüntü Kalite Değerlendirici (NIQUE); CLIP Sim skoru; ve Parlaklık Benzerliği (LS):

<img class=" wp-image-414266" src="https://www.unite.ai/wp-content/uploads/2026/04/table-1-5.jpg" alt="Yazarların yönteminin, doğrusal, sahneye atıfta bulunan görüntüler oluşturmak için uyarlanmış beberapa temel modelle karşılaştırılması. Metin-görüntü (Flux) ve metin-videolu (Wan 2.1) modeller, LoRA ile fine-tune ediliyor, mevcut generatif sistemlerin bu ayarları nasıl ele aldığını test etmek için; CameraCtrl ve Generative Photography, difüzyon modellerini temporal bileşenler ile genişletiyor. Bazı skorlar eksik, çünkü belirli modeller tutarlı maruz kalma kuyrukları üretebiliyor, bu da tam dinamik aralığın kurtarılmasını gerektiriyor. Rapor edilen metrikler üzerinden, yeni yöntem en güçlü genel sonuçları elde ediyor, özellikle görüntü kalitesi ve doğru parlaklık yeniden yapılandırması ile ilgili ölçümlerde.

Bu sonuçlarla ilgili olarak, yazarlar şunları belirtiyorlar:

‘Doğrusal görüntüler oluşturmak zor, çünkü ön eğitimli VAE’ler latent difüzyon modellerinde, daha yüksek dinamik aralık ve bit derinliği nedeniyle hem aşırı vurguları hem de gölgeleri aynı anda korumak için mücadele ediyor.’

‘T2I Model Inflation yöntemleri, sınırlı dinamik aralığa ve önemli görüntü kalitesi bozulmasına sahiptir, hatta fine-tuning sonrasında bile.’

‘T2V Fine-Tuning için, Wan 2.1’in 4× zamanlı downsampling’i, dört maruz kalma kuyruğunu tek bir latent temsiline karıştırıyor, bu da fine-tuning alone ile çözülemeyen ciddi bir dağılım uyumsuzluğuna neden oluyor.’

‘Sahne özelliklerini maruz kalma kuyrukları kullanarak doğrudan modelleyerek, yöntemimiz görsel kalite ve dinamik aralıkta tüm referanslara göre üstün performans gösteriyor.’

<img class=" wp-image-414267" src="https://www.unite.ai/wp-content/uploads/2026/04/figure-6-2.jpg" alt="LoRA ile uyarlanmış Flux ve Wan 2.1 ile karşılaştırma, her yöntemin aynı sahnelerdeki maruz kalma değişikliklerine nasıl tepki verdiğini gösteriyor. Rakip yaklaşımlar, çok dark veya çok parlak bölgelerde ayrıntı kaybetme eğilimindeyken, önerilen yöntem tutarlı bir yapı ve tüm maruz kalma seviyeleri boyunca kullanılabilir ayrıntı koruma sağlar. Kaynak makale ve proje sitesine daha iyi örnekler için başvurun.

Lütfen daha fazla test için kaynak makalenin genişletilmiş deneyleri ve ek materyaller bölümüne başvurun.

Sonuç

Medya profesyonelleri için, film ve TV üretiminde çalışanlar gibi, dünyanın hayal gücünü (ve, giderek, öfkesini) ele geçiren aynı çıktı, onları etkilemedi, çünkü neredeyse tüm管line’ları某 şekilde HDR yakalamalarına bağlı.

Dolayısıyla bu, zamanında bir projedir ve umuluyor ki bu tür bir özellik, yeni çerçeveler boyunca isteğe bağlı bir standart haline gelecektir – ancak bu, kesinlikle oluşturma sürelerini en az iki katına çıkaracaktır; açıkça, gecikme ciddi bir şekilde ele alınmalıdır, yoksa HDR AI içeriği ‘post-prodüksiyonda’ değil, ‘kamerada’ kategorisine mahkum edilecektir.

* Normalde örnekler gösterirdik, ancak okuyucu bir HDR özellikli monitöre sahip olmayabileceği için bu durumda bunları atlıyoruz.

İlk olarak Pazar, 26 Nisan 2026’da yayımlandı