- Терминологија (А до Д)

- Контрола АИ способности

- АИОпс

- албумације

- Перформансе имовине

- Аутоенцодер

- Пропагација уназад

- Бајесова теорема

- Биг података

- Цхатбот: Водич за почетнике

- Рачунарско размишљање

- Цомпутер Висион

- Цонфусион Матрик

- Конволуционарне неуронске мреже

- Циберсецурити

- Дата Фабриц

- Дата Сторителлинг

- podaci Наука

- Складиштење података

- Стабло одлучивања

- Деепфакес

- Дееп Леарнинг

- Учење дубоког ојачања

- Девопс

- ДевСецОпс

- Дифузиони модели

- Дигитал Твин

- Смањење димензија

- Терминологија (Е до К)

- Едге АИ

- Емотион АИ

- Енсембле Леарнинг

- Етхицал Хацкинг

- ЕТЛ

- Објашњива АИ

- Федератед Леарнинг

- ФинОпс

- Генеративна АИ

- Генеративе Адверсариал Нетворк

- Генеративно против дискриминативног

- Градиент Боостинг

- Градиент Десцент

- Учење неколико хитаца

- Класификација слика

- ИТ операције (ИТОпс)

- Инцидент Аутоматион

- Инфлуенце Енгинееринг

- Груписање К-средстава

- К-најближи суседи

- Терминологија (Л до К)

- Терминологија (Р до З)

- Учење ојачања

- Одговоран АИ

- РЛХФ

- Аутоматизација роботских процеса

- Структурирано против неструктурираног

- Анализа осјећаја

- Надгледани против ненадгледаних

- Подршка векторских машина

- Синтетички подаци

- Синтхетиц Медиа

- Класификација текста

- ТиниМЛ

- Трансфер Леарнинг

- Трансформаторске неуронске мреже

- туринг тест

- Претрага векторске сличности

АИ 101

Како функционише класификација текста?

Преглед садржаја

Класификација текста је процес анализе текстуалних секвенци и додељивања им ознаке, стављајући их у групу на основу њиховог садржаја. Класификација текста лежи у основи готово сваког задатка АИ или машинског учења који укључује обраду природног језика (НЛП). Са класификацијом текста, компјутерски програм може да изврши широк спектар различитих задатака као што су препознавање нежељене поште, анализа осећања и функције цхатбот-а. Како тачно функционише класификација текста? Које су различите методе вршења класификације текста? У наставку ћемо истражити одговоре на ова питања.

Дефинисање класификације текста

Важно је да одвојимо мало времена и уверимо се да разумемо каква је класификација текста, уопште, пре него што уђемо у различите методе класификације текста. Класификација текста је један од оних термина који се примењује на много различитих задатака и алгоритама, тако да је корисно да се уверимо да разумемо основни концепт класификације текста пре него што пређемо на истраживање различитих начина на које се она може извршити.

Све што укључује креирање различитих категорија за текст, а затим означавање различитих узорака текста као ових категорија, може се сматрати класификацијом текста. Све док систем спроводи ове основне кораке може се сматрати класификатором текста, без обзира на тачан метод који се користи за класификацију текста и без обзира на то како се класификатор текста на крају примењује. Откривање нежељене е-поште, организовање докумената по теми или наслову и препознавање осећаја рецензије за производ су примери класификације текста јер се постижу узимањем текста као улаза и излазом ознаке класе за тај део текста.

Како функционише класификација текста?

Фотографија: Куинн Домбровски преко Флицкр-а, ЦЦ БИ СА 2.0, (хттпс://ввв.флицкр.цом/пхотос/куиннаниа/4714794045)

Већина метода класификације текста може се ставити у једну од три различите категорије: методе засноване на правилима или методе машинског учења.

Методе класификације засноване на правилима

Методе класификације текста засноване на правилима функционишу коришћењем експлицитно осмишљених лингвистичких правила. Систем користи правила која је креирао инжењер да би одредио којој класи треба да припада дати део текста, тражећи трагове у виду семантички релевантних елемената текста. Свако правило има образац са којим текст мора да одговара да би био стављен у одговарајућу категорију.

Да будемо конкретнији, рецимо да сте желели да дизајнирате класификатор текста који може да разликује уобичајене теме разговора, као што су време, филмови или храна. Да бисте омогућили вашем класификатору текста да препозна дискусију о времену, можете му рећи да тражи речи повезане са временом у телу узорака текста којима се шаље. Имали бисте листу кључних речи, фраза и других релевантних образаца који би се могли користити за разликовање теме. На пример, можете наложити класификатору да тражи речи попут „ветар“, „киша“, „сунце“, „снег“ или „облак“. Затим бисте могли да натерате класификатор да прегледа уносни текст и изброји колико пута се ове речи појављују у телу текста и ако се појављују чешће од речи које се односе на филмове, ви бисте класификовали текст као припадајући класи времена.

Предност система заснованих на правилима је у томе што су њихови улази и излази предвидљиви и разумљиви од стране људи, а могу се побољшати ручном интервенцијом инжењера. Међутим, методе класификације засноване на правилима су такође донекле крхке и често им је тешко да генерализују јер могу да се придржавају само унапред дефинисаних образаца који су програмирани. На пример, реч „облак“ може да се односи на влагу у небо, или се може односити на дигитални облак у којем се чувају подаци. Системима заснованим на правилима тешко је да се изборе са овим нијансама, а да инжењери не потроше доста времена покушавајући да ручно предвиде и прилагоде ове суптилности.

Системи машинског учења

Као што је горе поменуто, системи засновани на правилима имају ограничења, јер њихове функције и правила морају бити унапред програмирани. Насупрот томе, системи класификације засновани на машинском учењу функционишу применом алгоритама који анализирају скупове података за обрасце који су повезани са одређеном класом.

Алгоритми машинског учења се напајају унапред означеним/пре-класификованим инстанцама које се анализирају за релевантне карактеристике. Ове унапред означене инстанце су подаци о обуци.

Класификатор машинског учења анализира податке о обуци и учи обрасце који су повезани са различитим класама. Након тога, невидљиве инстанце се уклањају са својих ознака и уносе у класификациони алгоритам који инстанцама додељује ознаку. Додељене ознаке се затим упоређују са оригиналним ознакама да би се видело колико је тачан класификатор машинског учења, мерећи колико добро је модел научио који обрасци предвиђају које класе.

Алгоритми машинског учења раде анализом нумеричких података. То значи да да би се користио алгоритам машинског учења на текстуалним подацима, текст треба да се конвертује у нумерички формат. Постоје различите методе кодирања текстуалних података као нумеричких података и креирања метода машинског учења око ових података. У наставку ћемо покрити неке од различитих начина представљања текстуалних података.

Баг-оф-Вордс

Врећа речи је један од најчешће коришћених приступа за кодирање и представљање текстуалних података. Термин „врећа речи“ потиче од чињенице да у суштини узимате све речи у документима и стављате их све у једну „торбу“ не обраћајући пажњу на ред речи или граматику, обраћајући пажњу само на учесталост речи у торби. Ово резултира дугачким низом, или вектором, који садржи једну репрезентацију свих речи у улазним документима. Дакле, ако има укупно 10000 јединствених речи у улазним документима, вектори карактеристика ће бити дуги 10000 речи. Овако се израчунава величина вектора речи торба/феатуре.

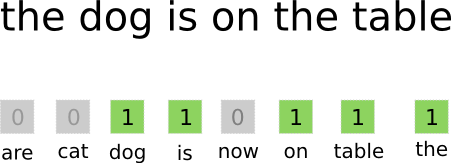

Фотографија: гк_ преко Мацхинелеарнинг.цо, (хттпс://мацхинелеарнингс.цо/тект-цлассифицатион-усинг-неурал-нетворкс-ф5цд7б8765ц6)

Након што се одреди величина вектора обележја, сваком документу на листи укупних докумената се додељује сопствени вектор испуњен бројевима који показују колико пута се реч о којој је реч појављује у тренутном документу. То значи да ако се реч „храна“ појави осам пута у једном текстуалном документу, тај одговарајући низ вектора/обележја ће имати осмицу на одговарајућој позицији.

Другим речима, све јединствене речи које се појављују у улазним документима се гомилају у једну врећу и онда сваки документ добија вектор речи исте величине, који се затим попуњава бројем пута када се различите речи појављују у документу .

Текстуални скупови података често садрже велики број јединствених речи, али већина њих се не користи често. Из тог разлога, број речи које се користе за креирање вектора речи је обично ограничен на изабрану вредност (Н) и тада ће димензија вектора обележја бити Нк1.

Учесталост термина – Инверзна учесталост докумената (ТФ-ИДФ)

Други начин представљања документа на основу речи у њему је синхронизован Учесталост термина – Инверзна учесталост докумената (ТФ-ИДФ). ТФ-ИДФ приступ такође креира вектор који представља документ на основу речи у њему, али за разлику од Баг-оф-вордс ове речи су пондерисани више од њихове фреквенције. ТФ-ИДФ разматра важност речи у документима, покушавајући да квантификује колико је та реч релевантна за предмет документа. Другим речима, ТФ-ИДФ анализира релевантност уместо учесталости и број речи у вектору обележја се замењује резултатом ТФ-ИДФ који се израчунава у односу на цео скуп података.

ТФ-ИДФ приступ функционише тако што се прво израчунава фреквенција термина, колико пута се јединствени термини појављују у одређеном документу. Међутим, ТФ-ИДФ такође води рачуна да ограничи утицај изузетно уобичајених речи као што су „тхе“, „ор“ и „анд“, пошто су ове „зауставне речи“ веома честе, али преносе врло мало информација о садржају документа. Ове речи треба одбацити, на шта се односи део „фреквенције инверзне документације“ у ТФ-ИДФ-у. Ово се ради зато што што се у више докумената појављује одређена реч, то је та реч мање корисна у разликовању од осталих докумената на листи свих докумената. Формула коју ТФ-ИДФ користи за израчунавање важности речи је дизајнирана да сачува речи које су најчешће и семантички најбогатије.

Вектори обележја креирани ТФ-ИДФ приступом садрже нормализоване вредности које се збрајају у један, при чему се свакој речи додељује пондерисана вредност како је израчуната ТФ-ИДФ формулом.

Ворд Ембеддингс

Уграђивање речи су методе представљања текста које обезбеђују да речи са сличним значењима имају сличне нумеричке репрезентације.

Уграђивање речи оперишу „векторизацијом“ речи, што значи да представљају речи као векторе реалне вредности у векторском простору. Вектори постоје у мрежи или матрици и имају правац и дужину (или величину). Када се речи представљају као вектори, речи се претварају у векторе који се састоје од стварних вредности. Свака реч је мапирана у један вектор, а речи које су сличне по значењу имају сличан правац и величину. Овај тип кодирања омогућава алгоритму машинског учења да научи компликоване односе између речи.

Уградње које представљају различите речи креирају се с обзиром на то како се дотичне речи користе. Пошто ће речи које се користе на сличан начин имати сличне векторе, процес креирања уграђивања речи аутоматски преводи нека од значења које речи имају. Приступ кесама речи, насупрот томе, ствара крхке репрезентације где ће различите речи имати различите репрезентације чак и ако се користе у веома сличним контекстима.

Као резултат тога, уграђивање речи је боље у хватању контекста речи унутар реченице.

Постоје различити алгоритми и приступи који се користе за креирање уграђивања речи. Неке од најчешћих и најпоузданијих метода за уграђивање речи укључују: уграђивање слојева, ворд2вец и ГлоВе.

Уграђивање слојева

Један од потенцијалних начина да се користе уграђивање речи уз систем машинског учења/дубоког учења је да користите слој за уграђивање. Слојеви за уграђивање су слојеви дубоког учења који претварају речи у уграђене елементе који се затим уносе у остатак система дубоког учења. Уграђивање речи се учи док се мрежа обучава за одређени задатак заснован на тексту.

У приступу уграђивања речи, сличне речи ће имати сличне репрезентације и бити ближе једна другој него различитим речима.

Да би се користили слојеви за уграђивање, текст треба прво да буде претходно обрађен. Текст у документу мора бити једнократно кодиран, а величина вектора мора бити специфицирана унапред. Једнократни текст се затим претвара у векторе речи и вектори се прослеђују у модел машинског учења.

Ворд2Вец

Ворд2Вец је још један уобичајени метод уграђивања речи. Ворд2Вец користи статистичке методе за претварање речи у уграђене и оптимизован је за употребу са моделима заснованим на неуронским мрежама. Ворд2Вец су развили Гоогле истраживачи и један је од најчешће коришћених метода уграђивања, јер поуздано даје корисне, богате уградње. Ворд2Вец репрезентације су корисне за идентификацију семантичких и синтаксичких сличности у језику. То значи да Ворд2Вец репрезентације обухватају односе између сличних концепата, могу да разликују да је заједничко између „Краља“ и „Краљице“ краљевство и да „Краљ“ имплицира „мушкост“, док Краљица имплицира „Женскост“.

Рукавица

ГлоВЕ, или Глобални вектор за представљање речи, надовезује се на алгоритме за уграђивање које користи Ворд2Вец. ГлоВе методе уграђивања комбинују аспекте и Ворд2Вец и техника факторизације матрице као што је латентна семантичка анализа. Предност Ворд2Вец-а је у томе што може да ухвати контекст, али као компромис лоше бележи глобалну статистику текста. Насупрот томе, традиционалне векторске репрезентације су добре у одређивању глобалне статистике текста, али нису корисне за одређивање контекста речи и фраза. ГлоВЕ користи најбоље од оба приступа, стварајући контекст речи заснован на глобалној статистици текста.

Блогер и програмер са специјалностима у Машинско учење Дееп Леарнинг теме. Данијел се нада да ће помоћи другима да искористе моћ вештачке интелигенције за друштвено добро.

Можда вам се свидја

Успон софтверских инжењера АИ: СВЕ-Агент, Девин АИ и будућност кодирања

ИнструцтИР: Висококвалитетна рестаурација слике према људским упутствима

НЛП Рисе са моделима трансформатора | Свеобухватна анализа Т5, БЕРТ и ГПТ

Аналогне и повратне информације: Уроните у недавна достигнућа Гоогле ДеепМинд-а

ЛламаИндек: Лако проширите своје ЛЛМ апликације прилагођеним подацима

Улога векторских база података у модерним генеративним АИ апликацијама