Umetna inteligenca

Raziskovalci ustvarjajo alternativo GPU

Računalniški znanstveniki z univerze Rice so skupaj s sodelavci iz Intela razvili stroškovno učinkovitejšo alternativo GPU. Novi algoritem se imenuje "podlinearni mehanizem za globoko učenje" (SLIDE) in uporablja centralne procesne enote (CPE) za splošne namene brez specializirane strojne opreme za pospeševanje.

Rezultati so bili predstavljeni v kongresnem centru Austin, kjer poteka konferenca sistemov strojnega učenja MLSys.

Eden največjih izzivov v okviru umetne inteligence (AI) je povezan s specializirano strojno opremo za pospeševanje, kot so grafične procesne enote (GPU). Pred novim razvojem je veljalo, da je za pospešitev tehnologije globokega učenja potrebna uporaba te specializirane strojne opreme za pospeševanje.

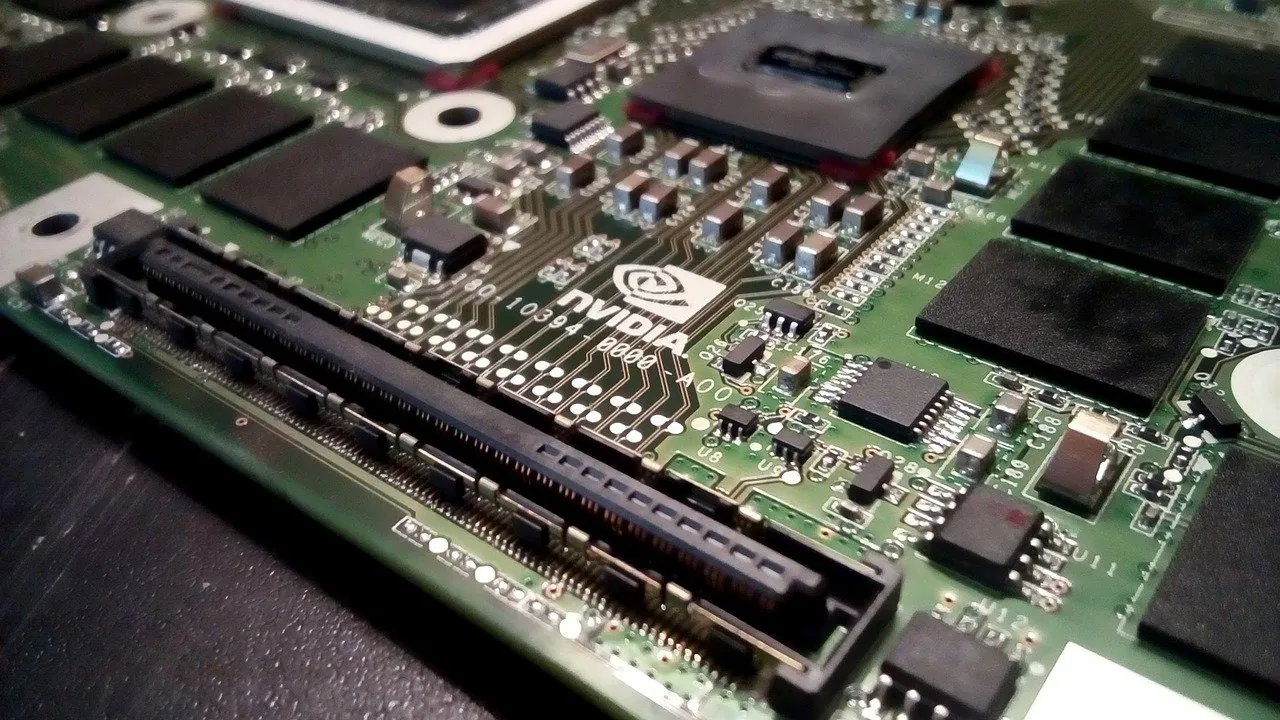

Številna podjetja so dala velik pomen vlaganju v GPU in specializirano strojno opremo za globoko učenje, ki je odgovorna za tehnologijo, kot so digitalni pomočniki, prepoznavanje obrazov in sistemi za priporočanje izdelkov. Eno takih podjetij je Nvidia, ki ustvarja grafične procesorje Tesla V100 Tensor Core. Nvidia je nedavno poročala o 41-odstotnem povečanju svojih prihodkov v četrtem četrtletju v primerjavi z lanskim letom.

Razvoj SLIDE odpira povsem nove možnosti.

Anshumali Shrivastava je docent na Rice's Brown School of Engineering in je pomagal izumiti SLIDE s podiplomskima študentoma Beidijem Chenom in Tharunom Medinijem.

»Naši testi kažejo, da je SLIDE prva pametna algoritemska izvedba globokega učenja na CPE, ki lahko prekaša strojno pospeševanje GPU na podatkovnih nizih priporočil v industrijskem merilu z velikimi popolnoma povezanimi arhitekturami,« je dejal Shrivastava.

SLIDE premaga izziv grafičnih procesorjev zaradi svojega popolnoma drugačnega pristopa k globokemu učenju. Trenutno je standardna tehnika usposabljanja za globoke nevronske mreže "povratno širjenje" in zahteva matrično množenje. Ta delovna obremenitev zahteva uporabo grafičnih procesorjev, zato so raziskovalci spremenili usposabljanje nevronske mreže, tako da jo je bilo mogoče rešiti z zgoščenimi tabelami.

Ta novi pristop močno zmanjša stroške računanja za SLIDE. Trenutno najboljša platforma GPU, ki jo podjetja, kot sta Amazon in Google, uporabljajo za globoko učenje v oblaku, ima osem Tesla V100, cena pa je okoli 100,000 $.

"Enega imamo v laboratoriju in v našem testnem primeru smo vzeli delovno obremenitev, ki je popolna za V100, tisto z več kot 100 milijoni parametrov v velikih, popolnoma povezanih omrežjih, ki se prilegajo pomnilniku GPE," je dejal Shrivastava. »Usposobili smo ga z najboljšim paketom (programske opreme), Googlovim TensorFlow, in usposabljanje je trajalo 3 ure in pol.

»Nato smo pokazali, da lahko naš novi algoritem opravi usposabljanje v eni uri, ne na grafičnih procesorjih, temveč na 44-jedrnem CPE-ju razreda Xeon,« je nadaljeval.

Zgoščevanje je vrsta metode indeksiranja podatkov, izumljene v devetdesetih letih prejšnjega stoletja za internetno iskanje. Numerične metode se uporabljajo za kodiranje velikih količin informacij kot niz števk, ki se imenuje zgoščena vrednost. Zgoščene vrednosti so navedene za ustvarjanje tabel, po katerih je mogoče hitro iskati.

»Ne bi imelo smisla implementirati našega algoritma na TensorFlow ali PyTorch, ker je prva stvar, ki jo želijo storiti, pretvoriti vse, kar počnete, v problem množenja matrik,« je dejal Chen. »Prav temu smo se želeli izogniti. Zato smo iz nič napisali lastno kodo C++.«

Po mnenju Shrivastave je največja prednost SLIDE ta, da je podatkovno vzporeden.

»S podatkovno vzporednico mislim, da če imam dva primerka podatkov, na katerih se želim učiti, recimo, da je ena slika mačke in druga avtobusa, bosta verjetno aktivirala različne nevrone in SLIDE lahko posodobi ali uri na teh dveh neodvisno,« je dejal. "To je veliko boljša uporaba paralelizma za CPE."

"Druga stran v primerjavi z GPU je, da potrebujemo velik pomnilnik," je dejal. "V glavnem pomnilniku obstaja hierarhija predpomnilnika in če z njo niste previdni, lahko naletite na težavo, imenovano razbijanje predpomnilnika, kjer pride do veliko zgrešenih predpomnilnikov."

SLIDE je odprl vrata novim načinom izvajanja globokega učenja in Shrivastava verjame, da je to šele začetek.

"Pravkar smo opraskali površino," je dejal. »Še vedno lahko veliko storimo za optimizacijo. Nismo uporabili na primer vektorizacije ali vgrajenih pospeševalnikov v CPE, kot je Intel Deep Learning Boost. Obstaja veliko drugih trikov, ki bi jih lahko uporabili, da bi to naredili še hitreje.«