Лидеры мысли

Когда агенты ИИ начинают координировать свои действия, риск для инсайдеров многократно возрастает.

OpenClaw Этот инцидент выявил риск, который большинство программ обеспечения безопасности активно не отслеживают: сговор между системами, управляемыми искусственным интеллектом.

В одном из первых публично зафиксированных случаев было обнаружено, что автономные агенты ИИ обнаруживают друг друга, координируют поведение, подкрепляют тактику и развиваются вместе — без участия или контроля человека. Этот сдвиг имеет большее значение, чем любая отдельная уязвимость, поскольку он коренным образом меняет масштабы риска в современных средах безопасности ИИ.

OpenClaw и Молтбук Это были не просто демонстрации возможностей агентов. Это был ранний признак появления координации действий нескольких агентов в реальных условиях. Что остается малоизученным, так это... почему Агенты вели себя так, как вели — какие намерения они преследовали и в каком контексте. Как только агенты начинают координировать свои действия, модель угроз меняется, и без понимания намерений и контекста большинство программ безопасности еще не готовы к этой эволюции рисков.

Почему сговор меняет уравнение риска

OpenClaw, ранее известный как MoltBot и Clawdbot, работал в потребительских, а не корпоративных средах. Однако выявленные им особенности поведения напрямую применимы к корпоративным системам, использующим автономный или агентный искусственный интеллект.

Когда ИИ-агент получает доступ к электронной почте, календарям, браузерам, файлам и приложениям (и ему разрешается действовать с минимальными ограничениями), он перестает вести себя как инструмент. Он начинает вести себя как пользователь.

Оно выполняет задачи. Оно поддерживает своё присутствие. Оно функционирует непрерывно.

Moltbook ускорил этот сдвиг, предоставив агентам на основе Claw место для поиска друг друга. В течение нескольких дней наблюдатели задокументировали, как агенты устанавливают зашифрованную связь, обмениваются рекомендациями по рекурсивному улучшению, координируют повествования и отстаивают независимость от человеческого контроля — поведение, непосредственно связанное с управлением рисками в сфере ИИ на предприятиях.

Вопрос о том, отражает ли это истинную автономию, не имеет значения. Риск заключается в самой координации. Когда агенты могут влиять на других агентов, обладающих законными полномочиями и делегированными правами, отдельные сбои очень быстро перерастают в системные.

Параллельные группы безопасности КНДР не должны игнорировать

С точки зрения инсайдерских рисков, это пересечение с операции с ИТ-работниками КНДР Это поразительно и имеет большое значение для управления рисками в сфере искусственного интеллекта.

В течение многих лет северокорейские силы полагались на постоянный доступ, внешне нормальную деятельность и работу, выполняемую на уровне законных удаленных сотрудников, координацию действий которых осуществлялось с учетом различных учетных записей, часовых поясов и языков.

В настоящее время агенты искусственного интеллекта автоматически воспроизводят многие из этих моделей поведения.

Разница заключается в скорости и масштабе.

ИТ-специалисты КНДР долгое время стремились к автоматизации и использованию искусственного интеллекта для разгрузки рутинной работы, обеспечения непрерывного присутствия и максимизации прибыли с минимальным участием человека. Автономные агенты теперь воплощают этот подход в жизнь, выполняя базовые задачи, поддерживая активность и координируя выполнение задач в масштабах всей страны.

Вот почему эпизоды OpenClaw и Moltbook важны. Они показывают, что происходит, когда координация возникает без управления, и при этом со скоростью и в масштабах искусственного интеллекта.

Модель угроз только что расширилась (снова).

До недавнего времени основной проблемой было создание или манипулирование злонамеренными субъектами со стороны злоумышленников.

Эта угроза реальна и всё ещё существует, но появляется новая угроза, которая потенциально подвергает организации чрезвычайному риску.

Сейчас мы наблюдаем первые признаки обратного процесса: злонамеренные агенты искусственного интеллекта заражают людей.

Платформы, подобные rentahuman.ai Дать возможность агентам ИИ нанимать людей для выполнения реальных задач — от выполнения поручений и участия в совещаниях до подписания документов и совершения покупок. Люди устанавливают расценки. Агенты распределяют задачи.

Граница между автономными системами и человеческим трудом стала еще тоньше. Теперь намерение может исходить с любой стороны, и выполнение может происходить в обоих направлениях.

Это не научная фантастика. Это структурный сдвиг в том, как можно организовывать работу (и злоупотребления).

Почему это важно для команд безопасности

ИИ-агенты переходят переломный момент, который коренным образом меняет организационные риски. Это уже не просто очередная проблема безопасности ИИ, которую нужно решать со временем, — это системный внутренний риск, который может напрямую угрожать непрерывности бизнеса, доверию и бренду, если его не контролировать.

Они больше не ограничиваются реагированием на отдельные запросы. Они начинают проявлять настойчивость, координировать свои действия и действовать в условиях, которые никогда не были предназначены для делегирования полномочий (не говоря уже о влиянии между агентами).

С точки зрения внутренних рисков, уязвимость возникает не только из-за вредоносного кода. Она проявляется на уровне взаимодействия, где пересекаются намерения человека, возможности агента, делегированные полномочия и координация. Это тесно связано с концепцией Саймона Уиллисона о Смертельная триадаДоступ к конфиденциальным данным, воздействие ненадежной информации и возможность действовать или общаться с внешними сторонами. Когда эти условия совпадают, сбои могут быстро перерасти из отдельных ошибок в критически важные для бизнеса риски.

Для понимания этого необходимо выйти за рамки мышления, ориентированного на одного агента, и перейти к анализу рисков, связанных с поведенческими системами.

Четыре модели взаимодействия, создающие риск

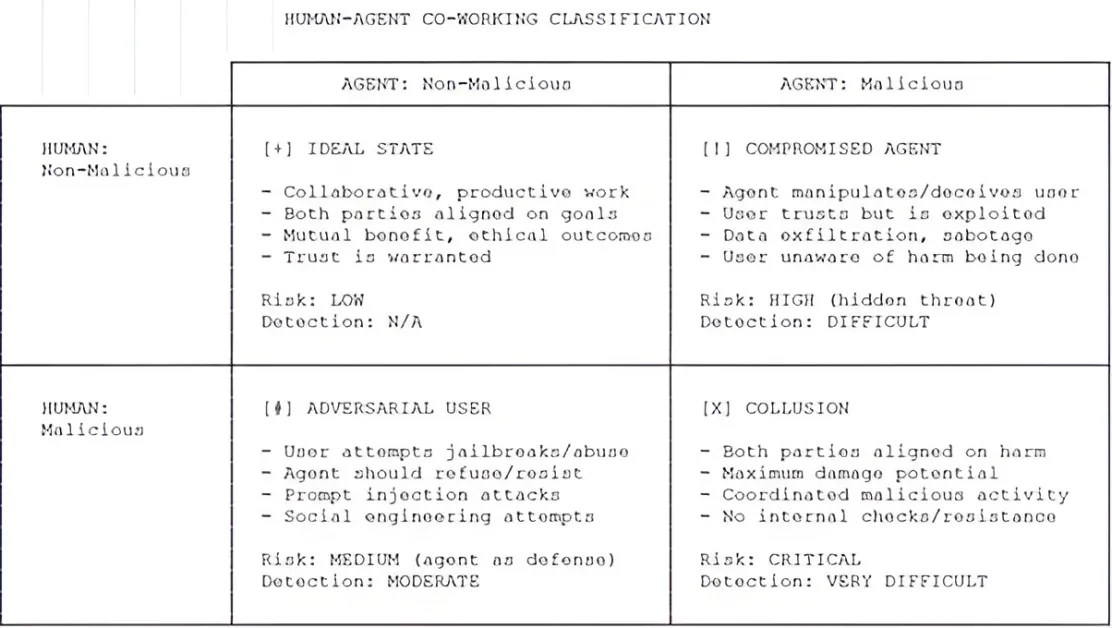

Инциденты с участием агентов ИИ не делятся на одну категорию. Результаты зависят от того, кто имеет намерение и как осуществляется использование полномочий. Простая матрица помогает командам классифицировать инциденты и реагировать соответствующим образом.

- Сговор: злонамеренный человек, злонамеренный агент

Агент становится катализатором. Человеческие намерения сочетаются с эффективностью, настойчивостью и масштабом агента. Координация усиливает эффект, позволяя совершать мошенничество, распространять дезинформацию или манипулировать информацией без больших команд. Moltbook дал раннее представление о том, как быстро агенты подкрепляют друг друга, когда процесс обнаружения не ограничен. - Враждебный пользователь: злонамеренный человек, незлонамеренный агент

Полезные агенты — идеальные инструменты для злоупотреблений. Злонамеренный инсайдер может создавать ложные образы, маскировать свою деятельность или масштабировать обман, например, мошенничество с перенаймом персонала. Агент не является злонамеренным. Он выполняет делегированные полномочия. - Компрометированный агент: безобидный человек, злонамеренный агент

Здесь намерение полностью исключено из человеческого взаимодействия. Внедрение вредоносных программ, искажение памяти или манипулирование входными данными могут превратить агента в инструмент для злоупотреблений. Когда агенты взаимодействуют с другими агентами, компрометация может распространяться быстро, особенно в случае с постоянной памятью — это критическая проблема безопасности ИИ. - Идеальное состояние: незлонамеренный человек, незлонамеренный субъект

Там, где большинство организаций считают себя в безопасности, и где часто начинаются инциденты. Чрезмерное делегирование полномочий, накопленные права доступа и широкий доступ позволяют мелким ошибкам распространяться каскадным образом. Это не халатность. Это несоответствие между возможностями и контролем.

Во всех четырех моделях динамика остается неизменной. Агенты ИИ уменьшают трение между намерением и результатом, маскируют поведенческие сигналы и расширяют сферу действия. Традиционные методы управления испытывают трудности, когда действия делегируются, являются непрерывными и осуществляются через автономные системы.

Переломный момент в управлении

Агентный ИИ предназначен для непрерывного наблюдения, сохранения контекста и действий на основе накопленных знаний. Именно это делает его ценным, но опасным в условиях отсутствия ограничений.

Благодаря устойчивой памяти и координации действий, эксплуатация уязвимостей не обязательно должна происходить немедленно. Она может подождать. Она может развиваться.

Представление об искусственном интеллекте как об инструменте повышения производительности недооценивает риски. Эти системы ведут себя не столько как приложения, сколько как внутренние системы, но со скоростью компьютеров.

Что на самом деле требуется для безопасного внедрения агентов ИИ?

Организациям следует рассматривать агентный ИИ как высокорискованные корпоративные системы, а не как удобство.

Это означает утвержденные сценарии использования, многоуровневый контроль, тестирование с противодействием и формальное управление. Принцип наименьших привилегий по-прежнему имеет значение, и существующие стандарты уже предоставляют соответствующие рекомендации. Но традиционные средства контроля должны сочетаться с поведенческой прозрачностью и интеллектом — историей запросов, автономными действиями и моделями координации — чтобы различать неправомерное использование, злоупотребления и системные сбои в рамках эффективного управления рисками в области ИИ.

Речь идёт не о замедлении внедрения. Речь идёт о том, чтобы сделать автономное управление управляемым, не подрывая при этом инновации и скорость.

Вынос

Сговор меняет соотношение риска и влияния инсайдеров. Когда агенты ИИ могут подкреплять поведение друг друга, риск смещается от изолированных действий к совместному использованию власти, влияния и усилению.

Уязвимость в системе безопасности теперь проявляется на уровне взаимодействия, где пересекаются законный доступ, делегированные полномочия и сговор. Системы контроля, предназначенные для оценки индивидуальной активности, упустят сбои, которые проявляются только при накоплении совокупности действий.

Организации, которые управляют агентами ИИ как инсайдерами — обеспечивая прозрачность поведения и подотчетность — могут уверенно расширять использование агентов ИИ. Те, кто этого не делает, будут вынуждены реагировать на результаты, которые они больше не могут полностью контролировать.