Лидеры мнений

Что должен знать каждый специалист по данным о графических трансформаторах и их влиянии на структурированные данные

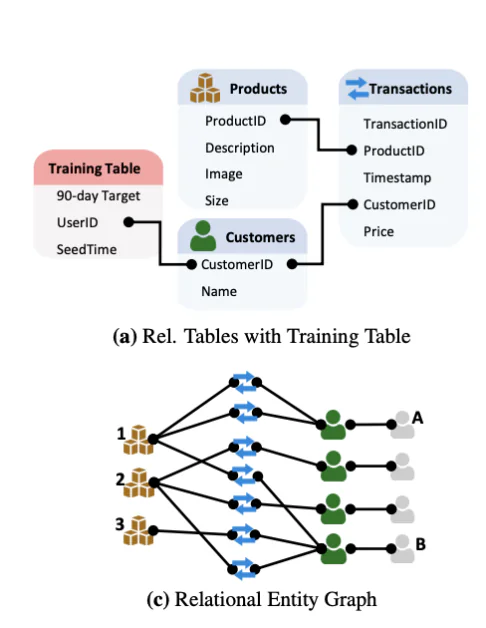

Я стал соавтором графических нейронных сетей, работая в Стэнфорде. Я рано осознал, что эта технология невероятно мощна. Каждая точка данных, каждое наблюдение, каждый фрагмент знаний не существует в изоляции; он является частью графа, связанного с другими фрагментами знаний. Важно отметить, что большинство ценных бизнес-данных, часто хранящихся в таблицах баз данных и хранилищ данных, может быть естественно представлено как граф. Использование этой реляционной структуры является ключом к созданию точных и не галлюцинирующих моделей ИИ.

Графические нейронные сети (GNN) ввели архитектуры передачи сообщений, которые могли рассуждать о графах, захватывая связи между фрагментами знаний. Но как и трансформеры преобразовали понимание языка, новый класс моделей, графические трансформаторы, приносит подобные выгоды графическим данным. Эти модели объединяют гибкость механизмов внимания с структурными графическими априорными знаниями для более эффективного моделирования сложных отношений, чем их предшественники GNN.

Почему графам нужно больше, чем передача сообщений

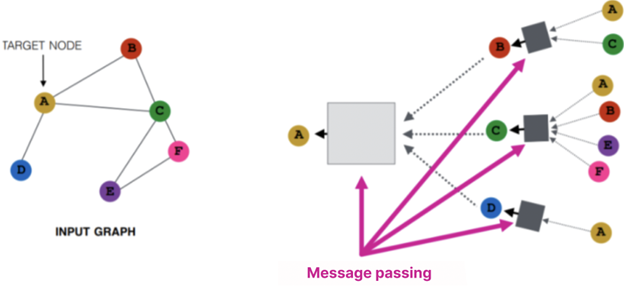

Традиционные графические нейронные сети (GNN) полагаются на передачу сообщений, процесс, при котором каждый узел обновляет свое внутреннее состояние, агрегируя информацию от своих соседей. Представьте себе, что каждый узел обменивается резюме с ближайшими узлами, а затем использует эти резюме для уточнения своего понимания. Через несколько слоев это позволяет информации распространяться по графу.

Хотя этот подход мощен для обучения локальным закономерностям, передача сообщений имеет важные ограничения:

- Перекомпрессия: Когда информация агрегируется за многие шаги, она может стать сжатой, теряя осмысленные детали. Это особенно проблематично в глубоких GNN.

- Ограниченный контекст: Стандартная передача сообщений не может легко захватить долгосрочные зависимости без многих слоев, что увеличивает сложность и шум.

- Выразительность: Многие графические структуры не могут быть дифференцированы, используя только локальную информацию о соседстве, что ограничивает производительность модели на задачах, требующих тонких структурных различий.

Именно здесь графические трансформаторы вступают в игру. Заменяя или дополняя передачу сообщений механизмами внимания, они позволяют каждому узлу直接 обращать внимание на другие узлы (даже удаленные) на основе выученной важности. Результатом являются более богатые представления, лучшая масштабируемость и возможность рассуждать о сложных структурах более гибко.

От GNN до графических трансформаторов

Оригинальная модель трансформера, представленная в иконической статье, Внимание – это все, что вам нужно, была разработана для моделирования отношений между токенами в последовательности. Ее успех заключается в само-внимании, механизме, который позволяет каждому входу учитывать каждый другой вход, взвешенный по выученной релевантности.

Графические трансформаторы адаптируют этот парадигму, позволяя узлам обращать внимание не только на своих соседей, но и на любой узел в графе, либо через полностью связанное внимание, либо через гибридный подход, который балансирует глобальные и локальные сигналы. Вызов заключается в введении понятия структуры в модель, разработанную для неструктурированных последовательностей.

Графические позиционные кодировки

В отличие от текста, графы не имеют внутреннего порядка, что делает позиционное кодирование, которое относится к методам введения структурной или локационной информации в модель, не тривиальным. Графические трансформаторы решают эту проблему с помощью различных методов:

- Лапласовы собственные векторы: Полученные из матрицы Лапласа графа, они обеспечивают спектральное вложение, которое захватывает глобальную структуру.

- Случайные прогулки: Захватывают вероятность перехода от одного узла к другому за несколько шагов.

- Структурные кодировки: Включают метрики расстояния, степени узлов или типы ребер.

Эти позиционные кодировки, будь то спектральные, вероятностные или структурные, дают графическим трансформаторам способ понять, где каждый узел находится в более широком графе. Это структурное осознание является необходимым для того, чтобы механизмы внимания могли работать осмысленно на нерегулярных, неупорядоченных данных, в конечном итоге позволяя модели захватить отношения, которые были бы невидимы для более простых, чисто локальных методов.

Реальные реализации и случаи использования

Внедрение графических трансформаторов в производство требует инфраструктуры, которая может масштабироваться до реальных размеров данных. Библиотеки, такие как PyTorch Geometric (PyG), делают это возможным. Построенная на PyTorch, PyG предоставляет модульную основу для реализации GNN и графических трансформаторов в широком спектре приложений, от моделирования молекул до систем рекомендаций. Она поддерживает обучение в мини-пакетах на многих небольших графах и одном большом графе, с поддержкой нескольких GPU и torch.compile, что делает ее хорошо подходящей для исследований и рабочих процессов предприятий.

Эти инструменты уже используются в широком спектре реальных приложений. В открытии лекарств графические трансформаторы помогают предсказывать молекулярные свойства, моделируя атомные взаимодействия как графы. В логистике и оптимизации цепочки поставок они могут представлять и рассуждать о динамических сетях отправок, складов и маршрутов. Компании электронной коммерции используют их для улучшения рекомендаций, понимая поведение совместных покупок и просмотра как реляционные графы. А в кибербезопасности графические модели используются для обнаружения аномалий, анализируя закономерности доступа, сетевую топологию и последовательности событий.

В каждом из этих контекстов возможность обучаться на сложных, взаимосвязанных структурах без опоры только на手crafted-фичи оказывается значительным преимуществом.

Технические соображения

Несмотря на их потенциал, графические трансформаторы имеют реальные инженерные компромиссы. Полное само-внимание масштабируется квадратично с количеством узлов, что делает эффективность памяти и вычислений главной проблемой, особенно для крупномасштабных или плотных графов. Многие реальные графы также имеют направленные ребра, что вводит асимметрии, которые усложняют, как структурная информация кодируется. А в практических развертываниях входные данные редко бывают униформными: объединение граф-структурированных данных с текстом, временными рядами или изображениями требует тщательных архитектурных выборов и прочной предварительной обработки данных.

Эти проблемы не являются непреодолимыми, но они требуют вдумчивого системного проектирования, особенно при переходе от прототипов исследований к производственным моделям.

Что дальше: LLM встречают графы

Одним из основных направлений исследований является интеграция крупных языковых моделей (LLM) с графическими структурами. Эти гибридные системы используют LLM для кодирования текстового контекста или извлечения сущностей, а затем основывают эту информацию в графе для рассуждений и принятия решений.

В биологии это обеспечило инструменты, такие как AlphaFold. В корпоративном ИИ это позволяет системам поддержки клиентов, которые объединяют документацию и поведенческие графы. Графические трансформаторы также играют все более важную роль в ermögении ИИ-агентов принимать более умные, действенные решения, позволяя им рассуждать о структурированных представлениях состояния и расставлять приоритеты взаимодействий динамически. Это слияние помогает агентам лучше понять иерархические отношения, отслеживать зависимости во времени и адаптировать свое поведение в сложных средах.

Область еще развивается, но потенциал значительный.

Заключение

Графические трансформаторы не являются просто следующей итерацией GNN; они представляют собой слияние внимания, структуры и масштабируемости. Будете ли вы работать в финансах, биологических науках или системах рекомендаций, сообщение ясно: ваши данные образуют граф, поэтому и ваши модели должны.