Искусственный интеллект

Проблема Чёрной Коробки в LLM: Вызовы и Новые Решения

Обучение с помощью машин, подмножество ИИ, включает в себя три компонента: алгоритмы, обучающие данные и полученную модель. Алгоритм, по сути, набор процедур, учится распознавать закономерности из большого набора примеров (обучающих данных). Результатом этого обучения является модель машинного обучения. Например, алгоритм, обученный изображениями собак, приведёт к модели, способной определять собак на изображениях.

Чёрная Коробка в Машинном Обучении

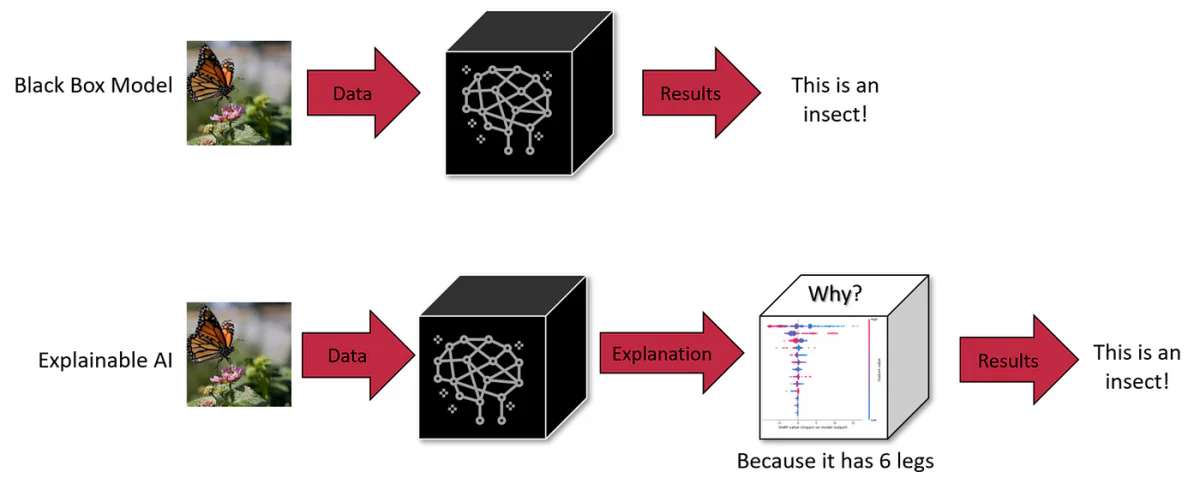

В машинном обучении любой из трёх компонентов — алгоритм, обучающие данные или модель — может быть чёрной коробкой. Хотя алгоритмы часто являются общедоступными, разработчики могут выбрать сохранение модели или обучающих данных в секрете, чтобы защитить интеллектуальную собственность. Эта неясность делает сложным понимание процесса принятия решений ИИ.

ИИ чёрные коробки — это системы, внутренние механизмы которых остаются неясными или невидимыми для пользователей. Пользователи могут вводить данные и получать вывод, но логика или код, который производит вывод, остаётся скрытым. Это общая характеристика многих систем ИИ, включая продвинутые генеративные модели, такие как ChatGPT и DALL-E 3.

LLM, такие как GPT-4, представляют значительную проблему: их внутренние механизмы в значительной степени неясны, что делает их «чёрными коробками». Такая неясность не только техническая загадка, но и представляет реальные проблемы безопасности и этики. Например, если мы не можем понять, как эти системы приходят к выводам, можем ли мы доверять им в критических областях, таких как медицинские диагнозы или финансовые оценки?

Изучение Техник LIME и SHAP

Интерпретируемость в машинном обучении (ML) и глубоком обучении (DL) помогает нам заглянуть во внутренние механизмы этих продвинутых моделей. Локальные Интерпретируемые Модель-Агностические Объяснения (LIME) и SHapley Аддитивные Объяснения (SHAP) — это две такие популярные техники интерпретируемости.

LIME, например, разбивает сложность, создавая более простые, локальные суррогатные модели, которые приближают поведение исходной модели вокруг определённого входа. Делая это, LIME помогает понять, как отдельные функции влияют на предсказания сложных моделей, по сути, предоставляя «локальное» объяснение того, почему модель приняла определённое решение. Это особенно полезно для непрофессиональных пользователей, поскольку оно переводит сложный процесс принятия решений моделей в более понятные термины.

SHAP, с другой стороны, черпает вдохновение из теории игр, в частности, концепции шапли-значений. Он присваивает «важность» каждой функции, указывая, насколько каждая функция способствует разнице между фактическим предсказанием и базовым предсказанием (средним предсказанием по всем входам). Сила SHAP заключается в его последовательности и способности предоставить глобальную перспективу — он не только объясняет отдельные предсказания, но и даёт представление о модели в целом. Это особенно ценно в моделях глубокого обучения, где взаимосвязанные слои и многочисленные параметры часто делают процесс предсказания похожим на путешествие через лабиринт. SHAP разъясняет это, количественно оценивая вклад каждой функции, предлагая более чёткую карту путей принятия решений модели.

SHAP (Источник)

И LIME, и SHAP стали необходимыми инструментами в области ИИ и МО, решая критическую потребность в прозрачности и достоверности. По мере того, как мы продолжаем более глубоко интегрировать ИИ в различные секторы, способность интерпретировать и понимать эти модели становится не только технической необходимостью, но и фундаментальным требованием для этической и ответственной разработки ИИ. Эти техники представляют собой значительные шаги в разъяснении сложностей моделей МО и ОО, превращая их из непонятных «чёрных коробок» в понятные системы, чьи решения и поведение можно понять, доверять и эффективно использовать.

Масштаб и Сложность LLM

Масштаб этих моделей добавляет к их сложности. Возьмём, например, GPT-3 с его 175 миллиардами параметров, и новые модели, имеющие триллионы. Каждый параметр взаимодействует сложными способами внутри нейронной сети, способствуя возникновению способностей, которые не могут быть предсказаны путем изучения отдельных компонентов. Этот масштаб и сложность делают практически невозможным полностью понять их внутреннюю логику, представляя препятствие в диагностике предвзятости или нежелательного поведения в этих моделях.

Компромисс: Масштаб против Интерпретируемости

Уменьшение масштаба LLM может повысить интерпретируемость, но за счёт их продвинутых возможностей. Масштаб — это то, что позволяет поведению, которого не могут достичь более мелкие модели. Это представляет собой внутренний компромисс между масштабом, возможностями и интерпретируемостью.

Влияние Проблемы Чёрной Коробки LLM

1. Неправильное Принятие Решений

Неясность в процессе принятия решений LLM, таких как GPT-3 или BERT, может привести к нераспознанным предвзятостям и ошибкам. В областях, таких как здравоохранение или уголовное правосудие, где решения имеют далеко идущие последствия, невозможность аудита LLM на этическую и логическую обоснованность является значительной проблемой. Например, медицинская диагностическая LLM, полагающаяся на устаревшие или предвзятые данные, может давать вредные рекомендации. Аналогично, LLM в процессах найма могут непреднамеренно увековечивать гендерные предвзятости. Природа чёрной коробки не только скрывает недостатки, но и может потенциально усилить их, требуя активного подхода к повышению прозрачности.

2. Ограниченная Адаптируемость в Различных Контекстах

Отсутствие прозрения во внутренние механизмы LLM ограничивает их адаптируемость. Например, LLM для найма может быть неэффективным в оценке кандидатов на роль, которая ценит практические навыки над академическими квалификациями, из-за своей неспособности скорректировать свои критерии оценки. Аналогично, медицинская LLM может испытывать трудности с диагностикой редких заболеваний из-за дисбаланса данных. Эта негибкость подчёркивает необходимость прозрачности для перенастройки LLM для конкретных задач и контекстов.

3. Предвзятость и Зазоры в Знаниях

Обработка LLM огромных обучающих данных подвержена ограничениям, налагаемым их алгоритмами и архитектурами моделей. Например, медицинская LLM может демонстрировать демографические предвзятости, если она обучена на несбалансированных наборах данных. Кроме того, умение LLM в нишевых темах может быть вводящим в заблуждение, что приводит к чрезмерно уверенным, неправильным выводам. Решение этих предвзятостей и зазоров в знаниях требует более чем просто дополнительных данных; это требует изучения механизмов обработки модели.

4. Юридическая и Этическая Ответственность

Неясная природа LLM создаёт юридическую серую зону в отношении ответственности за любой вред, причинённый их решениями. Если LLM в медицинской среде даёт ошибочные советы, что приводит к вреду пациента, определение ответственности становится сложным из-за неясности модели. Эта юридическая неопределённость представляет риски для организаций, развертывающих LLM в чувствительных областях, подчёркивая необходимость чёткого управления и прозрачности.

5. Проблемы Доверия в Чувствительных Приложениях

Для LLM, используемых в критических областях, таких как здравоохранение и финансы, отсутствие прозрачности подрывает их достоверность. Пользователям и регулирующим органам необходимо обеспечить, чтобы эти модели не содержали предвзятости или не принимали решения на основе несправедливых критериев. Проверка отсутствия предвзятости в LLM требует понимания их процесса принятия решений, подчёркивая важность объяснимости для этической эксплуатации.

6. Риски с Личными Данными

LLM требуют обширных обучающих данных, которые могут включать чувствительную личную информацию. Неясная природа этих моделей вызывает обеспокоенность по поводу того, как эти данные обрабатываются и используются. Например, медицинская LLM, обученная на медицинских записях, вызывает вопросы о конфиденциальности и использовании данных. Обеспечение того, чтобы личные данные не были неправильно использованы или эксплуатированы, требует прозрачных процессов обработки данных внутри этих моделей.

Новые Решения для Интерпретируемости

Для решения этих проблем разрабатываются новые техники. К ним относятся методы приближения контрфактов (CF). Первый метод включает в себя побуждение LLM изменить определённую концепцию текста, сохраняя при этом другие концепции постоянными. Этот подход, хотя и эффективен, требует значительных ресурсов во время вывода.

Второй подход включает в себя создание специального пространства вложений, управляемого LLM во время обучения. Это пространство соответствует причинному графу и помогает выявить совпадения, приближающиеся к контрфактам. Этот метод требует меньше ресурсов во время тестирования и был показан как эффективно объясняющий предсказания модели, даже в LLM с миллиардами параметров.

Эти подходы подчёркивают важность причинных объяснений в системах NLP для обеспечения безопасности и доверия. Приближения контрфактов предоставляют способ представить, как данный текст изменится, если определённая концепция в его генеративном процессе будет другой, помогая в практической оценке причинного эффекта высокоуровневых концепций на модели NLP.

Глубокое Изучение: Методы Объяснений и Причинность в LLM

Инструменты Зондинга и Важности Функций

Зондинг — это техника, используемая для расшифровки того, что внутренние представления в моделях кодируют. Он может быть как управляемым, так и неуправляемым и направлен на определение того, кодируются ли определённые концепции в определённых местах сети. Хотя эффективен до определённой степени, зонды не могут обеспечить причинные объяснения, как подчёркнуто Geiger et al. (2021).

Инструменты важности функций, другой вид метода объяснения, часто фокусируются на входных функциях, хотя некоторые методы, основанные на градиентах, расширяют это до скрытых состояний. Примером является метод Интегрированных Градиентов, который предлагает причинную интерпретацию, изучая базовые (контрфактные, CF) входы. Несмотря на их полезность, эти методы всё ещё испытывают трудности в соединении своих анализов с реальными концепциями за пределами простых свойств входа.

Методы, Основанные на Вмешательстве

Методы, основанные на вмешательстве, включают изменение входов или внутренних представлений для изучения эффектов на поведение модели. Эти методы могут создавать контрфактные состояния для оценки причинных эффектов, но они часто генерируют неправдоподобные входы или состояния сети, если не контролировать их тщательно. Модель Контрфактного Заместителя (CPM), вдохновлённая концепцией S-ученика, является новым подходом в этой области, имитирующим поведение объяснённой модели под контрфактными входами. Однако необходимость в отдельном объяснителе для каждой модели является значительным ограничением.

Приближение Контрфактов

Контрфакты широко используются в машинном обучении для аугментации данных, включающей нарушения различных факторов или меток. Они могут быть сгенерированы с помощью ручного редактирования, эвристического замена ключевых слов или автоматического переписывания текста. Хотя ручное редактирование точное, оно также трудоёмкое. Методы, основанные на ключевых словах, имеют свои ограничения, и генеративные подходы предлагают баланс между плавностью и покрытием.

Верные Объяснения

Верность в объяснениях относится к точному изображению лежащей в основе логики модели. Нет универсально принятого определения верности, что приводит к её характеристике через различные метрики, такие как Чувствительность, Последовательность, Согласие Важности Функций, Устойчивость и Симулируемость. Большинство этих методов фокусируются на объяснениях на уровне функций и часто путают корреляцию с причинностью. Наша работа направлена на предоставление объяснений высокоуровневых концепций, используя литературу о причинности для предложения интуитивного критерия: Порядок-Верности.

Мы углубились в внутренние сложности LLM, понимая их «чёрную коробку» и значительные проблемы, которые она представляет. От рисков неправильного принятия решений в чувствительных областях, таких как здравоохранение и финансы, до этических дилемм, окружающих предвзятость и справедливость, необходимость прозрачности в LLM никогда не была более очевидной.

Будущее LLM и их интеграция в нашу повседневную жизнь и критические процессы принятия решений зависят от нашей способности сделать эти модели не только более продвинутыми, но и более понятными и ответственными. Преследование объяснимости и интерпретируемости не только техническое начинание, но и фундаментальный аспект построения доверия к системам ИИ. По мере того, как LLM становятся более интегрированными в общество, спрос на прозрачность будет расти, не только со стороны практиков ИИ, но и со стороны каждого пользователя, который взаимодействует с этими системами.