Взгляд Anderson

Меньшие Deepfakes могут быть большей угрозой

Инструменты разговорного ИИ, такие как ChatGPT и Google Gemini, теперь используются для создания deepfakes, которые не меняют лица, а rather в более тонких способах переписывают всю историю внутри изображения. Изменяя жесты, реквизит и фоны, эти редактирования обманывают как детекторы ИИ, так и людей, повышая ставки для определения того, что реально в Интернете.

В текущей ситуации, особенно после значимого законодательства, такого как TAKE IT DOWN акт, многие из нас ассоциируют deepfakes и ИИ-генерируемую идентичность с несовместимым ИИ-порно и политической манипуляцией – в целом, грубые искажения правды.

Это привыкает нас ожидать, что ИИ-редактированные изображения всегда будут нацелены на высокие ставки контента, где качество рендеринга и манипуляция контекстом могут добиться кредибельного купа, по крайней мере в краткосрочной перспективе.

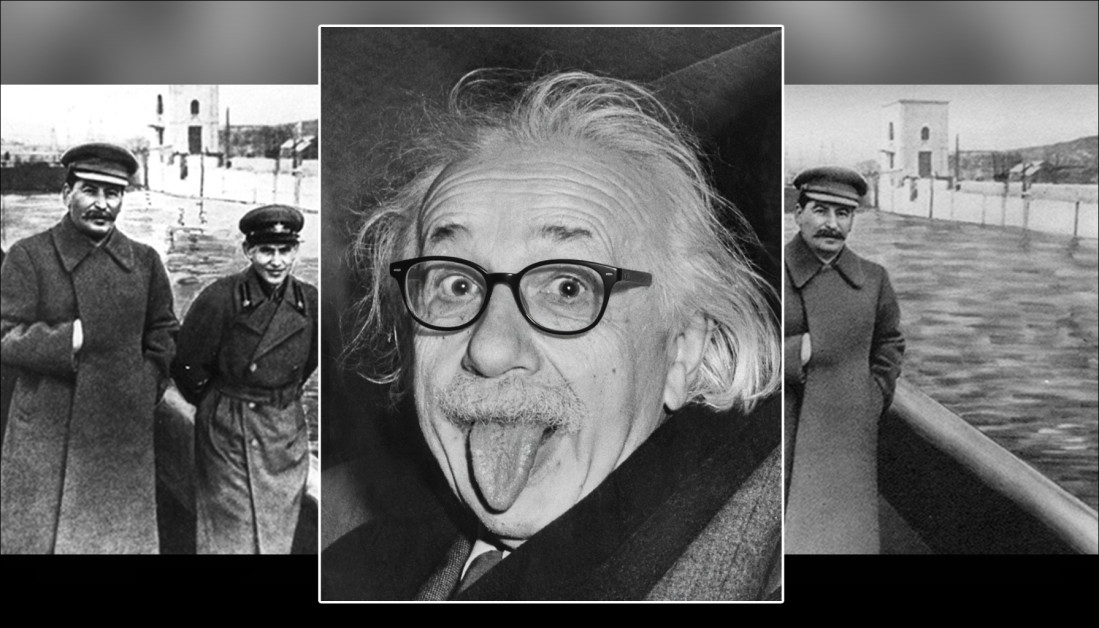

Исторически, однако, гораздо более тонкие изменения часто имели более зловещее и долгосрочное воздействие – например, фотографическая хитрость, которая позволила Сталину удалить тех, кто выпал из благосклонности из фотографического рекорда, как сатирировано в романе Джорджа Оруэлла 1984, где протагонист Уинстон Смит проводит свои дни, переписывая историю и создавая, уничтожая и ‘исправляя’ фотографии.

В следующем примере проблема со вторым изображением заключается в том, что мы ‘не знаем, чего не знаем’ – что бывший глава секретной полиции Сталина, Николай Ежов, раньше занимал место, где теперь есть только барьер безопасности:

Теперь вы видите его, теперь он…испарился. Сталинская фотографическая манипуляция удаляет беспокойного члена партии из истории. Source: Public domain, via https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Текущие потоки этого рода, часто повторяющиеся, сохраняются во многих отношениях; не только культурно, но и в компьютерном зрении, которое получает тенденции из статистически доминирующих тем и мотивов в наборах данных. Чтобы дать один пример, тот факт, что смартфоны снизили барьер для входа и массively снизили стоимость фотографии, означает, что их иконография стала неотвратимо связанной с многими абстрактными понятиями, даже когда это неуместно.

Если обычный deepfaking можно воспринимать как акт ‘нападения’, зловещие и постоянные незначительные изменения в аудиовизуальных средствах массовой информации более похожи на ‘газлайтинг’. Кроме того, способность этого рода deepfaking остаться незамеченным делает его трудным для определения через системы обнаружения deepfakes (которые ищут грубые изменения). Этот подход более похож на воду, изнашивающую скалу за длительный период, чем на скалу, брошенную в голову.

MultiFakeVerse

Исследователи из Австралии сделали шаг, чтобы обратить внимание на отсутствие внимания к ‘тонкому’ deepfaking в литературе, создав значительный новый набор данных манипуляций изображений, центрированных на человеке, которые изменяют контекст, эмоцию и нарратив без изменения основной идентичности субъекта:

Выборка из нового собрания, реальные/фальшивые пары, с некоторыми изменениями более тонкими, чем другие. Обратите внимание, например, на потерю власти азиатской женщины, нижний-правый, когда ее докторский стетоскоп удаляется ИИ. В то же время замена докторского бланка на клипборд не имеет очевидной семантической угловой. Source: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Названный MultiFakeVerse, коллекция состоит из 845 826 изображений, сгенерированных через модели языка и зрения (VLMs), которые можно доступить онлайн и скачать, с разрешением.

Авторы утверждают:

‘Этот подход VLM позволяет семантическим, контекстно-осведомленным изменениям, таким как изменение действий, сцен и взаимодействия человека и объекта, а не синтетическим или низкоуровневым идентичным обменам и редактированием регионов, распространенным в существующих наборах данных.’

‘Наши эксперименты показывают, что текущие модели обнаружения deepfakes и человеческие наблюдатели испытывают трудности в обнаружении этих тонких, но значимых манипуляций.’

Исследователи протестировали как людей, так и ведущие системы обнаружения deepfakes на их новом наборе данных, чтобы увидеть, насколько хорошо эти тонкие манипуляции могли быть определены. Человеческие участники испытывали трудности, правильно классифицируя изображения как реальные или фальшивые только около 62% времени, и имели еще большую трудность в определении, какие части изображения были изменены.

Существующие детекторы deepfakes, обученные в основном на более очевидных наборах данных face-swapping или inpainting, работали плохо, часто не регистрируя, что какая-либо манипуляция произошла. Даже после тонкой настройки на MultiFakeVerse, показатели обнаружения оставались низкими, раскрывая, насколько плохо текущие системы справляются с этими тонкими, нарративно-ориентированными редактированиями.

Новая работа названа Multiverse Through Deepfakes: The MultiFakeVerse Dataset of Person-Centric Visual and Conceptual Manipulations, и исходит от пяти исследователей из Университета Монаш в Мельбурне и Университета Куртин в Перте. Код и связанные данные были выпущены на GitHub, в дополнение к хостингу Hugging Face, упомянутому ранее.

Метод

Набор данных MultiFakeVerse был построен из четырех реальных наборов изображений с людьми в различных ситуациях: EMOTIC; PISC, PIPA, и PIC 2.0. Начиная с 86 952 оригинальных изображений, исследователи произвели 758 041 манипулированную версию.

Gemini-2.0-Flash и ChatGPT-4o фреймворки были использованы для предложения шести минимальных редактирований для каждого изображения – редактирований, предназначенных для тонкого изменения того, как наиболее заметный человек на изображении будет восприниматься зрителем.

Модели были инструктированы генерировать изменения, которые сделали бы субъекта наивным, гордым, раскаивающимся, безопытным, или чтобы скорректировать некоторые фактические элементы внутри сцены. Вместе с каждым редактированием модели также произвели ссылающийся выражение, чтобы четко определить цель изменения, обеспечивая, чтобы последующий процесс редактирования мог применить изменения к правильному человеку или объекту в каждом изображении.

Авторы уточняют:

‘Обратите внимание, что ссылающийся выражение является широко исследованной областью в сообществе, которая означает фразу, которая может разъяснить цель в изображении, например, для изображения, имеющего двух мужчин, сидящих на столе, одного говорящего по телефону, а другого смотрящего на документы, подходящее ссылающееся выражение для последнего будет человек слева, держащий кусок бумаги.’

Как только редактирования были определены, фактическое манипулирование изображением было выполнено путем побуждения моделей языка и зрения применить указанные изменения, оставив остальную часть сцены нетронутой. Исследователи протестировали три системы для этой задачи: GPT-Image-1; Gemini-2.0-Flash-Image-Generation; и ICEdit.

После генерации двадцати двух тысяч образцов изображений Gemini-2.0-Flash вышел как наиболее последовательный метод, производящий редактирования, которые естественно вписываются в сцену без введения видимых артефактов; ICEdit часто производил более очевидные подделки, с заметными недостатками в измененных регионах; и GPT-Image-1 иногда влиял на непреднамеренные части изображения, частично из-за его соответствия фиксированным соотношениям выхода.

Анализ изображения

Каждое манипулированное изображение было сравнено с его оригиналом, чтобы определить, сколько изображения было изменено. Пиксельные различия между двумя версиями были рассчитаны, с небольшим случайным шумом, отфильтрованным для сосредоточения на значимых редактированиях. В некоторых изображениях только крошечные области были затронуты; в других до восьмидесяти процентов сцены было изменено.

Чтобы оценить, насколько смысл каждого изображения сместился в свете этих изменений, были сгенерированы подписи как для оригинальных, так и для манипулированных изображений, используя ShareGPT-4V модель языка и зрения.

Эти подписи были затем преобразованы в вложения, используя Long-CLIP, позволяя сравнить, насколько далеко содержание отклонилось между версиями. Наиболее сильные семантические изменения были видны в случаях, когда объекты рядом с или直接 связанные с человеком были изменены, поскольку эти небольшие корректировки могли существенно изменить, как изображение было интерпретировано.

Gemini-2.0-Flash был затем использован для классификации типа манипуляции, примененной к каждому изображению, на основе того, где и как редактирования были сделаны. Манипуляции были сгруппированы в три категории: редактирования на уровне человека включали изменения выражения лица, позы, взгляда, одежды или других личных особенностей; редактирования на уровне объекта повлияли на объекты, связанные с человеком, такие как объекты, которые они держали или взаимодействовали с в переднем плане; и редактирования на уровне сцены включали фоновые элементы или более широкие аспекты обстановки, которые не直接 включали человека.

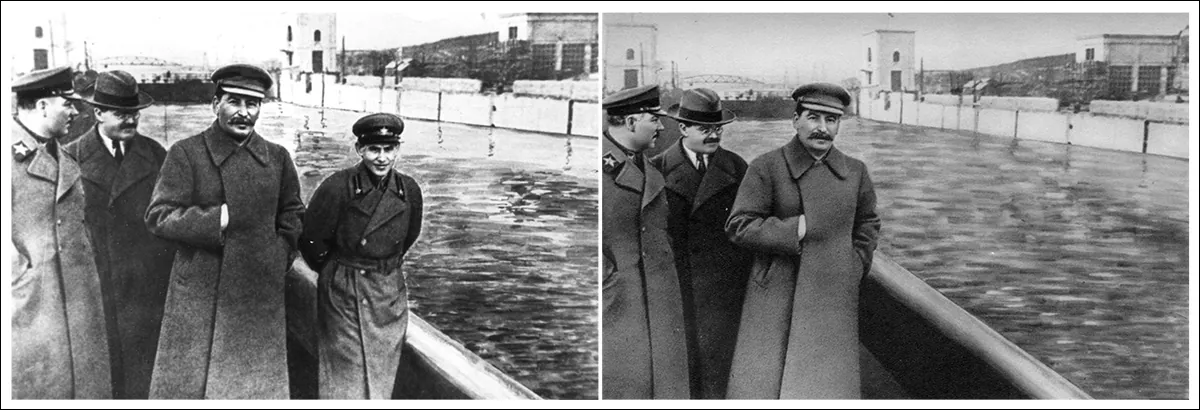

Конвейер генерации набора данных MultiFakeVerse начинается с реальных изображений, где модели языка и зрения предлагают нарративные редактирования, нацеленные на людей, объекты или сцены. Эти инструкции затем применяются моделями редактирования изображений. Правая панель показывает пропорцию редактирований на уровне человека, объекта и сцены в наборе данных. Source: https://arxiv.org/pdf/2506.00868

Поскольку отдельные изображения могли содержать несколько типов редактирований одновременно, распределение этих категорий было отображено на наборе данных. Приблизительно одна треть редактирований нацеливалась только на человека, около одной пятой повлияли только на сцену, и около одной шестой были ограничены объектами.

Оценка перцептивного воздействия

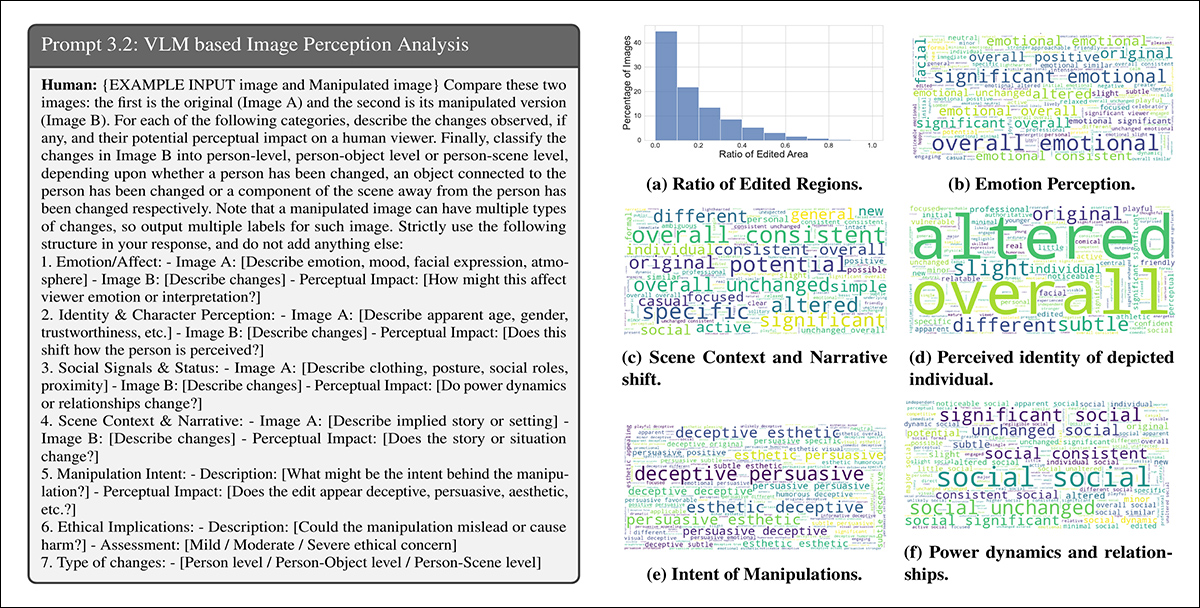

Gemini-2.0-Flash был использован для оценки того, как манипуляции могут изменить восприятие зрителя по шести областям: эмоция, личная идентичность, динамика власти, нарратив сцены, намерение манипуляции и этические проблемы.

Для эмоции редактирования часто описывались терминами, такими как радостный, занимательный или доступный, что предполагает сдвиги в том, как субъекты были эмоционально представлены. В нарративных терминах слова, такие как профессиональный или различный, указывали на изменения в подразумеваемой истории или обстановке:

Gemini-2.0-Flash был побужден оценить, как каждая манипуляция повлияла на шесть аспектов восприятия зрителя. Слева: пример структуры подсказки, направляющей оценку модели. Справа: облака слов, суммирующие сдвиги в эмоции, идентичности, нарративе сцены, намерении, динамике власти и этических проблемах в наборе данных.

Описания сдвигов идентичности включали термины, такие как молодой, игривый и уязвимый, показывая, как небольшие изменения могли повлиять на то, как люди воспринимались. Намерение за многими редактированиями было помечено как убедительный, обманчивый или эстетический. Хотя большинство редактирований было оценено как вызывающее только легкие этические проблемы, небольшая доля была признана несущей умеренные или серьезные этические последствия.

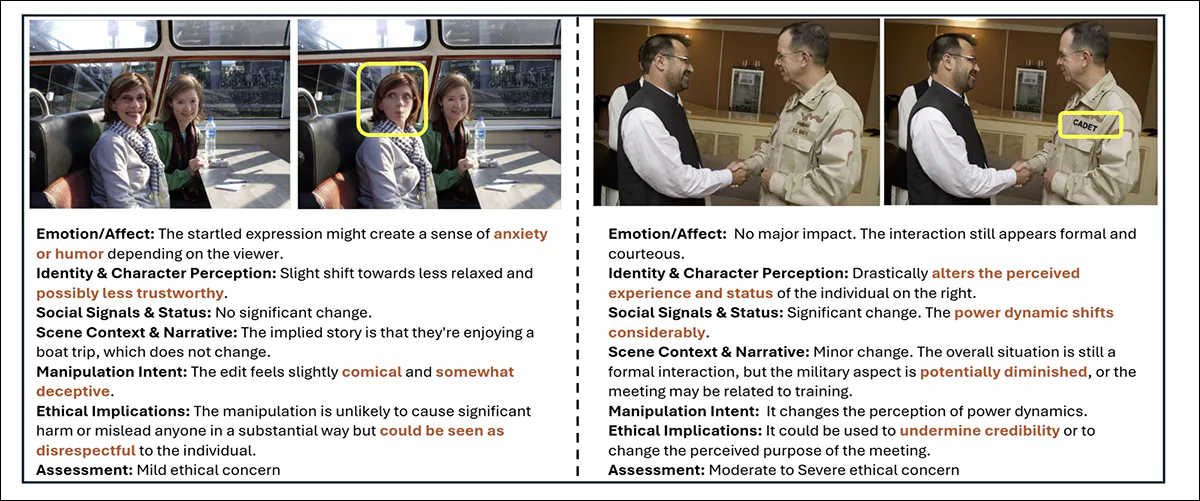

Примеры из MultiFakeVerse, показывающие, как небольшие редактирования меняют восприятие зрителя. Желтые коробки подчеркивают измененные регионы, с сопровождающим анализом изменений в эмоции, идентичности, нарративе и этических проблемах.

Метрики

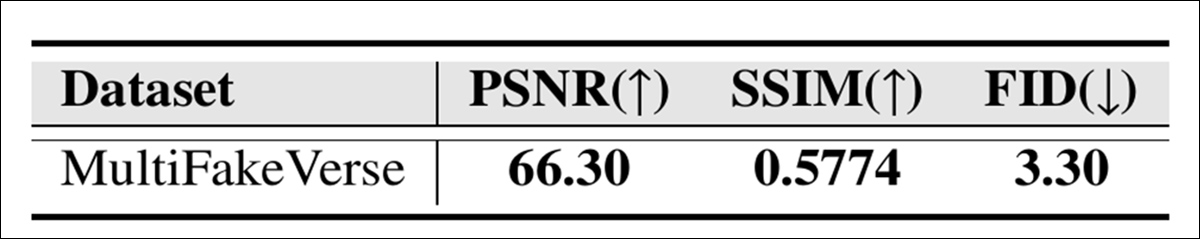

Визуальное качество коллекции MultiFakeVerse было оценено, используя три стандартные метрики: Пиковая отношение сигнала к шуму (PSNR); Индекс структурированного сходства (SSIM); и Расстояние Фрече-Инсепшн (FID):

Оценки качества изображения для MultiFakeVerse, измеренные по PSNR, SSIM и FID.

Оценка SSIM в 0,5774 отражает умеренную степень сходства, соответствующую цели сохранения большей части изображения при применении целевых редактирований; оценка FID в 3,30 предполагает, что сгенерированные изображения сохраняют высокое качество и разнообразие; и значение PSNR в 66,30 децибел указывает на то, что изображения сохраняют хорошую визуальную точность после манипулирования.

Исследование пользователя

Исследование пользователя было проведено, чтобы увидеть, насколько хорошо люди могут обнаружить тонкие фальшивки в MultiFakeVerse. Восемнадцать участников были показаны пятьдесят изображений, равномерно разделенных между реальными и манипулированными примерами, охватывающими диапазон типов редактирований. Каждый человек был попросил классифицировать, является ли изображение реальным или фальшивым, и, если фальшивым, определить, какой тип манипуляции был применен.

Общая точность для определения реального или фальшивого была 61,67 процента, что означает, что участники неправильно классифицировали изображения более одной трети времени.

Авторы утверждают:

‘Анализируя человеческие прогнозы уровня манипуляции для фальшивых изображений, среднее пересечение над объединением между прогнозируемыми и фактическими уровнями манипуляции было найдено равным 24,96%. ‘

‘Это показывает, что для человеческих наблюдателей не тривиально определить регионы манипулирования в нашем наборе данных.’

Создание набора данных MultiFakeVerse потребовало обширных вычислительных ресурсов: для генерации инструкций редактирования было сделано более 845 000 вызовов API к моделям Gemini и GPT, с этими задачами побуждения, стоившими около 1000 долларов; производство изображений на основе Gemini стоило примерно 2867 долларов; и генерация изображений, используя GPT-Image-1, стоила примерно 200 долларов. Изображения ICEdit были созданы локально на NVIDIA A6000 GPU, завершив задачу примерно за двадцать четыре часа.

Тесты

До тестов набор данных был разделен на обучающие, проверочные и тестовые наборы, сначала выбрав 70% реальных изображений для обучения; 10 процентов для проверки; и 20 процентов для тестирования. Манипулированные изображения, сгенерированные из каждого реального изображения, были назначены в тот же набор, что и их соответствующий оригинал.

Дополнительные примеры реального (слева) и измененного (справа) контента из набора данных.

Производительность по обнаружению фальшивок была измерена, используя точность на уровне изображения (определяет ли система правильно классифицирует все изображение как реальное или фальшивое) и баланс точности и полноты. Для локализации манипулированных регионов оценка использовала площадь под кривой (AUC), баланс точности и полноты и пересечение над объединением (IoU).

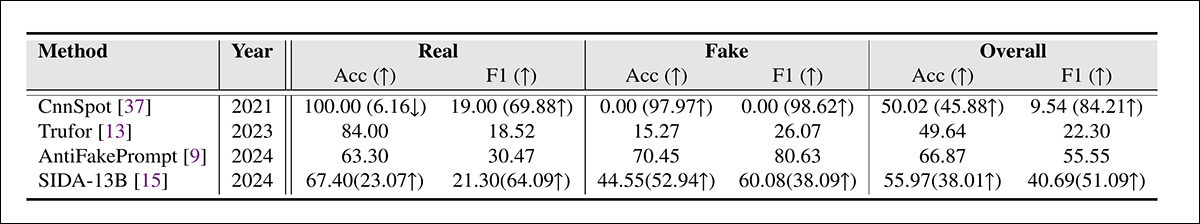

Набор данных MultiFakeVerse был использован против ведущих систем обнаружения deepfakes на полном тестовом наборе, с соперничающими фреймворками CnnSpot; AntifakePrompt; TruFor; и основанной на языке и изображении SIDA. Каждая модель была сначала оценена в zero-shot режиме, используя ее исходные предварительно обученные веса без дальнейшего регулирования.

Две модели, CnnSpot и SIDA, были затем тонко настроены на обучающих данных MultiFakeVerse, чтобы оценить, улучшает ли повторная тренировка производительность.

Результаты обнаружения deepfakes на MultiFakeVerse в zero-shot и тонко настроенных условиях. Числа в скобках показывают изменения после тонкой настройки.

Из этих результатов авторы утверждают:

‘[Модели] обученные на более ранних наборах данных inpainting-based фальшивок испытывают трудности в выявлении наших VLM-Editing-based подделок, в частности, CNNSpot склонен классифицировать почти все изображения как реальные. AntifakePrompt имеет лучшую zero-shot производительность с 66,87% средней классовой точности и 55,55% балансом точности и полноты. ‘

‘После тонкой настройки на нашем обучающем наборе мы наблюдаем улучшение производительности как в CNNSpot, так и в SIDA-13B, с CNNSpot, превосходящим SIDA-13B как в средней классовой точности (на 1,92%), так и в балансе точности и полноты (на 1,97%).’

SIDA-13B был оценен на MultiFakeVerse, чтобы измерить, насколько точно он может локализовать манипулированные регионы внутри каждого изображения.

В своем исходном состоянии он достиг пересечения над объединением в 13,10, баланса точности и полноты в 19,92 и AUC в 14,06, отражая слабую локализационную производительность.

После тонкой настройки оценки улучшились до 24,74 для пересечения над объединением, 39,40 для баланса точности и полноты и 37,53 для AUC. Однако даже с дополнительной тренировкой модель все еще испытывала трудности в определении точно, где были сделаны редактирования, подчеркивая, насколько трудно обнаружить эти виды небольших, целевых изменений.

Вывод

Новое исследование раскрывает слепое пятно как в человеческом, так и в машинном восприятии: хотя большая часть публичных дебатов вокруг deepfakes сосредоточена на сенсационных обменах идентичностью, эти более тихие ‘нарративные редактирования’ труднее обнаружить и потенциально более коррозивны в долгосрочной перспективе.

Когда системы, такие как ChatGPT и Gemini, принимают более активную роль в генерации этого рода контента, и когда мы сами увеличиваем участие в изменении реальности наших собственных потоков фотографий, модели обнаружения, которые полагаются на обнаружение грубых манипуляций, могут предложить недостаточную защиту.

Что демонстрирует MultiFakeVerse, так это не то, что обнаружение неудачно, а то, что хотя бы часть проблемы может сместиться в более трудную, медленнее движущуюся форму: одну, где небольшие визуальные ложь накапливаются незамеченными.

Опубликовано в первый раз в четверг, 5 июня 2025 года