Взгляд Anderson

Приносящий чувство запаха в разработку ИИ

Новый набор данных ИИ учит машины чувствовать запах, ассоциируя данные запаха с изображениями, позволяя моделям сопоставлять запахи с объектами, сценами и материалами.

Возможно, потому что машины с запаховыми выходами имеют такую запутанную историю, обоняние является довольно забытым чувством в литературе исследований ИИ. Если только вы не планировали производить еще одну запись в длинной серии (более века, на данный момент) саги запахо-видения, случаи использования всегда казались довольно «нишевыми» по сравнению с потенциальной эксплуатацией наборов изображений, аудио и видео, и моделей ИИ, обученных на них.

Фактически, возможность автоматизации, индустриализации и популяризации видов детектирования, предлагаемых собаками, обнаруживающими бомбы, собаками, обнаруживающими трупы, собаками, обнаруживающими заболевания и другими видами собачьих единиц обнаружения, будет заметной выгодой в муниципальных и службах безопасности. Несмотря на высокий спрос, далеко превосходит предложение, обучение и поддержка собак-детекторов – это дорогой бизнес, который не всегда предлагает хорошую стоимость за деньги.

До сих пор большинство исследований, которые заходят в эту область, были ограничены лабораторией, с отобранными коллекциями, обычно состоящими из примеров с手-crafted функциями – профиль, склонный больше к bespoke-решениям, чем к индустриализированным приложениям.

Впереди на нос

В эту довольно пыльную атмосферу приходит интересное новое академическое/промышленное сотрудничество из США, где команда исследователей провела несколько месяцев, каталогизируя разные запахи в помещениях и на улицах в Нью-Йорке – и, впервые, собирая изображения, связанные с захваченными запахами:

Обратите внимание на центральный датчик, «нос» прибора обоняния. Обученный только на запах, модель угадывает, является ли она запахом гранита, пластика или кожи – и даже определяет комнату, в которой она находится, не видя ни одного пикселя. Источник

Это исследование привело авторов новой работы к разработке варианта на огромной популярности Contrastive Language-Image Pretraining (CLIP)框架, который соединяет текст и изображения, в форме Contrastive Olfaction-Image Pretraining (COIP) – который соединяет запахи и изображения.

Вверху: синхронизированные видео- и запаховые данные захватываются в естественных условиях с помощью камеры-нос-прибора. Внизу слева (б): совместное внедрение обучается через само-надзор. (с): система извлекает визуальные совпадения на основе только запаха-запроса. (d): индивидуальные запаховые образцы используются для классификации категорий окружающей среды, объектов и материалов. (е): очень похожие запахи, такие как два типа травы, различаются без визуального ввода. Источник

Новый набор данных, озаглавленный New York Smells, содержит 7 000 пар запах-изображение, в которых представлены 3 500 разных объектов. Когда он был обучен в тестах, новые данные были найдены, чтобы превзойти популярные hand-crafted функции в относительно небольшом количестве подобных предыдущих наборов данных.

Авторы надеются, что их первое выступление откроет путь для последующих работ по системам обнаружения запахов, предназначенным для работы в дикой природе, так же, как собаки-детекторы*:

‘Мы рассматриваем этот набор данных как шаг к в-диких, многомодальных восприятиям обоняния, а также как шаг к связыванию зрения со запахом. Хотя обоняние традиционно подходило в ограниченных условиях, таких как контроль качества, есть много применений в естественных условиях.

‘Например, как люди, мы постоянно используем наше чувство запаха, чтобы оценить качество пищи, определить опасности и обнаружить незаметные объекты.

‘Кроме того, многие животные, такие как собаки, медведи и мыши, показывают сверхчеловеческие возможности обоняния, что предполагает, что человеческое восприятие запаха далеко от предела возможностей машин.’

Хотя новая работа, озаглавленная New York Smells: A Large Multimodal Dataset for Olfaction, обещает, что данные и код будут выпущены, 27ГБ файл данных уже доступен через сайт проекта. Работа была произведена девятью исследователями из Университета Колумбии, Университета Корнелла и Osmo Labs.

Метод

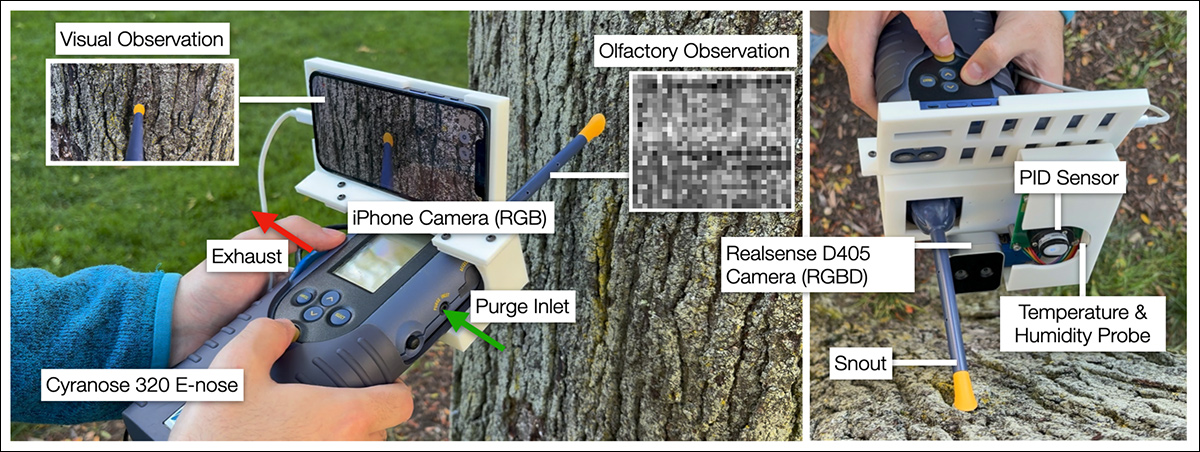

Чтобы собрать материал для нового сбора, исследователи использовали Cyranose 320 электронный нос, с iPhone, установленным над передним впуском, чтобы захватить визуально, какие запахи были зарегистрированы:

Портативный датчик собирает парные видео- и запаховые данные, устанавливая iPhone-камеру на Cyranose 320 электронный нос. Нос направлен на объекты, а выпуск и вход очистки управляют воздушным потоком во время выборки. RGB‑D камера захватывает глубину, а концентрация летучих органических соединений (VOC), температура и влажность регистрируются через интегрированные датчики, включая модуль пропорционально-интегрально-дифференциального (PID) и экологический зонд.

Устройство Cyranose работает на частоте 2 Гц, записывая 32-мерные шаги времени обоняния. Концентрации летучих органических соединений (VOC) записывались с помощью MiniPID2 PPM WR датчика.

Портативная единица функционировала как ловкий датчик, передавая данные на более вычислительную мобильную станцию для обработки.

Чтобы поставить целевой запах в контекст, «фоновый запах» был зарегистрирован, прежде чем более конкретный объект был нацелен直接 с «носом» Cyranose. Фоновый образец был затем взят из бокового порта в единице, чтобы обеспечить, что он был достаточно远 от основного источника запаха, чтобы не быть загрязненным.

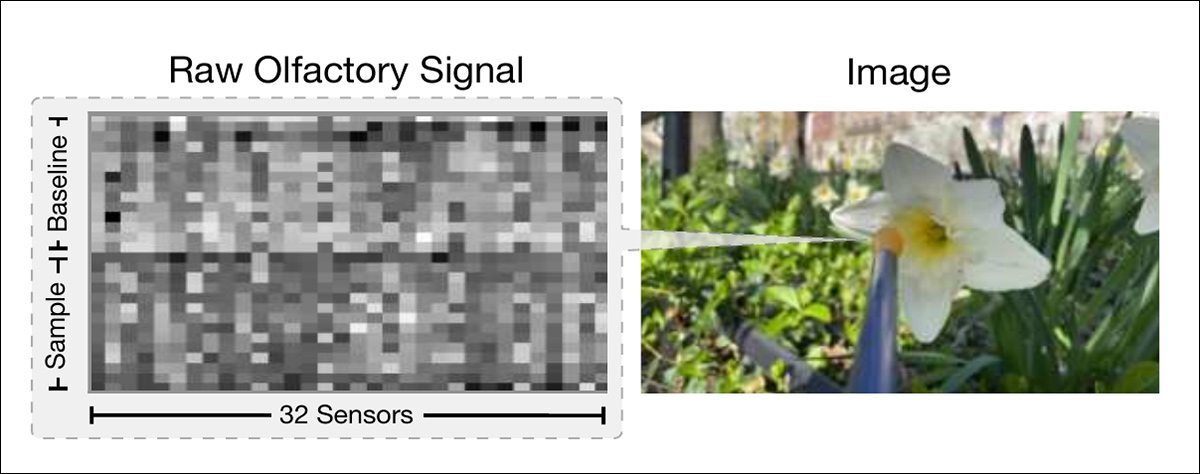

Два образца были взяты через основной впуск датчика, с каждым 10-секундным записом, захваченным из разных позиций вокруг объекта, чтобы улучшить эффективность данных. Образцы были затем объединены с фоновым базовым образцом, чтобы сформировать 28×32 матрицу, представляющую полное обонятельное измерение:

Этот пример показывает сигнал и соответствующее изображение для цветка. Полный обонятельный сигнал состоит из 28×32 матрицы, объединяющей 14-кадровый фоновый базовый образец с двумя 10-секундными образцами, взятыми из разных углов вокруг целевого объекта.

Данные и тесты

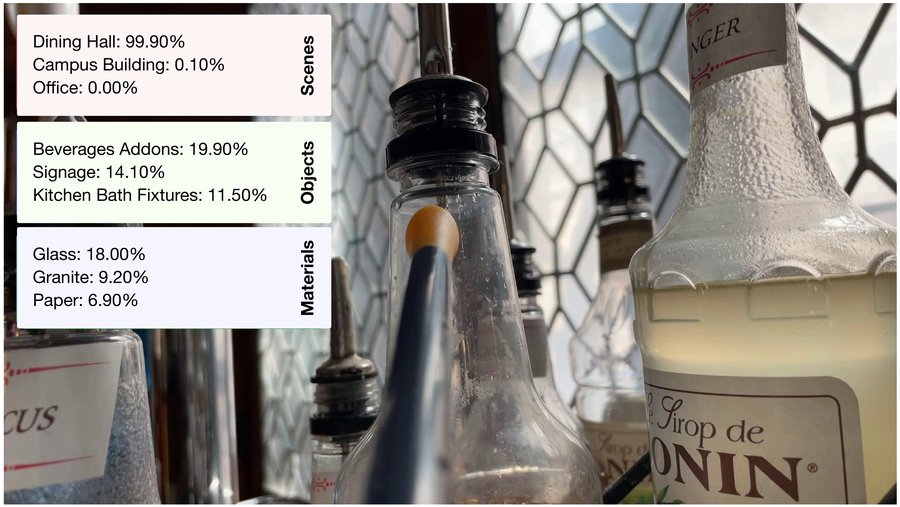

Модели языка и зрения (VLMs) были использованы для автоматического пометки объектов и материалов, захваченных iPhone в Cyranose-приборе, с GPT-4o, использованным для этой задачи; однако, категории сцен были вручную помечены:

Маленький образец из обширной иллюстрации в исходной работе, детализирующей разнообразные источники запахов и среды, захваченные в проекте.

Набор данных был разделен на обучающие и проверочные разделы, с обоими образцами из каждого объекта, назначенными одному и тому же разделу, чтобы избежать перекрестного загрязнения. Окончательная коллекция состоит из 7 000 ольфакторно-видовых пар, полученных из 3 500 не помеченных объектов, а также 70 часов видео и 196 000 шагов времени сырых ольфакторных данных из обоих фоновых и выборочных фаз.

Данные были собраны в течение 60 сессий в течение двухмесячного периода, охватывающего парки, университетские здания, офисы, улицы, библиотеки, квартиры и столовые, с несколькими сессиями, проведенными в каждом месте. Результатом является набор данных, содержащий 41% уличных и 59% внутренних сред.

Чтобы разработать общие представления обоняния, авторы обучили контрастную модель, чтобы ассоциировать синхронизированные изображение-запах пары из набора данных. Этот подход, вышеупомянутый COIP, использует функцию потерь, адаптированную из CLIP, чтобы выровнять внедрения совпадающих визуальных и ольфакторных сигналов.

Обучение использовало как визуальный кодировщик, так и запаховый кодировщик, с целью обучения модели bringen совпадающие запахи и изображения ближе вместе в общем представительном пространстве. Результатом являются представления, которые поддерживают ряд последующих задач, включая извлечение запаха-изображения, распознавание сцен и объектов, классификацию материалов и тонкую дискриминацию запахов.

Модель была обучена с использованием двух типов ольфакторных входных данных: полного сырого сигнала датчика и сокращенного hand-crafted резюме, известного как смеллпринты – широко используемые функции в исследованиях обоняния, которые сжимают каждый ответ датчика в одно число, сравнивая пиковое сопротивление во время выборки с средним сопротивлением во время фонового базового образца.

Напротив, сырые входные данные, записанные по всему Нью-Йорку, состоят из временного ряда из 32 химических датчиков внутри устройства Cyranose, захватывающих, как каждый датчик изменяет свое электрическое сопротивление во времени, реагируя на запах.

Для кураторства набора данных этот необработанный сигнал был подан直接 в нейронную сеть, позволяя обучать конец в конец с помощью либо свёрточной или трансформер-основанной основы. Модели были обучены с помощью как смеллпринтов, так и сырых входных данных, собранных из различных сред в Нью-Йорке, с обоими типами входных данных, оцененными с помощью контрастного обучения.

Перекрестное извлечение

Перекрестное извлечение было оценено путем внедрения каждого запахового образца и его парного изображения в общее представительное пространство и тестирования, может ли быть извлечено правильное изображение на основе только ольфакторного входа.

Ранжирование определялось близостью каждого изображения внедрения к запросу запаха в этом пространстве, и производительность измерялась с помощью среднего ранга, медианы ранга и воспоминания на нескольких порогах:

Точность перекрестного извлечения для разных запаховых кодировщиков, показывающая, насколько хорошо каждая модель определяет правильное изображение из запроса запаха. Результаты сравнивают архитектуры, обученные на сырых ольфакторных сигналах, с теми, которые используют смеллпринты.

Что касается этих результатов, авторы заявляют:

‘Контрастное предварительное обучение, использующее смеллпринт, работает лучше, чем случайно, во всех метриках. Однако обучение ольфакторного кодировщика на сыром ольфакторном сигнале приводит к значительному улучшению по сравнению с кодировщиком смеллпринта, независимо от архитектуры.

‘Это показывает более богатую информацию, присутствующую в сырых ольфакторных данных, открывая более сильные перекрестные ассоциации между зрением и запахом.’

Деталь из седьмой иллюстрации в исходной работе, которая слишком сжата, чтобы воспроизвести осмысленно здесь. Здесь примеры перекрестного извлечения, показывающие, как модель связывает запахи с соответствующими изображениями. Каждый ряд начинается с запроса запаха, за которым следуют лучшие прогнозируемые изображения в общем пространстве внедрения. Правильное изображение для каждого запроса очерчено зеленым, иллюстрируя, как запахи от книг, растений, каменной кладки и других материалов притягивают модель к визуально и семантически связанным сценам.

Авторы также отметили, что результаты извлечения показали четкие семантические закономерности:

‘Извлечения из нашей модели часто показывают семантические группировки. Запах книги извлекает изображения других книг, запах листьев извлекает изображения листвы.

‘Эти результаты предполагают, что обученное представление захватывает осмысленную перекрестную структуру.’

Распознавание сцен, объектов и материалов

Способность модели распознавать запахи без визуального входа была оценена путем обучения ее определять сцены, объекты и материалы на основе только ольфакторных данных; для этого была использована линейная зонда (простой классификатор, обученный на замороженных представлениях), чтобы оценить, сколько информации было закодировано в обученных запаховых внедрениях.

Метки были получены из парных изображений в обучающем наборе с помощью GPT-4o – но только ольфакторный сигнал был использован во время классификации.

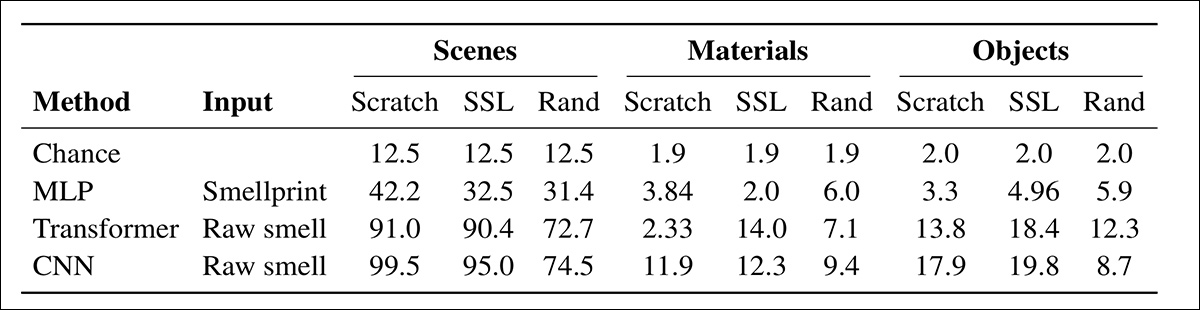

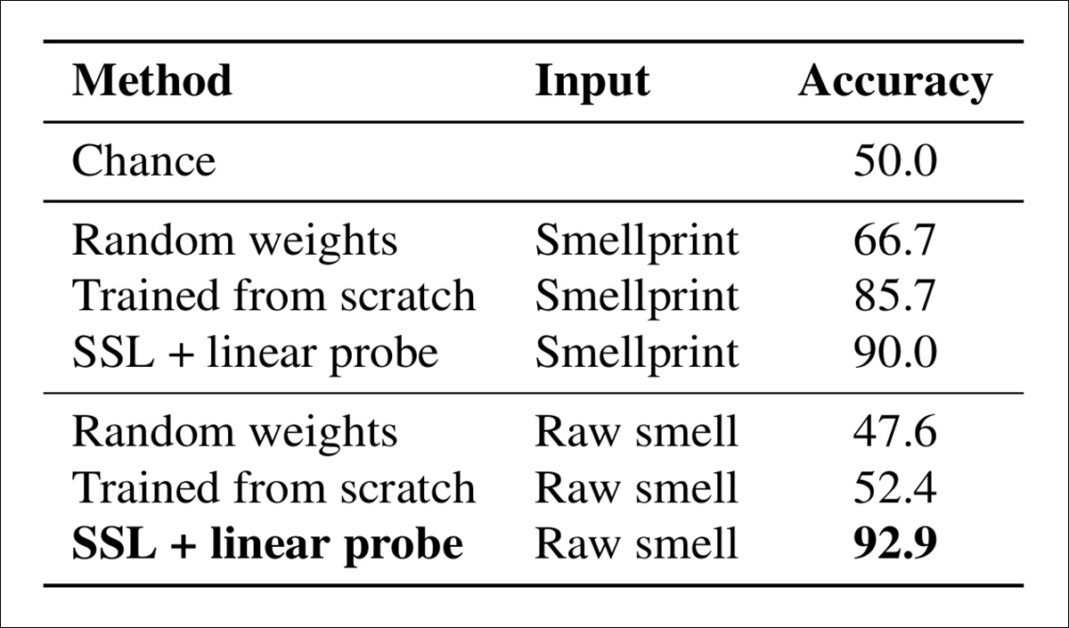

Несколько типов кодировщиков были протестированы: некоторые были инициализированы случайно, некоторые были обучены с нуля, а другие были обучены с помощью контрастного обучения, чтобы выровнять запах и зрение в общем представительном пространстве, с сырыми данными и смеллпринтами, оцененными:

Точность классификации для сцен, материалов и объектов была оценена с помощью только ольфакторных сигналов. Сырые входные данные превосходили смеллпринты, с CNN, обученными с нуля, которые давали наилучшие результаты, включая 99,5% для сцен. Само-надзорное обучение помогло в некоторых случаях, но в целом было превзойдено обучением с учителем. Случайные весовые базовые линии указывают на то, что емкость модели сама по себе оказывается недостаточной.

Значительно более высокая точность была получена, когда использовались сырые ольфакторные данные, особенно в моделях, обученных с помощью контрастного надзора. Авторы комментируют**:

‘Модели, обученные на сырых сенсорных входных данных, также достигают более высокой точности, чем модели, обученные с помощью hand-crafted смеллпринт-функций. Эти результаты показывают, что глубокое обучение из сырых ольфакторных сигналов значительно лучше, чем hand-crafted функции.’

Тонкая дискриминация

Чтобы оценить, могут ли быть выучены тонкие различия запахов, был построен эталон из двух видов трав, сосуществующих на одной университетской лужайке. Чередующиеся образцы были собраны в течение шести 30-минутных сессий, в результате чего было получено 256 примеров. Линейный классификатор был обучен на функциях из ольфакторно-видового контрастного обучения и оценен на отдельном наборе из 42 образцов:

Точность классификации видов трав по одному запаху. Модели были оценены на их способность различать два визуально похожих типа трав, используя только ольфакторный вход. Производительность была сравнена через смеллпринты и сырые сенсорные данные, с моделями, либо случайно инициализированными, либо обученными с нуля, либо обученными с помощью само-надзорного обучения (SSL), за которым следовал линейный зонд. Наивысшая точность, 92,9%, была достигнута с помощью сырых ольфакторных сигналов и SSL, указывая на то, что тонкие различия запахов лучше всего захватываются через сырые входные данные и обучение, руководимое зрением.

Здесь исследователи заявляют:

‘Обучение на сыром ольфакторном сигнале (вместо hand-crafted функций) дает наилучшую точность – превосходящую все варианты, основанные на смеллпринтах.

‘Эти результаты предполагают, что ольфакторно-видовое обучение сохраняет более тонкую информацию, чем обучение со смеллпринтами, и что визуальное руководство обеспечивает сигнал для использования этой информации.’

Заключение

Хотя синтез запахов, кажется, останется нерешенной проблемой в ближайшем будущем, эффективная и доступная в-диких система анализа запахов имеет огромный потенциал, не только для полицейских, служб безопасности и медицинских целей, но и для мониторинга качества жизни и городов.

На данный момент оборудование, участвующее в этом процессе, является нишевым и обычно довольно дорогим; поэтому реальный прогресс в «ольфакторном ИИ» для обнаружения, вероятно, потребует дальновидного и доступного датчика в духе Raspberry PI.

* Мое преобразование внутренних цитат авторов в гиперссылки.

** Пожалуйста, обратите внимание, что дальнейшие иллюстрации (фигура 8) доступны в исходной работе, но лучше всего просматривать их в этом контексте.

Опубликовано впервые в пятницу, 28 ноября 2025 года