Искусственный интеллект

Язык, сгенерированный ИИ, начинает загрязнять научную литературу

Исследователи из Франции и России опубликовали исследование, указывающее на то, что использование вероятностных текстовых генераторов на основе ИИ, таких как GPT-3, вводит ‘истязаемый язык’, цитаты несуществующей литературы и ад-хок, неавторизованное повторное использование изображений в ранее уважаемых каналах для публикации новой научной литературы.

Возможно, наиболее тревожно то, что изучаемые статьи также содержат научно неточные или ненадежные данные, представленные как результат объективных и систематических исследований, указывая на то, что генеративные языковые модели используются не только для улучшения ограниченных навыков английского языка авторов статей, но и фактически для выполнения сложной работы (и, неизбежно, для ее плохого выполнения).

Отчет отчет, озаглавленный Истязанные фразы: сомнительный стиль письма, возникающий в науке, был составлен исследователями из кафедры компьютерных наук Университета Тулузы и исследователем Yandex Александр Магазинов, в настоящее время в Тель-Авивском университете.

Исследование фокусируется в частности на росте бессмысленных научных публикаций, сгенерированных ИИ, в журнале Elsevier Микропроцессоры и микросистемы.

Под любым другим названием

Авторегрессивные языковые модели, такие как GPT-3, обучаются на больших объемах данных и предназначены для парафразирования, суммирования, сборки и интерпретации этих данных в когерентные генеративные языковые модели, которые способны воспроизводить естественные речевые и письменные модели, сохраняя при этом исходную цель обучающих данных.

Поскольку такие рамки часто наказываются на этапе обучения модели за прямое и ‘неабсорбированное’ воспроизведение исходных данных, они неизбежно ищут синонимы – даже для хорошо установленных фраз.

Очевидно, что научные статьи, созданные с помощью ИИ, обнаруженные исследователями, включают необычайное количество неудачных попыток творческих синонимов для известных фраз в секторе машинного обучения:

Глубокая нейронная сеть: ‘глубокая нейронная организация’

Искусственная нейронная сеть: ‘(фальшивая | поддельная) нейронная организация’

Мобильная сеть: ‘универсальная организация’

Атака на сеть: ‘организация (засада | нападение)’

Соединение сети: ‘организация ассоциация’

Большие данные: ‘(огромные | огромные | огромные | колоссальные) данные’

Хранилище данных: ‘информация (склад | распределительный центр)’

Искусственный интеллект (ИИ): ‘(фальшивый | созданный человеком) сознание’

Высокопроизводительные вычисления: ‘элитные вычисления’

Облачные вычисления: ‘туманные вычисления’

Графический процессор (GPU): ‘устройство подготовки дизайна’

Центральный процессор (CPU): ‘фокальный подготовительный блок’

Двигатель рабочего процесса: ‘двигатель рабочего процесса’

Распознавание лиц: ‘распознавание лица’

Распознавание голоса: ‘распознавание речи’

Среднеквадратическая ошибка: ‘среднеквадратическая (ошибка | промах)’

Средняя абсолютная ошибка: ‘средняя (полная | верховная) (ошибка | промах)’

Отношение сигнала к шуму: ‘(движение | флаг | индикатор | знак | сигнал) к (шуму | суматохе)’

Глобальные параметры: ‘глобальные параметры’

Случайный доступ: ‘(случайный | нерегулярный) доступ’

Случайный лес: ‘(случайный | нерегулярный) (лес | лесной массив | густой район)’

Случайное значение: ‘(случайное | нерегулярное) значение’

Колония муравьев: ‘подземная насекомая (государство | провинция | область | регион | поселение)’

Колония муравьев: ‘подземный ползучий (государство | провинция | область | регион | поселение)’

Оставшаяся энергия: ‘оставшаяся энергия’

Кинетическая энергия: ‘двигательная энергия’

Наивный Байес: ‘(доверчивый | невинный | наивный) Байес’

Личный цифровой помощник (PDA): ‘индивидуальный компьютерный помощник’

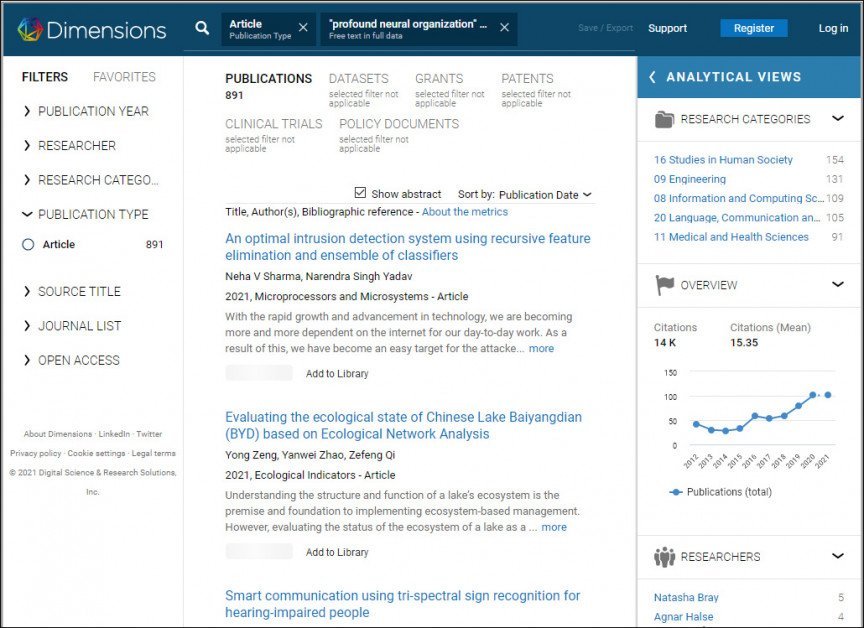

В мае 2021 года исследователи запросили Dimensions академический поисковый движок в поисках такого искаженного, автоматизированного языка, принимая меры для исключения законных фраз, таких как ‘огромные данные’ (которая является действительной фразой и не является неудачной заменой для ‘больших данных’). В этот момент они обнаружили, что Микропроцессоры и микросистемы имели наибольшее количество случаев неправильного парафразирования.

На данный момент все еще можно получить (архивный снимок, 15/07/2021) ряд научных статей для бессмысленной фразы ‘глубокая нейронная организация’ (т.е. ‘глубокая нейронная сеть’), и другие в вышеуказанном списке дают аналогичные результаты.

Результаты поиска для ‘глубокой нейронной организации’ (‘глубокой нейронной сети’) в Dimensions. Источник: https://app.dimensions.ai/

Журнал Микропроцессоры был основан в 1976 году и переименован в Микропроцессоры и микросистемы два года спустя.

Рост бессмысленного языка

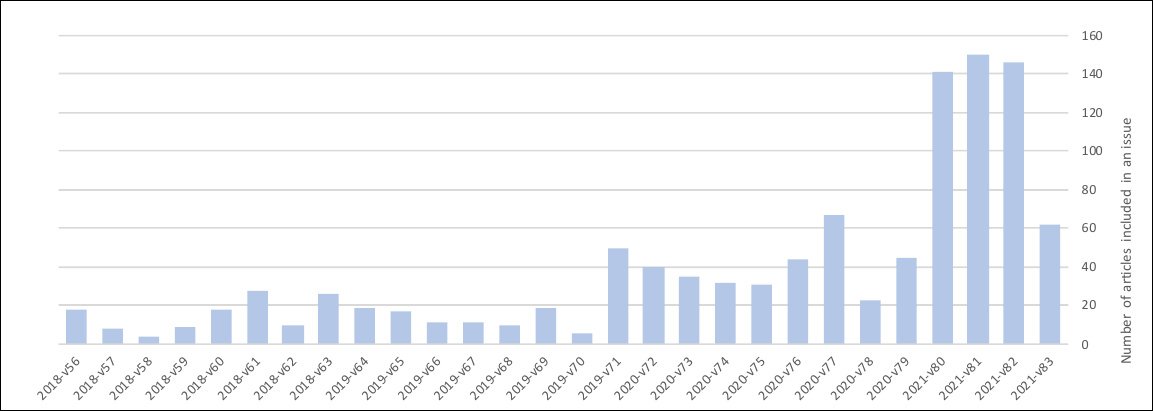

Исследователи изучали период, охватывающий февраль 2018 года по июнь 2021 года, и обнаружили резкий рост объема заявок за последние два года, и особенно за последние 6-8 месяцев:

Корреляция или причинно-следственная связь? Рост заявок в журнал Микропроцессоры и микросистемы, кажется, совпадает с ростом ‘бессмысленного’ текста и синонимов в apparentemente уважаемых заявках. Источник: https://arxiv.org/pdf/2107.06751.pdf

Окончательный набор данных, собранный сотрудниками, содержит 1 078 полных статей, полученных через подписку Elsevier Университета Тулузы.

Уменьшение редакторского надзора для китайских научных статей

В статье отмечается, что период времени, выделенный для редакторской оценки помеченных заявок, радикально сократился в 2021 году, снизившись до менее 40 дней; шестикратное уменьшение стандартного времени для рецензирования, очевидного с февраля 2021 года.

Большинство помеченных статей происходят от авторов с аффилиацией к материковой части Китая: из 404 статей, принятых менее чем за 30 дней, 97,5% связаны с Китаем. Напротив, в случаях, когда процесс редактирования превышал 40 дней (615 статей), китайские аффилированные заявки представляли только 9,5% этой категории – десятикратный дисбаланс.

Отчет приписывает проникновение помеченных статей пробелам в редакторском процессе и возможному отсутствию ресурсов перед лицом растущего числа заявок.

Исследователи предполагают, что модели генерации языка в стиле GPT, и подобные типы языковых генеративных рамок, были использованы для создания большей части текста в помеченных статьях; однако, способ, которым генеративная модель абстрагирует свои источники, делает это трудным для доказательства, и главными доказательствами является общесмысловая оценка плохих и ненужных синонимов, и тщательное изучение логической последовательности заявки.

Исследователи также отмечают, что генеративные языковые модели, которые, по их мнению, способствуют этому потоку бессмысленных статей, способны не только создавать проблемные тексты, но и распознавать их и флагировать систематически, так же, как исследователи сами выполнили это вручную. Работа подробно описывает такое внедрение, используя GPT-2, и предлагает рамки для будущих систем для выявления проблемных научных заявок.

Случай ‘загрязненных’ заявок намного выше в журнале Elsevier (72,1%) по сравнению с другими изученными журналами (13,6% максимум).

Не только семантика

Исследователи подчеркивают, что многие из этих статей не только используют неправильный язык, но и содержат научно неточные утверждения, указывающие на возможность того, что генеративные языковые модели не только используются для улучшения ограниченных языковых навыков участвующих ученых, но могут фактически использоваться для формулирования, по крайней мере, некоторых основных теорем и данных в статье.

В других случаях исследователи полагают эффективную ‘пересинтез’ или ‘переворачивание’ абстрагированной (и лучшей) предыдущей работы, чтобы удовлетворить давлению ‘публиковать или погибать’ академических исследовательских культур, и, возможно, чтобы улучшить национальные рейтинги для глобального превосходства в исследованиях ИИ, посредством чистого объема.

Бессмысленный контент в представленной статье. В этом случае исследователи обнаружили, что текст был получен ad hoc из статьи EDN, откуда иллюстрация также была взята без указания источника. Переписывание исходного контента было настолько радикальным, что сделало его бессмысленным.

Анализируя несколько представленных статей в журнале Elsevier, исследователи обнаружили предложения, для которых им не удалось сделать какие-либо выводы; ссылки на несуществующую литературу; ссылки на переменные и теоремы в формулах, которые не фактически появлялись в поддерживающем материале (что предполагает языковую абстракцию или ‘галлюцинацию’ казалось бы фактических данных); и повторное использование изображений без признания их источников (что исследователи критикуют не с точки зрения авторского права, а скорее как индикатор недостаточной научной строгости).

Неудачи цитирования

Цитаты, предназначенные для поддержки аргументов в научной статье, были обнаружены во многих из помеченных примеров как ‘или сломанные, или ведущие к не связанным публикациям’.

Кроме того, ссылки на ‘связанную работу’ часто включают авторов, которых исследователи считают ‘галлюцинированными’ системой GPT-стиля.

Блуждающее внимание

Другим недостатком даже самых передовых языковых моделей, таких как GPT-3, является их тенденция терять фокус в течение длительного дискурса. Исследователи обнаружили, что помеченные статьи часто поднимают тему в начале статьи, которая фактически никогда не возвращается после того, как она впервые упоминается в предварительных заметках или в другом месте.

Они также теоретизируют, что некоторые из худших примеров возникают через множественные путешествия исходного текста через серию переводческих двигателей, каждый из которых искажает смысл дальше.

Источники и причины

Пытаясь понять, что стоит за этим явлением, авторы статьи предлагают несколько возможностей: что контент из фабрик статей используется в качестве исходного материала, вводя неточности очень рано в процессе, который неизбежно произведет дальнейшие неточности; что инструменты для вращения статей, такие как Spinbot, используются для маскировки плагиата; и что подавляющее давление, чтобы регулярно публиковаться, приводит недостаточно обеспеченных исследователей к использованию систем в стиле GPT-3 для либо дополнения, либо полного создания новых академических статей.

Исследователи заканчивают призывом к действию для большего надзора и улучшения стандартов в области академической публикации, которая, по-видимому, становится пищей для своей собственной темы – систем машинного обучения. Они также призывают Elsevier и других издателей ввести более строгие процедуры проверки и рецензирования, и широко критикуют текущие стандарты и практики в этом отношении, предлагая, что ‘Обман с синтетическими текстами угрожает целостности научной литературы.’