Unghiul lui Anderson

Încercarea virtuală a hainelor noi prin intermediul IA

Un model de IA poate transforma acum o singură fotografie și imagini cu haine într-un videoclip mișcător al unei persoane care poartă ținute noi, evitând glitch-urile comune din sistemele mai vechi, cu două etape.

Categoría ‘încercării virtuale’ (VTON) în cercetarea viziunii computaționale este printre cele mai bine finanțate și mai prolifice din literatură – în principal pentru că, așa cum se poate desprinde din colaborările frecvente între industrie și academie publicate în fiecare an, acest obiectiv primește o finanțare semnificativă din partea industriei modei bine dotate:

Din lucrarea ‘Image-Based Virtual Try-On: A Survey’, exemple de tipuri de reprezentare a persoanei și unele dintre etapele de filtrare și rafinare pe care chiar și imaginile de bază trebuie să le parcurgă pentru o încercare virtuală (VTON). Sursă

Există multe variante ale obiectivului, cum ar fi extragerea hainelor din imagini cu oameni și adaptarea siluetei mai complete atunci când este necesar. Unele sisteme bazate pe imagini au fost implementate comercial, pe platforme precum veesual.ai, wanna.fashion și fashn.ai.

Pentru video, aplicația experimentală Doppl a lui Google Labs a experimentat cu această funcționalitate, lansând anul trecut:

Vă rugăm să faceți clic pentru a reda dacă videoclipul nu se redă automat. Excerpte din proiectul abandonat de încercare virtuală video Doppl. Sursă

Cu toate acestea, Doppl se închide în aprilie 2026, după o primire rezervată, iar acum utilizatorii sunt redirecționați către serviciul de încercare virtuală doar pe imagini al companiei †:

Programul de încercare virtuală doar pe imagini al Google, unde utilizatorii sunt redirecționați de pe platforma abandonată Doppl. Sursă

Deși există un număr mic de platforme care oferă încercare virtuală cu video, niciuna dintre ele nu pare a fi afiliată cu un magazin real; și toate sunt produse ‘de ultimă oră’, marginale (și adesea ‘îndoielnice’) care promovează tokenuri.

Deși există o serie de incursiuni interesante din sectorul cercetării, acestea sunt, în mod tradițional, arhitecturi complexe care sunt greu de implementat pentru latență scăzută și calitate ridicată:

Vă rugăm să faceți clic pentru a reda dacă videoclipul nu se redă automat. Din proiectul Fashion-VDM din 2024, un exemplu de transfer de haine ‘fără cap’. Sursă

Adevărul este că sarcina de a face hainele să se conformeze unei persoane reale, fără a distorsiona hainele sau persoana, menținând în același timp o mișcare demonstrativă utilă (care arată cu exactitate spatele produsului atunci când persoana își întoarce spatele), este o provocare formidabilă pentru stadiul actual al tehnologiei.

Vanast

Este o provocare la care un nou articol din Coreea încearcă să răspundă, utilizând o soluție integrată și complet nouă pentru analiza hainelor + persoanei + mișcării:

Vă rugăm să faceți clic pentru a reda dacă videoclipul nu se redă automat. Exemple din site-ul de materiale suplimentare pentru proiectul Vanast. Sursă

Noul sistem, intitulat Vanast, utilizează un set de date personalizat care include încorporarea și orchestrarea tuturor celor trei factori necesari pentru a realiza sarcina: hainele; persoana; și mișcarea:

Faceți clic pentru a reda. Mai multe exemple de pe site-ul proiectului Vanast.

Sistemul utilizează cadre diverse, cum ar fi Flux, Qwen și ChatGPT, pentru a genera un set de date ‘triplet’ capabil să informeze o arhitectură de la capăt la capăt:

Din noua lucrare, exemple de puncte de date din setul de date utilizat pentru generare și antrenare. Sursă –

Noua lucrare, intitulată Vanast: Încercare virtuală cu animație de imagine umană prin supraveghere triplet sintetică, provine de la patru cercetători de la Universitatea Națională din Seoul. Există, de asemenea, un site al proiectului plin de videoclipuri.

Metodă

Obiectivul declarat al autorilor în lucrare este de a combina cele trei aspecte menționate anterior într-un cadru într-o singură etapă – nu numai pentru că procesul ar fi discret, ci și pentru că oferă diverselor aspecte mai multe oportunități de a se împleti și de a interacționa în timpul antrenării, cu scopul de a obține o generare mai coerentă:

Vanast combină o singură fotografie a unei persoane, imagini separate de haine și o referință de mișcare pentru a genera o secvență de mișcare în care aceeași persoană poartă ținuta nouă, cu îndrumarea poziției care asigură o mișcare consistentă, în timp ce identitatea și detaliile hainelor sunt păstrate pe parcursul cadrelor.

Pentru a realiza acest lucru, sistemul ia imagini cu articolele de îmbrăcăminte țintă; o fotografie a persoanei care poartă haine diferite; un videoclip de referință de mișcare care definește cum ar trebui să se miște persoana; și un prompt de text care descrie acțiunea și setarea; și produce o secvență de videoclip completă în care aceeași persoană pare să poarte ținuta nouă, urmând mișcarea impusă, cu fiecare cadru păstrat vizual consistent în timp.

În loc să separe îmbrăcarea și animația în etape separate – ceea ce a fost abordarea în majoritatea lucrărilor similare anterioare – Vanast gestionează îmbrăcămintea, identitatea și mișcarea împreună într-un singur proces, permițând acestor elemente să interacționeze în timpul generării și reducând tipurile de necorespondențe și instabilități evidențiate în metodele anterioare.

Set de date

Antrenarea pentru proiect se bazează pe exemple pereche de imagine a unei persoane, articolele de îmbrăcăminte corespunzătoare și un videoclip al persoanei care se mișcă purtând aceste haine, cu mișcarea extrasă utilizând o arhitectură anterioară, pentru a oferi o îndrumare stabilă a poziției pe parcursul cadrelor.

În absența unui set de date public disponibil care să îndeplinească cerințele proiectului, datele au fost extrase de pe platforme de shopping online (nespecificate), oferind un depozit de videoclipuri cu îmbrăcăminte diversă. Cu toate acestea, sarcina a necesitat videoclipuri cu aceeași persoană purtând mai multe ținute, ceea ce este o găsire rară în datele din sălbăticie, și care a necesitat crearea datelor sintetice.

Procesul în trei etape a implicat selectarea cadrului candidat potrivit din videoclipurile extrase, gestionat prin modelul de limbaj și viziune Qwen2.5-VL, cu tăiere și evaluare adecvată a potrivirii (de exemplu, fără occluzii, subiectul în poziție corectă etc.); și crearea unor măști de inpainting adecvate pentru a izola zonele afectate – care (în conformitate cu lucrarea anterioară PERSE) este gestionat de modelul de difuzie SDXL venerabil.

Prezentare generală a pipeline-ului Vanast, unde o imagine a unei persoane, imagini cu haine și un videoclip de îndrumare a mișcării sunt codificate și procesate într-un model de difuzie video unificat. Sistemul generează o animație care păstrează identitatea, urmează secvența poziției și aplică hainele țintă, în timp ce generarea tripletului sintetic susține antrenarea, iar proiectarea cu două module separă animația de transferul hainelor, pentru a menține coerența.

În a treia etapă, Qwen își reia îndatorirea pentru a clasifica imaginile după gen, iar cadrul de difuzie a imaginilor Flux popular este utilizat apoi pentru a crea modificări ale îmbrăcămintei într-o imagine (deoarece Flux este capabil să combine multiple elemente de intrare). Prompturile de text de inpainting au fost curate de ChatGPT (versiune nespecificată).

Pentru a crește și mai mult diversitatea poziției și a fundalului, a fost introdus un pipeline pentru a construi tripleți de antrenare din videoclipuri din sălbăticie, utilizând setul de date HumanVid. Același proces a fost utilizat pentru a genera imaginea umană care păstrează identitatea.

Deoarece nu a existat o imagine de sine stătătoare a hainelor în aceste videoclipuri, imaginile cu haine au fost sintetizate direct din film. Cadrele au fost eșantionate din fiecare videoclip, iar Qwen a fost utilizat pentru a le evalua pentru vizibilitatea frontală, înainte de a selecta candidatul cel mai potrivit, pe baza vizibilității întregului corp, clarității imaginii, a minimizării occluziei, calității iluminatului și a compoziției generale.

O regiune de îmbrăcăminte superioară a fost extrasă utilizând SegFormer, iar fundalul a fost eliminat pentru a izola haina.

Pentru a evita polarizarea pozițională, regiunea hainei a fost deplasată aleatoriu în cutia sa de delimitare, iar Qwen a fost utilizat din nou pentru a filtra segmentările nerelevante. Acest proces a produs imagini sintetice cu haine asociate cu mișcarea și identitatea, permițând construirea tripletului pe scară largă din datele video nestructurate, îmbunătățind robustețea în condiții variate din lumea reală.

Arhitectură

A fost introdusă o arhitectură cu două module pentru a aborda convergența lentă și echilibrul slab de control observat în acele metode anterioare care au încercat să fuzioneze toate condițiile. Abordarea a utilizat transformatorul de difuzie video text-to-video de la Wan, și s-a bazat și pe proiectul VACE (a se vedea mai jos).

Modelul a fost împărțit într-un Modul de animație umană (HAM), care a gestionat mișcarea și identitatea de la intrările umane și poziționale; și un Modul de transfer haine (GTM), care a gestionat îmbrăcămintea de la imaginile cu haine. Ambele au avut acces la coloană vertebră, integrând caracteristici într-un mod distribuit și cascada, pentru a îmbunătăți condiționarea.

Antrenarea a fost realizată prin înghețarea coloanei vertebrale și optimizarea doar a parametrilor HAM și GTM, cu contribuțiile lor echilibrate în timpul integrării caracteristicii. Intrările din setul de date triplet sintetic au fost convertite în reprezentări latente utilizând autoencoderul variabil WAN.

Contextul conștient de mișcare a fost construit prin combinarea informațiilor umane și a poziției în timp, în timp ce caracteristicile hainelor au fost procesate separat și aliniate prin proiectarea în încorporări de token.

Modelul a fost extins și pentru a susține interpolarea hainelor. Aici, reprezentările a două haine au fost combinate pentru a genera tranziții netede, permițând o amestecare coerentă și consistentă între articolele de îmbrăcăminte, fără optimizare suplimentară.

Date și teste

Modelul a fost antrenat pe 9.135 de videoclipuri, cu lungimi variind de la trei la zece secunde, provenite de la site-urile de shopping menționate anterior; setul de date generat de autori; și setul de date HumanVid.

Din acestea, au fost stabilite două seturi de date de evaluare: ‘setul de date de internet’, care prezintă videoclipuri și imagini cu produse de la magazine; și divizarea oficială de test a setului de date ViViD de la Alibaba.

Deoarece datele ViViD lipsesc fețele (a se vedea videoclipul de mai sus, pentru un exemplu al acestuia, care este foarte comun în literatura de încercare virtuală), acestea au fost adăugate prin împăierea cu Flux.

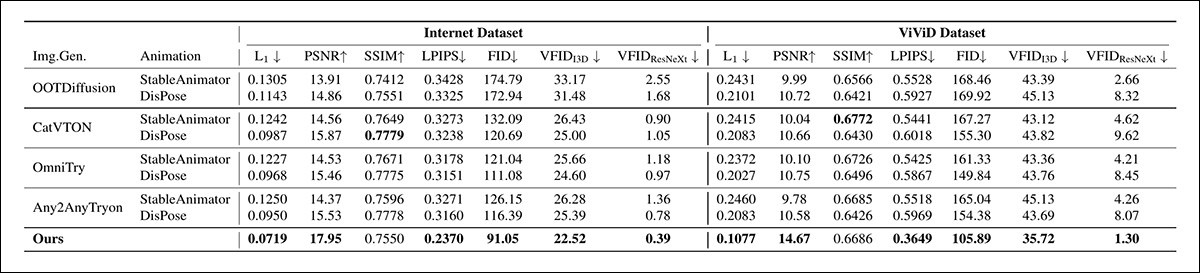

Metricele utilizate au fost pierderea L1; Raportul de semnal la zgomot de vârf (PSNR); Indexul de similaritate structurală (SSIM); Asemănarea perceptuală a patch-urilor de imagine învățate (LPIPS); Distanța Fréchet de intrare (FID); și Distanța video Fréchet†† (FVD)

Sistemele testate pentru transferul hainelor au fost OOTDiffusion; CatVTON; OmniTry; și Any2AnyTryon. Modelele de generare imagine-persoană testate au fost VisualCloze; MOSAIC; și UNO de la ByteDance.

Pentru a doua etapă de animație a imaginii umane, au fost utilizate cadrele StableAnimator și DisPose.

Într-un context mai limitat (deoarece nu susține direct obiectivul), VACE a fost testat și el, cu o anumită încercare de a echilibra funcționalitatea lipsă:

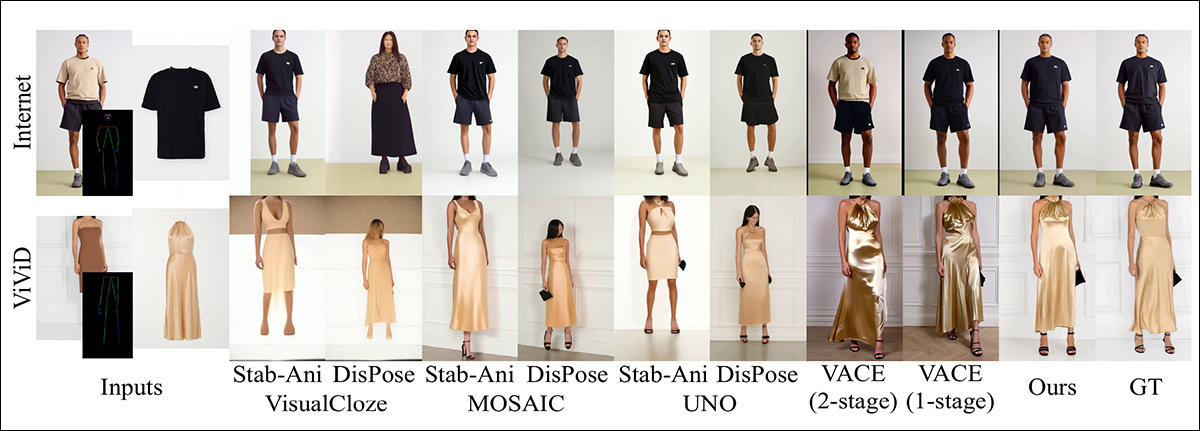

Comparație cantitativă împotriva combinațiilor de modele de generare imagine-persoană și animație pe seturile de date de internet și ViViD, unde metoda propusă a obținut cea mai bună performanță în toate metricele raportate. Valorile îngroșate indică cel mai bun scor în fiecare coloană.

Dintre rezultatele inițiale prezentate mai sus, autorii afirmă:

‘[Modelul nostru] obține cea mai bună performanță în toate metricele atunci când este comparat cu combinațiile de modele de generare imagine-persoană și animație.

‘Rezultatele calitative [prezentate mai jos] confirmă, de asemenea, că abordarea noastră produce cea mai precisă urmărire a poziției și transfer de haine, păstrând identitatea într-un mod mai fidel decât toate liniile de bază bazate pe imagine-persoană.’

Comparație calitativă pe seturile de date de internet și ViViD împotriva liniilor de bază imagine-persoană și animație, unde metoda propusă, susțin autorii, oferă o aliniere a poziției și un transfer de haine mai precis, păstrând identitatea într-un mod mai consecvent decât VisualCloze, MOSAIC, UNO și VACE.

Pentru a doua categorie de teste, în care au fost testate combinații de încercări virtuale pe imagini și modele de animație, noua lucrare a reușit din nou să obțină cel mai bun scor:

Comparație cantitativă cu combinațiile de modele de încercare virtuală pe imagini și animație pe seturile de date de internet și ViViD. Metoda propusă a obținut cea mai bună performanță generală în toate metricele, cu SSIM rămânând comparabil cu cea mai puternică linie de bază. Valorile îngroșate denotă cel mai bun scor.

Autorii adaugă:

‘Comparațiile calitative [prezentate mai jos] demonstrează că rezultatele noastre se aseamănă cel mai mult cu imaginea reală dintre toate liniile de bază bazate pe încercarea virtuală pe imagini.’

Teste calitative utilizând liniile de bază create prin combinarea modelelor VTON cu modelele de animație.

Concluzie

Deși proiectul Vanast realizează o soluție de capăt la capăt discretă, lipsa de detalii din lucrare cu privire la cerințele de resurse pentru antrenare și inferență indică faptul că aceasta nu ar putea fi cea mai agilă sau mai ușoară soluție. În realitate, provocarea în sine este extrem de dificilă de realizat, chiar și într-un sistem neoptimizat – și cu atât mai mult într-o implementare comercială care ar necesita latență scăzută și rentabilitate la scară..

Încercarea virtuală este unul dintre obiectivele ‘lunare’ ale inteligenței artificiale, unde stadiul actual al tehnologiei, așa cum este difuzat prin diverse titluri și rezultate selectate, ascunde dificultatea reală a sarcinii, care, poate, în cele din urmă va fi rezolvată de tehnologii ulterioare și mai ușoare decât Transformatorii.

† Disponibil în SUA, blocat în multe alte regiuni, dacă nu în toate.

†† Autorii fac referire la ‘VFID’, dar link-ul duce doar la lucrarea ViViD, care nu justifică referința, după cum pot să văd, cu timp limitat pentru a o urmări. Am presupus că, de fapt, au vrut să spună Distanța video Fréchet (FVD), și au fost la fel de grăbiți. Vă rog să-mi trimiteți modificările, după cum este necesar.

Publicat pentru prima dată miercuri, 8 aprilie 2026