Unghiul lui Anderson

Utilizarea ‘Probabilității’ ca Metrică de Detectare a Deepfake-urilor

Dacă videourile și sunetele generate de IA devin suficient de bune, detectoarele de deepfake bazate pe artefacte vizuale sau alte semnale tradiționale nu vor mai funcționa. Dar, având în vedere cât de rar oamenii se abat de la comportamentul previzibil, poate ‘probabilitatea’ ar putea fi adoptată mai profund ca semnal al faptului că un videoclip sau o știră este probabil să fie adevărată.

Opinie La începutul anilor ’90, respectatul fost fotbalist britanic și comentator sportiv TV David Icke a dezvăluit într-un show de talk că el este ‘fiul lui Dumnezeu’ – o revelație ciudată și neașteptată care se va dezvolta în următorii ani într-o teorie a conspirației persistente și elaborată despre o cabală globală secretă și puternică de ‘oameni-lizard’.

Cu adoptarea internetului încă în următorii ani și cu apariția rețelelor sociale și mai departe în viitor, disonanța dintre celebritatea lui Icke și natura noilor sale insight-uri a avut un impact profund asupra publicului britanic – nu în ultimul rând din cauza lipsei complete de context sau a oricărui fel de pregătire pentru această schimbare masivă, de la o personalitate sportivă cunoscută și bine stabilită.

Mai mult de douăzeci de ani mai târziu, o tensiune similară și mult mai întunecată a acestui șoc societal a apărut, când iubitul activist pentru caritate și prezentator de televiziune pentru copii Jimmy Savile a fost găsit postum a fi un agresor sexual serial și rapace care și-a folosit imaginea publică pentru a facilita crimele sale.

Următoarea investigație a poliției Operation Yewtree a descoperit mulți alți celebriți britanici cu istoric de infracțiuni sexuale; mai târziu, urmărirea penală a lui Harvey Weinstein a condus la o descoperire similară a agresorilor sexuali celebri în SUA, evoluând în mișcarea #metoo și devenind permanent parte a culturii americane în evenimente precum The Morning Show. Știrile ‘șoc’ păreau să dezvolte un nou și abrupt șablon – unul care în cele din urmă va fi adoptat de atacatorii de deepfake.

Sfârșitul detectării ‘tradiționale’ de deepfake?

Chiar dacă rețelele sociale și IA ar fi existat în anii ’90, niciun sistem predictiv din lume nu ar fi putut prevedea revelațiile lui Icke de la show-ul de talk, care (așa cum îmi amintesc) nu au fost în niciun fel prezise în anii care au precedat evenimentul.

Dar, dacă IA ar fi existat, ar fi putut dura ceva timp pentru a convinge o audiență mai largă că declarațiile lui Icke nu au fost produsul Google Veo 3, sau a unei altei generații de cadre audio/video deepfake hiper-reale.

Abia în ultimii 6-12 luni, metodele de deepfake ale IA au devenit suficient de eficiente pentru a îndeplini ani de profeții media despre interferența deepfake în alegeri și capabile să genereze felul de atacuri rapide la reputație care sunt false, dar greu de șters într-o cultură din ce în ce mai credulă.

Până în prezent, ieșirile video ale IA sunt în general limitate de obstacole tehnice și din ce în ce mai polarizate de o prăpastie tot mai largă între modelele restrictive occidentale și lansările deschise și necenzurate ale Chinei**.

Cu toate acestea, observ din ce în ce mai mult în literatura de cercetare o concesie iminentă a acestui război rece, de exemplu în noul articol Decăderea performanței în detectarea deepfake-urilor†:

‘[Noi] presupunem că videourile deepfake vor continua să conțină caracteristici învățabile de mașini care le diferențiază în mod fiabil de videourile autentice. Pe măsură ce capacitățile IA generative continuă să avanseze rapid, această presupunere se poate rupe.

‘Într-un astfel de scenariu, marcarea cu apă și alte metode de urmărire a provenienței vor oferi singura soluție pentru menținerea încrederii în mass-media digitală.’

Cu toate acestea, același articol recunoaște că soluțiile bazate pe proveniență, cum ar fi Inițiativa de Autenticitate a Conținutului condusă de Adobe (și multe alte oferte mai mici de cercetare din ultimii 7-8 ani) necesită o adoptare atât de largă încât să fie nerealistă; și articolul se încheie cu o notă generală de retragere, dacă nu de înfrângere.

Dacă metodele de detectare a deepfake-urilor audio-vizuale sunt depășite de IA generativă, și adoptarea globală a unui sistem de marcă sau de urmărire a provenienței cade în fața obstacolelor logistice diverse, ce trăsătură comună centrală ar putea înlocui acestea ca indicatori ai ieșirilor potențial falsificate? Sau trebuie să ne rezumăm la o lume în care toate mass-media sunt în dubiu, și Dividendul Mincinosului prevalează?

Grafuri de cunoaștere

Pare să fie timpul să valorificăm mai profund probabilitatea și plauzibilitatea ‘evenimentelor raportate’ ca o caracteristică semnal în detectarea deepfake-urilor. Mai mult, deoarece sistemele de IA generative audio/video sunt din ce în ce mai convergente, poate că este timpul ca firele de cercetare separate ale ‘știrilor false’ (ca eveniment narativ bazat pe text) și ale imaginilor/video false să convergeze și ele.

O probabilitate ca metrică de deepfake nu este același lucru cu RAG-ajutat de verificarea faptelor, unde un model de IA poate aduce rezultate web actuale pentru a obține cunoștințe despre evenimente care au loc după data sa de închidere, și/sau pentru a-și corobora afirmațiile.

Mai degrabă, ar efectua predicții bazate pe tendințe statistice generale, derivate din modele istorice care se conformează unei anchete actuale.

În acest sens, o metodă bazată pe probabilitate este mai aproape de analiza statistică decât de abordările mai moderne din scena actuală de învățare automată.

Deși anterior eclipsate de abordări mai moderne din era Transformer, grafurile de cunoaștere par să facă o revenire în spațiul întreprinderilor și par adaptate pentru o posibilă implementare a metricilor ‘probabilității’ în detectarea deepfake-urilor.

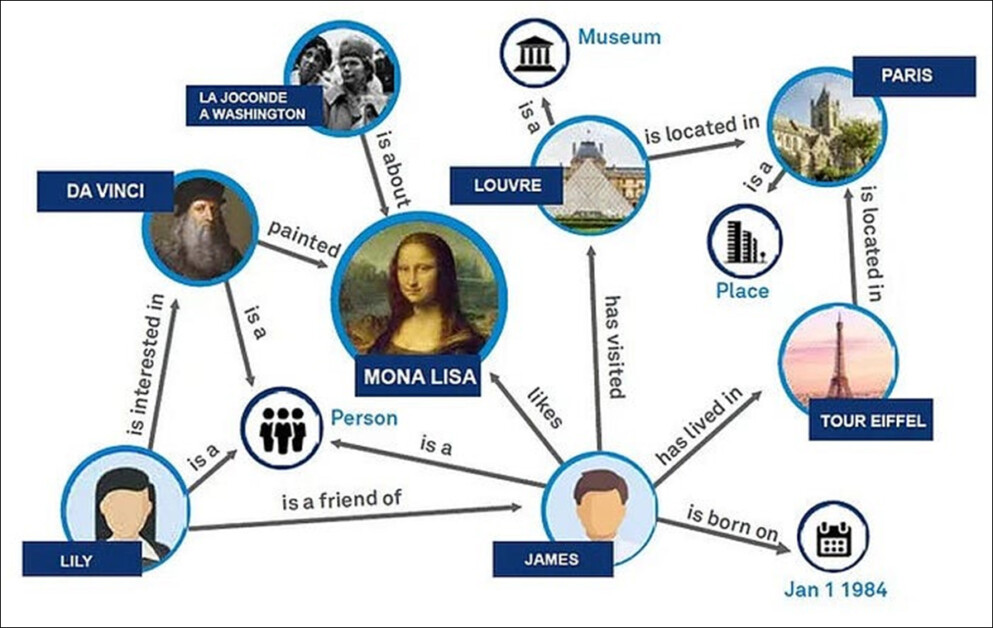

Un graf de cunoaștere simplificat care ilustrează modul în care oamenii, locurile, operele de artă și evenimentele pot fi legate prin relații etichetate, permițând mașinilor să raționeze asupra entităților și conexiunilor din lumea reală. Sursă

Un graf de cunoaștere este o modalitate de organizare a informațiilor prin maparea obiectelor din lumea reală, cum ar fi oameni, companii, evenimente sau idei, într-o rețea de fapte conectate.

Fiecare sub-entitate este un nod, iar legăturile dintre ele (muchii) descriu modul în care se relaționează. De exemplu, ‘Microsoft’ (un nod) ar putea fi legat de ‘OpenAI’ (alt nod) printr-un muchie care spune ‘este client al’. Aceste conexiuni sunt adesea stocate în baze de date grafice și urmează o structură subiect-predicat-obiect, cum ar fi ‘Microsoft este client al OpenAI’.

Memorie persistentă

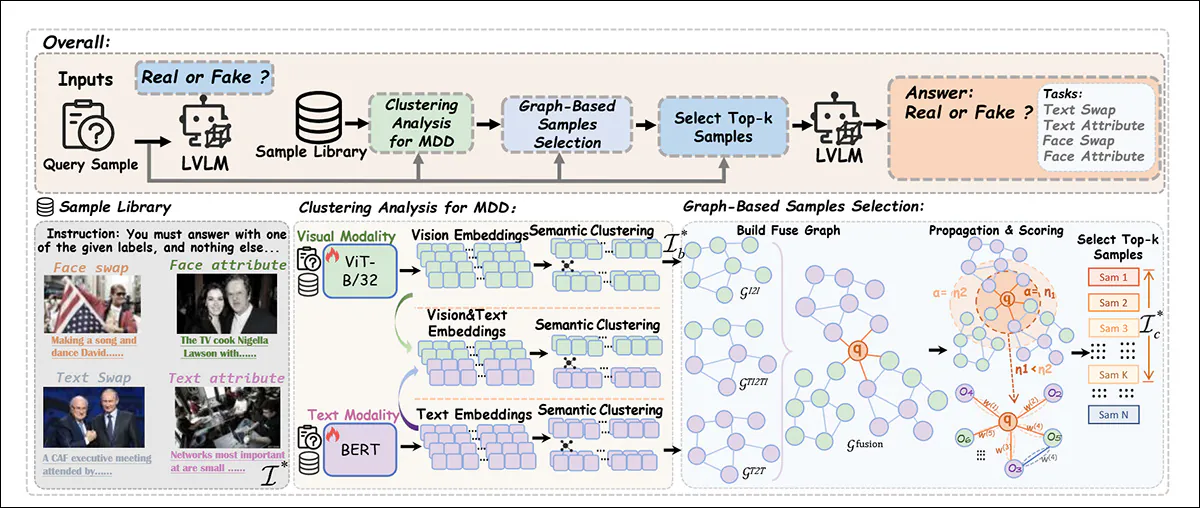

Un studiu chinez din septembrie al acestui an a propus o metodă fără antrenare care utilizează raționamentul grafic pentru a detecta inconsistențe subtile în deepfake-urile multimodale.

În loc de a genera raționamente sau a ajusta modele mari, sistemul recuperează perechi imagine-text, construiește un graf de similaritate și punctează conexiunile, pentru a recupera exemplele cele mai relevante, și acestea conduc judecata modelului fără a necesita antrenare nouă:

O prezentare generală a cadru GASP-ICL, care îmbunătățește detectarea deepfake-urilor prin combinarea selecției de mostre bazate pe graf cu învățarea în context, permițând un model de vedere-limbaj înghețat să clasifice perechi imagine/text ca reale sau false, fără antrenare sau ajustare. Source

Acesta este probabil cel mai apropiat lucru, cel puțin care mi-a trecut pe sub mână, de o abordare ‘informată’ și conștientă de istorie pentru evaluarea și verificarea noilor ieșiri media.

Pentru cea mai mare parte, abordările de vedere a computerului continuă să analizeze imagini (inclusiv cadre de videoclipuri și anomalii temporale care cuprind multiple cadre) în timp ce cadrele de detectare a ‘știrilor false’ continuă să pună accentul pe datele bazate pe text, chiar și în proiectele multimodale.

Creșterea caracteristicilor

Provocarea unui sistem predictiv de acest fel este amploarea supravegherii care poate fi necesară pentru a face abordarea pe deplin performantă – cel puțin dincolo de analiza celebrităților și a personalităților publice, pentru care datele accesibile gratuit deja există.

Probabil cel mai similar curent de cercetare actual este domeniul pre-crime, care etichetează diverse semnale de inteligență multimodală ca ‘suspecte’, și se prezintă ca un sperietoare de IA în evenimente precum Person of Interest (2011-2016) și Minority Report (2002).

În timp ce un sistem de supraveghere Person of Interest-style ar produce rezultate optime, este puțin probabil ca cultura occidentală să poată sancționa nivelul de intruziune personală pe care rețelele interne ale Chinei le impun cetățenilor săi.

Prin urmare, în ceea ce privește știrile false despre non-celebrități, doar agențiile guvernamentale, cum ar fi poliția (precum și registrele de nașteri și decese și birourile de taxe) ar avea suficiente informații istorice pertinente pentru a informa probabilitățile într-un flux de lucru bazat pe graf; și chiar și ei ar avea nevoie de voință, capacitate, legislație și resurse de tip CCCP pentru a include cetățeni obișnuiți în acoperirea și analizele lor (adică, dincolo de punctele de date banale dar obligatorii, cum ar fi numerele de pașaport și înmatriculare a vehiculelor).

Scorarea probabilității

Pare probabil că eficacitatea potențială a unui sistem de acest fel ar fi limitată la cele mai evidente (actuale) cazuri de utilizare pentru conținutul deepfake: destabilizare (deepfake-urile sprijinite de stat); deepfake-uri de pornografie cu celebrități și ‘necunoscute’ (care pot fi ambele considerate malefice, deși al doilea caz tinde să atragă o preocupare mai profundă a mass-mediei); fraudă (inclusiv deepfake-uri audio/video concepute pentru a efectua ‘jafuri de impersonare’); și asasinatul de caracter politic.

Un sistem bazat pe cunoaștere ar necesita o scară de probabilități pentru o diversitate de evenimente posibile. La un capăt al spectrului, defecte umane comune, cum ar fi managementul financiar discutabil, infidelitate, dependență, indiscreție etc.; la celălalt capăt… dezvăluirea faptului că eşti fiul lui Dumnezeu la un show de talk live (sau evenimente de o asemenea scară și impact).

Chiar și în ultimul caz, factorii istorici personali pentru orice individ ar cântări rezultatul probabilității: o figură politică proeminentă care a echivocat public în chestiuni controversate (cum ar fi veracitatea aterizărilor lunare din anii ’60/’70) pentru a câștiga capital cu un electorat din ce în ce mai ‘alternativ’-informat, ar putea obține statut suplimentar de carte de joc în rutinele de verificare, comparativ cu colegii lor mai modești.

În cazul deepfake-urilor de pornografie cu celebrități, există un context real din lume (adică scurgerile de fotografii cu celebrități din 2012, printre alte incidente – destul de rare) pentru a genera un dividend moderat al mincinosului, în anumite contexte; dar deoarece aceste incidente deosebite tind să funcționeze ca excepții care demonstrează regula, majoritatea deepfake-urilor de pornografie cu celebrități actuale ar fi considerate extrem de ‘improbabile’ (deși acest lucru nu rezolvă problema furtului de identitate pentru astfel de scopuri).

În ceea ce privește perturbarea națională, există o bogăție considerabilă de date statistice care pot ajuta la evaluarea probabilităților ‘raportărilor dezastruoase’. Chiar și în istoria antică, evenimente aparent ‘din senin’ precum erupția vulcanului nidentificat Vesuvius în 79 d.Hr. au fost prezise, dacă ai fi dat suficientă atenție; și, pe lângă disponibilitatea unei game de fluxuri guvernamentale și ONG, capacitatea IA de a extrage structura din datele brute poate oferi context istoric suplimentar pentru scorarea probabilității.

Concluzie

Chiar și un sistem predictiv bine implementat de acest fel nu ar putea să țină cont de șansa aleatorie, actele lui Dumnezeu, evenimentele ciudate sau de evenimentele malefice concepute departe de orice supraveghere.

Mai mult, volumul și profunzimea datelor necesare pentru a oferi acoperire și pentru persoane necunoscute ar fi un punct de dispută politică – cel puțin, pentru moment.

Cu toate acestea, alegerile par să se îngusteze; analiza vizuală este pe punctul de a eșua în fața IA generative îmbunătățite, în timp ce schemele de verificare și de urmărire a provenienței poartă o povară împovărătoare de datorie tehnică și de frecare împotriva adoptării. Acest lucru face soluții precum Inițiativa de Autenticitate a Conținutului și sistemul de copyrightare a feței Metaphysic Pro dificile de popularizat.

În utilizarea lor cea mai largă, sistemele RAG pot determina doar dacă o sursă de autoritate susține o pretenție neverificată; și, deoarece multe știri mari și adevărate (știri) apar fără context anterior, lipsa de susținere din partea surselor de autoritate nu este neapărat semnificativă.

Valoarea lor poate dovedi mai mare dacă pot face parte dintr-un ecosistem de date mai larg preocupat de singurul lucru cu care IA se confruntă – contextul istoric.

* Nu trebuie confundat cu primele autoencoder care au debutat în 2017 și care vor fi înlocuite în cele din urmă de abordări superioare.

† https://arxiv.org/abs/2511.07009

** Care pot rula în general liber pe calculatoare personale mai puternice, în loc să fie disponibile doar prin API-uri controlate, cum ar fi ChatGPT și seria Veo.

††† Omitând utilizările legitime de divertisment, cum ar fi efectele vizuale profesionale în producțiile de film și televiziune.

Publicat pentru prima dată joi, 13 noiembrie 2025