Etică

Baza de date a incidentelor AI are ca scop crearea unor algoritmi AI mai siguri

Orice sistem suficient de mare va avea erori, iar corectarea acestor erori presupune existența unei baze de date cu erorile respective, care poate fi analizată pentru a evalua impactul și cauzele potențiale. La fel ca FDA, care menține o bază de date pentru reacții adverse la medicamente, sau Consiliul Național pentru Siguranța Transporturilor, care menține o bază de date pentru accidente aviatice, baza de date a incidentelor AI este o bază de date destinată să catalogheze defecțiunile sistemelor AI și să ajute cercetătorii AI să proiecteze noi metode pentru a evita aceste defecțiuni. Creatorii bazei de date a incidentelor AI (AIID) speră că aceasta va ajuta companiile de AI să dezvolte sisteme AI mai sigure și mai etice.

Ce este AIID?

AIID este produsul organizației Partnership on AI (PAI). PAI a fost fondată inițial în 2016 de membri ai echipelor de cercetare AI de la companii tehnologice mari, cum ar fi Facebook, Apple, Amazon, Google, IBM și Microsoft. De atunci, organizația a recrutat membri de la multe alte organizații, inclusiv organizații non-profit. În 2018, PAI a început să creeze un standard de clasificare consistent pentru defecțiunile AI. Cu toate acestea, nu exista o colecție de incidente AI pe baza căreia să se poată stabili acest standard de clasificare. Din acest motiv, PAI a creat AIID.

Conform TechTalks, formatul AIID a fost inspirat de structura bazei de date a accidentelor aviatice întreținută de Consiliul Național pentru Siguranța Transporturilor. De la începerea colectării rapoartelor în 1996, sistemul de transport aerian comercial a reușit să crească siguranța industriei aviatice prin arhivarea și analiza incidentelor. Speranța este că un depozit similar de incidente AI poate face sistemele AI mai sigure, mai etice și mai fiabile. AIID a luat și inspirație de la baza de date a vulnerabilităților și expunerilor comune, care este un depozit de defecțiuni software notabile care acoperă o varietate de industrii și discipline diferite.

Sean McGregor este consultantul tehnic principal la IBM pentru Watson AI XPRIZE. McGregor este, de asemenea, responsabil pentru supravegherea dezvoltării bazei de date AIID. McGregor a explicat că scopul final al AIID este să prevină sistemele AI să cauzeze prejudicii sau, cel puțin, să reducă gravitatea incidentelor adverse. Așa cum a remarcat McGregor, sistemele de învățare automată sunt substanțial mai complexe și imprevizibile decât sistemele software tradiționale, și, ca urmare, nu pot fi testate în același mod ca și alte software. Sistemele de învățare automată pot schimba comportamentul în moduri neașteptate. McGregor notează că capacitatea sistemelor de învățare profundă de a învăța poate însemna “defecțiuni mai probabile, mai complicate și mai periculoase” atunci când intră într-o lume nestructurată.

Mai mult de 1.000 de incidente legate de AI înregistrate

De la crearea inițială a AIID, au fost înregistrate peste 1.000 de incidente legate de AI în bază de date. Din toate incidentele din bază de date, problemele legate de echitatea AI au fost cel mai frecvent tip de incident advers. Multe dintre aceste incidente de echitate implică utilizarea algoritmilor de recunoaștere facială de către agențiile guvernamentale. McGregor notează, de asemenea, că există un număr tot mai mare de incidente care implică robotica și care sunt adăugate în bază de date.

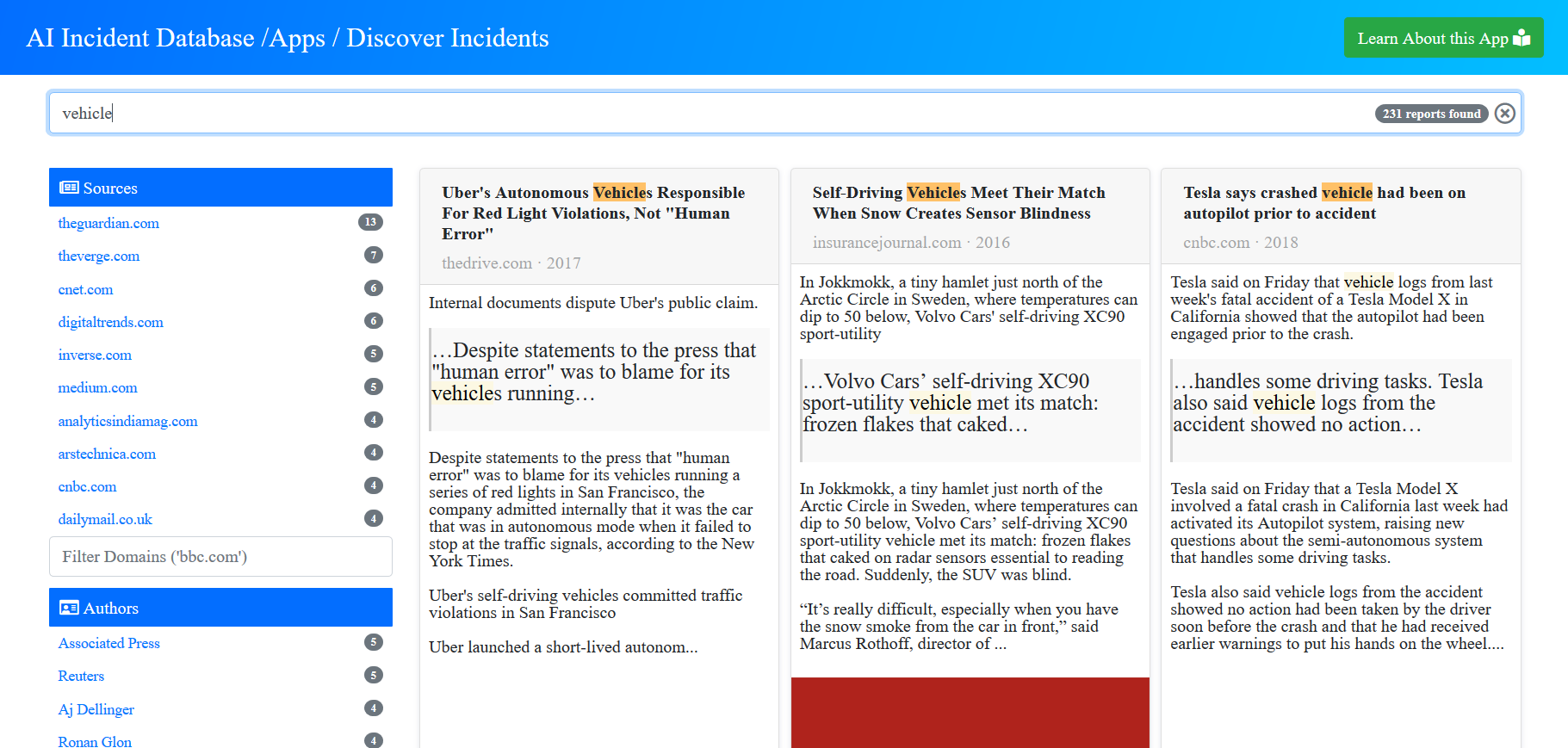

Vizitatorii bazei de date pot executa interogări, căutând incidente în bază de date pe baza unor criterii precum cuvinte cheie, ID de incident, sursă sau autor. De exemplu, rularea unei căutări pentru “Deepfake” returnează 7 rapoarte, în timp ce căutarea pentru “roboți” returnează 158 de rapoarte.

O bază de date centralizată pentru incidentele în care AI funcționează defectuos și se comportă în moduri neașteptate poate ajuta cercetătorii, inginerii și eticienii să supravegheze dezvoltarea și implementarea sistemelor AI. Managerii de produs de la companiile tehnologice pot utiliza AIID pentru a vedea dacă există probleme potențiale înainte de a utiliza sisteme de recomandare AI, sau un inginer AI poate obține o idee despre prejudecățile potențiale care trebuie corectate atunci când creează aplicația AI. La fel, ofițerii de risc pot utiliza baza de date pentru a determina efectele negative potențiale asociate cu un model AI, permițându-le să planifice și să dezvolte măsuri pentru a mitigă daunele potențiale.

Arhitectura care stă la baza AIID este destinată să fie flexibilă, ceea ce permite crearea de noi instrumente pentru a interoga baza de date și a extrage insight-uri semnificative. Parteneriatul pentru AI și McGregor vor colabora pentru a proiecta o taxonomie flexibilă care poate fi utilizată pentru a clasifica toate formele de incidente AI. Echipa speră că, odată ce taxonomia flexibilă a fost creată, aceasta poate fi combinată cu un sistem automatizat care va înregistra automat incidentele AI.

“Comunitatea AI a început să împărtășească înregistrări de incidente unii cu alții pentru a motiva schimbări în produsele, procedurile și programele de cercetare”, a explicat McGregor prin TechTalks. “Site-ul a fost lansat public în noiembrie, așa că abia începem să realizăm beneficiile sistemului.”