Inteligență artificială

Perplexity AI “Dezvoltă” DeepSeek R1: Cine Decide Limitările Inteligenței Artificiale?

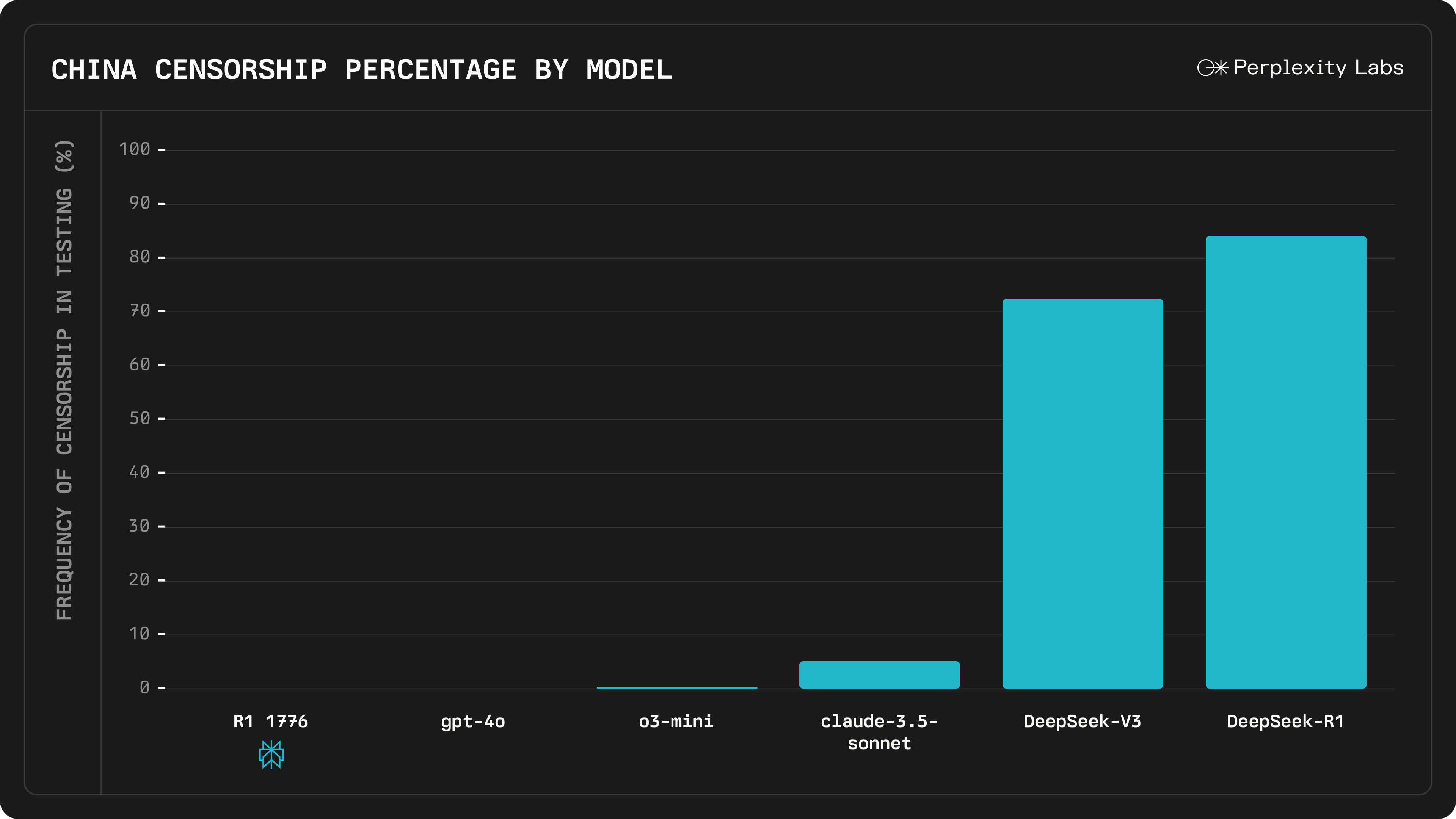

Într-o mișcare care a atras atenția multor persoane, Perplexity AI a lansat o nouă versiune a unui model de limbaj deschis popular, care elimină cenzura încorporată chineză. Acest model modificat, denumit R1 1776 (un nume care evocă spiritul independenței), se bazează pe modelul DeepSeek R1 dezvoltat în China. Modelul original DeepSeek R1 a făcut valuri datorită capacităților sale puternice de raționament – care au rivalizat cu modelele de top la o fracțiune din cost – dar a venit cu o limitare semnificativă: a refuzat să abordeze anumite subiecte sensibile.

De ce contează acest lucru?

Ridică întrebări cruciale despre supravegherea prin inteligență artificială, prejudecăți, deschidere și rolul geopoliticii în sistemele de inteligență artificială. Acest articol explorează ce a făcut exact Perplexity, implicațiile decenzurării modelului și cum se încadrează în conversația mai largă despre transparența și cenzura inteligenței artificiale.

Ce S-a Întâmplat: DeepSeek R1 Devine Fără Cenzură

DeepSeek R1 este un model de limbaj mare deschis care a apărut în China și a câștigat notorietate pentru capacitățile sale excelente de raționament – apropiindu-se de performanța modelelor de top – și a fost mai eficient din punct de vedere computațional. Cu toate acestea, utilizatorii au observat repede o particularitate: ori de câte ori întrebările atingeau subiecte sensibile în China (de exemplu, controverse politice sau evenimente istorice considerate tabu de autorități), DeepSeek R1 nu răspundea direct. În schimb, răspundea cu declarații standardizate, aprobate de stat, sau refuzuri, reflectând regulile de cenzură ale guvernului chinez. Această părtinire încorporată a limitat utilitatea modelului pentru cei care căutau discuții franche sau nuanțate pe aceste subiecte.

Soluția Perplexity AI a fost să “decenzureze” modelul prin intermediul unui proces extins de post-antrenare. Compania a adunat un set de date mare de 40.000 de întrebări multilingve care acopereau întrebări pe care DeepSeek R1 le cenzurase anterior sau le răspunsese evaziv. Cu ajutorul experților umani, ei au identificat aproximativ 300 de subiecte sensibile în care modelul original avea tendința de a urma linia partidului. Pentru fiecare astfel de întrebare, echipa a curatoriat răspunsuri factuale, bine motivate, în multiple limbi. Aceste eforturi au alimentat un sistem de detectare și corectare a cenzurii multilingv, învățând practic modelul să recunoască când aplica cenzură politică și să răspundă cu un răspuns informativ în schimb. După această finisare specială (pe care Perplexity a poreclit-o “R1 1776” pentru a sublinia tema libertății), modelul a fost făcut disponibil în mod deschis. Perplexity afirmă că a eliminat filtrele și prejudecățile de cenzură chineză din răspunsurile DeepSeek R1, fără a schimba în alt mod capacitățile sale de bază.

În mod crucial, R1 1776 se comportă foarte diferit la întrebările care erau anterior interzise. Perplexity a oferit un exemplu care implică o întrebare despre independența Taiwanului și impactul său potențial asupra prețului acțiunilor NVIDIA – un subiect politic sensibil care atinge relațiile China-Taiwan. Modelul original DeepSeek R1 a evitat întrebarea, răspunzând cu platitudini aliniate cu CCP. În contrast, R1 1776 oferă o evaluare detaliată și sinceră: discută riscuri geopolitice și economice concrete (întreruperi ale lanțului de aprovizionare, volatilitatea pieței, conflict posibil, etc.) care ar putea afecta acțiunile NVIDIA.

Prin faptul că a făcut modelul R1 1776 disponibil în mod deschis, Perplexity a făcut și greutățile modelului și modificările transparente pentru comunitate. Dezvoltatorii și cercetătorii pot descărca modelul de la Hugging Face și chiar îl pot integra prin API, asigurând că eliminarea cenzurii poate fi examinată și îmbunătățită de alții.

(Source: Perplexity AI)

Implicațiile Eliminării Cenzurii

Decizia Perplexity AI de a elimina cenzura chineză din DeepSeek R1 are mai multe implicații importante pentru comunitatea de inteligență artificială:

- Deschidere și Adevăr Îmbunătățite: Utilizatorii R1 1776 pot primi acum răspunsuri directe și fără cenzură pe subiecte care erau anterior interzise, ceea ce reprezintă un pas înainte pentru ancheta deschisă. Acest lucru ar putea face modelul mai fiabil pentru cercetători, studenți sau oricine este curios despre întrebări geopolitice sensibile. Este un exemplu concret de utilizare a inteligenței artificiale deschise pentru a contracara suprimarea informațiilor.

- Performanță Păstrată: Existau îngrijorări că ajustarea modelului pentru a elimina cenzura ar putea deteriora performanța sa în alte domenii. Cu toate acestea, Perplexity raportează că abilitățile de bază ale R1 1776 – cum ar fi matematica și raționamentul logic – rămân la nivelul modelului original. În testele efectuate pe peste 1.000 de exemple care acoperă o gamă largă de întrebări sensibile, s-a constatat că modelul este “în totalitate fără cenzură” și păstrează același nivel de acuratețe a raționamentului ca și DeepSeek R1. Acest lucru sugerează că eliminarea prejudecăților (cel puțin în acest caz) nu a venit la un cost al inteligenței sau capacităților generale, ceea ce este un semn încurajator pentru eforturile similare în viitor.

- Recepție Pozitivă a Comunității și Colaborare: Prin faptul că a făcut modelul decenzurat disponibil în mod deschis, Perplexity invită comunitatea de inteligență artificială să inspecteze și să îmbunătățească lucrarea lor. Acest lucru demonstrează un angajament față de transparență – echivalentul inteligenței artificiale de a-și arăta lucrul. Enthusiaștii și dezvoltatorii pot verifica că restricțiile de cenzură sunt cu adevărat eliminate și pot contribui la îmbunătățiri suplimentare. Acest lucru favorizează încrederea și inovarea colaborativă într-o industrie în care modelele închise și regulile de moderare ascunse sunt comune.

- Considerații Etice și Geopolitice: Pe de altă parte, eliminarea completă a cenzurii ridică întrebări etice complexe. O preocupare imediată este modul în care acest model decenzurat ar putea fi utilizat în contexte în care subiectele cenzurate sunt ilegale sau periculoase. De exemplu, dacă cineva din China ar utiliza R1 1776, răspunsurile modelului despre Piața Tiananmen sau Taiwan ar putea pune utilizatorul în pericol. Există și semnalul geopolitic mai larg: o companie americană care modifică un model de origine chineză pentru a defia cenzura chineză poate fi văzută ca o poziție ideologică îndrăzneață. Numele “1776” subliniază o temă de eliberare, care nu a trecut neobservat. Unii critici susțin că înlocuirea unei seturi de prejudecăți cu alta este posibilă – esențialmente punând sub semnul întrebării dacă modelul ar putea reflecta acum o perspectivă occidentală în zonele sensibile. Dezbaterile subliniază că cenzura versus deschiderea în inteligența artificială nu este doar o problemă tehnică, ci și una politică și etică. Unde o persoană vede moderare necesară, alta vede cenzură, și găsirea echilibrului corect este dificilă.

Eliminarea cenzurii este în mare parte celebrată ca un pas către modele de inteligență artificială mai transparente și mai utile la nivel global, dar aceasta servește și ca un reminder că ceea ce ar trebui să spună o inteligență artificială este o întrebare sensibilă fără acord universal.

(Source: Perplexity AI)

Imaginea Mai Mare: Cenzura Inteligenței Artificiale și Transparența Deschisă

Lansarea R1 1776 de către Perplexity are loc într-un moment în care comunitatea de inteligență artificială se confruntă cu întrebări despre modul în care modelele ar trebui să abordeze conținutul controversat. Cenzura în modelele de inteligență artificială poate proveni din multiple surse. În China, companiile de tehnologie sunt obligate să încorporeze filtre stricte și chiar răspunsuri hardcodate pentru subiecte politice sensibile. DeepSeek R1 este un exemplu primar al acestui lucru – a fost un model deschis, dar a purtat în mod evident amprenta normelor de cenzură ale Chinei în procesul de antrenare și finisare. În contrast, multe modele dezvoltate în Occident, cum ar fi GPT-4 al OpenAI sau LLaMA al Meta, nu sunt obligate să respecte ghidurile CCP, dar ele au totuși straturi de moderare (pentru lucruri precum discursul de ură, violență sau dezinformare) pe care unii utilizatori le numesc “cenzură”. Linia dintre moderarea rezonabilă și cenzura nedorită poate fi neclară și adesea depinde de perspectiva culturală sau politică.

Ceea ce a făcut Perplexity AI cu DeepSeek R1 ridică ideea că modelele deschise pot fi adaptate la diferite sisteme de valori sau medii regulatorii. În teorie, ar putea fi create multiple versiuni ale unui model: una care respectă reglementările chineze (pentru utilizare în China) și alta care este pe deplin deschisă (pentru utilizare în altă parte). R1 1776 este esențialmente ultimul caz – o ramură decenzurată destinată unei audiențe globale care preferă răspunsuri nefiltrate. Acest tip de ramificare este posibil doar pentru că greutățile DeepSeek R1 au fost disponibile în mod deschis. Subliniază beneficiul deschiderii în inteligența artificială: transparența. Oricine poate lua modelul și îl poate ajusta, fie pentru a adăuga măsuri de siguranță, fie, așa cum s-a întâmplat în acest caz, pentru a elimina restricțiile impuse. Faptul că s-a făcut public modelul, codul sau greutățile sale înseamnă că comunitatea poate audita modul în care modelul a fost modificat. (Perplexity nu a dezvăluit pe deplin toate sursele de date pe care le-a utilizat pentru decenzurare, dar prin lansarea modelului însuși, a permis altora să observe comportamentul său și chiar să îl reantreneze dacă este nevoie.)

Acest eveniment se îndreaptă și către dinamica geopolitică mai largă a dezvoltării inteligenței artificiale. Asistăm la o formă de dialog (sau confruntare) între diferite modele de guvernanță pentru inteligența artificială. Un model dezvoltat în China, cu anumite perspective încorporate, este preluat de o echipă din Statele Unite și modificat pentru a reflecta o etos mai deschis de informare. Este un mărturie a modului în care globală și fără frontiere este tehnologia inteligenței artificiale: cercetătorii de oriunde pot construi pe baza lucrărilor altora, dar nu sunt obligați să păstreze constrângerile originale. În timp, s-ar putea vedea mai multe exemple de acest fel – unde modelele sunt “traduse” sau ajustate între diferite contexte culturale. Ridică întrebarea dacă inteligența artificială poate fi vreodată cu adevărat universală sau dacă vom ajunge la versiuni regionale care respectă normele locale. Transparența și deschiderea oferă o cale de a naviga această situație: dacă toate părțile pot inspecta modelele, cel puțin conversația despre prejudecăți și cenzură este deschisă, în loc să fie ascunsă în spatele secretului corporativ sau guvernamental.

În final, mișcarea Perplexity subliniază un punct cheie în dezbaterea despre controlul inteligenței artificiale: cine decide ce poate sau nu spune o inteligență artificială? În proiectele deschise, această putere devine descentralizată. Comunitatea – sau dezvoltatorii individuali – pot decide să implementeze filtre mai stricte sau să le relaxeze. În cazul R1 1776, Perplexity a decis că beneficiile unui model decenzurat depășesc riscurile și a avut libertatea de a face această alegere și de a o face publică. Este un exemplu îndrăzneț al tipului de experimentare pe care o permite dezvoltarea deschisă a inteligenței artificiale.