Inteligență artificială

DeepSeek-V3 Dezvăluit: Cum proiectarea inteligentă a hardware-ului și a inteligenței artificiale reduce costurile și îmbunătățește performanța

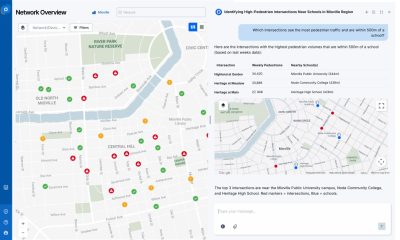

DeepSeek-V3 reprezintă o avanpremieră în dezvoltarea de inteligență artificială eficientă din punct de vedere al costurilor. Acesta demonstrează cum proiectarea inteligentă a hardware-ului și a software-ului poate livra performanțe de ultimă generație fără costuri excesive. Prin antrenarea pe doar 2.048 GPU-uri NVIDIA H800, acest model obține rezultate remarcabile prin abordări inovatoare, cum ar fi atenția latentă cu mai multe capete pentru eficiența memoriei, arhitectura Mixture of Experts pentru calculul optimizat și antrenamentul cu precizie mixtă FP8 care deblochează potențialul hardware-ului. Modelul demonstrează că echipele mai mici pot concura cu marile companii de tehnologie prin alegeri inteligente de proiectare, mai degrabă decât prin scalare forțată.

Provocarea escaladării inteligenței artificiale

Industria inteligenței artificiale se confruntă cu o problemă fundamentală. Modelele de limbaj mari devin tot mai puternice, dar necesită și resurse computaționale uriașe pe care majoritatea organizațiilor nu le pot permite. Marile companii de tehnologie, cum ar fi Google, Meta și OpenAI, implementează clusteruri de antrenament cu zeci sau sute de mii de GPU-uri, făcând dificilă competiția pentru echipele mai mici de cercetare și startup-uri.

Acest decalaj de resurse amenință să concentreze dezvoltarea inteligenței artificiale în mâinile câtorva mari companii de tehnologie. Legile de scalare care impulsionează progresul inteligenței artificiale sugerează că modelele mai mari, cu mai multe date de antrenament și putere de calcul, duc la o performanță mai bună. Cu toate acestea, creșterea exponențială a necesităților de hardware a făcut ca pentru jucătorii mai mici să devină tot mai dificil să concureze în cursa inteligenței artificiale.

Cerințele de memorie au devenit o altă provocare semnificativă. Modelele de limbaj mari necesită resurse de memorie semnificative, cu o creștere de peste 1000% pe an. Între timp, capacitatea de memorie de înaltă viteză crește la un ritm mult mai lent, de obicei sub 50% anual. Acest decalaj creează ceea ce cercetătorii numesc “peretele de memorie al inteligenței artificiale“, unde memoria devine factorul limitativ, mai degrabă decât puterea de calcul.

Situația devine și mai complexă în timpul inferenței, atunci când modelele servesc utilizatori reali. Aplicațiile moderne de inteligență artificială implică adesea conversații cu mai multe tururi și contexte lungi, necesitând mecanisme de caching puternice care consumă resurse de memorie substanțiale. Abordările tradiționale pot copleși rapid resursele disponibile și pot face inferența eficientă o provocare tehnică și economică semnificativă.

Abordarea hardware-aware a DeepSeek-V3

DeepSeek-V3 a fost proiectat cu optimizarea hardware-ului în minte. În loc să utilizeze mai mult hardware pentru scalarea modelelor mari, DeepSeek s-a concentrat pe crearea de proiecte de modele care optimizează eficiența în cadrul constrângerilor existente. Această abordare permite DeepSeek să atingă performanțe de ultimă generație utilizând doar 2.048 GPU-uri NVIDIA H800, o fracțiune din ceea ce competitorii obișnuiesc să necesite.

Principala idee din spatele DeepSeek-V3 este că modelele de inteligență artificială ar trebui să ia în considerare capacitățile hardware-ului ca parametru cheie în procesul de optimizare. Mai degrabă decât proiectarea modelelor în izolare și apoi găsirea de modalități de a le rula eficient, DeepSeek s-a concentrat pe construirea unui model de inteligență artificială care incorporează o înțelegere profundă a hardware-ului pe care rulează. Această strategie de proiectare comună înseamnă că modelul și hardware-ul lucrează împreună eficient, mai degrabă decât tratarea hardware-ului ca o constrângere fixă.

Proiectul se bazează pe insight-urile cheie ale modelelor DeepSeek anterioare, în special DeepSeek-V2, care a introdus inovații de succes, cum ar fi DeepSeek-MoE și atenția latentă cu mai multe capete. Cu toate acestea, DeepSeek-V3 extinde aceste insight-uri prin integrarea antrenamentului cu precizie mixtă FP8 și dezvoltarea de noi topologii de rețea care reduc costurile infrastructurii fără a compromite performanța.

Această abordare hardware-aware se aplică nu numai modelului, ci și întregii infrastructuri de antrenament. Echipa a dezvoltat o rețea Fat-Tree cu două straturi pe mai multe planuri pentru a înlocui topologiile tradiționale cu trei straturi, reducând semnificativ costurile de conectare ale clusterului. Aceste inovații în infrastructură demonstrează cum proiectarea atentă poate realiza economii majore de costuri pe întregul lanț de dezvoltare a inteligenței artificiale.

Inovații cheie care impulsionează eficiența

DeepSeek-V3 aduce numeroase îmbunătățiri care cresc semnificativ eficiența. O inovație cheie este mecanismul de atenție latentă cu mai multe capete (MLA), care abordează utilizarea ridicată a memoriei în timpul inferenței. Mecanismele tradiționale de atenție necesită cachingul vectorilor Cheie și Valoare pentru toate capetele de atenție. Acest lucru consumă cantități uriașe de memorie pe măsură ce conversațiile devin mai lungi.

MLA rezolvă această problemă prin comprimarea reprezentărilor Cheie-Valoare ale tuturor capetelor de atenție într-un vector latent mai mic, utilizând o matrice de proiecție antrenată împreună cu modelul. În timpul inferenței, trebuie să fie cache-uit doar acest vector latent comprimat, reducând semnificativ cerințele de memorie. DeepSeek-V3 necesită doar 70 KB pe token, comparativ cu 516 KB pentru LLaMA-3.1 405B și 327 KB pentru Qwen-2.5 72B1.

Arhitectura Mixture of Experts oferă o altă câștigare crucială de eficiență. În loc să activeze întregul model pentru fiecare calcul, MoE activează selectiv doar rețelele de experți cele mai relevante pentru fiecare intrare. Acestă abordare menține capacitatea modelului, reducând în același timp semnificativ calculul necesar pentru fiecare trecere înainte.

Antrenamentul cu precizie mixtă FP8 îmbunătățește și mai mult eficiența, trecând de la precizia cu punct fix de 16 biți la cea de 8 biți. Acest lucru reduce consumul de memorie la jumătate, menținând în același timp calitatea antrenamentului. Această inovație abordează direct peretele de memorie al inteligenței artificiale, folosind mai eficient resursele hardware disponibile.

Modulul de predicție multi-token adaugă o altă straturi de eficiență în timpul inferenței. În loc să genereze un token la un moment dat, acest sistem poate prezice multiple token-uri viitoare simultan, sporind semnificativ viteza de generare prin decodificarea speculativă. Acestă abordare reduce timpul total necesar pentru generarea de răspunsuri, îmbunătățind experiența utilizatorului, în timp ce reduce costurile computaționale.

Lecții cheie pentru industrie

Succesul DeepSeek-V3 oferă câteva lecții cheie pentru industria inteligenței artificiale mai largă. Acesta demonstrează că inovația în eficiență este la fel de importantă ca și scalarea dimensiunii modelului. Proiectul subliniază, de asemenea, cum proiectarea atentă a hardware-ului și a software-ului poate depăși limitele de resurse care ar putea altfel restricționa dezvoltarea inteligenței artificiale.

Această abordare de proiectare care ține cont de hardware ar putea schimba modul în care se dezvoltă inteligența artificială. În loc să vadă hardware-ul ca o limitare de ocolit, organizațiile ar putea să îl trateze ca un factor cheie de proiectare care modelează arhitectura modelului de la început. Această schimbare de mentalitate poate duce la sisteme de inteligență artificială mai eficiente și mai rentabile în întreaga industrie.

Eficacitatea tehnicilor, cum ar fi MLA și antrenamentul cu precizie mixtă FP8, sugerează că există încă un spațiu semnificativ pentru îmbunătățirea eficienței. Pe măsură ce hardware-ul continuă să evolueze, vor apărea noi oportunități de optimizare. Organizațiile care profită de aceste inovații vor fi mai bine pregătite să concureze într-o lume cu resurse în creștere.

Inovațiile de rețea din DeepSeek-V3 subliniază, de asemenea, importanța proiectării infrastructurii. În timp ce se pune un accent puternic pe arhitecturile de modele și metodele de antrenament, infrastructura joacă un rol critic în eficiența și costul general. Organizațiile care construiesc sisteme de inteligență artificială ar trebui să prioritizeze optimizarea infrastructurii alături de îmbunătățirile modelului.

Proiectul demonstrează, de asemenea, valoarea cercetării deschise și a colaborării. Prin împărtășirea insight-urilor și tehnicilor lor, echipa DeepSeek contribuie la progresul general al inteligenței artificiale, stabilind în același timp poziția lor ca lideri în dezvoltarea de inteligență artificială eficientă. Această abordare beneficiază întreaga industrie, accelerând progresul și reducând eforturile duplicate.

Rezumat

DeepSeek-V3 reprezintă un pas important înainte în inteligența artificială. Acesta demonstrează că proiectarea atentă poate livra performanțe comparabile cu, sau mai bune decât, simpla scalare a modelelor. Prin utilizarea de idei, cum ar fi atenția latentă cu mai multe capete, straturi Mixture-of-Experts și antrenamentul cu precizie mixtă FP8, modelul atinge rezultate de top, reducând semnificativ necesitățile de hardware. Acest accent pe eficiența hardware oferă laboratoarelor și companiilor mai mici șanse noi de a construi sisteme avansate fără bugete uriașe. Pe măsură ce inteligența artificială continuă să evolueze, abordări precum cele din DeepSeek-V3 vor deveni tot mai importante pentru a asigura că progresul este atât durabil, cât și accesibil. DeepSeek-3 învață o lecție mai largă. Cu alegeri arhitecturale inteligente și optimizare strânsă, putem construi inteligență artificială puternică fără nevoia de resurse extinse și costuri. În acest fel, DeepSeek-V3 oferă întregii industrii un drum practic către inteligența artificială accesibilă și eficientă din punct de vedere al costurilor, care ajută multe organizații și utilizatori din întreaga lume.