Unghiul lui Anderson

Aducerea unui simț al mirosului în dezvoltarea IA

O nouă bază de date IA învață mașinile să mirosim asociind datele de miros cu imagini, permițând modelului să asocieze mirosurile cu obiecte, scene și materiale.

Poate pentru că mașinile cu ieșire de miros au o istorie atât de controversată, olfacția este un simț relativ neglijat în literatura de cercetare a IA. Cu excepția cazului în care intenționați să produceți o altă intrare în saga lungă (de peste un secol, până în prezent) smell-o-vision, cazurile de utilizare au părut întotdeauna destul de “nișate” în comparație cu exploatarea potențială a seturilor de date de imagine, audio și video, și a modelului IA care este instruit de la acestea.

Într-adevăr, posibilitatea de a automatiza, industrializa și populariza facilitățile de detectare oferite de câini de bombă, câini de cadavru, câini de detectare a bolilor și diverse alte tipuri de unități de detectare canine, ar fi un beneficiu notabil în serviciile municipale și de securitate. În ciuda cererii ridicate, mult peste oferta, instruirea și întreținerea câinilor de detectare este o afacere scumpă care nu nu oferă întotdeauna o valoare bună pentru banii cheltuiți.

Până în prezent, cea mai mare parte a cercetărilor care se apropie de această zonă de studiu a fost limitată la un laborator, cu colecții curate care cuprind în general exemple cu caracteristici create manual – un profil mai mult îndreptat către soluții artizanale decât aplicații industrializate.

Înainte cu o nas

În această atmosferă destul de învechită, vine o colaborare academică/industrială interesantă din SUA, în care o echipă de cercetători a petrecut câteva luni catalogând diverse mirosuri în medii interioare și exterioare din New York – și, pentru prima dată, adunând imagini asociate cu mirosurile capturate:

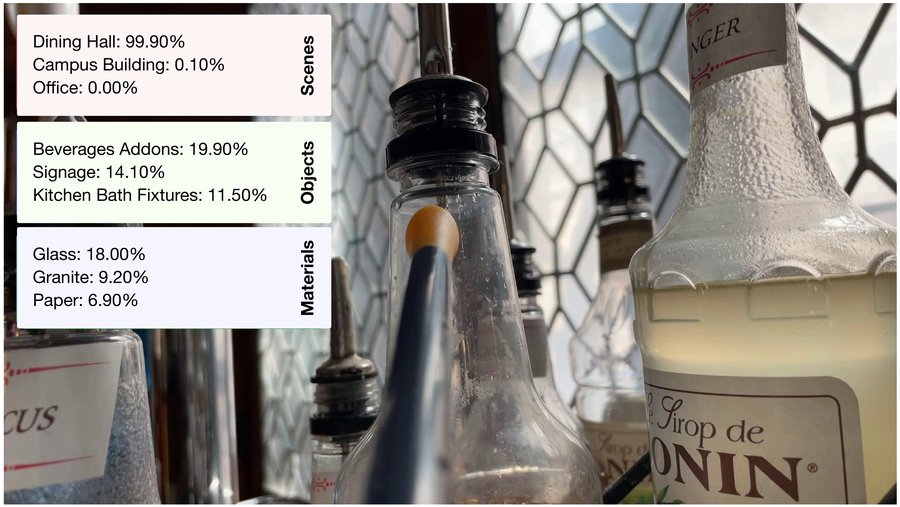

Notați senzorul central, ‘nasul’ dispozitivului olfactiv. Antrenat doar pe miros, modelul ghicește dacă mirosim granit, plastic sau piele – și chiar identifică camera în care se află, fără a vedea un singur pixel. Sursă

Această cercetare a condus autorii noii lucrări să conceapă o varianta a cadrului foarte popular Contrastive Language-Image Pretraining (CLIP), care conectează textul și imaginile, sub forma Contrastive Olfaction-Image Pretraining (COIP) – care conectează mirosurile și imaginile.

Sus: datele video și olfactive sunt capturate în medii naturale folosind un aparat cu cameră și nas electronic. Jos stânga (b): o încorporare comună este învățată prin auto-supervizare cross-modală. (c): sistemul recuperează potriviri vizuale pe baza unei cereri de miros. (d): mostrele individuale de miros sunt utilizate pentru a clasifica categoriile de mediu, obiect și material. (e): mirosuri foarte asemănătoare, cum ar fi două tipuri de iarbă, sunt distinse fără intrare vizuală. Sursă

Noua bază de date, intitulată Mirosurile din New York, conține 7.000 de perechi de miros-imagine care prezintă 3.500 de obiecte diferite. Atunci când a fost testat, noua bază de date s-a dovedit a fi mai bună decât caracteristicile populare create manual în numărul relativ mic de baze de date similare.

Autorii speră că prima lor ieșire va deschide calea pentru lucrări ulterioare și următoare către sisteme de detectare olfactivă proiectate pentru a funcționa în sălbăticie, în același mod în care funcționează câinii de detectare:

‘Vedem această bază de date ca un pas către percepția olfactivă multimodală în sălbăticie, precum și un pas către legarea vederii de miros. În timp ce olfacția a fost abordată în mod tradițional în medii constrânse, cum ar fi asigurarea calității, există multe aplicații în medii naturale.

‘De exemplu, ca oameni, folosim constant simțul nostru al mirosului pentru a evalua calitatea alimentelor, a identifica pericolele și a detecta obiectele invizibile.

‘Mai mult, multe animale, cum ar fi câinii, urșii și șoarecii, arată capacități olfactive supraomenești, sugerând că percepția mirosului uman este departe de limita capacităților mașinilor.’

Deși noul articol, intitulat Mirosurile din New York: O bază de date multimodală mare pentru olfacție, promite că datele și codul vor fi lansate, un fișier de date de 27 GB este deja disponibil prin site-ul proiectului. Articolul a fost produs de nouă cercetători de la Universitatea Columbia, Universitatea Cornell și Osmo Labs.

Metodă

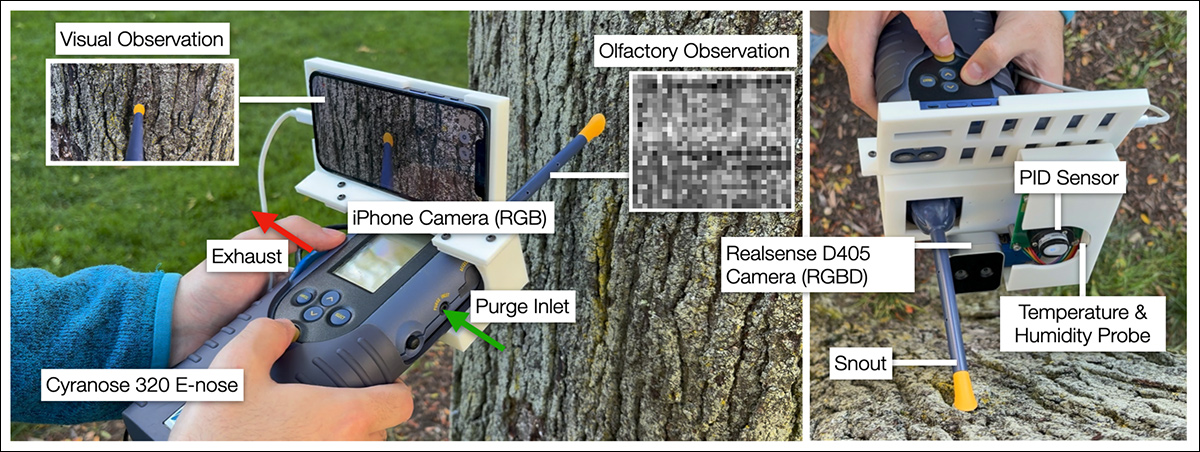

Pentru a colecta material pentru noua colecție, cercetătorii au utilizat Cyranose 320 nasul electronic, cu un iPhone montat deasupra intrării pentru a captura vizual ce mirosuri erau înregistrate:

Un aparat portabil de senzor colectează date video și miros în același timp, folosind o cameră iPhone montată pe un nas electronic Cyranose 320. Nasul este îndreptat către obiecte, în timp ce evacuarea și intrarea de aer gestionează fluxul de aer în timpul mostrelor. O cameră RGB-D capturează adâncimea, în timp ce concentrația de compuși organici volatili (VOC), temperatura și umiditatea sunt înregistrate prin senzori integrați, inclusiv un modul PID și o sondă de mediu.

Dispozitivul Cyranose rulează la 2Hz, înregistrând 32 de pași olfactivi în timp. Concentrațiile de compuși organici volatili (VOC) au fost înregistrate cu un senzor MiniPID2 PPM WR.

Unitatea portabilă a funcționat ca un senzor agil, transmițând date către o stație mobilă mai capabilă pentru procesare.

Pentru a plasa mirosul țintă în context, un “miros de bază” a fost înregistrat, înainte de a fi țintit direct obiectul cu “nasul” dispozitivului Cyranose. Mostra ambientală a fost apoi luată de la o portă laterală a unității, pentru a se asigura că este suficient de departe de sursa principală de miros pentru a nu fi contaminată.

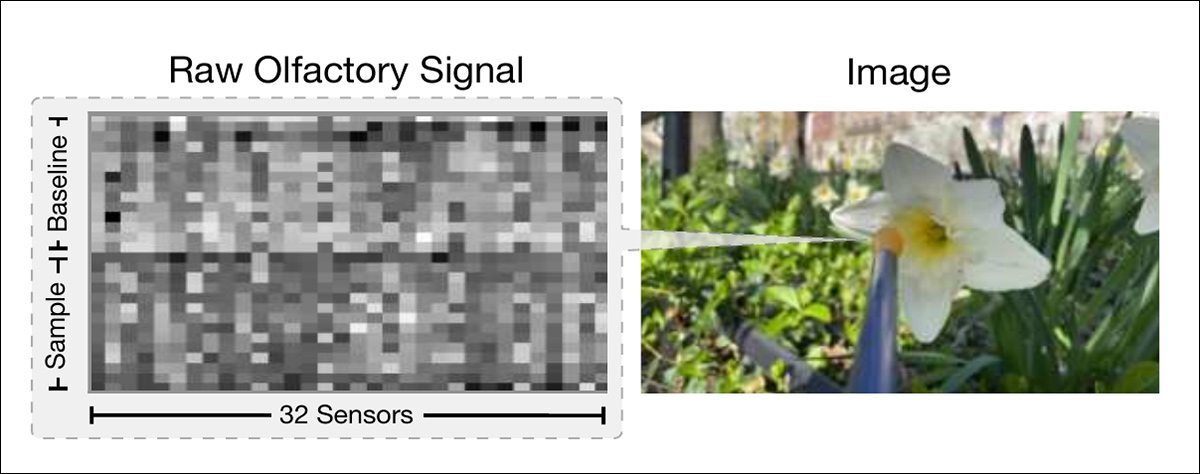

Două mostre au fost luate prin intrarea principală a senzorului, cu fiecare înregistrare de zece secunde capturată dintr-o poziție diferită în jurul obiectului, pentru a îmbunătăți eficiența datelor. Mostrele au fost apoi combinate cu mirosul de bază pentru a forma o matrice 28×32, reprezentând măsurarea olfactivă completă:

Acest exemplu arată semnalul și imaginea corespunzătoare pentru o floare. Semnalul olfactiv complet constă într-o matrice 28×32, combinând o bază ambientală de 14 cadre cu două mostre de zece secunde luate din unghiuri diferite în jurul obiectului țintă.

Date și teste

Modelele de limbaj și vedere (VLM) au fost utilizate pentru a eticheta automat obiectele și materialele capturate de iPhone în aparatul Cyranose, cu GPT-4o utilizat pentru această sarcină; cu toate acestea, categoriile de scene au fost etichetate manual:

Un exemplu mic dintr-o ilustrație extinsă din articolul sursă, care detaliază sursele și mediile de miros capturate în proiect.

Baza de date a fost împărțită în părți de antrenare și validare împărțite, cu ambele mostre din fiecare obiect atribuite aceleiași împărțiri pentru a evita contaminarea încrucișată. Colectia finală cuprinde 7.000 de perechi olfactive-vizuale extrase din 3.500 de obiecte neetichetate, împreună cu 70 de ore de video și 196.000 de pași de timp de date olfactive brute din fazele de bază și mostre.

Datele au fost colectate în 60 de sesiuni pe o perioadă de două luni, cuprinzând parcuri, clădiri universitare, birouri, străzi, biblioteci, apartamente și săli de mâncare, cu multiple sesiuni desfășurate în fiecare locație. Rezultatul bazei de date conține 41% mediu exterior și 59% mediu interior.

Pentru a dezvolta reprezentări olfactive generale, autorii au antrenat un model contrastiv pentru a asocia perechi de imagini și mirosuri sincronizate din baza de date. Această abordare, menționată anterior COIP, utilizează o funcție de pierdere adaptată de la CLIP pentru a alinia încorporările semnalelor vizuale și olfactive co-ocurente.

Antrenamentul a utilizat atât un codator vizual, cât și un codator de miros, cu scopul de a învăța modelul să aducă mirosurile și imaginile potrivite mai aproape într-un spațiu de reprezentare comun. Reprezentările rezultate susțin o varietate de sarcini downstream, inclusiv recuperarea imaginilor de la miros, recunoașterea scenei și a obiectului, clasificarea materialului și discriminarea fină a mirosului.

Modelul a fost antrenat utilizând două tipuri de intrări olfactive: semnalul senzorului brut și o sinteză redusă creată manual, cunoscută sub numele de amprente de miros – caracteristici larg utilizate în cercetarea olfactivă care comprimă răspunsul fiecărui senzor într-un singur număr, comparând rezistența de vârf în timpul mostrelor cu rezistența medie în timpul bazei ambientale.

În schimb, intrarea brută înregistrată constă dintr-o serie de timp de la 32 de senzori chimici din dispozitivul Cyranose, capturând modul în care rezistența electrică a fiecărui senzor s-a schimbat în timp, pe măsură ce a reacționat la miros.

Pentru curarea bazei de date, acest semnal neprelucrat a fost introdus direct într-o rețea neurală, permițând învățarea de la capăt la coadă cu o arhitectură convolutivă sau transformator. Modelele au fost antrenate utilizând atât amprente de miros, cât și intrarea brută colectată din diverse medii din New York, cu ambele tipuri de intrare evaluate utilizând învățarea contrastivă.

Recuperare cross-modală

Recuperarea cross-modală a fost evaluată prin încorporarea fiecărei mostre de miros și a imaginii sale asociate într-un spațiu de reprezentare comun și testarea dacă imaginea corectă poate fi recuperată pe baza intrării olfactive sole.

Clasamentul a fost determinat de proximitatea fiecărei încorporări de imagine față de cererea de miros în acest spațiu, iar performanța a fost măsurată utilizând rangul mediu, rangul median și recuperarea la multiple praguri:

Precizia de recuperare cross-modală pentru diferiți codatori de miros, arătând cât de bine fiecare model identifică imaginea corectă dintr-o cerere de miros. Rezultatele compară arhitecturi antrenate pe semnale olfactive brute cu cele care utilizează amprente de miros.

În legătură cu aceste rezultate, autorii declară:

‘Antrenamentul contrastiv utilizând amprente de miros realizează mai bine decât întâmplător în toate metricile. Cu toate acestea, antrenarea codatorului olfactiv pe semnalul senzorului brut duce la o îmbunătățire semnificativă în comparație cu codatorul de amprente de miros, independent de arhitectură.

‘Acest lucru arată informația mai bogată prezentă în datele olfactive brute, deblocând asocieri cross-modale mai puternice între vedere și miros.’

Un detaliu din a șaptea ilustrație din articolul sursă, care este prea condensat pentru a fi reprodus într-un mod semnificativ aici. Aici, exemple de recuperare cross-modală care arată cum modelul leagă mirosurile de imagini potrivite. Fiecare rând începe cu o cerere de miros, urmată de primele imagini potrivite în spațiul de încorporare comun. Imaginea corectă pentru fiecare cerere este evidențiată cu verde, ilustrând cum mirosurile de la cărți, plante, zidărie și alte materiale atrag modelul către scene vizual și semantic legate.

Autorii notează, de asemenea, că rezultatele de recuperare au arătat modele clare semantice:

‘Recuperările din modelul nostru arată adesea grupări semantice. Mirosul unei cărți recuperează imagini de alte cărți, mirosul frunzelor recuperează imagini de frunze.

‘Aceste rezultate sugerează că reprezentarea învățată capturează structura cross-modală semnificativă.’

Recunoașterea scenei, obiectului și materialului

Capacitatea modelului de a recunoaște mirosuri fără intrare vizuală a fost evaluată prin antrenarea acestuia pentru a identifica scene, obiecte și materiale pe baza exclusiv a datelor olfactive; în acest scop, a fost utilizată o sondă liniară (un clasificator simplu antrenat pe reprezentări înghețate) pentru a evalua câtă informație este codificată în încorporările de miros învățate.

Etichetele au fost derivate din imaginile asociate din setul de antrenament utilizând GPT-4o – dar numai semnalul olfactiv a fost utilizat în timpul clasificării.

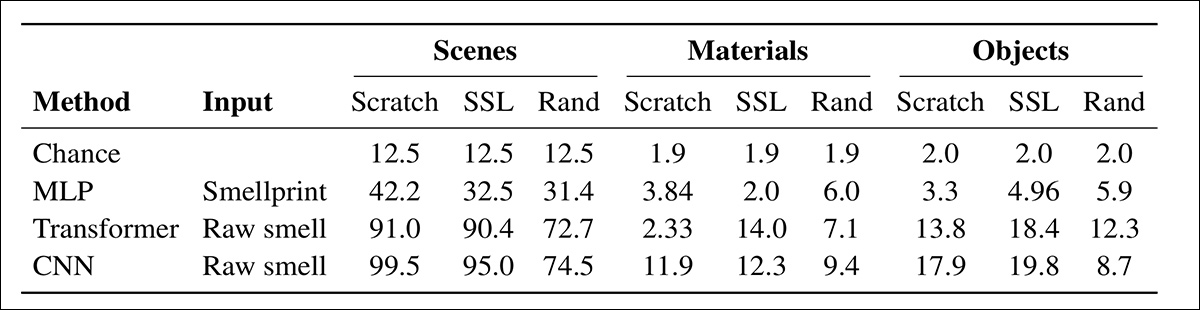

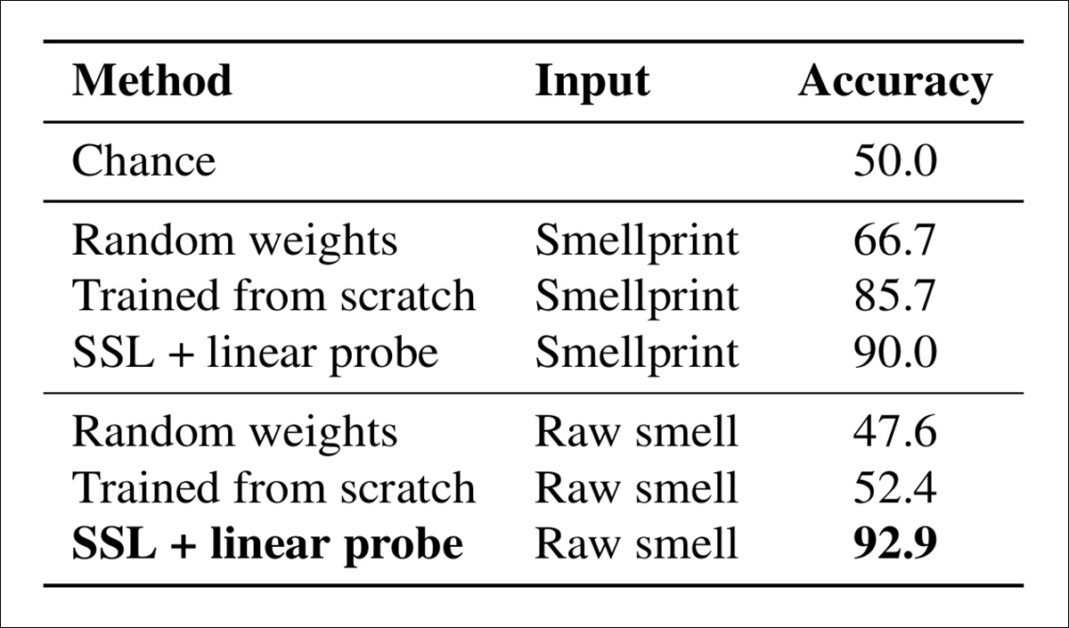

Au fost testate mai multe tipuri de codatori: unii inițializați aleator, alții antrenați de la zero și alții antrenați utilizând învățarea contrastivă pentru a alinia mirosul și vederea într-un spațiu de reprezentare comun, cu date brute și amprente de miros evaluate:

Precizia de clasificare pentru scene, materiale și obiecte a fost evaluată utilizând semnale olfactive singure. Intrarea senzorului brut a depășit amprente de miros, cu rețele neuronale convolutive antrenate de la zero care au furnizat cele mai bune rezultate, inclusiv 99,5% pentru scene. Prelucrarea SSL a ajutat în unele cazuri, dar a fost în general depășită de antrenamentul supravegheat. Bazele cu greutăți aleatorii indică faptul că capacitatea modelului singură se dovedește a fi insuficientă.

S-a obținut o precizie semnificativ mai mare atunci când s-au utilizat date olfactive brute, în special în modele antrenate cu supraveghere cross-modală. Autorii menționează:

‘Modelele antrenate pe intrări senzoriale brute realizează, de asemenea, o precizie mai mare decât modelele antrenate cu caracteristici de amprente de miros create manual. Aceste rezultate arată că învățarea profundă din semnalele olfactive brute este semnificativ mai bună decât caracteristicile create manual.’

Discriminare fină

Pentru a evalua dacă pot fi învățate distincții fine de miros, a fost creat un benchmark din două specii de iarbă care coexistă pe aceeași peluză a campusului. Mostrele alternative au fost colectate pe parcursul a șase sesiuni de 30 de minute, dând naștere la 256 de exemple. Un clasificator liniar a fost antrenat pe caracteristici din învățarea olfactiv-vizuală contrastivă și evaluat pe un set de 42 de mostre:

Precizia de clasificare a speciilor de iarbă din miros singur. Modelele au fost evaluate în funcție de capacitatea lor de a distinge între două tipuri de iarbă vizual asemănătoare, utilizând doar intrarea olfactivă. Performanța a fost comparată pe amprente de miros și date senzoriale brute, cu modele fie inițializate aleator, antrenate de la zero sau antrenate utilizând învățarea auto-supervizată (SSL), urmată de o sondă liniară. Precizia cea mai mare, 92,9%, a fost obținută utilizând semnale olfactive brute cu SSL, indicând faptul că diferențele fine de miros sunt cel mai bine capturate prin intrare brută și antrenament ghidat de vedere.

Aici cercetătorii declară:

‘Antrenarea pe semnalul senzorului brut (în loc de caracteristici create manual) conduce la cea mai mare precizie – depășind toate variantele bazate pe amprente de miros.

‘Aceste rezultate sugerează că învățarea olfactiv-vizuală păstrează mai multă informație fină decât învățarea cu amprente de miros, și că supravegherea vizuală oferă un semnal pentru exploatarea acestei informații.’

Concluzie

Deși sinteza mirosului pare să rămână o problemă nerezolvată pentru o perioadă de timp, un sistem de analiză a mirosului în sălbăticie eficient și accesibil are un potențial enorm, nu numai pentru poliție, securitate și scopuri medicale, ci și pentru monitorizarea calității vieții și a mediului urban.

În prezent, echipamentul implicat este de nișă și, de obicei, destul de scump; prin urmare, progresul real în “IA olfactivă” pentru detectare pare să necesite un senzor vizionar și accesibil în spiritul Raspberry PI.

* Conversia mea a citărilor inline ale autorilor în legături.

** Vă rugăm să rețineți că ilustrații suplimentare (figura 8) sunt disponibile în articolul sursă, dar sunt mai bine vizualizate în contextul respectiv.

Publicat pentru prima dată vineri, 28 noiembrie 2025