Inteligență artificială

Performanță Îmbunătățită a Învățării Automate prin Redimensionarea Imaginilor pe Baza de CNN

Cercetătorii de la Google Research au propus o nouă metodă pentru a îmbunătăți eficiența și acuratețea fluxurilor de antrenare a viziunii computaționale bazate pe imagini, prin îmbunătățirea modului în care imaginile dintr-un set de date sunt redimensionate în stadiul de pre-procesare.

În articol Învățarea Redimensionării Imaginilor pentru Task-uri de Viziune Computațională, cercetătorii Hossein Talebi și Peyman Milanfar utilizează un CNN pentru a crea o nouă arhitectură hibridă de redimensionare a imaginilor, care produce o îmbunătățire notabilă a rezultatelor de recunoaștere obținute pe patru seturi de date populare de viziune computațională.

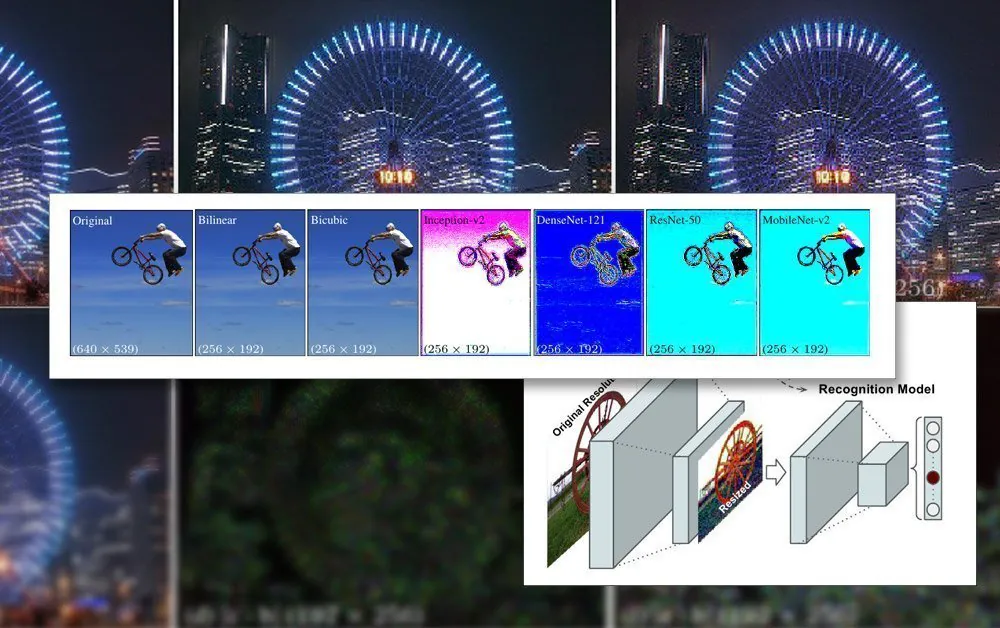

Cadru propus pentru recunoaștere și redimensionare. Sursă: https://arxiv.org/pdf/2103.09950.pdf

Articolul observă că metodele de redimensionare/rescalare utilizate în prezent în fluxurile automate de învățare a mașinilor sunt în urmă cu decenii și utilizează adesea doar metode de bază de redimensionare bilineare, bicubice și vecin nearest – metode care tratează toate pixelii în mod indiscriminat.

În schimb, metoda propusă îmbunătățește datele imaginilor prin intermediul unui CNN și incorporează aceste intrări în imaginile redimensionate care vor trece prin arhitectura modelului.

Restricții de Imagine în Antrenarea IA

Pentru a antrena un model care lucrează cu imagini, un cadru de învățare a mașinilor va include o etapă de pre-procesare, în care o varietate diversă de imagini de diferite dimensiuni, spații de culoare și rezoluții (care vor contribui la setul de date de antrenare) sunt tăiate și redimensionate în dimensiuni consistente și un format stabil și unic.

În general, acest lucru va implica un compromis bazat pe formatul PNG, în care se stabilește un echilibru între timpul de procesare/resurse, dimensiunea fișierului și calitatea imaginii.

În majoritatea cazurilor, dimensiunile finale ale imaginii prelucrate sunt foarte mici. Mai jos se vede un exemplu de imagine cu rezoluția 80×80, la care unele dintre primele seturi de date de deepfakes au fost generate:

Deoarece fețele (și alte subiecte posibile) rareori se potrivesc în raportul pătratic necesar, pot fi necesare bare negre (sau spațiu irosit) pentru a homogeniza imaginile, ceea ce reduce și mai mult cantitatea reală de date cu imagini:

Aici fața a fost extrasă dintr-o zonă de imagine mai mare până când a fost tăiată în mod economic pentru a include întreaga zonă a feței. Cu toate acestea, așa cum se vede în partea dreaptă, o mare parte a zonei rămase nu va fi utilizată în timpul antrenării, ceea ce adaugă o greutate și mai mare importanței calității imaginii redimensionate.

Pe măsură ce capacitățile GPU s-au îmbunătățit în ultimii ani, cu noile generații de carduri NVIDIA echipate cu cantități crescute de video-RAM (VRAM), dimensiunile medii ale imaginilor contribuitoare încep să crească, deși 224×224 pixeli rămâne un standard (de exemplu, este dimensiunea setului de date ResNet-50).

O imagine de 224×244 pixeli fără redimensionare.

Încărcarea Bazelor în VRAM

Motivul pentru care imaginile trebuie să aibă toate aceeași dimensiune este acela că coborârea gradientului, metoda prin care modelul se îmbunătățește în timp, necesită date de antrenare uniforme.

Motivul pentru care imaginile trebuie să fie atât de mici este acela că ele trebuie să fie încărcate (decomprimate complet) în VRAM în timpul antrenării, în loturi mici, de obicei între 6-24 de imagini pe lot. Prea puține imagini pe lot, și nu există suficient material de grup pentru a generaliza bine, în plus față de prelungirea timpului de antrenare; prea multe, și modelul poate să nu obțină caracteristicile și detaliile necesare (a se vedea mai jos).

Această secțiune “de încărcare live” a arhitecturii de antrenare se numește spațiu latent. Acesta este locul în care caracteristicile sunt extrase în mod repetat din aceleași date (adică aceleași imagini) până când modelul a convergent către o stare în care are toate cunoștințele generalizate necesare pentru a efectua transformări ulterioare pe date nevizionate de același tip.

Acest proces poate dura zile, deși poate dura chiar și o lună sau mai mult de cogitație constantă și neîntreruptă de înalt volum 24/7 pentru a obține o generalizare utilă. Creșterile în dimensiunea VRAM sunt utile doar până la un anumit punct, deoarece chiar și creșterile minore ale rezoluției imaginii pot avea un efect de ordinul de mărime asupra capacității de procesare și efecte asupra acurateței care nu sunt întotdeauna favorabile.

Utilizarea unei capacități mai mari de VRAM pentru a permite dimensiuni de lot mai mari este, de asemenea, o binecuvântare amestecată, deoarece vitezele de antrenare mai mari obținute prin aceasta sunt probabil să fie compensate de rezultate mai puțin precise.

Prin urmare, deoarece arhitectura de antrenare este atât de limitată, orice lucru care poate efectua o îmbunătățire în cadrul limitărilor existente ale pipeline-ului este o realizare notabilă.

Cum Ajută Redimensionarea Superioară

Calitatea finală a unei imagini care va fi inclusă într-un set de date de antrenare a fost dovedită a avea un efect de îmbunătățire asupra rezultatului antrenării, în special în task-urile de recunoaștere a obiectelor. În 2018, cercetători de la Institutul Max Planck pentru Sisteme Intelligente au susținut că alegerea metodei de reeșantionare are un impact semnificativ asupra performanței și rezultatelor antrenării.

În plus, lucrări anterioare de la Google (co-scrise de autorii noului articol) au descoperit că acuratețea clasificării poate fi îmbunătățită prin menținerea controlului asupra artefactelor de compresie în imaginile setului de date.

Modelul CNN integrat în noul redimensionator combină redimensionarea bilineare cu o caracteristică “skip connection” care poate incorpora ieșirea din rețeaua antrenată în imaginea redimensionată.

În contrast cu o arhitectură tipică encoder/decoder, noua propunere poate acționa nu numai ca un bottleneck feed-forward, ci și ca un bottleneck invers pentru redimensionare la orice dimensiune și/sau raport de aspect țintă. În plus, metoda “standard” de reeșantionare poate fi înlocuită cu orice altă metodă tradițională adecvată, cum ar fi Lanczos.

Detalii de Înaltă Frecvență

Noua metodă produce imagini care, în esență, par să “coacă” caracteristici cheie (care vor fi recunoscute în cele din urmă de procesul de antrenare) direct în imaginea sursă. În termeni estetici, rezultatele sunt neconvenționale:

Noua metodă aplicată pe patru rețele – Inception V2; DenseNet-121; ResNet-50; și MobileNet-V2. Rezultatele metodei de redimensionare a imaginilor Google Research produc imagini cu agregare de pixeli evidentă, anticipând caracteristicile cheie care vor fi discernute în timpul procesului de antrenare.

Cercetătorii notează că aceste experimente inițiale sunt optimizate exclusiv pentru task-uri de recunoaștere a imaginilor și că, în testele lor, “redimensionatorul învățat” bazat pe CNN a fost capabil să obțină rate de eroare îmbunătățite în astfel de task-uri. Cercetătorii intenționează să aplice metoda în viitor și la alte tipuri de aplicații de viziune computațională bazate pe imagini.