Lideri de opinie

De la cod la vindecare: Următoarea revoluție AI are nevoie de o mână (și de ochi)

Cum sistemele agențice, ochelarii inteligenți XR și robotica vor împuternici oamenii, nu îi vor înlocui

Trăim o paradoxă în inteligența artificială.

Pe ecrane, IA este supraomenească. Modelele de limbaj mari scriu cod funcțional Python în secunde. Sistemele generative produc imagini și videoclipuri fotorealiste în minute. Sistemele câștigătoare ale Premiului Nobel, cum ar fi AlphaFold, au prezis structurile a aproape toate proteinele cunoscute. Victoriile digitale se înmulțesc.

Însă, în lumea fizică a cercetării biomedicale, procesul de descoperire rămâne extrem de manual. Nu simțim cu adevărat că IA accelerează știința sau medicina, cel puțin nu încă. Numerele revelează profunzimea problemei. Un sondaj de referință al revistei Nature, realizat pe un eșantion de peste 1.500 de oameni de știință, a constatat că mai mult de 70% au încercat și au eșuat în a reproduce experimentele altui cercetător. Mai îngrijorător: mai mult de jumătate nu au putut reproduce propria lor muncă. În biologia cancerului, în special, un proiect de reproductivitate pe opt ani a constatat că doar 40% din descoperirile cu impact ridicat au putut fi replicate și 68% din experimente au lipsit de documentație suficientă pentru a încerca reproducerea.

Acesta este secretul murdar al științei moderne: nu avem o problemă de descoperire, ci o problemă de capturare a cunoștințelor. Detalii experimentale critice trăiesc în mintea cercetătorilor, nu în articole. Protocoalele se schimbă. Cunoașterea tacită iese pe ușă atunci când stagiarii absolvă. Sistemele IA antrenate pe literatura publicată moștenesc toate aceste lacune.

Problema fundamentală este că, deși o IA poate proiecta o proteină nouă pentru terapia cancerului într-o simulare digitală, nu poate lua o pipetă pentru a o testa. Nu poate naviga în realitatea murdară și imprevizibilă a unui laborator umed pentru a-și valida propria ipoteză. Nu poate urmări mâinile unui om de știință experimentat și învăța tehniciile subtile care fac experimentele să funcționeze.

Această “lacună de execuție” este cel mai mare blocaj care împiedică revoluția IA să devină o revoluție medicală. În timp ce majoritatea companiilor de robotică sunt încă ocupate să învețe mașinile să împătureze rufe sau să încarce mașinile de spălat vase, rămân în urmă în ceea ce privește capacitățile cu adevărat transformatoare ale acestor progrese în domenii precum medicina.

Pentru a rezolva această problemă, trebuie să mergem dincolo de chatbot-uri și spre IA Co-Oameni de știință, sisteme agențice care fac punte între lumea digitală și cea fizică, mergând dincolo de planificare și codare și în execuția din lumea reală. La Stanford, dezvoltăm LabOS, un cadru digital-fizic IA care demonstrează cum agenții IA, ochelarii inteligenți XR și robotica colaborativă pot uni pentru a închide acest cerc, transformând experimentele științifice într-o conversație colaborativă între om și mașină, capturând în același timp cunoașterea care în prezent se pierde.

Marea diviziune: De ce IA are nevoie de “ochi” și “mâini”

Multe dintre cele mai vizibile victorii ale IA s-au întâmplat acolo unde mediul este pe deplin digital: depozite de cod, seturi de date curate sau benchmark-uri simulate (unde IA concurează pentru a conduce o afacere virtuală sau pentru a investi digital în acțiuni).

Laboratoarele umede sunt diferite. Biologia, și în general, descoperirea științifică, este un proces foarte zgomotos. Instrumentele se abat, operatorii improvizează, iar “protocolul” trăiește adesea parțial în mintea oamenilor. Diferența dintre un rezultat curat și un rulaj eșuat poate fi un unghi de pipetare, un model de vortex, o substituție de reagent sau o incubare care a durat 10 minute mai mult. Aceste detalii contextuale rareori ajung într-un articol și sunt exact ceea ce un model IA are nevoie pentru a generaliza dincolo de un set de date.

De aceea, IA de laborator are nevoie de ochi (pentru a percepe ce se întâmplă în context), mâini (pentru a standardiza și a automatiza pași cu variație ridicată) și memorie (pentru a înregistra ce s-a întâmplat realmente). Fără aceste capacități, modelele pot recomanda ce să facă, dar nu pot traduce în mod fiabil recomandări în execuție fizică validată sau explica eșecurile atunci când realitatea se abate de la plan.

Dincolo de chatbot-uri: De la copiloți la co-om de știință

Termenul “IA agențică” este uneori folosit în mod vag. În medii biomedicale, ar trebui să însemne ceva precis: un sistem care poate lua un obiectiv (de exemplu, “optimiza eficiența editării genice CRISPR, minimizând țintele nedorite”), descompune-l într-o secvență de sarcini, execute aceste sarcini pe instrumente, evalueze rezultatele și adapteze planul sub constrângeri și cu decizii auditable.

Acest lucru contează pentru că fluxurile de lucru ale cercetării nu sunt un singur apel de model. Sunt conducte de capăt la capăt care acoperă formularea ipotezei, proiectarea experimentală, prelucrarea datelor, testarea statistică și interpretarea. Gândirea recentă în descoperirea de medicamente a început să sublinieze sisteme agențice care pot scala aceste conducte, mai degrabă decât să accelereze doar pași individuali (de exemplu, discuția Unite.AI despre agenți în descoperirea de molecule mici).

În ingineria software, am văzut deja dovezi empirice timpurii că copiloții IA pot crește productivitatea dezvoltatorilor. În biomedicină, oportunitatea analogă nu este doar scrierea de cod, ci și scrierea și validarea protocoalelor, structurarea datelor, monitorizarea execuției și închiderea buclei dintre predicție și măsurare, conectând IA la oamenii de știință din laboratoare.

LabOS: Când IA rulează pe un sistem de operare pentru laboratoarele de mâine

În munca noastră de la Stanford pe AI4Science, care acoperă copiloți de editare a genelor precum CRISPR-GPT și sisteme de co-execuție IA-XR precum LabOS, care ajută oamenii de știință în laboratoarele de biomedicină și știință a materialelor, am explorat o schimbare arhitecturală:

1. Proiectarea unui “sistem de operare de laborator” care leagă un laborator digital (uscat) de un laborator fizic (umed).

Premisa este simplă: dacă o carte de laborator este memoria științei, atunci un sistem de operare de laborator ar trebui să fie stratul de execuție, capturând intenția, traducând-o în acțiuni, observând rezultatele și transformând fiecare rulaj în cunoaștere structurată.

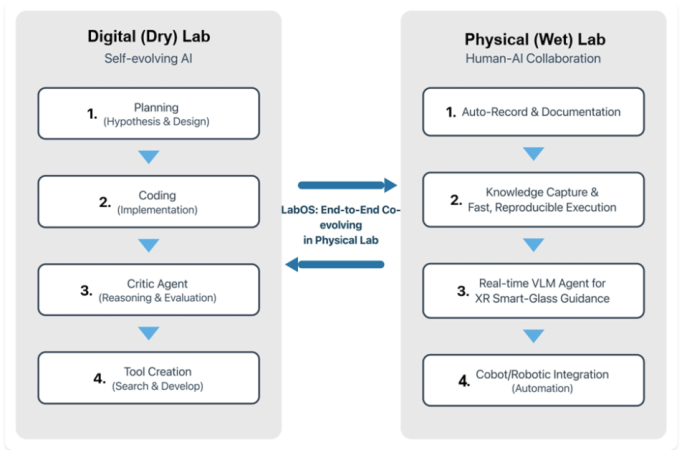

Figură. O vedere conceptuală a LabOS care leagă o buclă digitală auto-evoluantă (planificare, codare, critică, creare de instrumente) cu o buclă uman-IA din laboratorul umed (auto-documentare, capturare de cunoaștere, îndrumare XR și integrare robotică).

2. IA în laboratorul digital – Planificare și construire de instrumente auto-îmbunătățite

În laboratorul digital (uscat), putem lăsa IA să facă ceea ce face deja bine: să caute, să sintetizeze și să propună. Dar vrem și să fie auto-îmbunătățită. Nu prin “halucinarea de știință nouă”, ci prin învățarea de instrumente și fluxuri de lucru mai bune din feedback.

O buclă practică de laborator digital poate fi structurată în patru etape recurente:

- Planificare (ipoteză + design): propune ipoteze, selectează variabile experimentale, anticipă confundători și specifică puncte de terminare măsurabile.

- Codare (implementare): generează sau adaptează scripturi de analiză, conducte de simulare și șabloane de control al instrumentelor acolo unde este cazul.

- Agenții critici (raționament + evaluare): testează asumpțiile, verifică puterea statistică, propune controale și semnalează moduri de eșec probabil.

- Crearea de instrumente (căutare + dezvoltare): atunci când fluxul de lucru lipsește un component (un parser, o rutină de control al calității, un dashboard), construiește-l și adaugă-l înapoi în trusa de instrumente.

3. IA în laboratorul fizic – IA cu “ochi” (ochelari XR) și “mâini” (robotică)

Laboratorul fizic (umed) este locul unde sistemul câștigă încredere – sau o pierde. Obiectivul nu este să înlocuiască omul de știință, ci să reducă frecarea și eroarea, în timp ce crește observabilitatea.

Vedem bucla laboratorului fizic ca patru capacități complementare:

- Înregistrare automată și documentare: capturează acțiuni, timpi de executare, setări de instrumente și abateri automate, astfel încât documentarea să nu fie o gândire de după.

- Capturarea cunoașterii pentru execuție rapidă și reproductibilă: convertește rulajele în artefacte structurate și interogabile (versiuni de protocol, seturi de parametri, rezultate QC) aliniate cu principiile de administrare a datelor, cum ar fi FAIR.

- Îndrumare în timp real prin ochelari inteligenți XR: utilizează modele multimodale pentru a interpreta scena (ce face operatorul, care reagent este în mână) și oferă îndrumare pas cu pas și verificări de siguranță. AR/XR a demonstrat deja valoarea în fluxuri de lucru fizice cu risc ridicat, cum ar fi îndrumarea experimentală (LabOS, Stanford, Princeton, în colaborare cu NVIDIA).

- Integrarea cobot/robotică pentru automatizare: standardizează pașii repetitivi, permite predarea în siguranță și reduce variabilitatea. Platformele pentru fluxuri de lucru de la simulare la real (de exemplu NVIDIA Isaac) și procesarea IA în timp real la margine, cum ar fi transmisia în direct a ochelarilor inteligenți și interacțiunea om-IA în LabOS, sunt straturi de susținere importante.

Această arhitectură se aliniază cu o direcție mai largă în domeniu: “laboratoare autonome” sau “laboratoare autodirijate” care combină automatizarea cu învățarea mașinilor pentru a planifica următorul experiment. Ceea ce adaugă LabOS este un strat de interfață umană mai strâns, astfel încât autonomia să nu vină la costul transparenței.

De ce IA de laborator nu este doar “IA pe un set de date”

Sistemele IA pentru superinteligență științifică/biomedicală adesea par impresionante în evaluarea retrospectivă sau la examene, și apoi subperformează în laboratorul fizic. Motivul nu este niciodată o singură eroare. Este de obicei o nepotrivire între asumpțiile modelului și realitatea laboratorului.

Trei lacune apar în mod repetat:

- Lacună de context: seturile de date omit adesea variabilele contextuale pe care operatorii le știu importante (abateri de temperatură, numere de lot de reagenți, deviații subtile de protocol).

- Lacună de acțiune: multe sisteme IA pot recomanda ce să facă, dar nu pot traduce în mod fiabil această recomandare în pași fizici valabili.

- Lacună de feedback: fără feedback structurat și de înaltă calitate de la execuție, modelele nu pot învăța unde eșuează – și oamenii de știință nu pot audita de ce.

Închiderea acestor lacune nu este despre inventarea unei noi arhitecturi de rețea neuronală, ci despre construirea instrumentației, interfețelor și contractelor de date care fac laboratorul lizibil pentru mașini și permit IA să vadă și să lucreze cu oamenii.

Încredere prin design: Siguranță și guvernanță pentru IA care poate acționa

IA agențică în cercetarea de descoperire nu ridică doar preocupări familiare despre acuratețe. Introduce noi moduri de eșec pentru că poate acționa. Într-un laborator, acțiunea înseamnă potențialul de a genera deșeuri, de a dăuna sau de a conduce la concluzii înșelătoare, mai ales atunci când experimentele alimentează ipoteze clinice.

O mentalitate utilă este să tratezi o stivă de laborator IA-permisivă ca un sistem socio-tehnic care necesită asigurare. Mai multe cadre existente ajută, dar trebuie traduse în realitatea laboratorului:

- Managementul riscului ca o practică continuă: Cadrul de management al riscului IA al NIST (AI RMF 1.0) oferă un vocabular practic pentru cartografierea, măsurarea și gestionarea riscului IA pe parcursul întregului ciclu de viață.

- Alinierea regulamentară pentru IA medicală: lucrarea FDA privind IA/ML Software ca dispozitiv medical (SaMD), inclusiv Planul de acțiune și ghidurile conexe, oferă o vedere concretă a ceea ce “bunele practici” arată atunci când IA impactează îngrijirea pacienților.

Pentru domenii cu consecințe ridicate, cum ar fi editarea genică, guvernanța este deja o conversație globală. Se discută recomandări privind editarea genomului uman, subliniind nevoia de mecanisme de supraveghere adecvate și guvernanță responsabilă, cum ar fi cele propuse de Societatea Americană pentru Terapie Genică și Celulară, sau ASGCT. Sisteme precum LabOS ar trebui să fie proiectate pentru a face respectarea mai ușoară, nu mai grea.

Lista de verificare: Controale pentru IA Co-om de știință sigură pentru descoperire științifică

În opinia noastră, un sistem de operare de laborator sigur ar trebui să implementeze cel puțin următoarele proiecte:

- Proveniență implicită: fiecare set de date, versiune de protocol și ieșire a modelului ar trebui să poată fi urmărită până la intrări și timpi de executare.

- Autonomie limitată: sistemul ar trebui să aibă permisiuni explicite (ce poate face fără confirmare) și reguli de escaladare (când trebuie să ceară).

- Anulare umană și degradare grațioasă: atunci când senzorii sau fluxurile de date eșuează, sau incertitudinea este ridicată, sistemul ar trebui să revină la un mod mai sigur, mai simplu.

- Validare continuă: predicțiile în silico ar trebui să fie pereche cu validarea fizică a laboratorului; rulajele fizice din laborator ar trebui să includă porți de control al calității înainte de a permite concluzii să se propage în aval înapoi la modelele/agenții IA din lumea digitală.

- Securitate și conștientizarea utilizării duale: protejați infrastructura de laborator de tamperare.

Împuterniciți oamenii peste tot: Poate IA Co-om de știință egaliza terenul de joc?

Una dintre promisiunile cele mai convingătoare ale unui “co-om de știință” IA-XR este nu doar viteza pentru instituțiile de elit, ci și accesibilitatea pentru toată lumea. Luați în considerare ce limitează în prezent laboratoarele mici, startup-urile și clinicele regionale/îndepărtate:

- Acces limitat la expertiză specializată pentru protocoale și instrumente de clasă mondială.

- Costuri mai ridicate relative pentru formare, greșeli și reexecutare.

- Instrumente fragmentate: caiete de laborator, foi de calcul, jurnale de instrumente și scripturi de analiză rareori se conectează curat.

Un sistem care poate ghida execuția în context (prin ochelari XR), captura ce s-a întâmplat în mod automat și sugera următorul pas cel mai bun pe baza rulajelor anterioare ar putea face ca analizele avansate să fie mai reproductibile pe site-uri. În principiu, ar putea susține, de asemenea, cercetarea clinică distribuită în care protocoalele trebuie executate în mod consecvent, chiar și atunci când resursele variază.

Cronologie: Când primește fiecare om de știință și clinician un co-om de știință?

Pe scurt, suntem mai aproape decât cred mulți pentru anumite sarcini de valoare ridicată și frecvență ridicată (cum ar fi producerea unui medicament în mod fiabil în laborator) și mai departe decât sugerează majoritatea demonstrațiilor pentru altele (cum ar fi IA care rezolvă complet probleme mari, cum ar fi cancerul sau boala Alzheimer). O hartă realistă arată astfel:

- Pe termen scurt (într-un an): Copiloți de flux de lucru care reduc încărcătura administrativă: redactarea protocolului, sinteza literaturii, șabloanele de analiză și rapoartele automate de control al calității. Factorul limitativ este integrarea, nu capacitatea modelului.

- Pe termen mediu (1-2 ani): Sisteme de co-execuție în laborator: îndrumare prin ochelari XR, documentare automată și robotică selectivă pentru pași cu variație ridicată. Încrederea va depinde de urmele de audit și de proiectarea strânsă a buclei umane.

- Pe termen lung (3+ ani): Co-cercetători interdisciplinari care leagă descoperirea de traducere: conectarea datelor de laborator la puncte de terminare clinice, monitorizarea semnalelor de siguranță și ajutarea la proiectarea studiilor – în timp ce se respectă așteptările regulatorii și etice.

De la cod la vindecare: Calea înainte pentru descoperirea științifică de 1000 de ori

LabOS este o încercare de a răspunde la o întrebare simplă: și ce dacă un experiment ar putea fi rulat ca o conversație, unde intenția, execuția și dovezi sunt conectate de la capăt la capăt? Dacă construim aceste sisteme bine, pot ajuta la abordarea lacunei de traducere care încetinește biomedicina și multe discipline științifice fizice (de exemplu, știința materialelor). Dacă le construim prost, vor amplifica ireproducibilitatea și vor crea noi riscuri de siguranță.

Cel mai important lucru în următorii ani va fi fondational: interfețe de date și dispozitive standardizate prin construirea sistemului de operare (similar cu iOS, care rulează toate tipurile de aplicații), construirea benchmark-urilor IA care includ execuția și incertitudinea (cum ar fi benchmark-ul LabSuperVision din LabOS) și începerea implementării în lumea reală, care încurajează inovația, protejând în același timp pacienții și integritatea cercetării.

Pentru cercetători și clinicieni, întrebarea nu este dacă IA va intra în laborator. Deja a făcut-o. Întrebarea este dacă o vom integra ca o colecție de unelte desconectate sau ca un sistem de încredere, proiectat pentru realitățile științei biomedicale.

Citire și surse sugerate

- Sondaj de reproductivitate (Nature, 2016): https://www.nature.com/articles/533452a

- Articolul CRISPR-GPT peer-review (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Știri de la Stanford Medicine despre CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- Preprint LabOS (arXiv): https://arxiv.org/abs/2510.14861

- Site-ul LabOS și benchmark-ul LabSuperVision: https://ai4lab.stanford.edu

- Cadrul de management al riscului IA al NIST (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- Prezentarea generală a FDA privind IA/ML Software ca dispozitiv medical: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- Principiile de date FAIR (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI despre blocajele din descoperirea de molecule mici: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI despre IA și chirurgie robotică: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/