Unghiul lui Anderson

Adăugarea de dialog la videoclipuri reale cu ajutorul IA

O nouă arhitectură IA poate rescrie, șterge sau adăuga cuvintele unei persoane într-un videoclip fără a fi necesară refilmarea, într-un sistem de la capăt la coadă.

Acum trei ani, internetul ar fi fost șocat de oricare dintre cele 20-30 de cadre de editare video IA care sunt publicate săptămânal în portaluri academice; după cum stau lucrurile, această ramură populară de cercetare a devenit atât de prolifică, încât aproape constituie o altă ramură a ‘IA Slop’, și eu acoper mai puține astfel de lansări decât aș fi făcut cu doi sau trei ani în urmă.

Cu toate acestea, o lansare recentă în această direcție a atras atenția mea: un sistem integrat care poate interveni în clipuri video reale și introduce noi replici în videoclipul existent (și nu creează un clip generativ întreg dintr-o față sau cadru, ceea ce este mult mai frecvent).

În exemplele de mai jos, pe care le-am editat împreună din multe clipuri video disponibile pe site-ul proiectului proiectului, vedem mai întâi clipul sursă real, și apoi, sub el, replicile impuse de IA în mijlocul clipului, incluzând sinteză vocală și sincronizare buzelor:

Apăsați pentru a reda. Editare locală cu coasere – una dintre modalitățile oferite de FacEDiT. Vă rugăm să consultați site-ul sursă pentru o rezoluție mai bună. Source – https://facedit.github.io/

Acestă abordare este una dintre cele trei dezvoltate pentru noua metodă, aceasta fiind intitulată ‘editare locală cu coasere’, și cea care îi interesează cel mai mult pe autori (precum și pe mine). Esențial, clipul este extins prin utilizarea uneia dintre cadrele din mijloc ca punct de plecare pentru interpretarea IA nouă, și a următoarei (reale) cadre ca scop pe care clipul generativ introdus ar trebui să îl atingă. În clipurile de mai sus, aceste ‘semințe’ și ‘ținte’ cadre sunt reprezentate de videoclipul superior care se oprește, în timp ce videoclipul modificat de mai jos oferă umplerea generativă.

Autorii prezintă această abordare de sinteză facială și vocală ca primul sistem complet integrat de la capăt la coadă pentru editarea video IA de acest fel, observând potențialul unui cadru complet dezvoltat, cum ar fi acesta, pentru producția de televiziune și film:

‘Cineaștii și producătorii media trebuie adesea să revizuiască părți specifice ale videoclipurilor înregistrate – poate un cuvânt a fost pronunțat greșit sau scenariul a fost schimbat după filmare. De exemplu, în scena iconică din Titanic (1997) în care Rose spune, “I’ll never let go, Jack,” regizorul ar putea decide mai târziu că ar trebui să fie “I’ll never forget you, Jack”.

‘În mod tradițional, astfel de modificări necesită refilmarea întregii scene, ceea ce este costisitor și consumator de timp. Sinteza feței care vorbește oferă o alternativă practică prin modificarea automată a mișcării feței pentru a se potrivi cu discursul revizuit, eliminând nevoia de refilmări.’

Deși intervențiile IA de acest fel pot întâmpina rezistență culturală sau industrială, ele pot constitui, de asemenea, un nou tip de funcționalitate în sistemele și seturile de instrumente VFX conduse de oameni. În orice caz, pentru moment, provocările sunt strict tehnice.

Pe lângă extinderea unui clip prin dialogul generat de IA suplimentar, noul sistem poate modifica, de asemenea, discursul existent:

Apăsați pentru a reda. Un exemplu de schimbare a discursului existent, în loc de introducerea de dialog suplimentar. Vă rugăm să consultați site-ul sursă pentru o rezoluție mai bună.

Stadiul actual

Nu există în prezent sisteme de la capăt la coadă care să ofere această capacitate de sinteză; deși o serie tot mai mare de platforme de IA generativă, cum ar fi seria Veo de la Google, poate genera audio, și diverse alte cadre pot crea audio deepfake, în prezent trebuie să creați o serie destul de complexă de arhitecturi și trucuri diverse pentru a interveni în materialele reale în felul în care noul sistem – intitulat FacEDiT – poate realiza.

Sistemul utilizează Transformatori de difuziune (DiT) în combinație cu Corespondență de flux pentru a crea mișcări faciale condiționate de mișcările și conținutul audio din jur. Sistemul utilizează pachetele existente populare care se ocupă de reconstrucția facială, incluzând LivePortrait (recent preluat de Kling).

Pe lângă această metodă, dat fiind că abordarea lor este prima care integrează aceste provocări într-o singură soluție, autorii au creat o nouă benchmark intitulată FacEDiTBench, împreună cu mai multe metrici de evaluare complet noi, potrivite pentru această sarcină foarte specifică.

Noua lucrare este intitulată FacEDiT: Editare și generare unificată a feței care vorbește prin umplerea mișcării faciale, și provine de la patru cercetători de la Universitatea Științifică și Tehnologică Pohang (POSTECH) din Coreea, Institutul Avansat de Știință și Tehnologie (KAIST) și Universitatea Texasului din Austin.

Metodă

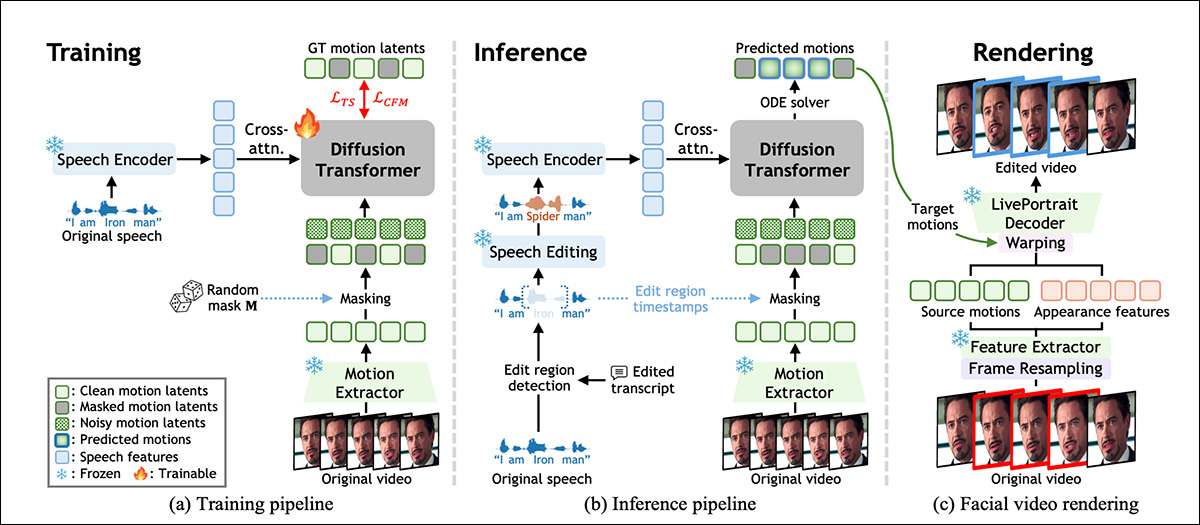

FacEDiT este antrenat pentru a reconstrui mișcarea facială prin învățarea modului de umplere a părților lipsă ale performanței originale a actorului, pe baza mișcării din jur și a conținutului audio. Așa cum se arată în schema de mai jos, acest proces permite modelului să acționeze ca un umplutor de goluri în timpul antrenamentului, prevăzând mișcări faciale care se potrivesc cu vocea, în timp ce rămân consecvente cu videoclipul original:

Prezentarea generală a sistemului FacEDiT, care arată cum mișcarea facială este învățată prin umplerea auto-supervizată în timpul antrenamentului, ghidată de discursul editat la inferență și, în final, redată înapoi în videoclip prin reutilizarea aspectului materialului original, în timp ce se înlocuiește doar mișcarea țintă. Sursă

La momentul inferenței, aceeași arhitectură susține două ieșiri diferite, în funcție de cât de mult din videoclip este mascat: editări parțiale, unde doar o frază este alterată și restul este lăsat neatins; sau generare de propoziții complete, unde o nouă mișcare este sintetizată în întregime de la zero.

Modelul este antrenat prin corespondență de flux, care tratează editările video ca o specie de cale între două versiuni de mișcare facială.

În loc de a învăța să ghicească cum ar trebui să arate o față editată de la zero, corespondența de flux învață să se deplaseze treptat și lin între un placeholder zgomotos și mișcarea corectă. Pentru a facilita acest lucru, sistemul reprezintă mișcarea facială ca un set compact de numere extrase din fiecare cadru, utilizând o versiune a sistemului LivePortrait menționat anterior (a se vedea schema de mai sus).

Aceste vectori de mișcare sunt proiectați pentru a descrie expresii și poziția capului fără a încurca identitatea, astfel încât schimbările de discurs să poată fi localizate fără a afecta apariția generală a persoanei.

Antrenamentul FacEDiT

Pentru a antrena FacEDiT, fiecare clip video a fost împărțit într-o serie de instantanee de mișcare facială, și fiecare cadru a fost asociat cu bucata corespunzătoare de audio. Părți ale datelor de mișcare au fost apoi ascunse aleatoriu, și modelul a fost rugat să ghicească cum ar trebui să arate mișcările lipsă, utilizând atât discursul, cât și mișcarea neascunsă din jur, ca context.

Deoarece spanurile mascate și pozițiile lor variază de la un exemplu de antrenament la altul, modelul învață treptat să gestioneze atât editări interne mici, cât și lacune mai lungi, pentru generarea de secvențe complete, în funcție de cât de multă informație primește.

Sistemul așa-numit Diffusion Transformer învață să recupereze mișcarea mascată, prin rafinarea intrărilor zgomotoase în timp. În loc de a introduce discursul și mișcarea în model deodată, audio-ul este introdus în fiecare bloc de procesare prin atenție încrucișată, ajutând sistemul să potrivească mișcările buzelor mai precis cu discursul audio.

Pentru a păstra realismul de-a lungul editărilor, atenția este îndreptată spre cadrele vecine, mai degrabă decât întreaga cronologie, forțând modelul să se concentreze pe continuitatea locală și prevenind flicker-ul sau salturile de mișcare la marginile regiunilor modificate.

În timpul antrenamentului, sistemul învață să prevadă mișcarea facială lipsă, prin reconstruirea spanurilor mascate pe baza discursului și a mișcării neascunse din jur. La momentul inferenței, aceeași configurație este reutilizată, dar cu măștile mascate, acum ghidate de editări în discurs.

Când un cuvânt sau o frază este introdus, eliminat sau schimbat, sistemul localizează regiunea afectată, o maschează și regenerează mișcarea care se potrivește cu noul audio. Generarea de secvențe complete este tratată ca un caz special, unde întreaga regiune este mascată și sintetizată de la zero.

Date și teste

Spina dorsală a sistemului este alcătuită din 22 de straturi pentru Transformatorul de difuziune, fiecare cu 16 capete de atenție și dimensiuni de alimentare înainte și înapoi de 1024 și 2024px. Caracteristicile de mișcare și apariție sunt extrase utilizând componente înghețate LivePortrait, și discursul este codificat prin WavLM și modificat utilizând VoiceCraft.

Un strat de proiecție dedicat mappează caracteristicile de discurs de 786 de dimensiuni în spațiul latent DiT, cu doar DiT și modulele de proiecție antrenate de la zero.

Antrenamentul a fost realizat sub optimizatorul AdamW la o rată de învățare țintă de 1e-4, timp de un milion de pași, pe două GPU-uri A6000 (fiecare cu 48GB de VRAM), la o dimensiune totală de lot de opt.

FacEDiTBench

Setul de date FacEDiTBench conține 250 de exemple, fiecare cu un clip video al discursului original și editat, și transcrierile pentru ambele. Videoclipurile provin din trei surse, cu 100 de clipuri din HDTF, 100 din Hallo3, și 50 din CelebV-Dub. Fiecare a fost verificat manual pentru a confirma că atât audio-ul, cât și videoclipul erau suficient de clare pentru evaluare.

GPT-4o a fost utilizat pentru a revizui fiecare transcriere pentru a crea editări gramaticale valabile. Aceste transcrieri revizuite, împreună cu discursul original, au fost transmise către VoiceCraft pentru a produce noul audio; și la fiecare etapă, atât transcrierea, cât și discursul generat au fost revizuite manual pentru calitate.

Fiecare exemplu a fost etichetat cu tipul de editare, momentul schimbării și lungimea spanului modificat, și editările au fost clasificate ca inserții, ștergeri, sau înlocuiri. Numărul de cuvinte schimbate varia de la editări scurte de 1 până la 3 cuvinte, editări medii de 4 până la 6 cuvinte, și editări mai lungi de 7 până la 10 cuvinte.

Trei metrici personalizate au fost definite pentru a evalua calitatea editării. Continuitatea fotometrică, pentru a măsura cât de bine se amestecă iluminarea și culoarea unui segment editat cu videoclipul din jur, prin compararea diferențelor la nivel de pixel la margini; continuitatea mișcării, pentru a evalua consistența mișcării faciale, prin măsurarea schimbărilor de flux optic între cadre editate și needitate; și păstrarea identității, pentru a estima dacă apariția subiectului rămâne consistentă după editare, prin compararea încorporărilor faciale din secvențele originale și generate, utilizând modelul de recunoaștere facială ArcFace.

Teste

Modelul de testare a fost antrenat pe material din cele trei seturi de date menționate anterior, totalizând aproximativ 200 de ore de conținut video, incluzând bloguri video și filme, precum și videoclipuri de înaltă rezoluție de pe YouTube.

Pentru a evalua editarea feței care vorbește, FacEDiTBench a fost utilizat, împreună cu divizia de testare HDTF, care a devenit un standard de referință pentru această suită de sarcini.

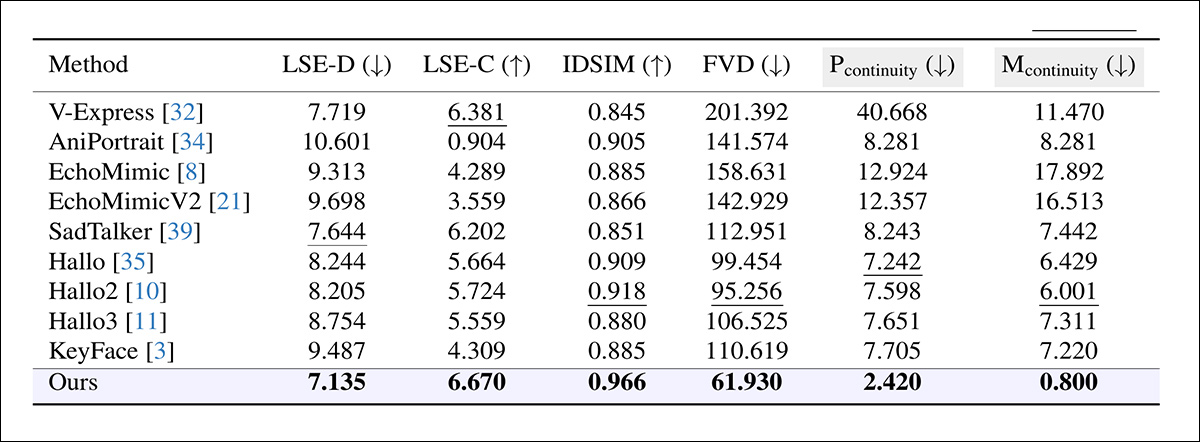

Deoarece nu existau sisteme direct comparabile capabile să încorporeze această funcționalitate de la capăt la coadă, autorii au ales o varietate de cadre care să reproducă cel puțin o parte a funcționalității țintă și care ar putea opera ca linii de bază; și anume, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; și SadTalker.

Câteva metrici stabilite au fost utilizate și pentru a evalua calitatea generării și editării, cu acuratețea sincronizării buzelor evaluată prin SyncNet, raportând atât eroarea absolută între mișcările buzelor și audio (LSE-D), cât și un scor de încredere (LSE-C); Distanța video Fréchet (FVD) care cuantifică cât de realist pare videoclipul în ansamblu; și Metrici de similaritate perceptuală învățate (LPIPS), care măsoară similaritatea perceptuală între cadre generate și originale.

Pentru editare, toate metricile, cu excepția LPIPS, au fost aplicate doar segmentului modificat; pentru generare, întregul videoclip a fost evaluat, cu excepția continuității la margini.

Fiecare model a fost făcut să sintetizeze un segment de videoclip corespunzător, care a fost apoi introdus în clipul original (cercetătorii notează că această metodă a introdus adesea discontinuități vizibile, acolo unde segmentul editat se întâlnește cu materialul din jur). O a doua abordare a fost testată și în care întregul videoclip a fost regenerat de la audio-ul modificat – dar acesta a șters în mod inevitabil regiunile needitate și nu a păstrat performanța originală:

Compararea performanței de editare între sistemele proiectate inițial pentru generarea feței care vorbește, cu FacEDiT care depășește toate liniile de bază în toate metricile, realizând o eroare de sincronizare a buzelor mai mică (LSE-D), o încredere de sincronizare mai mare (LSE-C), o păstrare a identității mai puternică (IDSIM), o realism mai mare (FVD) și tranziții mai netede la marginile editării (Pcontinuity, Mcontinuity). Colonnele umbrite cu gri evidențiază criteriile cheie pentru evaluarea calității marginilor; valorile îngroșate și subliniate indică cele mai bune și, respectiv, cele mai bune două rezultate.

În ceea ce privește aceste rezultate, autorii comentează:

‘[Modelul nostru] depășește semnificativ metodele existente în sarcina de editare. Acesta realizează o continuitate puternică a marginilor și o păstrare puternică a identității, demonstrând capacitatea sa de a menține coerența temporală și vizuală în timpul editării. În plus, acuratețea sa superioară de sincronizare a buzelor și FVD scăzut reflectă realismul videoclipului sintetizat.’

Apăsați pentru a reda. Rezultate, asamblate de mine din videoclipurile publicate pe site-ul proiectului. Vă rugăm să consultați site-ul sursă pentru o rezoluție mai bună.

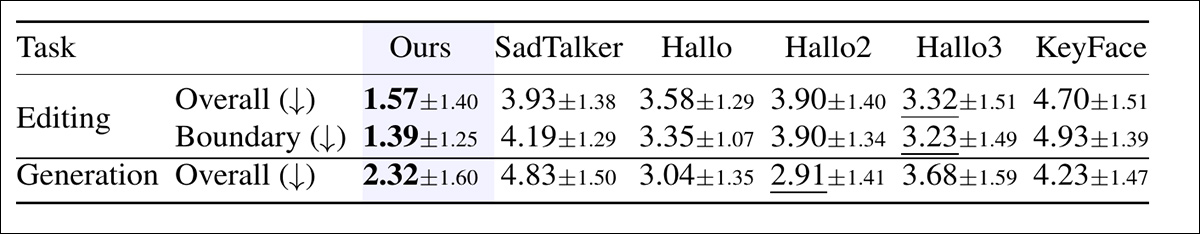

De asemenea, a fost efectuat un studiu uman, pentru a evalua calitatea percepută atât pentru editare, cât și pentru generare.

Pentru fiecare comparație, participanții au vizualizat șase videoclipuri și le-au clasat după calitatea generală, luând în considerare acuratețea sincronizării buzelor, naturalitatea și realismul mișcării capului. În încercările de editare, participanții au evaluat, de asemenea, netezimea tranzițiilor între segmentele editate și needitate:

Mediile clasamentului atribuite de evaluatorii umani, unde mai mic înseamnă mai bine. Atât pentru editare, cât și pentru generare, participanții au evaluat cât de natural și sincronizat a părut fiecare videoclip. Pentru editare, ei au evaluat, de asemenea, cât de netedă a fost tranziția între discursul editat și needitat. Numerele îngroșate și subliniate arată primele și, respectiv, cele mai bune două scoruri.

În studiu, FacEDiT a fost clasat constant pe primul loc, cu o diferență clară, atât pentru calitatea editării, cât și pentru netezimea tranziției, și a primit, de asemenea, scoruri puternice în setarea de generare, ceea ce sugerează că avantajele sale măsurate se traduc în ieșiri perceptual preferate.

Din cauza lipsei de spațiu, ne referim cititorul la lucrarea sursă pentru detalii suplimentare despre studiile de ablație și testele suplimentare care au fost efectuate și raportate în noua lucrare. În realitate, ofertele de cercetare prototipale de acest fel luptă pentru a genera secțiuni de teste semnificative, deoarece oferta în sine este inevitabil o bază potențială pentru lucrări ulterioare.

Concluzie

Chiar și pentru inferență, sistemele de acest fel pot necesita resurse computaționale semnificative la momentul inferenței, ceea ce face dificil pentru utilizatorii din aval – aici, presupunem magazinele de efecte vizuale – să păstreze lucrul pe teren, ceea ce face ca abordările care pot fi adaptate la resurse locale realiste să fie întotdeauna preferate de furnizori, care sunt sub obligația legală de a proteja filmările și proprietatea intelectuală a clienților.

Acest lucru nu este pentru a critica noua ofertă, care poate funcționa perfect sub greutăți cuantificate sau alte optimizări, și care este prima ofertă de acest fel care m-a atras înapoi pe această direcție de cercetare de ceva timp.

A fost publicat pentru prima dată miercuri, 17 decembrie 202. Editat 20.10 EET, în aceeași zi, pentru spațiu suplimentar în primul paragraf.