Unghiul lui Anderson

Ștergerea obiectelor și a persoanelor din videoclipuri cu ajutorul inteligenței artificiale

Nu, copilul nu rămâne în imagine, dacă inteligența artificială are ceva de spus în această privință.

Îndepărtarea persoanelor și a obiectelor din imagini și videoclipuri este o direcție de cercetare populară în literatura de specialitate a inteligenței artificiale, cu o serie tot mai mare de seturi de date și cadre dedicate care abordează această provocare. Ultimul dintre acestea, de la Institutul de Date Mari de la Universitatea Fudan din China, este EffectErase, un sistem de ștergere a obiectelor din videoclipuri “conștient de efecte”, care, după cum susțin autorii, îmbunătățește considerabil starea actuală a tehnologiei în testele efectuate:

Asamblat din materialul de pe site-ul proiectului, exemple ale metodei EffectErase (vă rugăm să rețineți că, deși oferim un link, site-ul sursă conține multe videoclipuri cu rezoluție înaltă și neoptimizate care se autorepetă, ceea ce poate afecta stabilitatea browserului dvs. web. Videoclipul de pe YouTube este o referință mai ușoară și mai completă și este încorporat la sfârșitul acestui articol). Sursă

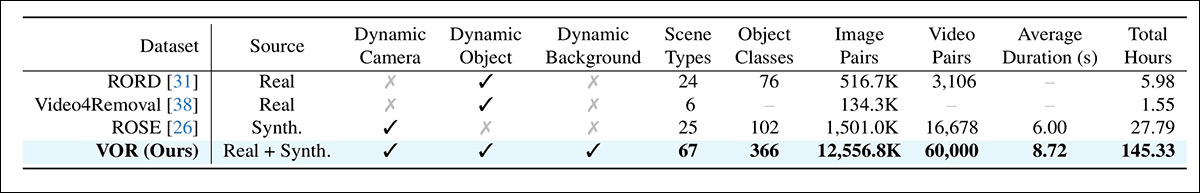

Noua lucrare a implicat crearea și curarea unui set de date semi-novator care cuprinde aproape 350 de scene reale și sintetice originale (folosind repository-uri publice*), fie capturate cu echipamente dedicate, fie sursă și reutilizate într-un flux de lucru construit în jurul cadrelor deschise Blender 3D.

Setul hibrid de ștergere a obiectelor din videoclipuri (VOR) reprezintă baza pentru aplicația EffectErase în sine, care este construită pe sistemul de generare a videoclipurilor Wan2.1. Sistemul definește, de asemenea, două noi repere conexe: VOR Eval și VOR Wild – respectiv, pentru mostre cu și fără adevăr de bază.

(Deși articolul are un site proiect însoțitor, este destul de încărcat cu multiple videoclipuri cu rezoluție înaltă și greu de încărcat; așa că vă rog să consultați extrasele pe care le-am curățat în videoclipul încorporat mai sus, dacă găsiți site-ul proiectului dificil de utilizat)

O comparație a cantităților din seturile de date comparabile, în raport cu noua ofertă. Sursă

Cercetătorii susțin că abordarea lor oferă o performanță de ultimă generație, atât în ceea ce privește metricile cantitative, cât și rezultatele calitative, așa cum au fost evaluate printr-un studiu uman.

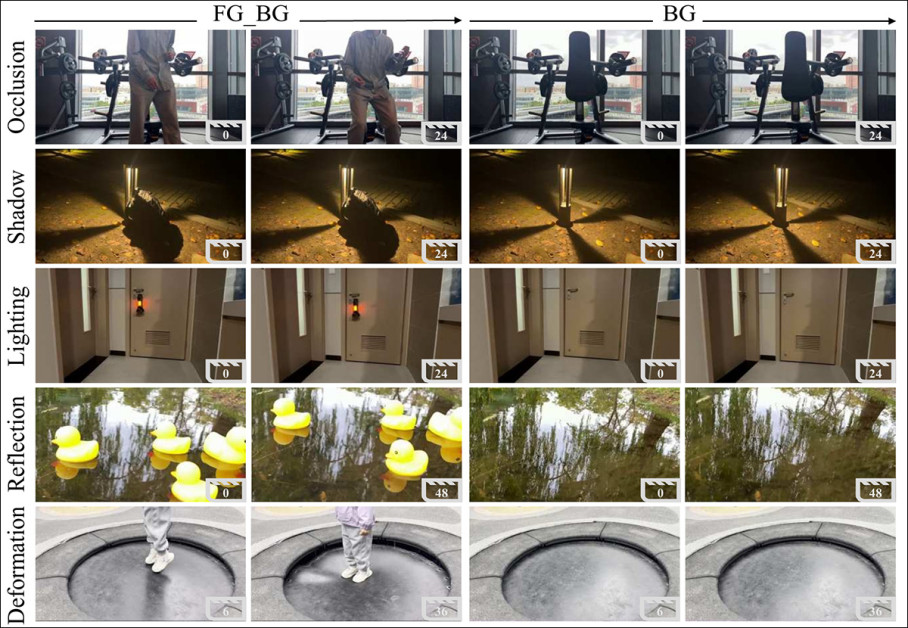

Ei observă că lucrările anterioare nu au reușit întotdeauna să îndepărteze efectele secundare ale unui obiect, cum ar fi umbrele și reflexiile, și că setul lor de date a fost creat cu atenție pentru a remedia această lacună:

Exemple ale modului în care abordările anterioare nu au reușit să depășească obiectul căutat pentru îndepărtare, pentru a ajunge la indicații secundare, cum ar fi reflexiile și umbrele.

Noul articol, intitulat EffectErase: Ștergerea și inserarea obiectelor din videoclipuri pentru ștergerea efectelor de înaltă calitate, provine de la patru cercetători de la Facultatea de Științe ale Calculatoarelor și Inteligență Artificială a Universității Fudan.

Metodă

Setul hibrid de ștergere a obiectelor din videoclipuri a fost conceput pentru a cuprinde un spectru suficient de larg de scenarii, astfel încât să acopere toate implicațiile încercării de a îndepărta o persoană sau un obiect dintr-un videoclip:

Cadrul pereche din setul de date VOR ilustrează modul în care îndepărtarea obiectului trebuie să depășească obiectul vizibil pentru a ajunge la efectele sale induse, cu exemple care arată ocluziune, umbră, schimbări de iluminare, reflexii și deformări fizice, prezentate ca intrare (obiect prezent) alături de fundalul curat corespunzător după îndepărtare. Pentru exemple suplimentare, vă rugăm să consultați videoclipul YouTube încorporat la sfârșitul acestui articol.

Cele cinci tipuri reprezentative de “interferență” care trebuie abordate sunt definite de autori ca ocluziune, incluzând diverse tipuri de ocluziune cu sticlă și fum; umbră; iluminare (de exemplu, atunci când un obiect care trebuie îndepărtat creează sau alterează calea luminii); reflexie; și deformare (de exemplu, amprenta unei persoane pe o pernă, care nu ar trebui să supraviețuiască îndepărtării persoanei).

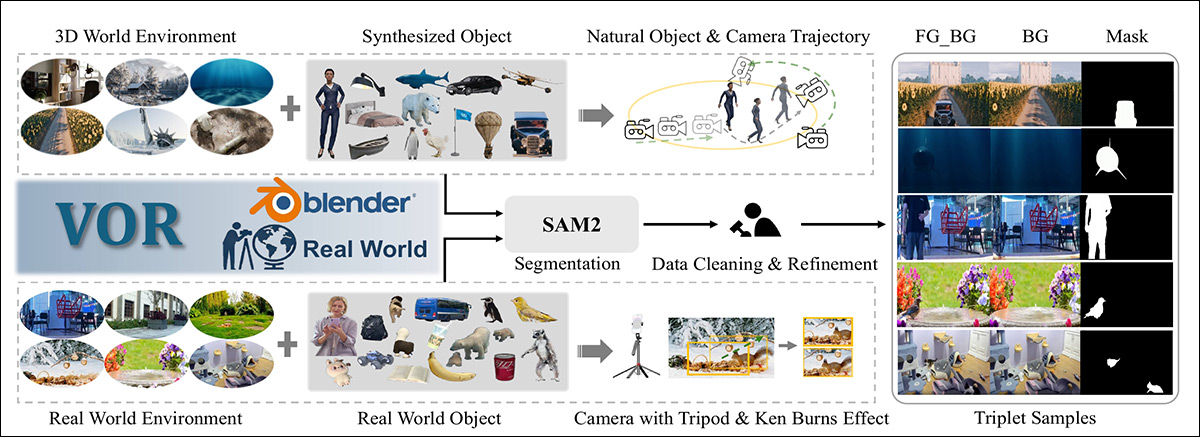

Pipeline de construire a setului de date VOR, care combină scene sintetice generate cu Blender cu capturi din lumea reală, unde datele sintetice sunt construite din medii 3D, obiecte și traiectorii de cameră curate, și filmări reale înregistrate în diverse scene, completate cu mișcarea Ken Burns. Segmentarea SAM2 și rafinarea manuală produc apoi tripleți de videoclipuri aliniate cu măști corespunzătoare.

Pentru datele reale originale, cercetătorii au folosit camere fixe pentru a înregistra scene “cu” și “fără” care acoperă o gamă largă de medii, ore ale zilei și condiții meteorologice.

Pentru datele sintetice, au fost generate multiple puncte de vedere și au fost create scenarii cu mai multe obiecte, care prezintă intenționat tipuri complexe și provocatoare de mișcare a camerei, așa cum ar apărea în filmări din lumea reală; și cercetătorii observă că această abordare este mai sofisticată și mai solicitantă decât cea utilizată pentru setul de date Remove Objects with Side Effects in Videos (ROSE).

Pentru a crește diversitatea mișcării, a fost aplicat efectul Ken Burns perechilor de filmări, adăugând panorame, zoom-uri și mișcări ușoare ale camerei sub paisprezece reguli predefinite, cu cinci modele de mișcare eșantionate pe pereche, menținând recolta în cadrul original.

Scalabilitatea și diversitatea au fost extinse și mai mult prin combinarea obiectelor sintetice cu multiple configurații de cameră, măștile fiind generate prin plasarea de puncte de referință manuale pe cadre cheie, propagarea segmentării cu Segment Anything 2 (SAM2), curățarea și rafinarea rezultatelor, și asamblarea tripletelor validate de fundal, prim-plan și măști pentru antrenament.

Colecția finală cuprinde 145 de ore de videoclipuri pe 60.000 de perechi de videoclipuri, reale și sintetice, care acoperă 366 de clase de obiecte în 443 de scene.

Rețeaua EffectErase în sine ingerează material prin intermediul unui Variational Auto-Encoder (VAE)†, cu zgomotul latent tratat de Wan2.1. Pe această bază, EffectErase funcționează cu Învățarea comună a ștergerii și inserării, care antrenează ambele sarcini împreună pe aceleași regiuni; Îndrumarea regiunii conștientă de sarcină (TARG), care utilizează tokeni de obiect și sarcină cu atenție încrucișată pentru a modela legăturile spațio-temporale dintre obiecte și efectele lor și pentru a permite comutarea sarcinilor; și Pierderea consistenței efectului, care aliniază regiunile efectului aliniate pe sarcinile de ștergere și inserare:

<img class=" wp-image-394161" src="https://www.unite.ai/wp-content/uploads/2026/03/figure-6.jpg" alt="Schema cadrului EffectErase. În timpul antrenamentului, perechile de videoclipuri sunt codificate într-un spațiu latent comun, fuzionate cu zgomot și procesate de un transformator de difuzie ghidat de atenția conștientă de sarcină, în timp ce o pierdere a consistenței efectului aliniază regiunile de ștergere și inserare, astfel încât ambele sarcini să se concentreze pe aceeași zonă.” width=”1045″ height=”484″ /> Schema cadrului EffectErase. În timpul antrenamentului, perechile de videoclipuri sunt codificate într-un spațiu latent comun, fuzionate cu zgomot și procesate de un transformator de difuzie ghidat de atenția conștientă de sarcină, în timp ce o pierdere a consistenței efectului aliniază regiunile de ștergere și inserare, astfel încât ambele sarcini să se concentreze pe aceeași zonă.

În sine, procesele de ștergere și inserare sunt antrenate împreună, utilizând un transformator de difuzie comun, astfel încât modelul să învețe să se concentreze pe aceleași regiuni afectate și să urmărească indicii structurale.

Videoclipurile cu obiecte, videoclipurile cu fundal gol și măștile sunt mai întâi codificate într-un spațiu latent; apoi se adaugă zgomot pentru antrenamentul difuziei, și modelul învață să recupereze reprezentări curate sub îndrumarea specifică sarcinii. Un adaptor ușor fuzionează apoi caracteristicile zgomotoase cu condițiile de ștergere sau inserare, permițând ambelor sarcini să împărtășească supravegherea, în timp ce rămân controlabile.

Îndrumarea regiunii conștientă de sarcină creează un semnal specific sarcinii prin combinarea tokenilor de limbaj cu caracteristici vizuale extrase din obiectul din prim-plan, utilizând CLIP, înlocuind un token generic de obiect cu o încorporare derivată din conținutul real al imaginii. Această reprezentare fuzionată este injectată în spatele scenei prin atenție încrucișată, permițând modelului să urmărească modul în care un obiect și efectele sale vizuale evoluează în spațiu și timp, în timp ce permite comutarea flexibilă între ștergere și inserare.

Pierderea consistenței efectului forțează procesele de ștergere și inserare să se concentreze pe aceleași zone modificate, deoarece ambele sarcini se ocupă de același obiect și de efectele sale vizuale. Hărțile de atenție din fiecare ramură sunt combinate în hărți moi de regiuni, și aliniate cu o hartă a diferenței calculate din videoclipurile cu obiect și fundal, astfel încât schimbări subtile, cum ar fi iluminarea și umbrele, să fie păstrate. Această pierdere suplimentară ajută inserarea să ghideze ștergerea și menține ambele sarcini consistente.

Date și teste

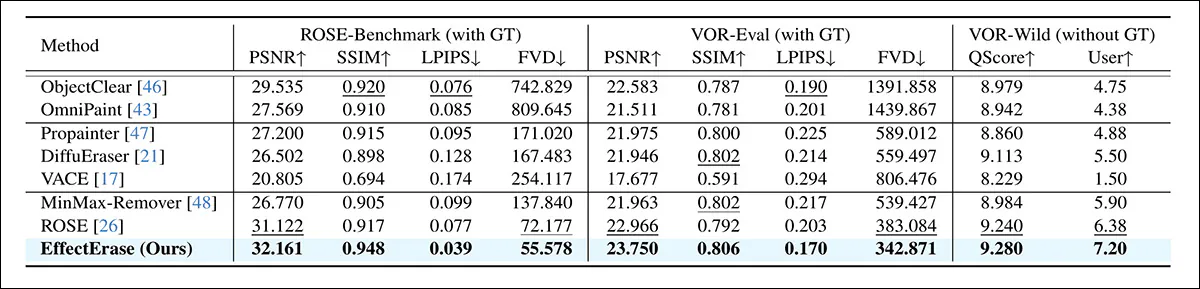

Cercetătorii au testat abordarea lor împotriva unor metode de umplere, umplere de videoclipuri și ștergere de obiecte: OmniPaint; ObjectClear; VACE; DiffuEraser; ProPainter; ROSE; și MiniMax-Remover.

Wan2.1 a fost ajustat cu LoRA†† utilizând setul de date VOR la o rezoluție de 832x480px. Au fost eșantionate 81 de cadre consecutive (limita eficientă pentru WAN, dincolo de care tendința este să apară erori) pentru antrenament, care a avut loc timp de 129.000 de iterații la o dimensiune a lotului de 8, pe opt procesoare H100 GPU, fiecare cu 80GB de VRAM. Rata de învățare a fost setată la 1×102, și rangul LoRA la 256.

Colecția sintetică ROSE-Benchmark a fost singurul set de date extern testat; celelalte două au fost VOR-Eval, divizarea test a setului de date VOR; și VOR-Wild, un set de test care cuprinde 195 de videoclipuri reale extrase de pe internet, care prezintă “obiecte dinamice”.

Metricile utilizate au fost Raportul de semnal la zgomot de vârf (PSNR); Indexul de similaritate structurală (SSIM); Similaritatea perceptuală a patch-urilor de imagine învățate (LPIPS); și Distanța video Fréchet (FVD). De asemenea, a fost luat în considerare și un studiu cu utilizatorii a 195 de videoclipuri generate din VOR-Wild, cu ratinguri medii de la 20 de voluntari.

În plus, autorii au conceput QScore, o metrică care utilizează modelul multimodal Qwen-VL pentru a evalua calitatea videoclipurilor cu obiecte șterse, în ceea ce privește artefactele rămase sau lipsa îndepărtării mediului, cum ar fi umbrele și efectele de iluminare:

Comparație cantitativă pe reperele ROSE și VOR, cu rezultatele cele mai bune și următoarele cele mai bune afișate cu caractere aldine și subliniate, respectiv.

În legătură cu aceste rezultate, autorii observă:

‘[Metodele actuale de] umplere a imaginilor operează pe cadre individuale, utilizând modele 2D, fără modelare temporală, și, prin urmare, nu reușesc să mențină coerența temporală în videoclipuri.

Metodele recente de umplere a videoclipurilor nu modelează în mod explicit efectele secundare ale obiectelor, ceea ce duce la rezultate neconvingătoare. Metodele actuale de ștergere a obiectelor din videoclipuri lipsesc modelarea corelației spațio-temporale dintre obiect și efectele sale, și, prin urmare, adesea produc artefacte și urme reziduale ale obiectelor șterse.

‘În general, EffectErase obține o performanță de ultimă generație în toate seturile de date și metricile de evaluare. Obține scorurile cele mai bune la metrica calității videoclipului FVD, demonstrând o netă superioritate a netezimii și coerenței temporale a videoclipurilor generate.

‘Metoda noastră obține, de asemenea, cel mai ridicat scor QScore și ratinguri de feedback ale utilizatorilor, demonstrând și mai mult eficacitatea sa în producerea unor rezultate de ștergere convingătoare.’

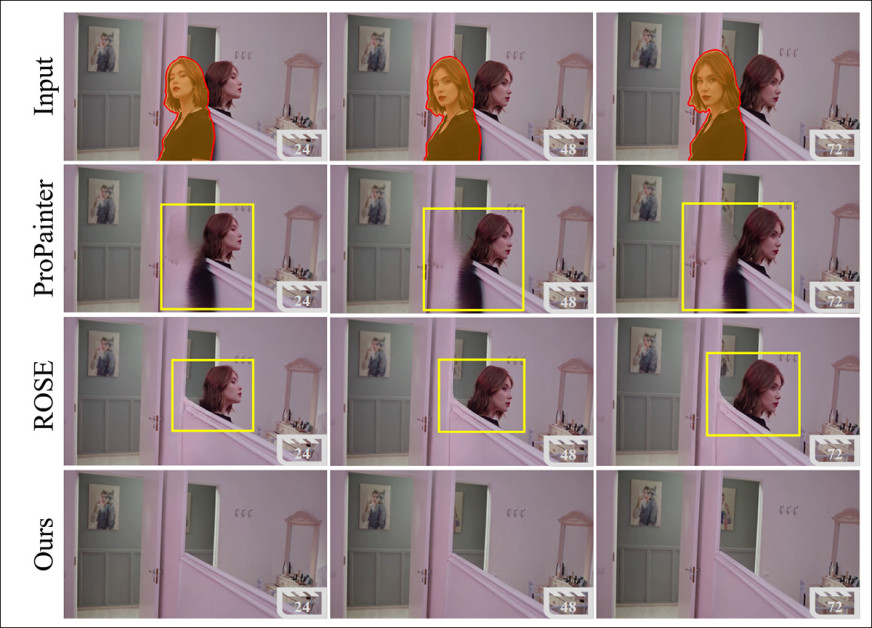

Pentru evaluarea calitativă, rezultate statice sunt oferite în articol (prezentate direct mai jos), precum și rezultate în mișcare disponibile pe site-ul proiectului și în prezentarea video YouTube:

<img class=" wp-image-394163" src="https://www.unite.ai/wp-content/uploads/2026/03/figure-7.jpg" alt="Comparație calitativă pe VOR-Eval, pentru cazuri de ocluziune, umbră, iluminare, reflexie și deformare. Metodele de umplere a imaginilor se luptă să îndepărteze efectele din afara masca, în timp ce metodele de ștergere a obiectelor adesea lasă artefacte vizibile. EffectErase îndepărtează atât obiectele țintă, cât și efectele lor asociate, într-un mod mai curat. Vă rugăm să consultați articolul sursă pentru o rezoluție mai bună și site-ul proiectului pentru exemple de videoclipuri.” width=”1032″ height=”508″ /> Comparație calitativă pe VOR-Eval, pentru cazuri de ocluziune, umbră, iluminare, reflexie și deformare. Metodele de umplere a imaginilor se luptă să îndepărteze efectele din afara masca, în timp ce metodele de ștergere a obiectelor adesea lasă artefacte vizibile. EffectErase îndepărtează atât obiectele țintă, cât și efectele lor asociate, într-un mod mai curat. Vă rugăm să consultați articolul sursă pentru o rezoluție mai bună și site-ul proiectului pentru exemple de videoclipuri.

Ne referim, de asemenea, cititorului la diverse exemple conexe de pe site-ul proiectului, prezentate mai jos, precum și la videoclipul oficial YouTube încorporat la sfârșitul acestui articol:

Faceți clic pentru a juca. Un exemplu de comparație de pe site-ul EffectErase. Vă rugăm să consultați site-ul pentru o rezoluție mai bună (cu avertismentele menționate) și pentru exemple suplimentare.

Autorii comentă:

‘Metodele de umplere a videoclipurilor adesea produc artefacte în regiunile mascate și nu reușesc să îndepărteze complet efectele secundare cauzate de obiectele șterse. Abordările anterioare de ștergere a obiectelor, cum ar fi [ROSE] și [MinMax-Remover], se descurcă bine la ștergerea obiectelor țintă, dar încă se luptă cu efectele secundare, în special în scenariile de ocluziune, umbră, iluminare, reflexie și deformare.

‘În contrast, EffectErase îndepărtează atât obiectele țintă, cât și efectele lor asociate, rezultând în rezultate curate, coerente și de înaltă calitate.’

În încheiere, cercetătorii observă că metoda lor poate fi adaptată și pentru sarcini de inserare, fără a necesita antrenament suplimentar:

<img class=" wp-image-394165" src="https://www.unite.ai/wp-content/uploads/2026/03/figure-9.jpg" alt="Rezultate de inserare a obiectelor din videoclipuri. EffectErase inserează obiecte, păstrând conținutul fundalului și generând efecte induse de obiecte, cum ar fi umbre și reflexii, în mod constant pe cadre.” width=”913″ height=”357″ /> Rezultate de inserare a obiectelor din videoclipuri. EffectErase inserează obiecte, păstrând conținutul fundalului și generând efecte induse de obiecte, cum ar fi umbre și reflexii, în mod constant pe cadre.

Rezultatele videoclipurilor pentru sarcina de inserare pot fi văzute în (exemplul specific de timp) videoclipul YouTube (de asemenea, încorporat fără marcaje de timp la sfârșitul articolului).

Concluzie

O privire asupra unor proiecte similare din literatură arată că multe dintre ele încă speră că modelele generale de efecte vizuale vor reuși în cele din urmă să încorporeze această funcționalitate într-un model de “cutie de instrumente” destinat unei game largi de efecte, și nu doar acestei sarcini specifice.

Însă, pe principiul “omul care face totul”, pare rezonabil să se presupună că sistemele dedicate, cum ar fi EffectErase, vor continua să păstreze un avantaj față de abordările mai generale; cu rezerva că această diferență poate contracta în cele din urmă suficient de mult pentru a face ca efortul suplimentar de antrenare a unui model distinct să nu mai fie justificat.

* Ar fi de dorit, având în vedere preocupările crescânde legate de problema dovedirii proprietății intelectuale, ca toate aceste surse să fie citate; dar dacă materialele disponibile din noua lucrare menționează sursa modelului 3D, nu am reușit să găsesc această referință.

† Referința oferită pare a fi un text explicativ generic din 2013, fără a detalia VAE-ul specific.

†† Luat din articol, aceasta este o descriere semantică neclară, deoarece ajustarea fină și LoRA sunt procese diferite cu cerințe foarte diferite.

Publicat pentru prima dată sâmbătă, 21 martie 2026