Inteligență artificială

Un cartel de seturi de date influente domină cercetarea în învățarea automată, sugerează un nou studiu

Un nou articol din partea Universității din California și Google Research a constatat că un număr mic de seturi de date de “referință” pentru învățarea automată, în mare parte din instituții vestice influente și, adesea, din organizații guvernamentale, domină din ce în ce mai mult sectorul cercetării AI.

Cercetătorii concluzionează că această tendință de a “recurge” la seturi de date deschise foarte populare, cum ar fi ImageNet, ridică o serie de motive practice, etice și chiar politice de îngrijorare.

Printre constatările lor – pe baza datelor de bază de la proiectul comunitar condus de Facebook, Papers With Code (PWC) – autorii susțin că “seturile de date utilizate pe scară largă sunt introduse de doar câteva instituții de elită” și că această “consolidare” a crescut la 80% în ultimii ani.

‘[Noi] constatăm că există o creștere a inegalității în utilizarea seturilor de date la nivel global, și că mai mult de 50% din toate utilizările seturilor de date din eşantionul nostru de 43.140 corespund seturilor de date introduse de douăsprezece instituții de elită, în principal vestice.’

O hartă a utilizărilor seturilor de date nespecifice sarcinii în ultimii zece ani. Criteriul de includere este instituția sau compania care reprezintă mai mult de 50% din utilizările cunoscute. În partea dreaptă este prezentat coeficientul Gini pentru concentrarea seturilor de date în timp, atât pentru instituții, cât și pentru seturi de date. Sursa: https://arxiv.org/pdf/2112.01716.pdf

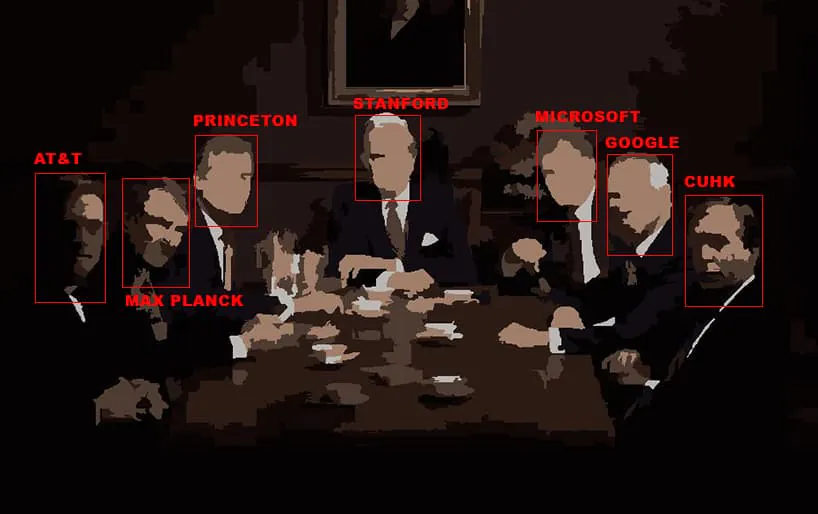

Instituțiile dominante includ Universitatea Stanford, Microsoft, Princeton, Facebook, Google, Institutul Max Planck și AT&T. Patru dintre primele zece surse de seturi de date sunt instituții corporatiste.

Articolul caracterizează, de asemenea, utilizarea crescândă a acestor seturi de date de elită ca ‘un vehicul pentru inegalitate în știință’. Acest lucru se datorează faptului că echipele de cercetare care solicită aprobarea comunității sunt mai motivate să obțină rezultate de ultimă oră (SOTA) împotriva unui set de date consistent decât să genereze seturi de date originale care nu au o astfel de poziție și care ar necesita ca colegii să se adapteze la metrice noi în locul indicilor standard.

În orice caz, după cum recunoaște articolul, crearea propriului set de date este o întreprindere prohibitiv de scumpă pentru instituții și echipe mai puțin dotate.

‘Valabilitatea științifică prima facie acordată de benchmark-ul SOTA este generic confundată cu credibilitatea socială pe care o obțin cercetătorii prin demonstrarea capacității de a concura pe un set de date larg recunoscut, chiar dacă un benchmark mai specific din punct de vedere al contextului ar fi mai adecvat din punct de vedere tehnic.

‘Susținem că aceste dinamici creează un “Efect Matthew” (adică “bogatul devine mai bogat și săracul devine mai sărac”) în care benchmark-urile de succes și instituțiile de elită care le introduc capătă o poziție disproporționat de puternică în domeniu.’

Articolul Reduced, Reused and Recycled: The Life of a Dataset in Machine Learning Research provine de la Bernard Koch și Jacob G. Foster de la UCLA, și Emily Denton și Alex Hanna de la Google Research.

Lucrarea ridică o serie de probleme cu tendința de consolidare pe care o documentează și a fost întâmpinată cu aprobare generală la Open Review. Un recenzor de la NeurIPS 2021 a comentat că lucrarea este ‘extrem de relevantă pentru oricine implicat în cercetarea învățării automate.’ și a prevăzut includerea sa ca lectură obligatorie la cursurile universitare.

De la necesitate la corupție

Autorii notează că cultura actuală de “a bate benchmark-ul” a apărut ca o soluție pentru lipsa unor instrumente de evaluare obiectivă care a determinat o scădere a interesului și a investițiilor în IA pentru a doua oară acum peste treizeci de ani, după declinul entuziasmului business-ului pentru noile cercetări în “Sisteme Expert”:

‘Benchmark-urile formalizează, de obicei, o anumită sarcină prin intermediul unui set de date și al unei metrice cantitative de evaluare. Practica a fost introdusă inițial în cercetarea învățării automate după “Iarna IA” din anii 1980 de către finanțatorii guvernamentali, care au căutat să evalueze mai precis valoarea obținută din subvenții.’

Articolul susține că avantajele inițiale ale acestei culturi informale de standardizare (reducerea barierelor de participare, metrice consistente și oportunități de dezvoltare mai agile) încep să fie depășite de dezavantajele care apar în mod natural atunci când un corp de date devine suficient de puternic pentru a defini eficient “condițiile de utilizare” și sfera de influență.

Autorii sugerează, în conformitate cu multe gânduri recente din industrie și din mediul academic pe această temă, că comunitatea de cercetare nu mai pune probleme noi dacă acestea nu pot fi abordate prin seturile de date de benchmark existente.

Ei notează, de asemenea, că aderarea oarbă la acest număr mic de seturi de date “de aur” îi încurajează pe cercetători să obțină rezultate care sunt supraajustate (adică care sunt specifice setului de date și care nu sunt susceptibile de a performa aproape la fel de bine pe date din lumea reală, pe seturi de date academice noi sau originale, sau chiar pe seturi de date diferite din “standardul de aur”).

‘Având în vedere concentrarea observată a cercetării pe un număr mic de seturi de date de benchmark, credem că diversificarea formelor de evaluare este deosebit de importantă pentru a evita supraajustarea la seturile de date existente și pentru a nu reprezenta greșit progresul în domeniu.’

Influența guvernamentală în cercetarea viziunii computaționale

Conform articolului, cercetarea în viziunea computațională este afectată în mod semnificativ de sindromul pe care îl descrie, autorii notând că cercetarea în procesarea limbajului natural (NLP) este mult mai puțin afectată. Autorii sugerează că acest lucru se datorează faptului că comunitățile NLP sunt ‘mai coerente’ și mai mari ca mărime și pentru că seturile de date NLP sunt mai accesibile și mai ușor de curățat, precum și pentru că sunt mai mici și mai puțin consumatoare de resurse în ceea ce privește colectarea datelor.

În viziunea computațională, și în special în ceea ce privește seturile de date de recunoaștere facială (FR), autorii susțin că interesele corporatiste, de stat și private adesea colidează:

‘Instituțiile corporatiste și guvernamentale au obiective care pot intra în conflict cu confidențialitatea (de exemplu, supravegherea), și greutatea acestor priorități este probabil să fie diferită de cea a academicienilor sau a altor părți interesate în IA.’

Pentru sarcinile de recunoaștere facială, cercetătorii au constatat că incidența seturilor de date pur academice scade dramatic în comparație cu media:

‘[Patru] din cele opt seturi de date (33,69% din totalul utilizărilor) au fost finanțate exclusiv de corporații, armata americană sau guvernul chinez (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). MS-Celeb-1M a fost retras ulterior din cauza controversei legate de valoarea confidențialității pentru diferiți stakeholderi.’

Seturile de date principale utilizate în comunitățile de cercetare a generării de imagini și recunoașterii feței.

În graficul de mai sus, după cum notează autorii, vedem și faptul că domeniul relativ recent de generare a imaginilor (sau sinteză a imaginilor) se bazează puternic pe seturi de date existente, mult mai vechi, care nu au fost destinate inițial pentru acest scop.

De fapt, articolul observă o tendință în creștere de “migrare” a seturilor de date departe de scopul lor inițial, punând sub semnul întrebării adecvarea lor pentru nevoile sectoarelor de cercetare noi sau periferice și măsura în care constrângerile bugetare pot “genericiza” sfera ambițiilor cercetătorilor într-un cadru mai îngust oferit atât de materialele disponibile, cât și de o cultură atât de obsedată de evaluările anuale ale benchmark-ului, încât seturile de date noi au dificultăți în a câștiga teren.

‘Rezultatele noastre arată, de asemenea, că seturile de date se transferă în mod regulat între diferite comunități de sarcini. La capătul extrem, majoritatea seturilor de date de benchmark în circulație pentru anumite comunități de sarcini au fost create pentru alte sarcini.’

În ceea ce privește personalitățile de seamă din domeniul învățării automate (inclusiv Andrew Ng) care au solicitat în mod constant o diversificare și o curățare a seturilor de date în ultimii ani, autorii susțin sentimentul, dar cred că acest efort, chiar dacă este încununat de succes, ar putea fi subminat de dependența actuală a culturii de rezultatele SOTA și de seturile de date stabilite:

‘Cercetarea noastră sugerează că simpla solicitare ca cercetătorii în învățarea automată să dezvolte mai multe seturi de date și schimbarea structurilor de stimulente astfel încât dezvoltarea seturilor de date să fie valorizată și recompensată poate să nu fie suficientă pentru a diversifica utilizarea seturilor de date și perspectivele care, în cele din urmă, modelează și stabilesc agenda de cercetare a învățării automate.’

‘Pe lângă stimularea dezvoltării seturilor de date, susținem intervenții politice orientate spre echitate care să prioritizeze finanțarea semnificativă a persoanelor din instituții mai puțin dotate pentru a crea seturi de date de înaltă calitate. Acest lucru ar diversifica – dintr-o perspectivă socială și culturală – seturile de date de benchmark utilizate pentru a evalua metodele moderne de învățare automată.’