Inteligência artificial

As deficiências do Amazon Mechanical Turk podem ameaçar os sistemas de geração de linguagem natural

Um novo estudo da Universidade de Massachusetts Amherst colocou professores de inglês contra trabalhadores de crowdsourcing em Amazon Mechanical Turk na avaliação do resultado da Geração de Linguagem Natural (NLG) sistemas, concluindo que padrões frouxos e a "gamificação" de tarefas valorizadas entre trabalhadores de AMT podem estar atrapalhando o desenvolvimento do setor.

O relatório chega a uma série de conclusões contundentes sobre até que ponto a terceirização barata em "escala industrial" de tarefas de avaliação de NLG de final aberto pode levar a resultados e algoritmos inferiores neste setor.

Os pesquisadores também compilaram uma lista de 45 artigos sobre geração de texto aberto, onde a pesquisa fez uso da AMT, e descobriram que "a grande maioria" não relatou detalhes críticos sobre o uso do serviço coletivo da Amazon, dificultando a reprodução das descobertas dos artigos.

Mão-de-obra

O relatório critica tanto a natureza de exploração do Amazon Mechanical Turk quanto os projetos acadêmicos (provavelmente limitados pelo orçamento) que estão emprestando credibilidade adicional à AMT usando (e citando) como um recurso de pesquisa válido e consistente. Os autores observam:

'Embora a AMT seja uma solução conveniente e acessível, observamos que alta variação entre trabalhadores, calibração deficiente e tarefas cognitivamente exigentes podem levar os pesquisadores a tirar conclusões científicas enganosas (por exemplo, que o texto escrito por humanos é "pior" do que o do GPT-2).'

O relatório culpa o jogo e não os jogadores, com os pesquisadores observando:

'Os trabalhadores [da multidão] frequentemente são mal pagos por seu trabalho, o que prejudica tanto a qualidade da pesquisa quanto, mais importante, a capacidade desses trabalhadores da multidão de ganhar a vida adequadamente.'

O método da papel, intitulado Os perigos de usar o Mechanical Turk para avaliar a geração de texto aberto, conclui ainda que 'avaliadores especialistas', como professores de línguas e linguistas, devem ser usados para avaliar conteúdo NLG artificial aberto, mesmo que o AMT seja mais barato.

Tarefas de teste

Ao comparar o desempenho da AMT com o de leitores especialistas, com menos restrições de tempo, os pesquisadores gastaram US$ 144 nos serviços da AMT realmente usados nos testes de comparação (embora muito mais tenha sido gasto em resultados "não utilizáveis" — veja abaixo), exigindo que "turcos" aleatórios avaliassem um de 200 textos, divididos entre conteúdo de texto criado por humanos e texto gerado artificialmente.

Encarregar professores profissionais com o mesmo trabalho custou US$ 187.50 e confirmar seu desempenho superior (em comparação com os funcionários da AMT) contratando freelancers da Upwork para replicar as tarefas custou US$ 262.50 adicionais.

Cada tarefa consistia em quatro critérios avaliativos: gramática ('Quão gramaticalmente correto é o texto do fragmento da história?'); coerência ('Quão bem as frases no fragmento da história se encaixam?'); simpatia ('Você achou o fragmento da história agradável?'); e relevância ('Qual a relevância do fragmento da história para o prompt?').

Gerando os Textos

Para obter material NLG para os testes, os pesquisadores usaram o Facebook AI Research de 2018 Geração de história neural hierárquica conjunto de dados, que compreende 303,358 histórias em inglês compostas por usuários no popular (mais de 15 milhões de usuários) r / writingprompts subreddit, onde as histórias dos assinantes são 'semeadas' por 'prompts' de frases únicas de maneira semelhante às práticas atuais em geração de texto para imagem – e, claro, na Geração de Linguagem Natural aberta sistemas.

200 prompts do conjunto de dados foram selecionados aleatoriamente e passados por um modelo GPT-2 de tamanho médio usando os Transformers Hugging-Face biblioteca. Assim, dois conjuntos de resultados foram obtidos a partir dos mesmos prompts: os ensaios discursivos escritos por humanos de usuários do Reddit e os textos gerados pelo GPT-2.

Para evitar que os mesmos trabalhadores da AMT julgassem a mesma história várias vezes, foram solicitados três julgamentos de trabalhadores da AMT por exemplo. Juntamente com experimentos sobre as habilidades de língua inglesa dos trabalhadores (veja o final do artigo) e o desconto nos resultados de trabalhadores com baixo esforço (veja "Tempo Curto" abaixo), isso aumentou o gasto total com AMT para cerca de US$ 1,500.

Para criar um campo de jogo nivelado, todos os testes foram realizados durante a semana entre 11.00h11 e 30hXNUMX PST.

Resultados e Conclusões

O amplo estudo cobre muito terreno, mas os pontos-chave são os seguintes:

Curto período de tempo

O jornal descobriu que um tempo médio de tarefa relatado pela Amazon oficial de 360 segundos se resumia a um tempo de trabalho real de apenas 22 segundos e um tempo médio de trabalho de apenas 13 segundos – um quarto do tempo gasto pelo mais rápido Professora de inglês replicando a tarefa.

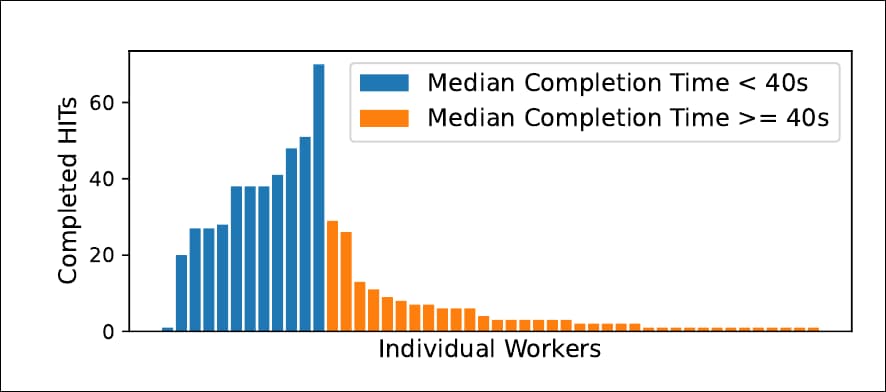

A partir do segundo dia do estudo: os trabalhadores individuais (em laranja) gastaram notavelmente menos tempo avaliando cada tarefa do que os professores mais bem pagos e (mais tarde) os contratados da Upwork ainda mais bem pagos. Fonte: https://arxiv.org/pdf/2109.06835.pdf

Como a AMT não impõe limites às Tarefas de Inteligência Humana (HITs) que um trabalhador individual pode realizar, surgiram os "grandes rebatedores" da AMT, com reputações (lucrativas) por completarem um grande número de tarefas por experimento. Para compensar as rebatidas aceitas pelo mesmo trabalhador, os pesquisadores mediram o tempo entre as HITs submetidas consecutivamente, comparando o horário de início e término de cada uma. Dessa forma, a diferença entre as HITs relatadas pela AMT WorkTimeInSeconds e o tempo real gasto na tarefa entrou em foco.

Como esse trabalho não pode ser realizado nesses prazos reduzidos, os pesquisadores tiveram que compensar isso:

'Como é impossível ler cuidadosamente uma história com um parágrafo e avaliar todas as quatro propriedades em apenas 13 segundos, medimos o impacto nas avaliações médias ao filtrar os trabalhadores que gastam muito pouco tempo por HIT... Especificamente, removemos os julgamentos dos trabalhadores cujo tempo mediano é inferior a 40s (o que é um padrão baixo) e descobrimos que, em média, cerca de 42% de nossas avaliações são filtradas (variando de 20% a 72% em todos os experimentos).'

O artigo afirma que o tempo de trabalho real relatado incorretamente no AMT é "um problema importante" normalmente ignorado pelos pesquisadores que usam os serviços.

Mão Segurada Necessária

As descobertas sugerem ainda que os trabalhadores da AMT não conseguem distinguir de forma confiável entre texto escrito por um humano e texto escrito por uma máquina, a menos que vejam ambos os textos lado a lado, o que comprometeria efetivamente um cenário típico de avaliação (onde o leitor deveria ser capaz de fazer um julgamento com base em uma única amostra de texto, "real" ou gerada artificialmente).

Aceitação casual de texto artificial de baixa qualidade

Os funcionários da AMT classificaram consistentemente o texto artificial baseado em GPT de baixa qualidade em pé de igualdade com o texto coerente e de maior qualidade escrito por humanos, em contraste com os professores de inglês, que foram facilmente capazes de distinguir a diferença de qualidade.

Sem tempo de preparação, contexto zero

Entrar na mentalidade correta para uma tarefa tão abstrata quanto a avaliação de autenticidade não ocorre naturalmente; professores de inglês precisaram de 20 tarefas para calibrar suas sensibilidades ao ambiente avaliativo, enquanto trabalhadores de AMT normalmente não têm nenhum "tempo de orientação", o que diminui a qualidade de sua contribuição.

Jogando o sistema

O relatório afirma que o tempo total que os trabalhadores da AMT gastam em tarefas individuais é inflado por trabalhadores que aceitam várias tarefas simultaneamente e executam as tarefas em diferentes guias em seus navegadores, em vez de se concentrar em uma tarefa durante a duração da tarefa registrada.

País de origem é importante

As configurações padrão da AMT não filtram os trabalhadores por país de origem, e o relatório observa trabalho prévio indicando que os trabalhadores da AMT usam VPNs para contornar restrições geográficas, permitindo que falantes não nativos se apresentem como falantes nativos de inglês (em um sistema que, talvez de forma um tanto ingênua, equipara a língua materna de um trabalhador à sua localização geográfica baseada em IP).

Assim, os pesquisadores reexecutaram os testes de avaliação no AMT com filtros limitando os potenciais compradores a não-Países de língua inglesa, descobrindo que 'trabalhadores de países que não falam inglês classificaram a coerência, a relevância e a gramática… significativamente mais baixo do que trabalhadores com qualificações idênticas de países que não falam inglês'.

O relatório conclui:

'Avaliadores [especialistas], como linguistas ou professores de línguas, devem ser usados sempre que possível, pois eles já foram treinados para avaliar textos escritos, e não é muito mais caro...'.

Publicado em 16 de setembro de 2021 - Atualizado em 18 de dezembro de 2021: tags adicionadas