Inteligência artificial

Nossas Habilidades Subconscientes de Detecção de Deepfakes Podem Energizar Sistemas Automatizados Futuros

Nova pesquisa da Austrália sugere que nosso cérebro é habilidoso em reconhecer deepfakes sofisticados, mesmo quando acreditamos conscientemente que as imagens que estamos vendo são reais.

A descoberta implica ainda a possibilidade de usar as respostas neurais das pessoas a faces de deepfakes (em vez de suas opiniões declaradas) para treinar sistemas automatizados de detecção de deepfakes. Tais sistemas seriam treinados em características de deepfakes de imagens, e não em estimativas confusas de plausibilidade, mas em nossos mecanismos perceptuais instintivos para reconhecimento de identidade facial.

‘[A]lthough o cérebro pode ‘reconhecer’ a diferença entre faces reais e faces realistas, os observadores não podem conscientemente distingui-las. Nossas descobertas da dissociação entre resposta cerebral e comportamento têm implicações para como estudamos a percepção de faces falsas, as perguntas que fazemos sobre a identificação de imagens falsas e as possíveis maneiras pelas quais podemos estabelecer padrões de proteção contra o mau uso de imagens falsas.’

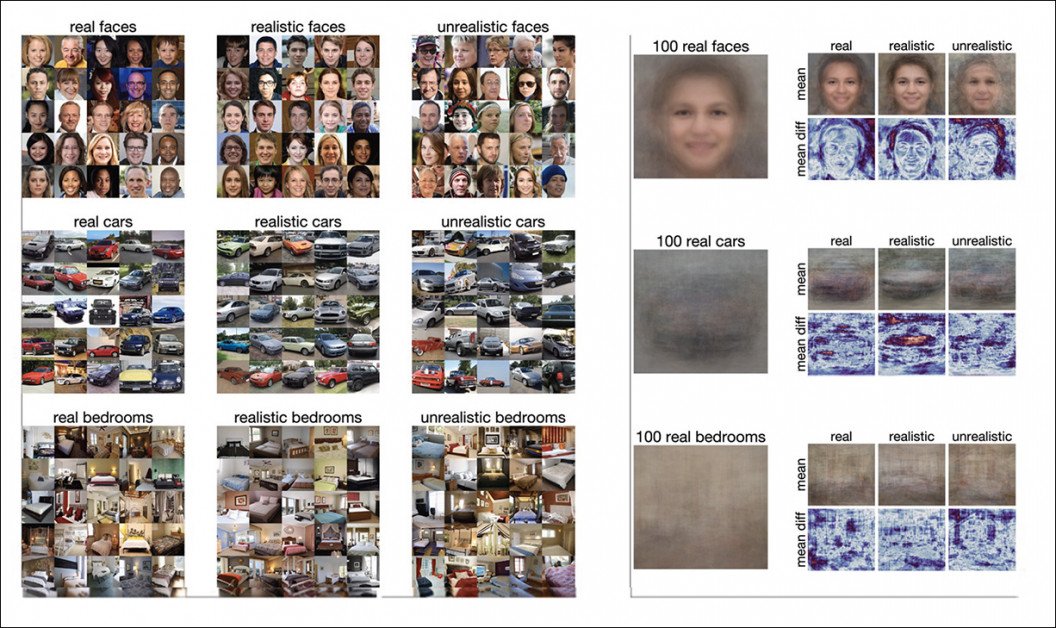

Os resultados surgiram em rodadas de testes projetados para avaliar a forma como as pessoas respondem a imagens falsas, incluindo imagens de faces manifestamente falsas, carros, espaços internos e faces invertidas (ou seja, de cabeça para baixo).

Várias iterações e abordagens para os experimentos, que envolviam dois grupos de sujeitos de teste precisando classificar uma imagem brevemente exibida como ‘falsa’ ou ‘real’. A primeira rodada ocorreu no Amazon Mechanical Turk, com 200 voluntários, enquanto a segunda rodada envolveu um número menor de voluntários respondendo aos testes enquanto estavam conectados a máquinas de EEG. Source: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

O artigo afirma:

‘Nossos resultados demonstram que, dado apenas um vislumbre breve, os observadores podem ser capazes de detectar faces falsas. No entanto, eles têm mais dificuldade em discernir faces reais de faces falsas e, em alguns casos, acreditam que faces falsas sejam mais reais do que faces reais.

‘No entanto, usando EEG de resolução temporal e métodos de classificação de padrões multivariados, descobrimos que era possível decodificar faces realistas e irrealistas de faces reais usando a atividade cerebral.

‘Essa dissociação entre comportamento e respostas neurais para faces realistas fornece novas evidências importantes sobre a percepção de faces falsas, bem como implicações envolvendo a classe cada vez mais realista de faces geradas por GAN.’

O artigo sugere que o novo trabalho tem ‘várias implicações’ na cibersegurança aplicada e que o desenvolvimento de classificadores de deepfakes deve ser impulsionado por respostas subconscientes, medidas em leituras de EEG em resposta a imagens falsas, em vez da estimativa consciente do espectador sobre a veracidade de uma imagem.

Os autores comentam*:

‘Isso é semelhante a descobertas de que indivíduos com prosopagnosia que não podem classificar ou reconhecer faces como familiares ou desconhecidas, no entanto, exibem respostas autonômicas mais fortes a faces familiares do que faces desconhecidas.

‘Da mesma forma, o que mostramos neste estudo é que, embora pudéssemos decodificar com precisão a diferença entre faces reais e faces realistas a partir da atividade neural, essa diferença não foi vista comportamentalmente. Em vez disso, os observadores identificaram incorretamente 69% das faces reais como sendo falsas.’

O novo trabalho é intitulado Are you for real? Decoding realistic AI-generated faces from neural activity e vem de quatro pesquisadores de todo o University of Sydney, Macquarie University, Western Sydney University e The University of Queensland.

Dados

Os resultados surgiram de um exame mais amplo da capacidade humana de distinguir imagens falsas manifestas, hiper-realistas (mas ainda falsas) e reais, realizado em duas rodadas de testes.

Os pesquisadores usaram imagens criadas por Redes Adversárias Generativas (GANs), compartilhadas pela NVIDIA.

Imagens de faces humanas geradas por GAN disponibilizadas pela NVIDIA. Source: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

Os dados compreendiam 25 faces, carros e quartos, em níveis de renderização que variavam de ‘irrealista’ a ‘realista’. Para comparação de faces (ou seja, para material não falso adequado), os autores usaram seleções do conjunto de dados de origem do conjunto de dados Flickr-Faces-HQ (FFHQ) da NVIDIA. Para comparação dos outros cenários, eles usaram material do conjunto de dados LSUN.

As imagens seriam finalmente apresentadas ao sujeito de teste de cabeça para cima ou de cabeça para baixo, e em uma variedade de frequências, com todas as imagens redimensionadas para 256×256 pixels.

Depois que todo o material foi reunido, 450 imagens de estímulo foram curadas para os testes.

Testes

Os testes em si foram inicialmente realizados online, por meio do jsPsych no pavlovia.org, com 200 participantes julgando várias subconjuntos dos dados de teste totais. As imagens foram apresentadas por 200ms, seguidas de uma tela em branco que persistiria até que o espectador fizesse uma decisão sobre se a imagem exibida brevemente era real ou falsa. Cada imagem foi apresentada apenas uma vez, e o teste todo levou 3-5 minutos para ser concluído.

A segunda e mais reveladora rodada usou sujeitos presenciais conectados a monitores de EEG e foi apresentada na plataforma Psychopy2. Cada uma das vinte sequências continha 40 imagens, com 18.000 imagens apresentadas em toda a tranche dos dados de teste.

Os dados de EEG coletados foram decodificados via MATLAB com a caixa de ferramentas CoSMoMVPA, usando um esquema de validação cruzada de deixar um fora sob Análise Discriminante Linear (LDA).

O classificador LDA foi o componente que pôde fazer a distinção entre a reação cerebral ao estímulo falso e a opinião do sujeito sobre se a imagem era falsa.

Resultados

Interessados em saber se os sujeitos de teste de EEG pudessem discriminar entre faces falsas e reais, os pesquisadores agregaram e processaram os resultados, encontrando que os participantes puderam discernir facilmente faces reais de faces irrealistas, mas aparentemente tiveram dificuldade em identificar faces realistas, geradas por GAN, falsas. Se a imagem estava de cabeça para baixo parecia fazer pouca diferença.

Discriminação comportamental de faces reais e faces geradas sinteticamente, na segunda rodada.

No entanto, os dados de EEG contaram uma história diferente.

O artigo afirma:

‘Embora os observadores tivessem dificuldade em distinguir faces reais de faces falsas e tendessem a superclassificar faces falsas, os dados de EEG continham informações de sinal relevantes para essa distinção, que diferiam significativamente entre realistas e irrealistas, e esse sinal parecia ser limitado a um estágio relativamente curto de processamento.’

Aqui a disparidade entre a precisão do EEG e a opinião relatada dos sujeitos (ou seja, se as imagens de faces eram falsas) não são idênticas, com as capturas de EEG se aproximando mais da verdade do que a percepção manifesta das pessoas envolvidas.

Os pesquisadores concluem que, embora os observadores possam ter dificuldade em identificar tacitamente faces falsas, essas faces têm ‘representações distintas no sistema visual humano’.

A disparidade encontrada fez com que os pesquisadores especulassem sobre a aplicabilidade potencial de suas descobertas para mecanismos de segurança futuros:

‘Em um cenário aplicado, como cibersegurança ou Deepfakes, examinar a capacidade de detecção de faces realistas pode ser melhor perseguido usando classificadores de aprendizado de máquina aplicados a dados de neuroimagem, em vez de visar o desempenho comportamental.’

Eles concluem:

‘Entender a dissociação entre cérebro e comportamento para a detecção de faces falsas terá implicações práticas para a forma como lidamos com a propagação potencialmente prejudicial e universal de informações geradas artificialmente.’

* Minha conversão de citações em linha para links.

Publicado pela primeira vez em 11 de julho de 2022.