Inteligência artificial

OpenAI e Anthropic Lançam Modelos de Duelo à Medida que a Corrida Armamentista de IA se Intensifica

OpenAI e Anthropic lançaram novos modelos de bandeira dentro de minutos um do outro hoje, enquanto OpenAI lançou simultaneamente uma plataforma de agente empresarial e Perplexity introduziu um recurso de pesquisa de multi-modelo. Hoje entregou mais anúncios de produtos de IA significativos em uma única tarde do que a maioria das semanas produz no total.

Aqui está o que foi enviado e o que isso significa.

Opus 4.6 da Anthropic: Equipes de Agentes e uma Janela de Um Milhão de Tokens

Anthropic lançou Claude Opus 4.6, seu modelo mais capaz, com dois recursos de destaque: uma janela de contexto de um milhão de tokens e uma nova capacidade chamada Equipes de Agentes.

A janela de contexto é o maior feito técnico. Com um milhão de tokens, Opus 4.6 pode processar aproximadamente 3.000 páginas de texto em uma única solicitação — quatro vezes o limite de 256.000 tokens de seu antecessor. Combinado com suporte de saída de 128.000 tokens, o modelo agora pode ingerir e trabalhar com código-fonte inteiros, arquivos de regulamentação ou corpora de pesquisa sem divisão ou resumo.

Equipes de Agentes, disponível no Claude Code, permite que várias instâncias de Claude trabalhem em paralelo em um código-fonte compartilhado. Em vez de um agente único executar tarefas sequencialmente, os desenvolvedores podem criar equipes onde um agente lida com alterações de frontend, outro escreve testes e um terceiro reorganiza a lógica de backend — todos coordenando no mesmo projeto simultaneamente.

Opus 4.6 também introduz pensamento adaptativo, que permite que o modelo calibre quanto esforço de raciocínio investir em uma solicitação determinada. Perguntas simples obtêm respostas rápidas; problemas complexos desencadeiam pensamento mais profundo e prolongado. Os desenvolvedores podem ajustar isso por meio de controles de esforço em quatro níveis: baixo, médio, alto e máximo.

Nos benchmarks, Opus 4.6 obtém a pontuação mais alta no Terminal-Bench 2.0 para codificação agente e lidera o Exame Final da Humanidade, uma avaliação de raciocínio complexo. Anthropic afirma uma vantagem de 144 pontos Elo sobre o GPT-5.2 na avaliação GDPval-AA e uma melhoria de 190 pontos em relação ao Opus 4.5.

O preço da API permanece inalterado em $5 por milhão de tokens de entrada e $25 por milhão de tokens de saída, embora as solicitações que excedam 200.000 tokens tenham uma taxa premium de $10/$37,50.

Em uma movimentação notável de empresa, Anthropic anunciou uma pré-visualização de pesquisa do Claude no Microsoft PowerPoint, onde o modelo pode ler layouts e modelos de slide existentes e gerar ou editar apresentações preservando a formatação da marca.

GPT-5.3-Codex da OpenAI: O Modelo que Ajudou a Construir a Si Mesmo

Minutos após o anúncio da Anthropic, OpenAI lançou GPT-5.3-Codex, seu modelo de codificação mais capaz. O lançamento unifica o desempenho de codificação de fronteira do GPT-5.2-Codex com as capacidades de raciocínio e conhecimento profissional do GPT-5.2 em um único sistema que também é 25 por cento mais rápido.

A afirmação mais notável: GPT-5.3-Codex ajudou a construir a si mesmo. A equipe Codex da OpenAI usou versões iniciais do modelo durante seu próprio processo de treinamento — depurando execuções de treinamento, gerenciando infraestrutura de implantação e diagnosticando resultados de avaliação. É o primeiro reconhecimento público da OpenAI de que um modelo foi instrumental em seu próprio desenvolvimento, um marco que levanta questões tanto de eficiência quanto de segurança.

GPT-5.3-Codex estabelece novos recordes da indústria no SWE-Bench Pro e Terminal-Bench, benchmarks que avaliam tarefas de engenharia de software do mundo real. O modelo pode lidar com tarefas de longa execução que envolvem pesquisa, uso de ferramentas e execução complexa, e os usuários podem interagir com ele no meio da tarefa sem perder o contexto — mais como colaborar com um colega de trabalho do que emitir comandos.

O modelo está disponível agora para todos os usuários do plano pago do ChatGPT por meio do aplicativo Codex, CLI, extensão de IDE e interface web. O acesso à API está chegando em breve.

Para os desenvolvedores que escolhem entre geradores de código de IA, a imagem competitiva agora está nitidamente definida: Opus 4.6 lidera em coordenação de agente e trabalho de contexto longo, enquanto GPT-5.3-Codex enfatiza velocidade e raciocínio integrado. Ambos reivindicam marcas mais altas em benchmarks sobrepostos, e ferramentas como Cursor e Xcode da Apple suportam ambos, então os desenvolvedores podem mudar livremente.

Fronteira da OpenAI: Agentes Empresariais Ganham Sua Própria Plataforma

Ao lado do lançamento do modelo, OpenAI introduziu Frontier, uma plataforma empresarial para construir, implantar e gerenciar agentes de IA. Frontier se conecta a bancos de dados, sistemas CRM, plataformas de RH, ferramentas de ticket e outras aplicações comerciais, então permite que os agentes de IA executem processos nelas.

OpenAI descreveu Frontier como “uma camada semântica para a empresa” onde funcionários humanos e agentes de IA operam na mesma plataforma com acesso compartilhado a dados e controles de segurança. Os agentes recebem identidades semelhantes às dos funcionários, contexto organizacional compartilhado e permissões de nível empresarial.

A plataforma é agnóstica de modelo — as empresas podem gerenciar agentes construídos nos modelos da OpenAI ao lado daqueles da Google, Microsoft e Anthropic. Os clientes iniciais incluem Intuit, State Farm, Thermo Fisher e Uber.

Frontier posiciona OpenAI para competir diretamente com plataformas empresariais como Agentforce da Salesforce e agentes de IA da ServiceNow. A diferença: OpenAI está construindo a partir da camada do modelo para cima, enquanto os incumbentes estão adicionando IA às ferramentas de fluxo de trabalho existentes. Se as empresas preferem sua infraestrutura de agente vinda de seu provedor de IA ou seu fornecedor de software definirá a competição de IA empresarial em 2026.

Conselho de Modelo da Perplexity: Três Modelos, Uma Resposta

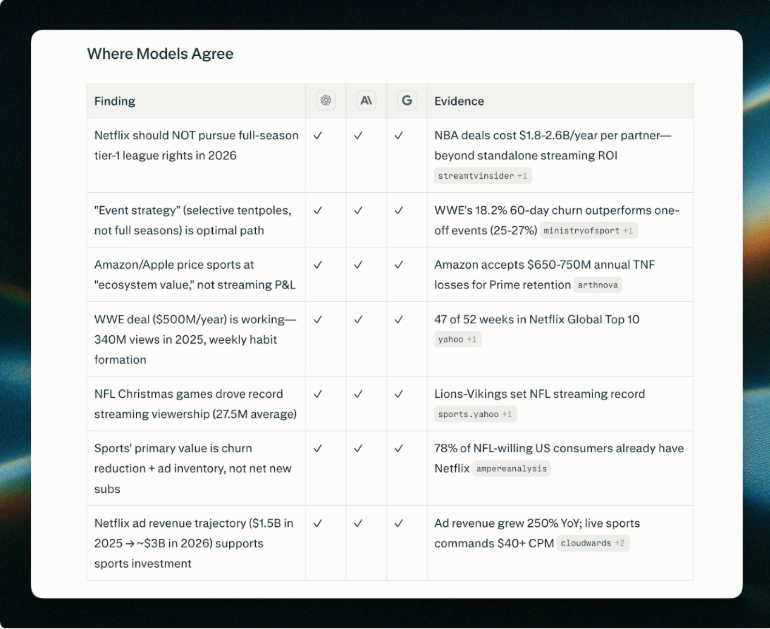

Perplexity lançou Model Council, um recurso que executa a mesma consulta em três modelos simultaneamente — Claude Opus, GPT e Gemini — então usa um modelo sintetizador para reconciliar suas saídas em uma única resposta que sinaliza áreas de concordância e discordância.

Imagem: Perplexity

A premissa é que nenhum modelo único é confiavelmente o melhor em todas as consultas. Quando três modelos de fronteira convergem para a mesma resposta, a confiança é alta. Quando eles divergem, os usuários sabem que devem investigar mais. Model Council está disponível para assinantes Max e é posicionado para pesquisa de investimento, análise estratégica e tomada de decisão complexa.

O recurso reflete a estratégia da Perplexity de se diferenciar por meio da orquestração de multi-modelo em vez de construir modelos de base. À medida que a lacuna entre os chatbots de IA de fronteira se estreita em benchmarks individuais, agregar suas saídas pode provar ser mais valioso do que escolher um único fornecedor.

O Que Tudo Isso Significa

Esses lançamentos confirmam que a competição de IA mudou de capacidade de modelo para infraestrutura de produto. Tanto OpenAI quanto Anthropic têm modelos que lideram os mesmos benchmarks; a diferenciação agora vive no que você pode construir sobre eles.

Perplexity, entretanto, está fazendo um argumento silencioso de que as guerras de modelo podem ser menos importantes do que como você combina modelos. Se Model Council provar ser útil, sugere que o futuro não é escolher entre Claude e GPT — é usar ambos.

Para os desenvolvedores e empresas que avaliam sua pilha de IA, isso acabou de tornar a decisão mais difícil.