Parcerias

Infineon Technologies e d-Matrix se unem para Infraestrutura de IA de Baixa Latência

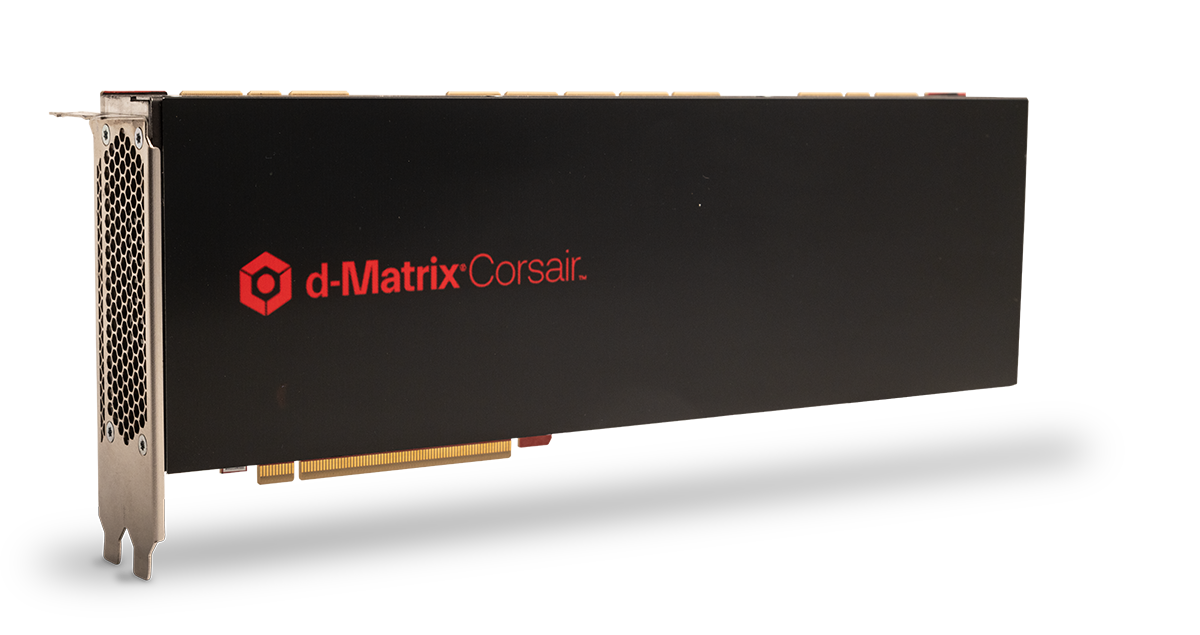

Infineon Technologies anunciou uma colaboração com d-Matrix focada em melhorar o desempenho e a eficiência energética dos sistemas de inferência de IA usados em data centers modernos. A parceria gira em torno da plataforma de aceleração de inferência de IA Corsair da d-Matrix e dos módulos de alimentação de energia OptiMOS dual-fase da Infineon, projetados para suportar ambientes de computação de alta densidade para cargas de trabalho de IA interativas.

O anúncio destaca uma mudança crescente dentro da indústria de hardware de IA. Enquanto grande parte do boom de infraestrutura nos últimos anos se concentrou em treinar modelos de IA cada vez mais grandes, a indústria agora está se expandindo rapidamente para a inferência – o processo de executar modelos em aplicações do mundo real, como chatbots, sistemas de IA agêntica, copilotos, busca, análise financeira e suporte à tomada de decisões de saúde. Essas cargas de trabalho colocam demandas diferentes sobre o hardware, particularmente em torno de latência, responsividade e consumo de energia.

Por que a Inferência de IA está se tornando um Campo de Batalha de Hardware

A Inferência de IA surgiu como um dos segmentos de crescimento mais rápido do mercado de infraestrutura de IA, pois os sistemas de IA interativos exigem respostas em milissegundos, e não em segundos. A d-Matrix tem se posicionado com a Corsair especificamente para essas cargas de trabalho, enfatizando a latência ultra-baixa e a inferência de energia eficiente para modelos de linguagem grande e agentes de IA.

De acordo com a d-Matrix, a Corsair foi projetada em torno de uma arquitetura de computação em memória digital destinada a reduzir os gargalos de memória que frequentemente desaceleram a inferência de IA gerativa. A empresa afirma que a plataforma pode reduzir significativamente a latência e melhorar a taxa de transferência em comparação com sistemas de inferência centrados em GPU tradicionais, particularmente para aplicações interativas.

A parceria com a Infineon aborda outro desafio cada vez mais crítico: a entrega de energia.

À medida que os servidores de IA continuam a aumentar em densidade, a entrega eficiente de energia aos aceleradores se tornou um fator limitante para a escalabilidade da infraestrutura. Os módulos OptiMOS TDM2254xx da Infineon são projetados para arquiteturas de entrega de energia verticais que ajudam a reduzir as perdas elétricas enquanto melhoram a densidade de energia dentro de sistemas de servidor compactos.

A Mudança para Sistemas de IA em Tempo Real

As empresas enquadraram a colaboração em torno do surgimento da “IA interativa”, onde os sistemas de inferência devem gerar continuamente saídas com atraso extremamente baixo. Isso inclui IA conversacional, agentes de IA, sistemas de raciocínio em tempo real e aplicações que exigem geração rápida de tokens a partir de modelos de linguagem grande.

O fundador e CEO da d-Matrix, Sid Sheth, disse que a arquitetura por trás da Corsair foi construída especificamente para uma latência de token sub-2 milissegundos, uma métrica que se tornou cada vez mais importante à medida que as empresas movem os sistemas de IA da experimentação para ambientes que enfrentam os clientes.

A indústria de IA mais ampla também está começando a reconhecer que a infraestrutura de inferência pode evoluir de forma diferente da infraestrutura de treinamento. Enquanto os clusters de GPU dominaram a primeira fase da expansão da IA gerativa, a inferência cada vez mais recompensa arquiteturas otimizadas em torno da largura de banda de memória, latência, rede e eficiência energética, em vez de apenas processamento bruto.

A Eficiência Energética está se tornando Central para a Escalabilidade de IA

Uma das principais restrições que enfrentam os hyperscalers e os provedores de nuvem de IA é a demanda de eletricidade. As cargas de trabalho de inferência de IA podem ser executadas continuamente em milhões de solicitações por dia, tornando a eficiência operacional crítica para os custos de implantação.

A Infineon tem se expandido agressivamente sua posição dentro da infraestrutura de IA por meio de tecnologias de semicondutores baseadas em silício, carbeto de silício (SiC) e nitreto de gálio (GaN). A empresa tem se concentrado cada vez mais em fornecer a camada de entrega de energia abaixo dos aceleradores de IA e da infraestrutura de servidor.

A colaboração com a d-Matrix reflete como as empresas de semicondutores estão se tornando mais integradas com as startups de aceleradores de IA, à medida que a indústria procura alternativas às arquiteturas convencionais baseadas em GPU.

A Infraestrutura de IA está se Expandindo Além dos GPUs Tradicionais

A parceria também chega durante uma onda mais ampla de experimentação em hardware de IA. Um número crescente de startups está desenvolvendo aceleradores especializados focados especificamente na inferência, computação centrada em memória ou redes de IA.

d-Matrix se diferenciou por meio de seu enfoque em tecnologias de computação em memória e sistemas de inferência de baixa latência personalizados para IA gerativa. A empresa também expandiu sua estratégia de infraestrutura além dos chips de acelerador apenas, enfatizando recentemente a rede, a infraestrutura componível e a otimização de sistema completo para clusters de inferência.

À medida que as aplicações de IA se tornam cada vez mais agênticas e interativas, os provedores de infraestrutura são esperados para colocar maior ênfase na redução da latência, na redução do consumo de energia e na melhoria da eficiência do sistema em todo o stack de data center, em vez de se concentrar apenas no processamento bruto.