Líderes de pensamento

Decodificando Oportunidades e Desafios para Agentes LLM em IA Gerativa

Estamos vendo uma progressão de aplicações de IA Gerativa alimentadas por grandes modelos de linguagem (LLM) desde prompts até recuperação aumentada por geração (RAG) até agentes. Agentes estão sendo amplamente discutidos em círculos industriais e de pesquisa, principalmente pelo poder que essa tecnologia fornece para transformar aplicações empresariais e fornecer experiências superiores ao cliente. Existem padrões comuns para construir agentes que habilitam os primeiros passos em direção à inteligência artificial geral (AGI).

Em meu artigo anterior article, vimos uma escada de inteligência de padrões para construir aplicações alimentadas por LLM. Começando com prompts que capturam o domínio do problema e usam a memória interna do LLM para gerar saída. Com RAG, aumentamos o prompt com conhecimento externo pesquisado em um banco de dados de vetores para controlar as saídas. Em seguida, encadeando chamadas LLM, podemos construir fluxos de trabalho para realizar aplicações complexas. Agentes levam isso a um próximo nível, determinando automaticamente como essas cadeias LLM devem ser formadas. Vamos olhar em detalhes.

Agentes – Por baixo dos panos

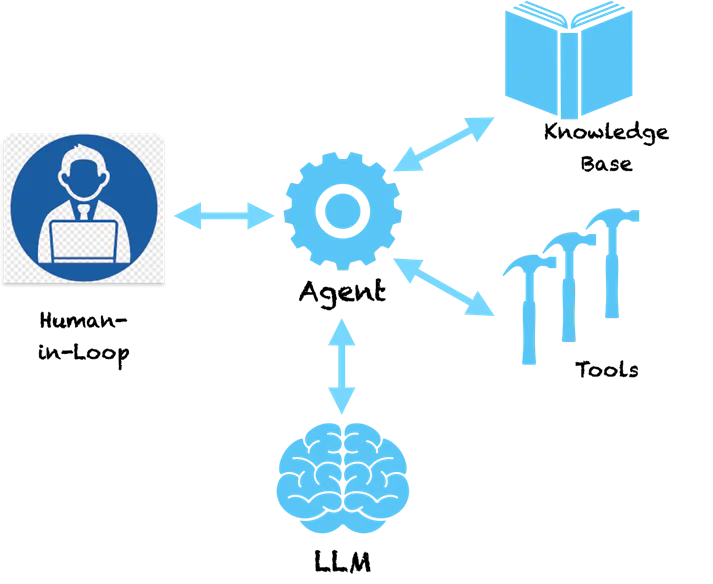

Um padrão-chave com agentes é que eles usam o poder de compreensão de linguagem do LLM para fazer um plano de como resolver um problema dado. O LLM entende o problema e nos dá uma sequência de etapas para resolver o problema. No entanto, não para por aí. Agentes não são um sistema de suporte puro que fornecerá recomendações sobre como resolver o problema e, em seguida, passará a batuta para você tomar as etapas recomendadas. Agentes são dotados de ferramentas para seguir em frente e tomar a ação. Assustador, não é?!

Se perguntarmos a um agente uma pergunta básica como esta:

Humano: Qual empresa o inventor do telefone começou?

A seguir está um exemplo de etapas de pensamento que um agente pode tomar.

Agente (PENSANDO):

- Pensamento: Preciso pesquisar o inventor do telefone.

- Ação: Pesquisar [inventor do telefone]

- Observação: Alexander Graham Bell

- Pensamento: Preciso pesquisar uma empresa que foi fundada por Alexander Graham Bell

- Ação: Pesquisar [empresa fundada por Alexander Graham Bell]

- Observação: Alexander Graham Bell co-fundou a American Telephone and Telegraph Company (AT&T) em 1885

- Pensamento: Encontrei a resposta. Vou retornar.

Agente (RESPOSTA): Alexander Graham Bell co-fundou a AT&T em 1885

Você pode ver que o agente segue um método sistemático para dividir o problema em subproblemas que podem ser resolvidos tomando ações específicas. As ações aqui são recomendadas pelo LLM e podemos mapeá-las para ferramentas específicas para implementar essas ações. Podemos habilitar uma ferramenta de pesquisa para o agente, de modo que, quando ele perceber que o LLM forneceu uma pesquisa como ação, ele chamará essa ferramenta com os parâmetros fornecidos pelo LLM. A pesquisa aqui é na internet, mas pode ser redirecionada para pesquisar uma base de conhecimento interna, como um banco de dados de vetores. O sistema agora se torna auto-suficiente e pode descobrir como resolver problemas complexos seguindo uma série de etapas. Frameworks como LangChain e LLaMAIndex fornecem uma maneira fácil de construir esses agentes e conectar a ferramentas e APIs. A Amazon recentemente lançou sua estrutura de agentes Bedrock, que fornece uma interface visual para projetar agentes.

Por baixo dos panos, os agentes seguem um estilo especial de enviar prompts ao LLM, que os faz gerar um plano de ação. O padrão de Pensamento-Ação-Observação acima é popular em um tipo de agente chamado ReAct (Raciocínio e Ação). Outros tipos de agentes incluem MRKL e Planejar e Executar, que diferem principalmente em seu estilo de prompt.

Para agentes mais complexos, as ações podem estar vinculadas a ferramentas que causem alterações em sistemas de origem. Por exemplo, podemos conectar o agente a uma ferramenta que verifique o saldo de férias e solicite licença em um sistema ERP para um funcionário. Agora podemos construir um chatbot agradável que interagiria com os usuários e, por meio de um comando de chat, aplicaria para licença no sistema. Nenhuma mais telas complexas para aplicar para licenças, uma interface de chat unificada simples. Soa emocionante!

Caveats e necessidade de IA Responsável

Agora, o que acontece se tivermos uma ferramenta que invoca transações em negociação de ações usando uma API pré-autorizada? Você constrói um aplicativo onde o agente estuda as alterações de ações (usando ferramentas) e toma decisões para você sobre a compra e venda de ações. E se o agente vender a ação errada porque ele alucinou e tomou uma decisão errada? Como os LLM são modelos enormes, é difícil apontar por que eles tomam algumas decisões, portanto, alucinações são comuns na ausência de guardrails adequados.

Enquanto os agentes são fascinantes, você provavelmente teria adivinhado como eles podem ser perigosos. Se eles alucinarem e tomarem uma ação errada, isso poderia causar enormes perdas financeiras ou problemas importantes em sistemas empresariais. Portanto, a IA Responsável está se tornando de suma importância na era de aplicações alimentadas por LLM. Os princípios de IA Responsável em torno de reprodutibilidade, transparência e responsabilidade tentam colocar guardrails nas decisões tomadas pelos agentes e sugerem análise de risco para decidir quais ações precisam de um humano no loop. À medida que agentes mais complexos estão sendo projetados, eles precisam de mais escrutínio, transparência e responsabilidade para garantir que saibamos o que eles estão fazendo.

Pensamentos finais

A capacidade dos agentes de gerar um caminho de etapas lógicas com ações os torna muito próximos do raciocínio humano. Dotá-los de ferramentas mais poderosas pode dar-lhes superpoderes. Padrões como ReAct tentam emular como os humanos resolvem o problema e veremos padrões de agentes melhores que serão relevantes para contextos e domínios específicos (banco, seguro, saúde, industrial, etc.). O futuro está aqui e a tecnologia por trás dos agentes está pronta para ser usada. Ao mesmo tempo, precisamos manter atenção próxima às guardrails de IA Responsável para garantir que não estejamos construindo o Skynet!