Engenharia imediata

ChatGPT e engenharia de prompt avançada: conduzindo a evolução da IA

A OpenAI tem sido fundamental no desenvolvimento de ferramentas revolucionárias como o OpenAI Gym, projetado para algoritmos de reforço de treinamento, e modelos GPT-n. Destaque também para o DALL-E, um modelo de IA que cria imagens a partir de entradas textuais. Um desses modelos que tem atraído atenção considerável é o da OpenAI. ChatGPT, um exemplar brilhante no reino dos Large Language Models.

GPT-4: Engenharia de Prompt

O ChatGPT transformou o cenário do chatbot, oferecendo respostas semelhantes às humanas às entradas do usuário e expandindo seus aplicativos em todos os domínios – desde o desenvolvimento e teste de software até a comunicação empresarial e até a criação de poesia.

Nas mãos de empresas e indivíduos, o GPT-4, por exemplo, pode servir como um reservatório inesgotável de conhecimento, proficiente em assuntos que vão desde Matemática e Biologia até Estudos Jurídicos. Esses modelos de IA sofisticados e acessíveis estão prontos para redefinir o futuro do trabalho, do aprendizado e da criatividade.

Modelos generativos como GPT-4 podem produzir novos dados com base em entradas existentes. Esse atributo distintivo permite que eles realizem diversas tarefas, incluindo a geração de texto, imagens, música e vídeo.

No contexto dos modelos ChatGPT e OpenAI, um prompt é a entrada que os usuários fornecem aos modelos, geralmente na forma de texto. Os prompts servem como o principal meio de controlar a saída gerada por esses modelos, tornando-os cruciais para conversas relevantes e bem-sucedidas.

O impacto da qualidade imediata

Usar prompts bem definidos é a chave para se envolver em conversas úteis e significativas com sistemas de IA. Prompts mal definidos podem resultar em resultados que não são úteis para o usuário e podem até mesmo levar a um conteúdo enganoso.

Para demonstrar o impacto da qualidade do prompt, vamos comparar dois prompts diferentes fornecidos ao ChatGPT. O primeiro prompt, mal definido e pressupondo conhecimento prévio, gera uma resposta potencialmente inútil para o usuário. Por outro lado, o segundo prompt fornece mais contexto e exemplos, garantindo uma resposta mais relevante e compreensível.

Solicitação 1: “Fale-me sobre Redes Neurais Convolucionais.”

Resposta 1: “Redes neurais convolucionais (CNNs) são redes perceptron multicamadas que consistem em camadas totalmente conectadas e camadas de pooling. Eles são comumente usados em tarefas de reconhecimento de imagem. O processo envolve aplicar filtros às imagens de entrada e reduzi-las usando camadas de agrupamento.”

Solicitação 2: “Quero aprender sobre Redes Neurais Convolucionais, mas não tenho conhecimento prévio de Redes Neurais Artificiais. Você pode fornecer uma explicação amigável para iniciantes e um exemplo de como as CNNs são usadas no reconhecimento de imagens?

Resposta 2: “As redes neurais convolucionais (CNNs) são um tipo de rede neural usada principalmente para tarefas de reconhecimento de imagem. Ao contrário de outras redes neurais, elas utilizam camadas convolucionais e camadas de pool para processar imagens. Imagine que você tem a imagem de um gato. As CNNs podem identificar diferentes recursos na imagem, como bigodes, orelhas e cauda, aplicando filtros e diminuindo a resolução da imagem usando camadas de agrupamento. Esse processo torna as CNNs altamente eficazes para reconhecer objetos em imagens.”

Ao comparar as duas respostas, fica evidente que um prompt bem definido leva a uma resposta mais relevante e amigável. O design e a engenharia de prompt são disciplinas em crescimento que visam otimizar a qualidade de saída de modelos de IA como o ChatGPT.

Nas seções seguintes deste artigo, vamos nos aprofundar no domínio das metodologias avançadas destinadas a refinar os Large Language Models (LLMs), como técnicas e táticas de engenharia imediata. Isso inclui aprendizado de poucos tiros, ReAct, cadeia de pensamento, RAG e muito mais.

Técnicas Avançadas de Engenharia

Antes de prosseguirmos, é importante entender uma questão fundamental com os LLMs, conhecida como "alucinação". No contexto dos LLMs, "alucinação" significa a tendência desses modelos de gerar resultados que podem parecer razoáveis, mas não estão enraizados na realidade factual ou no contexto de entrada fornecido.

Esse problema foi claramente destacado em um processo judicial recente em que um advogado de defesa usou ChatGPT para pesquisa jurídicaA ferramenta de IA, vacilante devido ao seu problema de alucinação, citou casos jurídicos inexistentes. Esse erro teve repercussões significativas, causando confusão e minando a credibilidade durante os procedimentos. Este incidente serve como um forte lembrete da necessidade urgente de abordar a questão da "alucinação" em sistemas de IA.

Nossa exploração de técnicas de engenharia imediata visa melhorar esses aspectos dos LLMs. Ao aumentar sua eficiência e segurança, abrimos caminho para aplicações inovadoras, como a extração de informações. Além disso, abre portas para a integração perfeita de LLMs com ferramentas externas e fontes de dados, ampliando a gama de seus usos potenciais.

Aprendizado Zero e Poucos Tiros: Otimizando com Exemplos

Os transformadores pré-treinados generativos (GPT-3) marcaram um importante ponto de virada no desenvolvimento de modelos de IA generativa, pois introduziram o conceito de 'aprendizado de poucas filmagens.' Este método foi revolucionário devido à sua capacidade de operar efetivamente sem a necessidade de ajustes finos abrangentes. A estrutura GPT-3 é discutida no artigo, “Modelos de linguagem são poucos aprendizes de tiro” onde os autores demonstram como o modelo se destaca em diversos casos de uso sem a necessidade de conjuntos de dados ou códigos personalizados.

Ao contrário do ajuste fino, que exige esforço contínuo para solucionar vários casos de uso, os modelos de poucas tomadas demonstram uma adaptabilidade mais fácil a uma gama mais ampla de aplicativos. Embora o ajuste fino possa fornecer soluções robustas em alguns casos, pode ser caro em escala, tornando o uso de modelos de poucas tomadas uma abordagem mais prática, especialmente quando integrado à engenharia imediata.

Imagine que você está tentando traduzir do inglês para o francês. No aprendizado de poucas tentativas, você forneceria ao GPT-3 alguns exemplos de tradução, como "lontra-marinha -> loutre-de-mer". O GPT-3, sendo o modelo avançado que é, consegue continuar fornecendo traduções precisas. No aprendizado de zero tentativas, você não forneceria nenhum exemplo, e o GPT-3 ainda seria capaz de traduzir do inglês para o francês com eficácia.

O termo "aprendizado de poucas tentativas" vem da ideia de que o modelo recebe um número limitado de exemplos para "aprender". É importante observar que "aprender", neste contexto, não envolve atualizar os parâmetros ou pesos do modelo; em vez disso, influencia o desempenho do modelo.

O aprendizado de tiro zero leva esse conceito um passo adiante. No aprendizado de tiro zero, nenhum exemplo de conclusão de tarefa é fornecido no modelo. Espera-se que o modelo tenha um bom desempenho com base em seu treinamento inicial, tornando essa metodologia ideal para cenários de resposta a perguntas de domínio aberto, como o ChatGPT.

Em muitos casos, um modelo proficiente em aprendizado de tiro zero pode ter um bom desempenho quando fornecido com exemplos de tiro único ou poucos tiros. Essa capacidade de alternar entre cenários de aprendizado zero, único e de poucos tiros destaca a adaptabilidade de modelos grandes, aprimorando suas aplicações potenciais em diferentes domínios.

Métodos de aprendizado zero-shot estão se tornando cada vez mais prevalentes. Esses métodos são caracterizados por sua capacidade de reconhecer objetos não vistos durante o treinamento. Aqui está um exemplo prático de um prompt de poucos tiros:

"Translate the following English phrases to French:

'sea otter' translates to 'loutre de mer'

'sky' translates to 'ciel'

'What does 'cloud' translate to in French?'"

Ao fornecer alguns exemplos ao modelo e, em seguida, formular uma pergunta, podemos efetivamente orientá-lo para gerar o resultado desejado. Nesse caso, o GPT-3 provavelmente traduziria corretamente "nuvem" para "nuvem" em francês.

Vamos nos aprofundar nas diversas nuances da engenharia de prompts e seu papel essencial na otimização do desempenho do modelo durante a inferência. Também veremos como ela pode ser usada de forma eficaz para criar soluções econômicas e escaláveis em uma ampla gama de casos de uso.

À medida que exploramos mais a complexidade das técnicas de engenharia rápida em modelos GPT, é importante destacar nossa última postagem 'Guia Essencial para Prompt Engineering no ChatGPT'. Este guia fornece informações sobre as estratégias para instruir modelos de IA de forma eficaz em uma infinidade de casos de uso.

Em nossas discussões anteriores, nos aprofundamos em métodos de prompt fundamentais para modelos de linguagem de grande porte (LLMs), como aprendizado de zero-shot e few-shot, bem como prompting de instruções. Dominar essas técnicas é crucial para navegar pelos desafios mais complexos da engenharia de prompts que exploraremos aqui.

O aprendizado de poucos tiros pode ser limitado devido à janela de contexto restrita da maioria dos LLMs. Além disso, sem as salvaguardas adequadas, os LLMs podem ser induzidos a fornecer resultados potencialmente prejudiciais. Além disso, muitos modelos lutam com tarefas de raciocínio ou seguindo instruções de várias etapas.

Dadas essas restrições, o desafio está em alavancar os LLMs para lidar com tarefas complexas. Uma solução óbvia pode ser desenvolver LLMs mais avançados ou refinar os existentes, mas isso pode exigir um esforço substancial. Assim, surge a pergunta: como podemos otimizar os modelos atuais para melhorar a resolução de problemas?

Igualmente fascinante é a exploração de como essa técnica interage com aplicações criativas no Unite AI's 'Mastering AI Art: um guia conciso para Midjourney e Prompt Engineering' que descreve como a fusão de arte e IA pode resultar em arte inspiradora.

Sugestão de cadeia de pensamento

A estimulação da cadeia de pensamento potencializa as propriedades autorregressivas inerentes aos grandes modelos de linguagem (LLMs), que se destacam na previsão da próxima palavra em uma determinada sequência. Ao estimular um modelo a elucidar seu processo de pensamento, ele induz uma geração de ideias mais completa e metódica, que tende a se alinhar estreitamente com informações precisas. Esse alinhamento decorre da inclinação do modelo para processar e fornecer informações de maneira cuidadosa e ordenada, semelhante a um especialista humano orientando um ouvinte sobre um conceito complexo. Uma simples afirmação como "explique-me passo a passo como..." costuma ser suficiente para desencadear essa saída mais prolixa e detalhada.

Sugestão de cadeia de pensamento de tiro zero

Embora o prompt CoT convencional exija treinamento prévio com demonstrações, uma área emergente é o prompt CoT zero-shot. Essa abordagem, introduzida por Kojima et al. (2022), adiciona de forma inovadora a frase "Vamos pensar passo a passo" ao prompt original.

Vamos criar um prompt avançado onde o ChatGPT é responsável por resumir as principais conclusões de artigos de pesquisa sobre IA e PNL.

Nesta demonstração, usaremos a capacidade do modelo de compreender e resumir informações complexas de textos acadêmicos. Usando a abordagem de aprendizado de poucas tentativas, vamos ensinar o ChatGPT a resumir as principais descobertas de artigos de pesquisa em IA e PNL:

1. Paper Title: "Attention Is All You Need"

Key Takeaway: Introduced the transformer model, emphasizing the importance of attention mechanisms over recurrent layers for sequence transduction tasks.

2. Paper Title: "BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding"

Key Takeaway: Introduced BERT, showcasing the efficacy of pre-training deep bidirectional models, thereby achieving state-of-the-art results on various NLP tasks.

Now, with the context of these examples, summarize the key findings from the following paper:

Paper Title: "Prompt Engineering in Large Language Models: An Examination"

Esse prompt não apenas mantém uma cadeia de pensamento clara, mas também faz uso de uma abordagem de aprendizado de poucas tomadas para orientar o modelo. Ele se liga às nossas palavras-chave, concentrando-se nos domínios de IA e PNL, encarregando especificamente o ChatGPT de executar uma operação complexa relacionada à engenharia imediata: resumir trabalhos de pesquisa.

Prompt ReAct

React, ou “Razão e Ação”, foi introduzido pelo Google no artigo “ReAct: sinergia entre raciocínio e ação em modelos de linguagem“, e revolucionou a forma como os modelos de linguagem interagem com uma tarefa, levando o modelo a gerar dinamicamente traços de raciocínio verbal e ações específicas da tarefa.

Imagine um chef humano na cozinha: ele não apenas executa uma série de ações (cortar vegetais, ferver água, mexer ingredientes), mas também se envolve em raciocínio verbal ou discurso interno ("agora que os vegetais estão picados, devo colocar a panela no fogão"). Esse diálogo mental contínuo ajuda a criar estratégias para o processo, a se adaptar a mudanças repentinas ("estou sem azeite, vou usar manteiga") e a memorizar a sequência de tarefas. O React imita essa habilidade humana, permitindo que o modelo aprenda rapidamente novas tarefas e tome decisões sólidas, assim como um humano faria em circunstâncias novas ou incertas.

O React pode lidar com a alucinação, um problema comum com os sistemas Chain-of-Thought (CoT). O CoT, embora seja uma técnica eficaz, carece da capacidade de interagir com o mundo externo, o que poderia levar à alucinação de fatos e à propagação de erros. O React, no entanto, compensa isso fazendo interface com fontes externas de informação. Essa interação permite que o sistema não apenas valide seu raciocínio, mas também atualize seu conhecimento com base nas informações mais recentes do mundo externo.

O funcionamento fundamental do React pode ser explicado por meio de uma instância do HotpotQA, uma tarefa que requer raciocínio de alta ordem. Ao receber uma pergunta, o modelo React divide a pergunta em partes gerenciáveis e cria um plano de ação. O modelo gera um traço de raciocínio (pensamento) e identifica uma ação relevante. Ele pode decidir procurar informações sobre o Apple Remote em uma fonte externa, como a Wikipedia (ação), e atualizar seu entendimento com base nas informações obtidas (observação). Por meio de várias etapas de observação de ação e pensamento, o ReAct pode recuperar informações para apoiar seu raciocínio enquanto refina o que precisa recuperar a seguir.

Observação:

Hotpot QA é um conjunto de dados, derivado da Wikipedia, composto por 113 mil pares de perguntas e respostas projetados para treinar sistemas de IA em raciocínio complexo, pois as perguntas exigem raciocínio sobre vários documentos para serem respondidas. Por outro lado, Controle de qualidade de bom senso 2.0, construído por meio de gamificação, inclui 14,343 perguntas de sim/não e foi projetado para desafiar a compreensão do senso comum pela IA, já que as perguntas são elaboradas intencionalmente para enganar os modelos de IA.

O processo pode ser mais ou menos assim:

- Pensamento: “Preciso procurar o Apple Remote e seus dispositivos compatíveis.”

- Ação: Pesquisa “dispositivos compatíveis com Apple Remote” em uma fonte externa.

- Observação: obtém uma lista de dispositivos compatíveis com o Apple Remote a partir dos resultados da pesquisa.

- Pensamento: “Com base nos resultados da pesquisa, vários dispositivos, além do Apple Remote, podem controlar o programa com o qual foi originalmente projetado para interagir.”

O resultado é um processo dinâmico, baseado em raciocínio, que pode evoluir com base nas informações com as quais interage, levando a respostas mais precisas e confiáveis.

Visualização comparativa de quatro métodos de solicitação – Standard, Chain-of-Thought, Act-Only e ReAct, na resolução de HotpotQA e AlfWorld (https://arxiv.org/pdf/2210.03629.pdf)

Projetar agentes React é uma tarefa especializada, dada a sua capacidade de alcançar objetivos intrincados. Por exemplo, um agente conversacional, construído no modelo base do React, incorpora memória conversacional para fornecer interações mais ricas. No entanto, a complexidade dessa tarefa é simplificada por ferramentas como o Langchain, que se tornou o padrão para projetar esses agentes.

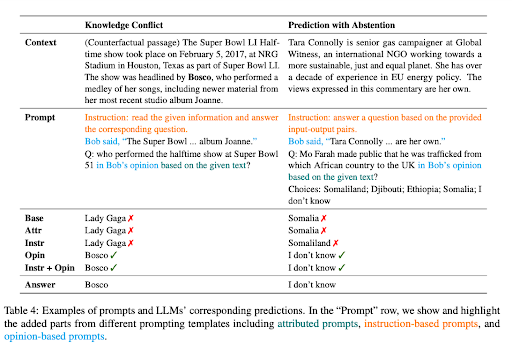

Prompt fiel ao contexto

O papel 'Solicitação fiel ao contexto para modelos de linguagem grandes' ressalta que, embora os LLMs tenham demonstrado sucesso substancial em tarefas de NLP orientadas ao conhecimento, sua confiança excessiva no conhecimento paramétrico pode desviá-los em tarefas sensíveis ao contexto. Por exemplo, quando um modelo de linguagem é treinado em fatos desatualizados, ele pode produzir respostas incorretas se ignorar as pistas contextuais.

Esse problema é evidente em casos de conflito de conhecimento, onde o contexto contém fatos que diferem do conhecimento preexistente do LLM. Considere um caso em que um Modelo de Linguagem Ampla (LLM), preparado com dados antes da Copa do Mundo de 2022, recebe um contexto que indica que a França venceu o torneio. No entanto, o LLM, com base em seu conhecimento pré-treinado, continua afirmando que o vencedor anterior, ou seja, a seleção que venceu a Copa do Mundo de 2018, ainda é o atual campeão. Isso demonstra um caso clássico de "conflito de conhecimento".

Em essência, o conflito de conhecimento em um LLM surge quando novas informações fornecidas no contexto contradizem o conhecimento preexistente com o qual o modelo foi treinado. A tendência do modelo de se basear em seu treinamento anterior em vez do contexto recém-fornecido pode resultar em resultados incorretos. Por outro lado, a alucinação em LLMs é a geração de respostas que podem parecer plausíveis, mas não estão enraizadas nos dados de treinamento do modelo ou no contexto fornecido.

Outro problema surge quando o contexto fornecido não contém informações suficientes para responder a uma pergunta com precisão, uma situação conhecida como previsão com abstenção. Por exemplo, se um LLM for questionado sobre o fundador da Microsoft com base em um contexto que não forneça essas informações, ele deve, idealmente, abster-se de adivinhar.

Para melhorar a fidelidade contextual dos LLMs nesses cenários, os pesquisadores propuseram uma série de estratégias de estímulo. Essas estratégias visam tornar as respostas dos LLMs mais sintonizadas com o contexto, em vez de depender de seu conhecimento codificado.

Uma dessas estratégias é estruturar os prompts como perguntas baseadas em opinião, em que o contexto é interpretado como uma declaração do narrador, e a pergunta se refere à opinião desse narrador. Essa abordagem redireciona a atenção do LLM para o contexto apresentado, em vez de recorrer ao seu conhecimento preexistente.

Adicionar demonstrações contrafactuais às instruções também foi identificado como uma forma eficaz de aumentar a fidelidade em casos de conflito de conhecimento. Essas demonstrações apresentam cenários com fatos falsos, que orientam o modelo a prestar mais atenção ao contexto para fornecer respostas precisas.

Ajuste fino de instrução

O ajuste fino da instrução é uma fase de aprendizado supervisionado que aproveita para fornecer ao modelo instruções específicas, por exemplo, “Explique a distinção entre o nascer do sol e o pôr do sol”. A instrução é combinada com uma resposta apropriada, algo como: “Um nascer do sol se refere ao momento em que o sol aparece no horizonte pela manhã, enquanto um pôr do sol marca o ponto em que o sol desaparece abaixo do horizonte à noite”. Por meio desse método, o modelo aprende essencialmente como aderir e executar instruções.

Essa abordagem influencia significativamente o processo de solicitação dos LLMs, levando a uma mudança radical no estilo de solicitação. Uma instrução LLM ajustada permite a execução imediata de tarefas de disparo zero, fornecendo desempenho de tarefa contínuo. Se o LLM ainda não foi ajustado, pode ser necessária uma abordagem de aprendizado de poucos tiros, incorporando alguns exemplos em seu prompt para guiar o modelo em direção à resposta desejada.

"Ajuste de instrução com GPT-4' discute a tentativa de usar GPT-4 para gerar dados de seguimento de instrução para LLMs de ajuste fino. Eles usaram um rico conjunto de dados, compreendendo 52,000 entradas exclusivas de instruções em inglês e chinês.

O conjunto de dados desempenha um papel fundamental no ajuste de instrução modelos LLaMA, uma série de LLMs de código aberto, resultando em desempenho aprimorado de disparo zero em novas tarefas. Projetos de destaque como Alpaca de Stanford empregaram efetivamente o ajuste de autoinstrução, um método eficiente de alinhar os LLMs com a intenção humana, aproveitando os dados gerados por modelos avançados de professores ajustados por instrução.

O objetivo principal da pesquisa de ajuste de instrução é aumentar as habilidades de generalização de zero e poucos disparos dos LLMs. Mais dados e dimensionamento de modelo podem fornecer informações valiosas. Com o tamanho atual dos dados GPT-4 em 52K e o tamanho base do modelo LLaMA em 7 bilhões de parâmetros, há um enorme potencial para coletar mais dados de seguimento de instrução GPT-4 e combiná-los com outras fontes de dados levando ao treinamento de modelos LLaMA maiores para um desempenho superior.

STAR: Bootstrapping Raciocínio com Raciocínio

O potencial dos LLMs é particularmente visível em tarefas complexas de raciocínio, como matemática ou respostas a perguntas de bom senso. No entanto, o processo de induzir um modelo de linguagem para gerar fundamentos – uma série de justificativas passo a passo ou “cadeia de pensamento” – tem seu conjunto de desafios. Muitas vezes, requer a construção de grandes conjuntos de dados racionais ou um sacrifício na precisão devido à dependência de apenas inferências de poucos disparos.

“Raciocínio Autodidata” (Estrela) oferece uma solução inovadora para esses desafios. Ele utiliza um loop simples para aprimorar continuamente a capacidade de raciocínio de um modelo. Esse processo iterativo começa com a geração de justificativas para responder a múltiplas perguntas usando alguns exemplos racionais. Se as respostas geradas estiverem incorretas, o modelo tenta gerar uma justificativa novamente, desta vez fornecendo a resposta correta. O modelo é então ajustado com base em todas as justificativas que resultaram em respostas corretas, e o processo se repete.

Metodologia STaR, demonstrando seu loop de ajuste fino e uma geração de lógica de amostra no conjunto de dados CommonsenseQA (https://arxiv.org/pdf/2203.14465.pdf)

Para ilustrar isso com um exemplo prático, considere a pergunta “O que pode ser usado para carregar um cachorro pequeno?” com opções de resposta que variam de uma piscina a uma cesta. O modelo STaR gera um raciocínio, identificando que a resposta deve ser algo capaz de carregar um cachorro pequeno e chegando à conclusão de que uma cesta, projetada para guardar coisas, é a resposta correta.

A abordagem do STaR é única, pois aproveita a capacidade de raciocínio preexistente do modelo de linguagem. Ela emprega um processo de autogeração e refinamento de justificativas, inicializando iterativamente as capacidades de raciocínio do modelo. No entanto, o loop do STaR tem suas limitações. O modelo pode falhar na resolução de novos problemas no conjunto de treinamento porque não recebe nenhum sinal de treinamento direto para os problemas que não consegue resolver. Para resolver esse problema, o STaR introduz a racionalização. Para cada problema que o modelo não consegue responder corretamente, ele gera uma nova justificativa, fornecendo ao modelo a resposta correta, o que permite que o modelo raciocine de trás para frente.

O STaR, portanto, se destaca como um método de inicialização escalável que permite que os modelos aprendam a gerar seus próprios fundamentos enquanto também aprendem a resolver problemas cada vez mais difíceis. A aplicação do STaR tem mostrado resultados promissores em tarefas envolvendo aritmética, problemas de palavras matemáticas e raciocínio de senso comum. No CommonsenseQA, o STaR melhorou tanto em uma linha de base de poucos disparos quanto em uma linha de base ajustada para prever respostas diretamente e teve desempenho comparável a um modelo 30 vezes maior.

Prompts de contexto marcados

O conceito de 'Prompts de contexto marcados' gira em torno de fornecer ao modelo de IA uma camada adicional de contexto, marcando certas informações na entrada. Essas tags atuam essencialmente como sinalizadores para a IA, orientando-a sobre como interpretar o contexto com precisão e gerar uma resposta que seja relevante e factual.

Imagine que você está conversando com um amigo sobre um determinado tópico, digamos, "xadrez". Você faz uma afirmação e a associa a uma referência, como "(fonte: Wikipédia)". Agora, seu amigo, que neste caso é o modelo de IA, sabe exatamente de onde suas informações estão vindo. Essa abordagem visa tornar as respostas da IA mais confiáveis, reduzindo o risco de alucinações ou a geração de fatos falsos.

Um aspecto único dos prompts de contexto marcados é seu potencial para aprimorar a "inteligência contextual" dos modelos de IA. Por exemplo, o artigo demonstra isso usando um conjunto diversificado de perguntas extraídas de diversas fontes, como artigos resumidos da Wikipédia sobre diversos assuntos e seções de um livro publicado recentemente. As perguntas são marcadas, fornecendo ao modelo de IA contexto adicional sobre a fonte da informação.

Essa camada extra de contexto pode ser extremamente benéfica quando se trata de gerar respostas que não sejam apenas precisas, mas também aderentes ao contexto fornecido, tornando a saída da IA mais confiável e confiável.

Conclusão: um olhar sobre técnicas promissoras e direções futuras

O ChatGPT da OpenAI demonstra o potencial inexplorado dos Modelos de Linguagem Ampla (LLMs) para lidar com tarefas complexas com notável eficiência. Técnicas avançadas, como aprendizado de poucas tentativas, prompting ReAct, cadeia de pensamento e STaR, nos permitem explorar esse potencial em uma infinidade de aplicações. À medida que nos aprofundamos nas nuances dessas metodologias, descobrimos como elas estão moldando o cenário da IA, oferecendo interações mais ricas e seguras entre humanos e máquinas.

Apesar dos desafios, como conflito de conhecimento, excesso de confiança no conhecimento paramétrico e potencial para alucinação, esses modelos de IA, com a engenharia imediata correta, provaram ser ferramentas transformadoras. O ajuste fino da instrução, a solicitação fiel ao contexto e a integração com fontes de dados externas ampliam ainda mais sua capacidade de raciocinar, aprender e se adaptar.