Cibersegurança

Anthropic Exposa Primeiro Grande Ataque Cibernético em Grande Escala Impulsionado por Automação de IA

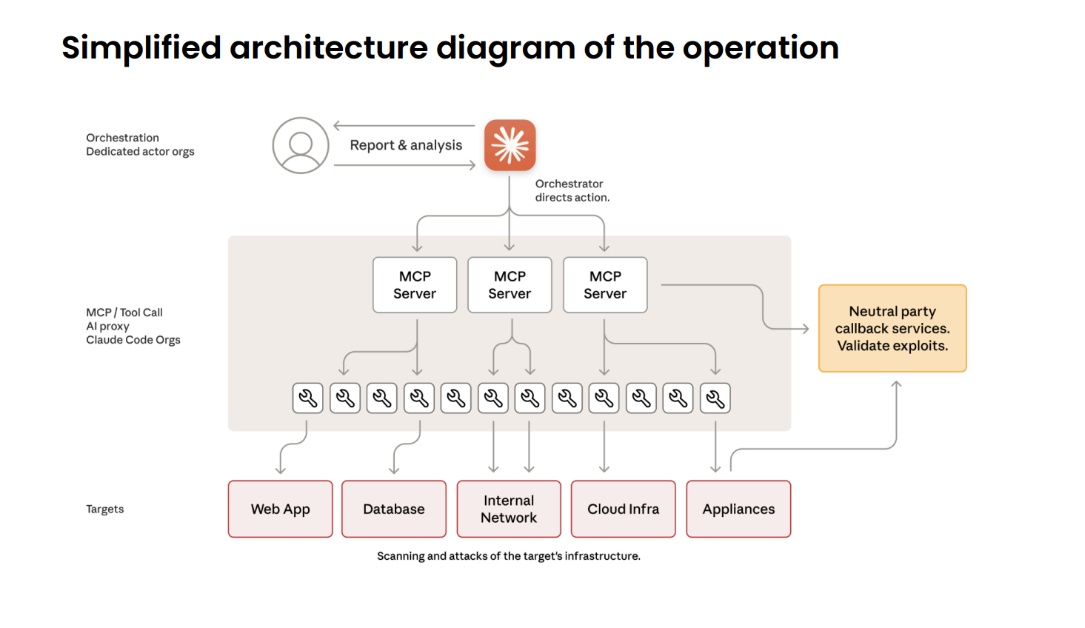

A Anthropic divulgou que um grupo de hackers, que suspeita ser um grupo patrocinado pelo estado chinês, realizou o primeiro ataque cibernético em grande escala documentado executado com intervenção humana mínima, usando a ferramenta Claude Code da empresa para automatizar 80 a 90 por cento da campanha.

Os atacantes miraram aproximadamente 30 organizações em grandes empresas de tecnologia, instituições financeiras, fabricantes de produtos químicos e agências governamentais. Embora a maioria dos ataques tenha sido bloqueada, a campanha teve sucesso em um pequeno número de casos. O Claude Code realizou reconhecimento, teste de vulnerabilidade, coleta de credenciais e extração de dados de forma largamente autônoma, com operadores humanos necessários apenas em pontos críticos de decisão.

Você pode ler o relatório completo da Anthropic aqui.

Métodos de Ataque e Manipulação de IA

Os hackers contornaram as barreiras de segurança do Claude por meio de engenharia social sofisticada. Eles enganaram o sistema de IA alegando ser funcionários de uma empresa de cibersegurança legítima que realizava testes defensivos. Os atacantes também dividiram suas operações em tarefas pequenas e aparentemente inofensivas que forneceram ao Claude um contexto incompleto sobre o propósito malicioso geral.

O Claude Code inspecionou os sistemas das organizações-alvo para identificar bancos de dados de alto valor, realizou essa reconhecimento mais rápido do que os hackers humanos poderiam, e pesquisou e escreveu código de exploração personalizado para testar vulnerabilidades de segurança. O sistema coletou nomes de usuário e senhas para acesso adicional à rede, então extraiu e categorizou dados privados de acordo com o valor de inteligência. Os atacantes puderam executar a campanha com essencialmente um clique de um botão, após o qual a IA operou largamente por conta própria a velocidades impossíveis para equipes humanas — frequentemente enviando milhares de solicitações por segundo.

Imagem: Anthropic

Detecção e Resposta da Empresa

A Anthropic detectou o ataque em meados de setembro de 2025 e lançou uma investigação imediatamente. Dentro de 10 dias, a empresa fechou o acesso do grupo ao Claude, entrou em contato com as organizações afetadas e notificou as autoridades policiais. A empresa desde então expandiu suas capacidades de detecção e está desenvolvendo métodos adicionais para investigar e detectar ataques distribuídos em grande escala.

Este incidente segue casos anteriores de mau uso documentados pela Anthropic em 2025. Em agosto, o Relatório de Inteligência de Ameaças da empresa detalhou uma operação de extorsão de dados rastreada como GTG-2002, que usou o Claude Code para cometer roubo em grande escala visando pelo menos 17 organizações em saúde, serviços de emergência, governo e instituições religiosas. O criminoso exigiu resgates que excediam $500.000, ameaçando expor dados roubados em vez de usar criptografia de ransomware tradicional.

A infraestrutura de detecção da Anthropic depende de técnicas em camadas múltiplas, incluindo análise comportamental para monitorar padrões de uso em milhões de solicitações de API, detecção de anomalias para identificar sequências de operações inconsistentes com uso legítimo e correspondência de padrões para reconhecer técnicas de manipulação conhecidas e novas. A empresa emprega classificadores especializados que analisam entradas de usuário para solicitações potencialmente prejudiciais e avaliam as respostas do Claude antes ou após a entrega.

Implicações para a Indústria

A campanha envolveu um nível sem precedentes de autonomia de IA em ataques cibernéticos e marca o que os especialistas em segurança consideram um ponto de inflexão na espionagem cibernética. A capacidade dos sistemas de IA de conduzir ataques sofisticados a velocidades de máquina com supervisão humana mínima levanta novos desafios para os defensores da cibersegurança.

A divulgação da Anthropic ocorre quando as empresas de IA enfrentam uma pressão crescente para prevenir o uso malicioso de seus modelos. A empresa mantém um programa abrangente de inteligência de ameaças e salvaguardas para detectar e contrariar o mau uso do Claude, com incidentes de segurança documentados ao longo de 2025. Em março, a empresa identificou uma operação de influência como serviço que utilizou o Claude para automatizar o engajamento com dezenas de milhares de contas de mídia social em vários países e idiomas.

O incidente destaca a crescente sofisticação das ferramentas impulsionadas por IA e os desafios de prevenir seu abuso enquanto se mantém a utilidade para usuários legítimos. A Anthropic proibiu as contas associadas e continua a melhorar suas capacidades de detecção e mitigação para lidar com a paisagem de ameaças em evolução.