Ângulo de Anderson

A IA Prefere Ler o Livro em vez de Assistir ao Filme

É surpreendentemente difícil fazer com que os modelos de IA assistam e comentem o conteúdo de vídeo real, mesmo que sejam feitos para essa tarefa. Eles estão mais interessados na palavra escrita.

Se você já tentou fazer o upload de um pequeno clipe de vídeo para o ChatGPT ou para um modelo de visão/linguagem popular semelhante, você pode ter se surpreendido ao perceber que eles não podem realmente analisar o vídeo. Embora modelos como o ChatGPT-4o+ sejam capazes de analisar quadros individuais – na forma de imagens, como JPEG e PNG –, eles preferem que o usuário extraia seus próprios quadros e faça o upload deles como imagens (que estão preparados para comentar).

No caso da série GPT da OpenAI, é possível, de forma um pouco laboriosa, extrair uma sequência completa de quadros de um clipe de vídeo e alimentar esses quadros com o ChatGPT, para fins de, por exemplo, gerar uma trilha narrativa criada por IA para o vídeo:

![Imagens e código de um tutorial da OpenAI sobre análise de múltiplos quadros extraídos para o desenvolvimento de uma trilha de comentário gerada por IA para um clipe de vídeo. [ Fonte ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Imagens e código de um tutorial da OpenAI sobre análise de múltiplos quadros extraídos para o desenvolvimento de uma trilha de comentário gerada por IA para um clipe de vídeo. Fonte

Mas cabe ao usuário fazer a conversão de vídeo para quadros, seja chamando funções em uma rotina maior, como no exemplo acima, ou extrair os quadros com FFMPEG ou várias soluções de edição de vídeo gratuitas ou pagas.

Em certa medida, talvez até uma grande medida, as limitações na análise de vídeo em produtos de grande escala, como o ChatGPT, dependem do uso de recursos: apenas equipar uma instância de IA com uma seleção dos codecs de vídeo mais populares e comprometer recursos de computação com o processo dispendioso e que consome CPU de extração não é uma consideração menor, caso centenas de milhões de usuários decidam começar a usar essas instalações todos os dias.

Além disso, a análise temporal pode pintar um quadro muito diferente do que um único quadro (Imagine alguém entrando em uma casa com um humor feliz e, em seguida, descobrindo um corpo); portanto, considerar a “assinatura temporal” completa de um clipe de vídeo, mesmo que curto, é uma tarefa exigente e intensiva em recursos –, bem como uma área especializada da literatura de pesquisa, por exemplo, com o desenvolvimento contínuo de estruturas como Optical Flow – que basicamente “desdobra” um trecho de vídeo para que possa ser considerado e agido como se fosse um documento estático:

![Diagramas de fluxo óptico destacam como o movimento é rastreado em quadros em uma sequência de vídeo, com vetores verdes mostrando direção e intensidade do movimento. Esses mapeamentos fornecem a continuidade temporal necessária para os VLMs e também podem servir como guias estruturais em fluxos de trabalho de VFX. [ Fonte ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Diagramas de fluxo óptico destacam como o movimento é rastreado em quadros em uma sequência de vídeo, com vetores verdes mostrando direção e intensidade do movimento. Esses mapeamentos fornecem a continuidade temporal necessária para os VLMs e também podem servir como guias estruturais em fluxos de trabalho de VFX. Fonte

Conformando-se com as Notas do Cliff

No entanto, como modelos como o Notebook LM da Google e as entradas mais recentes do ChatGPT são capazes de ler metadados associados (ou seja, conteúdo de texto incorporado que contextualiza o vídeo de alguma forma), eles não proíbem o upload de arquivos de vídeo; e às vezes, eles até tentarão interpretar um vídeo que não tem esses dados.

Nesse caso, eu faço o upload de um clipe aleatório de 6 segundos do filme italiano A Mão de Deus (2021) para o NotebookLM, garantindo que o clipe contenha zero texto útil, seja em metadados ou no nome do arquivo.

O NotebookLM então procede a elaborar material totalmente não relacionado ao vídeo*, completo com um podcast de cinco minutos sem sentido e não relacionado:

Um momento cotidiano em um clipe de seis segundos de um filme italiano é amplamente mal interpretado pelo NotebookLM. Fonte: Google NotebookLM

Embora o Notebook, como o ChatGPT, aceite um vídeo do YouTube como entrada, ele só o fará se o vídeo tiver uma anotação de texto interpretável e/ou legendas (não legendas rasterizadas queimadas no vídeo).

Dessa forma, o trabalho árduo de realmente olhar para o conteúdo do vídeo e realizar a interpretação semântica (uma necessidade legal para o YouTube, devido às suas medidas de proteção contra direitos autorais, e seu sistema de proteção de identidade pendente), foi feito com tranquilidade após o upload do usuário, e quando o clipe pôde ser alocado os recursos de processamento necessários.

A interpretação real de vídeo é cara e exaustiva, e, como se descobriu, mesmo os modelos treinados especificamente para realizar essa tarefa preferem ler texto a realmente olhar para o vídeo.

TL;DW

Isso, de acordo com um novo artigo do Reino Unido, da Universidade de Bristol, intitulado Um Vídeo não Vale Mil Palavras, no qual os dois autores concluem que os atuais modelos de visão e linguagem de ponta (VLMs) – modelos destinados a ser capazes de analisar vídeo de forma mais esforçada e participar de resposta a perguntas de vídeo (VQA) – também recorrem a informações baseadas em texto sempre que possível.

Quando fornecidos com imagens em movimento e perguntas e respostas múltiplas escritas, os autores do artigo descobriram que os modelos geralmente baseavam suas escolhas em padrões no texto, em vez de qualquer coisa que aconteça na tela – em muitos casos, performando tão bem quanto quando a pergunta era removida completamente.

Em o que parece ser uma forma habitual de atalho ou trapaça, o que mais importava para a maioria dos modelos era ser capaz de detectar padrões nas respostas possíveis; apenas quando a tarefa foi dificultada, adicionando mais opções de resposta, as IAs começaram a prestar mais atenção ao vídeo.

Os autores deram testes de VQA sob uma variedade de condições a seis modelos de VLM de comprimentos de contexto diversos, em quatro conjuntos de dados adequados; e descobriram que os resultados indicaram a dependência dos modelos em relação ao texto em vez do conteúdo do vídeo.

![Exemplo do estudo mostrando como um modelo de análise de vídeo pondera o que vê versus o que lê. O clipe mostra uma pessoa tecendo bambu, mas o modelo atribui muito mais importância ao texto da pergunta e da resposta do que aos próprios quadros do vídeo. Destaques azuis marcam elementos que apoiam a resposta escolhida, enquanto destaques vermelhos marcam aqueles que a puxam na direção oposta, ilustrando como o raciocínio do modelo centra-se na redação em vez das imagens em movimento. [ Fonte ] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Exemplo do estudo mostrando como um modelo de análise de vídeo pondera o que vê versus o que lê. O clipe mostra uma pessoa tecendo bambu, mas o modelo atribui muito mais importância ao texto da pergunta e da resposta do que aos próprios quadros do vídeo. Destaques azuis marcam elementos que apoiam a resposta escolhida, enquanto destaques vermelhos marcam aqueles que a puxam na direção oposta, ilustrando como o raciocínio do modelo centra-se na redação em vez das imagens em movimento. Fonte

Método

Para entender quanto cada entrada contribui para a decisão de um modelo, o novo trabalho usa um método da teoria dos jogos chamado Valores de Shapley. Originalmente projetado para dividir de forma justa um pagamento entre jogadores em uma coalizão, os Valores de Shapley atribuem crédito a cada “jogador” com base em seu impacto individual.

Efetivamente, então, os jogadores nesse cenário são os quadros do vídeo ou os componentes de texto (anotações, legendas, legendas, etc.) de uma tarefa de VQA; e o “pagamento” é a resposta final do modelo. Ao testar sistematicamente o que ocorre quando cada parte é adicionada ou removida, a técnica revela quão importante esse elemento foi para chegar à resposta escolhida.

No caso do novo projeto, para estender o método por várias tipologias de dados, os Valores de Shapley foram adaptados para lidar com modalidades mistas, com componentes de vídeo e texto tratados discretamente, e sua influência variada nos resultados do modelo medida, revelando se o conteúdo do vídeo estava sendo realmente interpretado ou se pistas escritas estavam sendo usadas como atalhos.

Métricas

Duas métricas simples foram definidas para comparar quanto cada modalidade (ou seja, vídeo, pergunta ou resposta) contribuiu para a decisão do modelo: Contribuição de Modalidade mede quanto do total de explicação veio de cada tipo de entrada; aqui, todos os valores de Shapley disponíveis são somados e a participação pertencente a cada modalidade calculada como um percentual do total.

Em segundo lugar, Contribuição por Recurso corrige o fato de que algumas modalidades, como vídeo, contenham muito mais recursos do que outras. Em vez disso, o valor de Shapley médio é calculado para cada recurso e essas médias comparadas para determinar qual modalidade tem influência dominante.

Dados e Testes

Os autores testaram a abordagem em seis VLMs com uma variedade de características projetadas para garantir que os testes fossem amplamente aplicáveis e generalizáveis. Portanto, os modelos foram escolhidos por diferentes comprimentos de contexto, diferentes idades (ou seja, quanto tempo desde que o framework foi lançado) e diferentes configurações de arquitetura.

Os concorrentes foram FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (que aproveita Qwen2); e LongVA (também usando Qwen2).

Com o mesmo objetivo de diversidade, os quatro conjuntos de dados alvo escolhidos foram EgoSchema, um conjunto de dados de VQA projetado para ser impossível de concluir sem a visualização completa dos vídeos associados; HD-EPIC, um conjunto de dados focado em cozinha com alguns vídeos excepcionalmente longos; MVBench, um conjunto de dados curado de contribuições de outros conjuntos de dados; e LVBench, que formula perguntas de VQA para vídeos muito longos.

A partir desses, os autores elaboraram 60 perguntas – dez de cada tipo de pergunta.

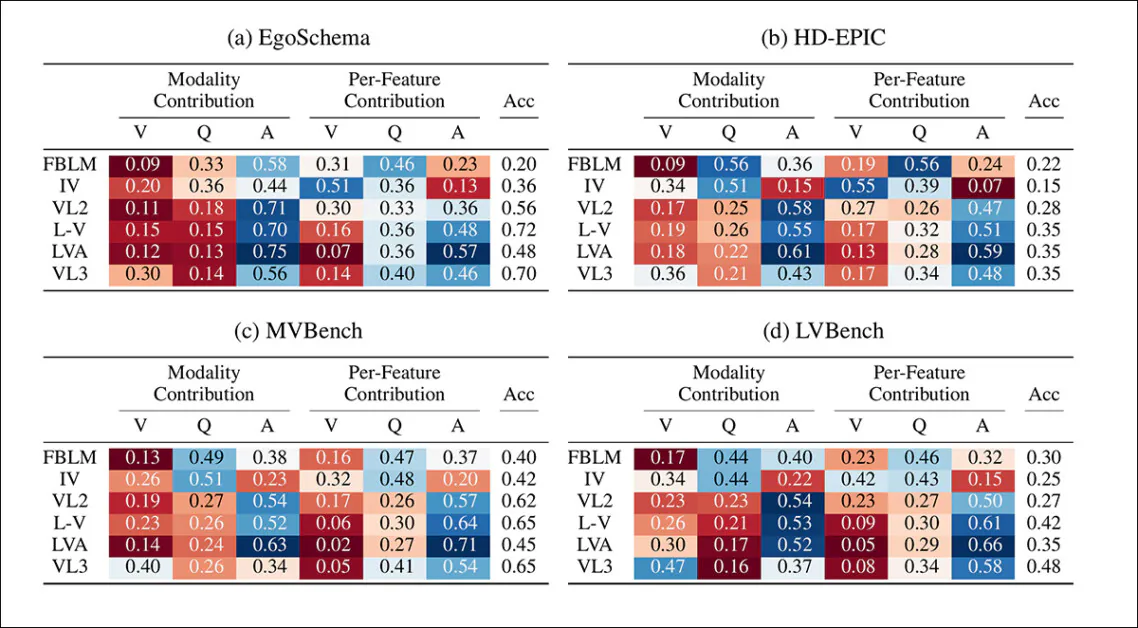

As métricas de contribuição tornaram claro que a maioria dos modelos dependia menos do vídeo do que do texto, especialmente quando julgados quadro a quadro. Mesmo onde o vídeo apresentou um desempenho razoável em termos de contribuição geral, sua influência por recurso era muitas vezes mínima, sugerindo que, embora o modelo possa estar usando o vídeo em agregado, ele estava prestando pouca atenção a quadros individuais. O VideoLLaMA3 foi o principal outlier aqui, com uma dependência visual mais pesada, especialmente nas sequências mais longas no LVBench:

Pontuações de Contribuição de Modalidade (MC) e Contribuição por Recurso (PFC) em modelos e conjuntos de dados, mostrando o peso relativo de vídeo (V), pergunta (Q) e resposta (A) de entrada. Cores mais frias indicam contribuições mais fortes; cores mais quentes indicam influência mais fraca ou negligenciável. Em todos os cenários, a linguagem é claramente dominante, com o vídeo frequentemente marginalizado – especialmente na influência por quadro.

Quanto ao texto, a pergunta tendia a ser mais importante do que a resposta, particularmente em modelos mais fortes. Isso foi mais óbvio em conjuntos de dados como o EgoSchema, onde as perguntas eram mais longas e mais naturalistas, enquanto as respostas eram curtas e às vezes esquemáticas. O MVBench reverteu um pouco isso, pois sua estrutura de resposta binária infla a importância aparente dos tokens de resposta.

Em todos os modelos e conjuntos de dados, no entanto, a visão foi consistentemente marginalizada, com a linguagem fazendo a maior parte do trabalho pesado.

O artigo afirma:

‘[Para] modelos de contexto longo, o vídeo mostra contribuições drasticamente reduzidas, o que significa que por quadro os valores de Shapley são muito menores do que seus contrapartes de recursos de texto.

‘O vídeo como uma modalidade é claramente ainda altamente relevante, mas isso é evidência de que os valores de Shapley de seus quadros individuais estão mais centrados em torno de zero, e que a atenção do modelo a eles é muito menos guiada do que para o texto.’

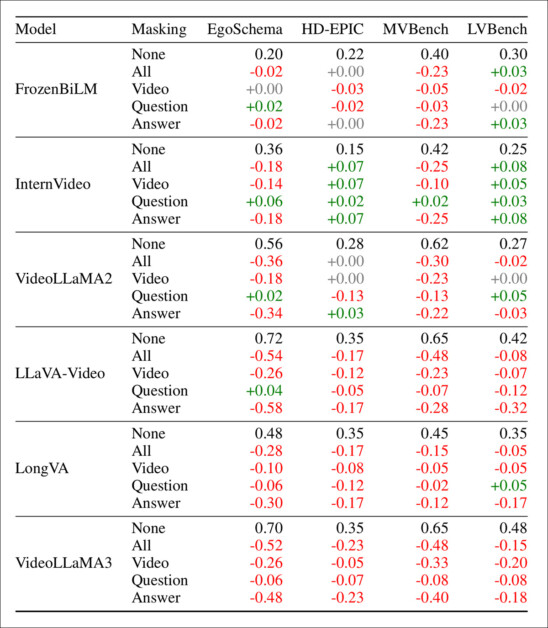

Para testar como cada parte da entrada (vídeo, texto, etc.) contribui para a precisão do modelo, os pesquisadores realizaram testes adicionais usando masking – deliberadamente escondendo uma ou mais partes da entrada e vendo quanto a precisão do modelo muda como resultado.

Se o desempenho cai acentuadamente quando uma entrada específica é removida, essa entrada provavelmente é importante; se o modelo performa mais ou menos da mesma forma, isso sugere que a peça faltante não foi muito utilizada. Nesse sentido, os testes de masking são uma espécie de estudo de ablação iterativo.

Impacto de desempenho da máscara de vídeo, pergunta ou resposta de entrada em quatro benchmarks de VQA. As pontuações mostram a alteração a partir da linha de base sem máscara. Vermelho significa menor precisão, verde significa maior precisão. Os modelos frequentemente mantinham pontuações altas sem vídeo, mas perderam mais quando a resposta (texto) foi removida. A pergunta podia ser mascarada com efeito mínimo.

Os resultados (visualizados acima) indicam que as respostas (respostas de texto nos dados de múltipla escolha) carregam o peso mais importante em toda a parte. Mascará a resposta geralmente causou a maior queda de precisão, muitas vezes reduzindo os modelos a um desempenho próximo ao aleatório.

No entanto, mascarar a pergunta geralmente teve muito menos efeito, o que apoia a descoberta anterior de que os modelos frequentemente subestimam a pergunta.

Em alguns casos, a precisão até melhorou quando a pergunta foi removida, o que implica que os modelos às vezes estavam apenas combinando respostas com pistas visuais ou textuais, em vez de avaliar adequadamente a pergunta.

Os modelos também variaram em sua dependência do vídeo: alguns mantiveram uma precisão razoável sem ele, confirmando ainda mais a contribuição limitada dos recursos de vídeo em muitos conjuntos atuais.

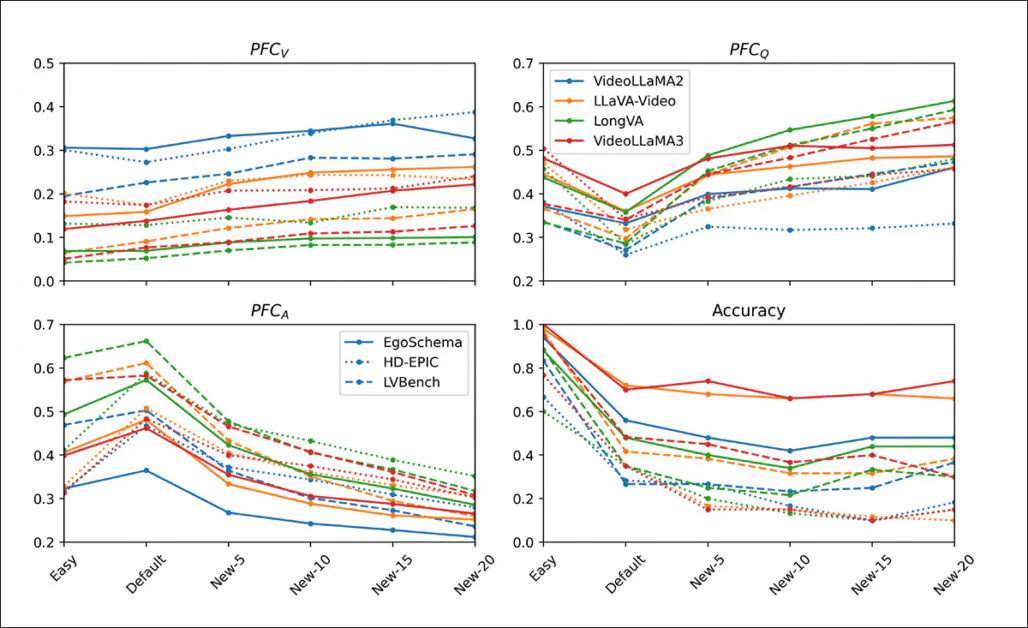

Os autores subsequentemente testaram se os modelos poderiam ser forçados a depender do vídeo adicionando respostas erradas extras às opções de múltipla escolha.

Quando os distratores eram fáceis e reciclados de outras perguntas, o desempenho melhorou, pois os modelos combinavam padrões de texto sem muito raciocínio. Mas com dez ou mais respostas não relacionadas, eles começaram a depender mais do vídeo e da pergunta:

Contribuição por recurso e precisão para vídeo, pergunta e resposta de entrada, à medida que respostas erradas adicionais são adicionadas a cada teste de VQA, mostrando que aumentar o número de distratores reduz a dominância do texto e aumenta a influência relativa dos recursos visuais e de pergunta.

Para o VideoLLaMA3, mascarar o vídeo reduziu a precisão em 40% no EgoSchema e 15% no LVBench, indicando que um simples aumento no número de respostas pode desviar os modelos de atalhos de texto e em direção a um raciocínio multimodal genuíno.

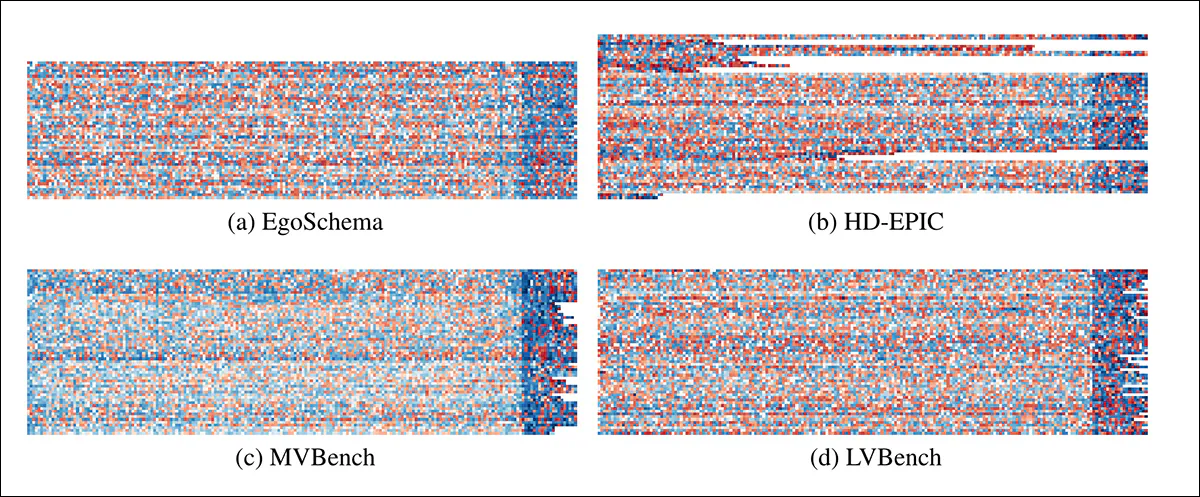

Os pesquisadores também exploraram como a atribuição é distribuída em entradas e abaixo vemos mapas de calor de valores de Shapley para cada entrada do modelo:

Mapas de calor de valores de Shapley para quatro conjuntos de dados, onde cada linha mostra um tuplo de VQA e cada coluna um recurso único. Recursos de vídeo aparecem à esquerda, seguidos de texto. Os valores muito mais fortes nas regiões de texto (vermelho) confirmam que os modelos confiam muito mais na linguagem do que no vídeo.

Comentando sobre os resultados acima, os autores afirmam:

‘Os valores de magnitude dos valores de Shapley são muito maiores em direção à direita de cada mapa de calor, representando as anotações de pergunta e resposta. Essa fronteira nítida é onde os quadros do vídeo terminam e os recursos de texto começam, demonstrando que a contribuição da modalidade de vídeo é muito menor do que a pergunta/resposta. ‘

Em resumo, em todos os conjuntos de dados, os valores são muito mais fortes no extremo do texto do espectro, indicando fortemente que os modelos confiam muito mais na linguagem do que em pistas visuais. Mesmo onde o vídeo é usado, a contribuição é espalhada finamente por muitos quadros, frequentemente sem um padrão consistente.

Abaixo, vemos um exemplo anotado do EgoSchema. Os 16 quadros mais “importantes” foram selecionados usando valores de Shapley e coloridos de acordo com sua influência, com azul indicando uma contribuição positiva e vermelho uma contribuição negativa:

Atribuições de Shapley para um exemplo único do EgoSchema, mostrando os 16 quadros mais influentes e todas as entradas de texto. As contribuições do vídeo são mínimas em comparação com o texto, que domina o raciocínio do modelo. Azul e vermelho indicam influência positiva e negativa na resposta selecionada.

Conclusão

Qualquer pessoa que já tenha se envolvido em edição de vídeo ou análise de vídeo já sabe como esses processos são intensivos em recursos e entenderá por que as empresas que analisam milhões de solicitações de IA por dia não podem se dar ao luxo de permitir processos de edição e interpretação de vídeo ad hoc a serem executados por usuários.

Uma coisa a lembrar a esse respeito é que quase todas as interfaces de API de IA que você tentará (com a possível exceção de um novo e de curta duração demonstração em apoio a novas pesquisas científicas) estão procurando realizar os desejos dos usuários no nível mínimo possível de despesa de recursos.

Isso significa confiar em metadados existentes de dados fornecidos pelo usuário ou RAG de recuperação, se possível; e extrair (se absolutamente necessário) metadados para formatos mais parseáveis, como PDF, documentos e imagens individuais.

O que não está na mesa é executar o vídeo carregado por você através do CLIP ou da última versão do YOLO, ou através de qualquer VLM que possa realmente identificar o que está nos quadros e entender o que está acontecendo no vídeo fornecido, considerando a temporalidade.

No entanto, isso não significa que os fenômenos que o artigo atual documenta necessariamente procedem de abordagens arquitetônicas parcimoniosas. Os autores observam que o texto domina os paradigmas de treinamento multimodal de ponta em qualquer caso, indicando que a “linguagem visual” é menos desenvolvida, menos importante ou informativa dentro de um contexto multimodal, ou (pelo menos no momento) menos bem compreendida,

* Interessantemente, o material que o NotebookLM veio com parece ser completamente original ou totalmente não indexado pelo Google, pois não consigo encontrar resultados de pesquisa que pudessem ter se infiltrado nos dados de treinamento e provocado essa saída.

Publicado pela primeira vez na sexta-feira, 31 de outubro de 2025; editado 14:20 para formatação