Líderes de pensamento

Do Código à Cura: A Próxima Revolução de IA Precisa de Uma Mão (E Olhos)

Como os sistemas agênticos, óculos inteligentes de realidade aumentada e robótica irão empoderar os humanos – e não substituí-los

Estamos vivendo um paradoxo na inteligência artificial.

Em telas, a IA é super-humana. Modelos de linguagem grandes escrevem código Python funcional em segundos. Sistemas gerativos produzem imagens e vídeos fotorealistas em minutos. Sistemas vencedores do Prêmio Nobel, como o AlphaFold, previram as estruturas de quase todas as proteínas conhecidas. As vitórias digitais estão se acumulando.

No entanto, no mundo físico da pesquisa biomédica, o processo de descoberta continua sendo dolorosamente manual. Não sentimos que a IA esteja acelerando a ciência ou a medicina, pelo menos não ainda. Os números revelam a profundidade do problema. Uma pesquisa marcante da Nature, com mais de 1.500 cientistas, encontrou que mais de 70% tentaram e falharam em reproduzir os experimentos de outro pesquisador. Ainda mais preocupante: mais da metade não conseguiu reproduzir seu próprio trabalho. Na biologia do câncer, especificamente, um projeto de reprodutibilidade de oito anos encontrou que apenas 40% das descobertas de alto impacto puderam ser replicadas e 68% dos experimentos careciam de documentação suficiente para sequer tentar a replicação.

Este é o segredo sujo da ciência moderna: temos um problema de captura de conhecimento, não apenas um problema de descoberta. Detalhes experimentais críticos vivem na cabeça dos pesquisadores, não em artigos. Protocolos mudam. Conhecimento tácito sai pela porta quando os trainees se formam. Sistemas de IA treinados com literatura publicada herdam todas essas lacunas.

A questão fundamental é que, embora uma IA possa projetar uma proteína nova para terapia contra o câncer em uma simulação digital, ela não pode pegar uma pipeta para testá-la. Ela não pode navegar pela realidade desordenada e imprevisível de um laboratório úmido para validar sua própria hipótese. Ela não pode observar as mãos de um cientista experiente e aprender as técnicas sutis que fazem os experimentos funcionarem.

Esta “lacuna de execução” é o maior gargalo que impede a revolução de IA de se tornar uma revolução médica. Enquanto a maioria das empresas de robótica ainda está ocupada ensinando máquinas a dobrar roupas ou carregar louças, elas estão atrasadas em relação às capacidades verdadeiramente transformadoras desses avanços em campos como a medicina.

Para resolver isso, devemos ir além dos chatbots e em direção a IA Co-Cientistas, sistemas agênticos que conectam o mundo digital e o físico, avançando além do planejamento e codificação e entrando na execução do mundo real. Em Stanford, estamos desenvolvendo LabOS, um quadro de trabalho digital-físico de IA que demonstra como agentes de IA, óculos inteligentes de realidade aumentada (XR) e robótica colaborativa podem unir-se para fechar esse loop, transformando experimentos científicos em uma conversa colaborativa entre humanos e máquinas, enquanto capturam automaticamente o conhecimento que atualmente se perde.

A Grande Divisão: Por Que a IA Precisa de “Olhos” e “Mãos”

Muitas das vitórias mais visíveis de IA aconteceram onde o ambiente é completamente digital: repositórios de código, conjuntos de dados curados ou benchmarks simulados (onde a IA compete para executar um negócio virtual ou investir digitalmente em ações).

Laboratórios úmidos são diferentes. A biologia, e em geral, a descoberta científica, é um processo muito barulhento. Instrumentos mudam, operadores improvisam e “o protocolo” frequentemente vive em parte na cabeça das pessoas. A diferença entre um resultado limpo e uma execução falha pode ser um ângulo de pipetagem, um padrão de vortex, uma substituição de reagente ou uma incubação que correu por 10 minutos a mais. Esses detalhes contextuais raramente entram em um artigo e são exatamente o que um modelo de IA precisa se for generalizar além de um conjunto de dados.

É por isso que a IA de laboratório de ponta precisa de olhos (para perceber o que está acontecendo no contexto), mãos (para padronizar e automatizar etapas de alta variância) e memória (para registrar o que realmente aconteceu). Sem essas capacidades, os modelos podem recomendar o que fazer, mas não podem traduzir confiavelmente as recomendações em execução física validada ou explicar falhas quando a realidade diverge do plano.

Além dos Chatbots: De Copilotos a Co-Cientistas

O termo “IA agêntica” às vezes é usado de forma frouxa. Em ambientes biomédicos, ele deve significar algo preciso: um sistema que pode tomar um objetivo (por exemplo, “otimizar a eficiência de edição de genes CRISPR enquanto minimiza alvos fora do lugar”), decompor em uma sequência de tarefas, executar essas tarefas em ferramentas, avaliar resultados e adaptar o plano sob restrições e com tomada de decisão auditável.

Isso importa porque fluxos de trabalho de pesquisa não são uma única chamada de modelo. São pipelines de ponta a ponta que abrangem formulação de hipótese, design experimental, processamento de dados, testes estatísticos e interpretação. O pensamento recente na descoberta de drogas começou a enfatizar sistemas agênticos que podem dimensionar esses pipelines, e não apenas acelerar etapas individuais (por exemplo, a discussão da Unite.AI sobre agentes na descoberta de moléculas pequenas).

Na engenharia de software, já vimos evidências empíricas iniciais de que copilotos de IA podem aumentar a produtividade dos desenvolvedores. Na biomedicina, a oportunidade análoga não é apenas escrever código, é escrever e validar protocolos, estruturar dados, monitorar a execução e fechar o loop entre previsão e medição, conectando a IA a cientistas humanos em laboratórios.

LabOS: Quando a IA Executa em um Sistema Operacional para os Laboratórios do Amanhã

Em nosso trabalho em Stanford sobre AI4Science, abrangendo copilotos de edição de genes como CRISPR-GPT e sistemas de co-execução de IA-XR como LabOS que ajudam cientistas em laboratórios biomédicos e de ciência de materiais, estamos explorando uma mudança arquitetônica:

1. Projetando um “sistema operacional de laboratório” que acopla um laboratório digital (seco) a um laboratório físico (úmido).

A premissa é simples: se um caderno de laboratório é a memória da ciência, então um sistema operacional de laboratório deve ser a camada de execução, capturando a intenção, traduzindo-a em ações, observando os resultados e transformando cada execução em conhecimento estruturado.

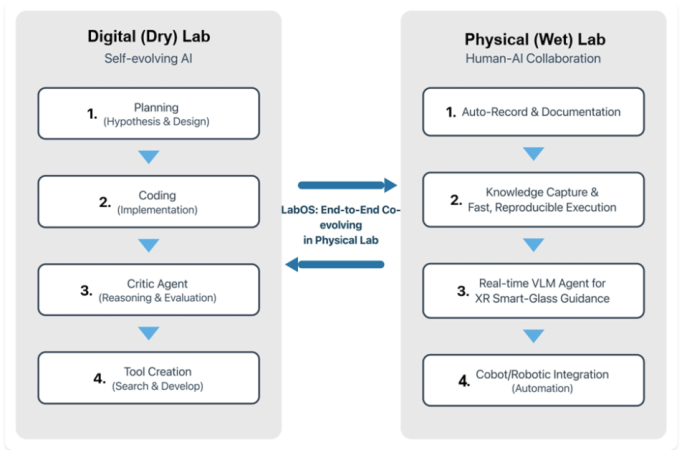

Figura. Uma visão conceitual do LabOS ligando um loop de laboratório digital autoevolutivo (planejamento, codificação, crítica, criação de ferramentas) com um loop de laboratório úmido humano-IA (autodocumentação, captura de conhecimento, orientação de XR e integração robótica).

2. IA no Laboratório Digital – Planejamento e Construção de Ferramentas Autoevolutivas

No laboratório digital (seco), podemos deixar a IA fazer o que ela já faz bem: buscar, sintetizar e propor. Mas também queremos que ela seja autoaprimorável. Não por “alucinar nova ciência”, mas aprendendo melhores ferramentas e fluxos de trabalho a partir de feedback.

Um loop de laboratório digital prático pode ser estruturado em quatro estágios recorrentes:

- Planejamento (hipótese + design): propor hipóteses, selecionar variáveis experimentais, antecipar confundidores e especificar pontos de medição.

- Codificação (implementação): gerar ou adaptar scripts de análise, pipelines de simulação e templates de controle de instrumentos onde apropriado.

- Agente crítico (raciocínio + avaliação): testar as suposições, verificar o poder estatístico, propor controles e sinalizar prováveis modos de falha.

- Criação de ferramentas (busca + desenvolvimento): quando o fluxo de trabalho carece de um componente (um analisador, uma rotina de QC, um painel), construí-lo e adicioná-lo de volta ao kit de ferramentas.

3. IA no Laboratório Físico – IA com “Olhos” (Óculos de Realidade Aumentada) e “Mãos” (Robótica)

O laboratório físico (úmido) é onde o sistema ou ganha confiança – ou perde. O objetivo não é substituir o cientista, mas reduzir a fricção e o erro, aumentando a observabilidade.

Vemos o loop do laboratório físico como quatro capacidades complementares:

- Registro e documentação automática: capturar ações, horários, configurações de instrumentos e desvios automaticamente, para que a documentação não seja um afterthought.

- Captura de conhecimento para execução rápida e reprodutível: converter execuções em artefatos estruturados e consultáveis (versões de protocolo, conjuntos de parâmetros, resultados de QC) alinhados com princípios de gestão de dados como FAIR.

- Orientação de visão-linguagem em tempo real via óculos de realidade aumentada: usar modelos multimodais para interpretar a cena (o que o operador está fazendo, qual reagente está em mãos) e fornecer orientação passo a passo e verificações de segurança. AR/XR já demonstrou valor em fluxos de trabalho físicos de alto estresse, como orientação experimental (LabOS, Stanford, Princeton, em colaboração com NVIDIA).

- Integração de robótica para automação: padronizar etapas repetitivas, permitir transferências seguras e reduzir a variância. Plataformas para fluxos de trabalho de simulação para real (por exemplo, NVIDIA Isaac) e processamento de IA em tempo real na borda, como o streaming ao vivo e interação humano-IA no LabOS, são camadas de habilitação importantes.

Essa arquitetura alinha-se com uma direção mais ampla no campo: “laboratórios autodirigidos” ou autônomos que combinam automação com aprendizado de máquina para planejar o próximo experimento. O que o LabOS adiciona é uma camada de interface humano mais apertada, para que a autonomia não venha ao custo da transparência.

Por Que a IA de Laboratório de Ponta Não É Apenas “IA em um Conjunto de Dados”

Sistemas de IA para superinteligência biomédica/científica frequentemente parecem impressionantes em avaliação retrospectiva ou ao fazer exames, e então têm um desempenho abaixo do esperado no laboratório físico. O motivo raramente é um único bug. É geralmente uma discordância entre as suposições do modelo e a realidade do laboratório.

Três lacunas aparecem repetidamente:

- Lacuna de contexto: conjuntos de dados normalmente omitir as variáveis contextuais que os operadores sabem que importam (excursões de temperatura, números de lote de reagentes, desvios sutis de protocolo).

- Lacuna de ação: muitos sistemas de IA podem recomendar o que fazer, mas não podem traduzir confiavelmente a recomendação em etapas físicas validadas.

- Lacuna de feedback: sem feedback estruturado e de alta qualidade da execução, os modelos não podem aprender onde falham – e os cientistas não podem auditar por quê.

Fechar essas lacunas é menos sobre inventar uma nova arquitetura de rede neural, mas mais sobre construir a instrumentação, interfaces e contratos de dados que tornam o laboratório legível para máquinas e permitem que a IA veja e trabalhe com humanos.

Confiabilidade por Design: Segurança e Governança para IA que Pode Agir

IA agêntica em pesquisa de descoberta não apenas levanta preocupações familiares sobre precisão. Ela introduz novos modos de falha porque pode agir. Em um laboratório, ação significa o potencial para desperdício, dano ou conclusões enganosas, especialmente quando os experimentos alimentam hipóteses clínicas.

Uma mentalidade útil é tratar uma pilha de laboratório habilitada por IA como um sistema sociotécnico que precisa de garantia. Vários quadros existentes ajudam, mas devem ser traduzidos para a realidade do laboratório:

- Gestão de risco como uma prática contínua: o Quadro de Gestão de Risco de IA do NIST (AI RMF 1.0) fornece um vocabulário prático para mapear, medir e gerenciar o risco de IA ao longo do ciclo de vida.

- Alinhamento regulatório para IA médica adjacente: o plano de ação da FDA sobre Software de IA/ML como Dispositivo Médico (SaMD), incluindo seu Plano de Ação e diretrizes relacionadas, oferece uma visão concreta do que “boa prática” parece quando a IA impacta os cuidados com os pacientes.

Para domínios de alto impacto, como edição de genes, a governança já é uma conversa global. Recomendações estão sendo discutidas sobre edição de genoma humano, para enfatizar a necessidade de mecanismos de supervisão apropriados e governança responsável, como as propostas pela American Society for Gene and Cell Therapy, ou ASGCT. Sistemas como o LabOS devem ser projetados para tornar o cumprimento mais fácil, não mais difícil.

Checklist: Controles para Co-Cientistas de IA Seguros para Descoberta Científica

Em nossa visão, um sistema operacional de laboratório consciente da segurança deve implementar pelo menos os seguintes designs:

- Proveniência por padrão: todos os conjuntos de dados, versões de protocolo e saídas de modelo devem ser rastreáveis para entradas e horários.

- Autonomia limitada: o sistema deve ter permissões explícitas (o que pode fazer sem confirmação) e regras de escalonamento (quando deve perguntar).

- Sobrecarga humana e degradação suave: quando sensores ou fluxos de dados falham, ou a incerteza é alta, o sistema deve voltar a um modo mais seguro e simples.

- Validação contínua: previsões in-silico devem ser combinadas com validação de laboratório físico; execuções de laboratório físico devem incluir portas de controle de qualidade antes que conclusões se propaguem downstream de volta aos modelos/agentes no mundo digital.

- Segurança e conscientização de uso dual: proteger a infraestrutura de laboratório contra manipulação.

Empoderar Humanos em Todos os Lugares: Podem Co-Cientistas de IA Nivelar o Campo de Jogos?

Uma das promessas mais convincentes de um “co-cientista” de IA-XR não é apenas velocidade para instituições de elite, é acessibilidade para todos. Considere o que atualmente limita laboratórios menores, startups e clínicas remotas/rurais/regionais:

- Acesso limitado a especialistas para protocolos e instrumentos de padrão ouro.

- Custo relativo mais alto de treinamento, erros e retrabalho.

- Ferramentas fragmentadas: cadernos, planilhas, registros de instrumentos e scripts de análise raramente se conectam limpa e claramente.

Um sistema que pode guiar a execução no contexto (através de óculos de realidade aumentada), capturar o que aconteceu automaticamente e sugerir a próxima melhor etapa com base em execuções anteriores pode tornar ensaios avançados mais reprodutíveis em diferentes locais. Em princípio, também pode apoiar pesquisa clínica distribuída, onde protocolos devem ser executados consistentemente, mesmo quando os recursos variam.

Cronograma: Quando Todo Cientista e Clínico Obterá um Co-Cientista?

Em resumo, estamos mais perto do que muitos pensam para algumas tarefas de alto valor e alta frequência (como produzir um medicamento de forma confiável no laboratório) e mais longe do que muitas demonstrações implicam para outras (como a IA resolver completamente grandes problemas como câncer ou Alzheimer). Um cronograma realista parece assim:

- Curto prazo (dentro de 1 ano): Copilotos de fluxo de trabalho que reduzem a carga administrativa: elaboração de protocolos, síntese de literatura, modelos de análise e relatórios de QC automatizados. O fator limitante é a integração, não a capacidade do modelo.

- Médio prazo (1-2 anos): Sistemas de co-execução no laboratório: orientação de óculos de realidade aumentada, documentação automática e robótica seletiva para etapas de alta variância. A confiança dependerá de registros de auditoria e design de loop humano apertado.

- Longo prazo (3+ anos): Co-pesquisadores de domínio cruzado que conectam a descoberta à tradução: ligando dados de laboratório a pontos de extremidade clínicos, monitorando sinais de segurança, ajudando a projetar ensaios – enquanto cumpre expectativas regulatórias e éticas.

Do Código à Cura: O Caminho à Frente para a Descoberta Científica 1000x

O LabOS é uma tentativa de responder a uma pergunta simples: e se um experimento pudesse ser executado como uma conversa, onde a intenção, a execução e a evidência estivessem conectadas de ponta a ponta? Se construirmos esses sistemas bem, eles podem ajudar a resolver a lacuna de tradução que desacelera a biomedicina e muitas disciplinas científicas físicas (por exemplo, ciência de materiais). Se os construirmos mal, eles amplificarão a irreprodutibilidade e criarão novos riscos de segurança.

O trabalho mais importante nos próximos anos será fundamental: interfaces de dados e dispositivos padronizados via construção do sistema operacional (muito como o iOS executa todos os tipos de aplicativos), construindo benchmarks de IA que incluem execução e incerteza (como o benchmark LabSuperVision no LabOS), e começando a implantação no mundo real que incentivam a inovação enquanto protegem pacientes e integridade de pesquisa.

Para pesquisadores e clínicos, a pergunta não é se a IA entrará no laboratório. Ela já entrou. A pergunta é se a integraremos como uma coleção de ferramentas desconectadas ou como um sistema confiável, projetado para as realidades da ciência biomédica.

Leitura sugerida e fontes

- Pesquisa de reprodutibilidade (Nature, 2016): https://www.nature.com/articles/533452a

- Artigo revisado por pares do CRISPR-GPT (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Notícias da Stanford Medicine sobre CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- Pré-impressão do LabOS (arXiv): https://arxiv.org/abs/2510.14861

- Site do benchmark LabOS e LabSuperVision: https://ai4lab.stanford.edu

- Quadro de Gestão de Risco de IA do NIST (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- Visão geral da FDA sobre Software de IA/ML como Dispositivo Médico: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- Princípios de dados FAIR (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI sobre gargalos na descoberta de drogas de moléculas pequenas: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI sobre IA e cirurgia robótica: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/