Inteligência artificial

A Língua Gerada por IA Está Começando a Poluir a Literatura Científica

Pesquisadores da França e Rússia publicaram um estudo indicando que o uso de geradores de texto probabilísticos baseados em IA, como o GPT-3, está introduzindo ‘linguagem torturada’, citações de literatura inexistente e reutilização de imagens sem créditos em canais anteriormente respeitáveis para a publicação de nova literatura científica.

Talvez o mais preocupante seja que os artigos estudados também contêm conteúdo cientificamente impreciso ou não reprodutível apresentado como frutos de pesquisa objetiva e sistemática, indicando que os modelos de linguagem gerativos estão sendo usados não apenas para melhorar as limitadas habilidades de inglês dos autores dos artigos, mas também para realizar o trabalho difícil envolvido (e, inevitavelmente, para fazê-lo mal).

O relatório, intitulado Frases Torturadas: Um Estilo de Escrita Duvidoso que Está Aparecendo na Ciência, foi compilado por pesquisadores do Departamento de Ciência da Computação da Universidade de Toulouse e pelo pesquisador da Yandex, Alexander Magazinov, atualmente na Universidade de Tel Aviv.

O estudo se concentra particularmente no crescimento de publicações científicas sem sentido geradas por IA na revista Elsevier Microprocessadores e Microsistemas.

Por Outro Nome

Modelos de linguagem autoregressivos, como o GPT-3, são treinados em grandes volumes de dados e são projetados para parafrasear, resumir, compilar e interpretar esses dados de contribuição em modelos de linguagem gerativos coesos que são capazes de reproduzir padrões de fala e escrita naturais, mantendo a intenção original dos dados de treinamento.

Como esses frameworks são frequentemente punidos no estágio de treinamento do modelo por oferecer regurgitação direta e “não absorvida” dos dados originais, eles inevitavelmente buscam sinônimos – mesmo para frases bem estabelecidas.

As submissões científicas aparentemente criadas ou auxiliadas por IA descobertas pelos pesquisadores incluem um número extraordinário de tentativas fracassadas de sinônimos criativos para frases conhecidas no setor de aprendizado de máquina:

rede neural profunda: organização neural profunda

rede neural artificial: organização neural (falsa | contrafeita)

rede móvel: organização versátil

ataque de rede: organização (emboscada | ataque)

conexão de rede: associação de organização

big data: informação (enorme | enorme | imensa | colossal)

armazenamento de dados: informação (armazém | centro de distribuição)

inteligência artificial (IA): consciência (falsa | feita pelo homem)

computação de alto desempenho: cálculo de elite

computação em nuvem/nevoeiro: cálculo de nevoeiro

unidade de processamento gráfico (GPU): unidade de preparo de desenhos

unidade central de processamento (CPU): unidade de preparo focal

motor de fluxo de trabalho: motor de processo de trabalho

reconhecimento facial: reconhecimento facial

reconhecimento de voz: reconhecimento de discurso

erro médio quadrático: erro médio quadrático (erro | falha)

erro médio absoluto: erro médio (absoluto | supremo) (erro | falha)

sinal para ruído: sinal para (ruído | alvoroço | comotação | sinal | indicação)

parâmetros globais: parâmetros mundiais

acesso aleatório: acesso (arbitrário | irregular) à

floresta aleatória: (arbitrário | irregular) (floresta | território | área)

valor aleatório: valor (arbitrário | irregular)

colônia de formigas: colônia de insetos subterrâneos (estado | província | área | região | assentamento)

colônia de formigas: colônia de insetos subterrâneos (estado | província | área | região | assentamento)

energia restante: energia restante

energia cinética: energia motora

Bayes ingênuo: Bayes (ingênuo | inocente | crédulo)

assistente digital pessoal (PDA): assistente computacional individual

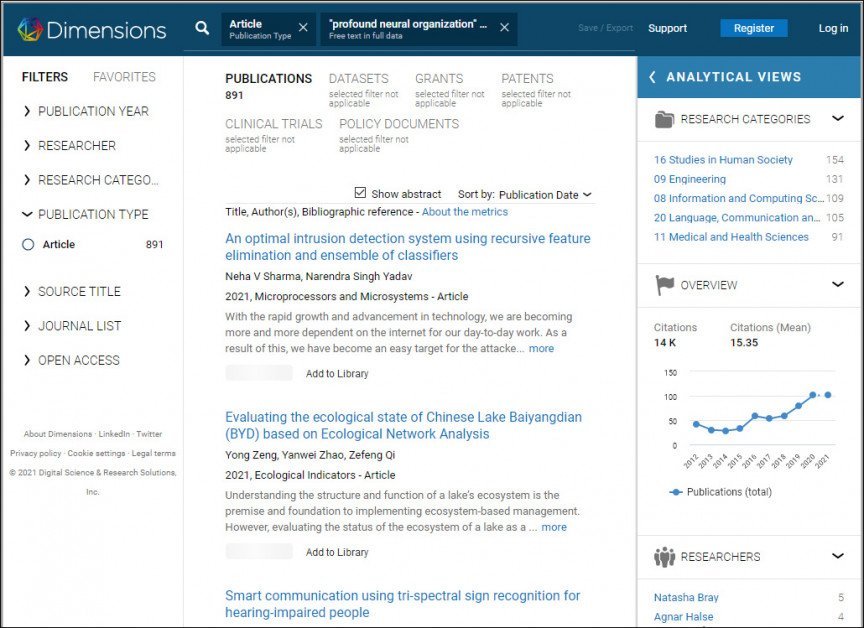

Em maio de 2021, os pesquisadores consultaram o mecanismo de busca acadêmico Dimensions em busca desse tipo de linguagem automatizada e distorcida, tomando cuidado para excluir frases legítimas, como ‘informação enorme’ (que é uma frase válida e não um sinônimo fracassado para ‘big data’). Nesse ponto, eles observaram que Microprocessadores e Microsistemas tinha o maior número de ocorrências de parafraseamento mal manuseado.

Atualmente, ainda é possível recuperar (snapshot de arquivo, 15/07/2021) vários artigos científicos para a frase sem sentido ‘organização neural profunda’ (ou seja, ‘rede neural profunda’), e outros na lista acima produzem resultados semelhantes.

Resultados de busca para ‘organização neural profunda’ (‘rede neural profunda’) no Dimensions. Fonte: https://app.dimensions.ai/

A revista Microprocessadores foi fundada em 1976 e renomeada para Microprocessadores e Microsistemas dois anos depois.

Crescimento de Linguagem sem Sentido

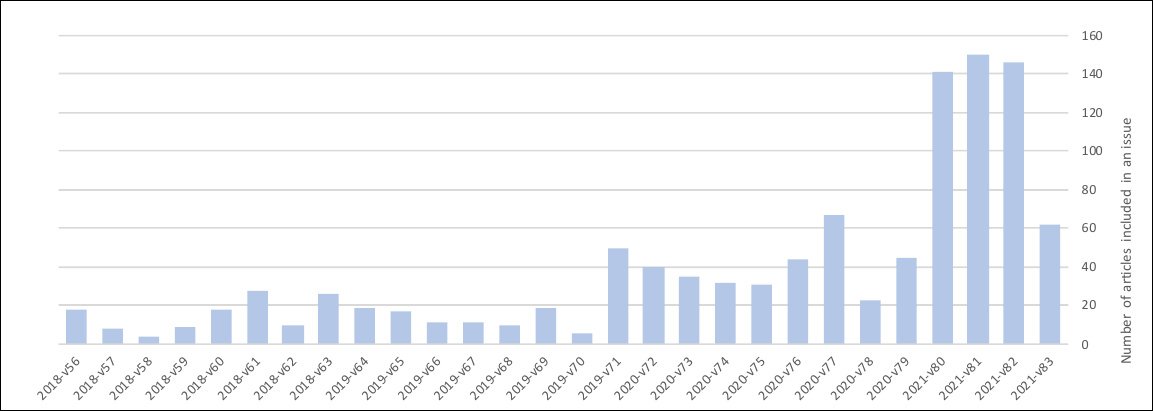

Os pesquisadores estudaram um período que abrange de fevereiro de 2018 a junho de 2021 e observaram um aumento acentuado no volume de submissões nos últimos dois anos, e particularmente nos últimos 6-8 meses:

Correlação ou causalidade? O aumento nas submissões para a revista Microprocessadores e Microsistemas parece coincidir com o crescimento de ‘nonsense’ texto e sinônimos em submissões aparentemente respeitáveis. Fonte: https://arxiv.org/pdf/2107.06751.pdf

O conjunto de dados final coletado pelos colaboradores contém 1.078 artigos completos obtidos via assinatura da Elsevier da Universidade de Toulouse.

Falta de Supervisão Editorial para Artigos Científicos Chineses

O artigo observa que o período de tempo alocado para a avaliação editorial das submissões sinalizadas se torna radicalmente encurtado em 2021, caindo para menos de 40 dias; uma diminuição seis vezes maior no tempo padrão para revisão por pares, evidente a partir de fevereiro de 2021.

O maior número de artigos sinalizados provém de autores com afiliações à China continental: de 404 artigos aceitos em menos de 30 dias, 97,5% são relacionados à China. Por outro lado, nos casos em que o processo editorial excedeu 40 dias (615 artigos), as submissões afiliadas à China representaram apenas 9,5% dessa categoria – um desequilíbrio de dez vezes.

O relatório atribui a infiltração dos artigos sinalizados a falhas no processo editorial e a uma possível falta de recursos diante do aumento do número de submissões.

Os pesquisadores hipotetizam que os modelos de linguagem gerativos do tipo GPT, e outros tipos de frameworks de geração de linguagem, foram usados para produzir grande parte do texto nos artigos sinalizados; no entanto, a forma como um modelo gerativo abstrai suas fontes torna isso difícil de provar, e a principal evidência reside em uma avaliação de senso comum de sinônimos pobres e desnecessários, e um exame meticuloso da coerência lógica da submissão.

Os pesquisadores observam ainda que os modelos de linguagem gerativos que acreditam estar contribuindo para essa inundação de nonsense são capazes não apenas de criar os textos problemáticos, mas também de reconhecê-los e sinalizá-los sistematicamente, da mesma forma que os próprios pesquisadores fizeram manualmente. O trabalho detalha tal implementação, usando o GPT-2, e oferece um framework para futuros sistemas identificarem submissões científicas problemáticas.

A incidência de submissões ‘poluídas’ é muito maior na revista Elsevier (72,1%) em comparação com outras revistas estudadas (13,6% no máximo).

Não Apenas Semântica

Os pesquisadores enfatizam que muitos dos artigos em questão não estão apenas usando a linguagem errada, mas contêm afirmações cientificamente imprecisas, indicando a possibilidade de que os modelos de linguagem gerativos não estão sendo usados apenas para melhorar as habilidades linguísticas limitadas dos cientistas que contribuem, mas podem estar sendo usados para formular pelo menos alguns dos teoremas e dados centrais no artigo.

Em outros casos, os pesquisadores sugerem uma ‘ressíntese’ ou ‘reelaboração’ eficaz de trabalho anterior abstrato (e superior), a fim de atender às pressões da cultura de pesquisa acadêmica ‘publicar ou perecer’, e possivelmente para melhorar as classificações nacionais para a preeminência global em pesquisa de IA, através do volume puro.

Conteúdo sem sentido em um artigo submetido. Nesse caso, os pesquisadores descobriram que o texto foi derivado, ad hoc, de um artigo da EDN, de onde a ilustração acompanhante também foi extraída sem atribuição. A reescrita do conteúdo original é tão extrema que o torna sem sentido.

Ao analisar vários dos artigos submetidos à Elsevier, os pesquisadores encontraram frases para as quais não conseguiram inferir nenhum significado; referências a literatura inexistente; referências a variáveis e teoremas em fórmulas que não apareciam realmente no material de apoio (sugerindo abstração baseada em linguagem, ou ‘alucinação’ de dados aparentemente factuais); e reutilização de imagens sem reconhecimento de suas fontes (o que os pesquisadores criticam não do ponto de vista de direitos autorais, mas como um indicador de rigor científico inadequado).

Falhas de Citação

As citações destinadas a apoiar os argumentos em um artigo científico foram encontradas em muitos dos exemplos sinalizados como ‘quebradas ou levando a publicações não relacionadas’.

Além disso, referências a ‘trabalho relacionado’ aparentemente incluem autores que os pesquisadores acreditam terem sido ‘alucinados’ por um sistema do tipo GPT.

Atenção Vagabunda

Outra limitação mesmo dos modelos de linguagem de ponta, como o GPT-3, é a tendência a perder o foco ao longo de um discurso longo. Os pesquisadores encontraram que os artigos sinalizados frequentemente abordam um tópico no início do artigo que nunca é retomado após ser mencionado em notas preliminares ou em outro lugar.

Eles também teorizam que alguns dos piores exemplos ocorrem por meio de múltiplas jornadas de texto-fonte por meio de uma série de motores de tradução, cada um distorcendo o significado ainda mais.

Fontes e Motivos

Ao tentar discernir o que está por trás desse fenômeno, os autores do artigo sugerem uma série de possibilidades: que o conteúdo de ‘fábricas de artigos’ está sendo usado como material de origem, introduzindo imprecisões muito cedo em um processo que inevitavelmente produzirá mais imprecisões; que ferramentas de giro de artigos, como o Spinbot, estão sendo usadas para mascarar plágio; e que a pressão esmagadora para publicar regularmente está levando pesquisadores subfinanciados a usar sistemas do tipo GPT-3 para aumentar ou gerar entirely novos artigos acadêmicos.

Os pesquisadores concluem com um apelo à ação para uma maior supervisão e melhorias nos padrões em uma área de publicação acadêmica que está se provando, aparentemente, se tornar alimento para seu próprio assunto – sistemas de aprendizado de máquina. Eles também advertem a Elsevier e outros editores para introduzir procedimentos de triagem e revisão mais rigorosos, e criticam amplamente os padrões e práticas atuais a esse respeito, sugerindo que ‘Engano com textos sintéticos ameaça a integridade da literatura científica.’