Zdrowie

Rewolucjonizuje opiekę zdrowotną: badanie wpływu i przyszłości modeli wielkojęzykowych w medycynie

Integracja i zastosowanie dużych modeli językowych (LLM) w medycynie i opiece zdrowotnej jest tematem cieszącym się dużym zainteresowaniem i rozwojem.

Jak wspomniano w Globalna konferencja dotycząca zarządzania informacjami w opiece zdrowotnej i społeczeństwa systemowego i innych znaczących wydarzeniach firmy takie jak Google przodują w badaniu potencjału generatywnej sztucznej inteligencji w opiece zdrowotnej. Ich inicjatywy, takie jak Med-PaLM 2, podkreślają ewoluujący krajobraz rozwiązań w zakresie opieki zdrowotnej opartych na sztucznej inteligencji, szczególnie w obszarach takich jak diagnostyka, opieka nad pacjentem i efektywność administracyjna.

Med-PaLM 2 firmy Google, pionierskie rozwiązanie LLM w dziedzinie opieki zdrowotnej, wykazało imponujące możliwości, w szczególności osiągając poziom „ekspercki” w zakresie pytań przypominających egzamin na licencję medyczną w USA. Ten model i inne mu podobne obiecują zrewolucjonizować sposób, w jaki pracownicy służby zdrowia uzyskują dostęp do informacji i wykorzystują je, potencjalnie zwiększając dokładność diagnozy i efektywność opieki nad pacjentem.

Jednak wraz z tymi postępami pojawiły się obawy dotyczące praktyczności i bezpieczeństwa tych technologii w warunkach klinicznych. Na przykład poleganie na rozległych internetowych źródłach danych w celu szkolenia modeli, choć w niektórych kontekstach korzystne, nie zawsze może być odpowiednie i niezawodne do celów medycznych. Jak Nigam Shah, doktor, MBBS, główny analityk danych ds Opieka zdrowotna w Stanford”, podkreśla, kluczowe pytania, które należy zadać, dotyczą działania tych modeli w rzeczywistych warunkach medycznych i ich rzeczywistego wpływu na opiekę nad pacjentem i efektywność opieki zdrowotnej.

Perspektywa dr Shaha podkreśla potrzebę bardziej dostosowanego podejścia do wykorzystania LLM w medycynie. Zamiast modeli ogólnego przeznaczenia szkolonych w oparciu o szerokie dane internetowe, sugeruje bardziej skoncentrowaną strategię, w ramach której modele są szkolone w oparciu o konkretne, istotne dane medyczne. Takie podejście przypomina szkolenie stażysty medycznego – przydzielanie mu konkretnych zadań, nadzorowanie jego wykonania i stopniowe pozwalanie na większą autonomię w miarę wykazania się kompetencjami.

W związku z tym rozwój Meditron autorstwa badaczy z EPFL prezentuje interesujący postęp w tej dziedzinie. Meditron, oprogramowanie LLM o otwartym kodzie źródłowym, specjalnie dostosowane do zastosowań medycznych, stanowi znaczący krok naprzód. Wyszkolony w oparciu o wyselekcjonowane dane medyczne z renomowanych źródeł, takich jak PubMed i wytyczne kliniczne, Meditron oferuje bardziej ukierunkowane i potencjalnie bardziej niezawodne narzędzie dla lekarzy. Jego charakter typu open source nie tylko promuje przejrzystość i współpracę, ale także umożliwia ciągłe doskonalenie i testowanie warunków skrajnych przez szerszą społeczność naukową.

Rozwój narzędzi takich jak Meditron, Med-PaLM 2 i innych odzwierciedla rosnące uznanie unikalnych wymagań sektora opieki zdrowotnej w zakresie aplikacji AI. Bardzo istotny jest nacisk na szkolenie tych modeli w oparciu o istotne dane medyczne wysokiej jakości oraz zapewnienie ich bezpieczeństwa i niezawodności w warunkach klinicznych.

Co więcej, włączenie różnorodnych zbiorów danych, np. pochodzących z kontekstów humanitarnych, takich jak Międzynarodowy Komitet Czerwonego Krzyża, pokazuje wrażliwość na różnorodne potrzeby i wyzwania stojące przed globalną opieką zdrowotną. Takie podejście wpisuje się w szerszą misję wielu ośrodków badawczych AI, których celem jest tworzenie narzędzi AI, które będą nie tylko zaawansowane technologicznie, ale także społecznie odpowiedzialne i korzystne.

Artykuł zatytułowany „Duże modele językowe kodują wiedzę kliniczną”, niedawno opublikowany w Nature, bada, w jaki sposób można skutecznie wykorzystać duże modele językowe (LLM) w warunkach klinicznych. Badanie przedstawia przełomowe spostrzeżenia i metodologie, rzucające światło na możliwości i ograniczenia LLM w dziedzinie medycyny.

Dziedzina medyczna charakteryzuje się złożonością, z szeroką gamą objawów, chorób i metod leczenia, które stale ewoluują. LLM muszą nie tylko rozumieć tę złożoność, ale także nadążać za najnowszą wiedzą medyczną i wytycznymi.

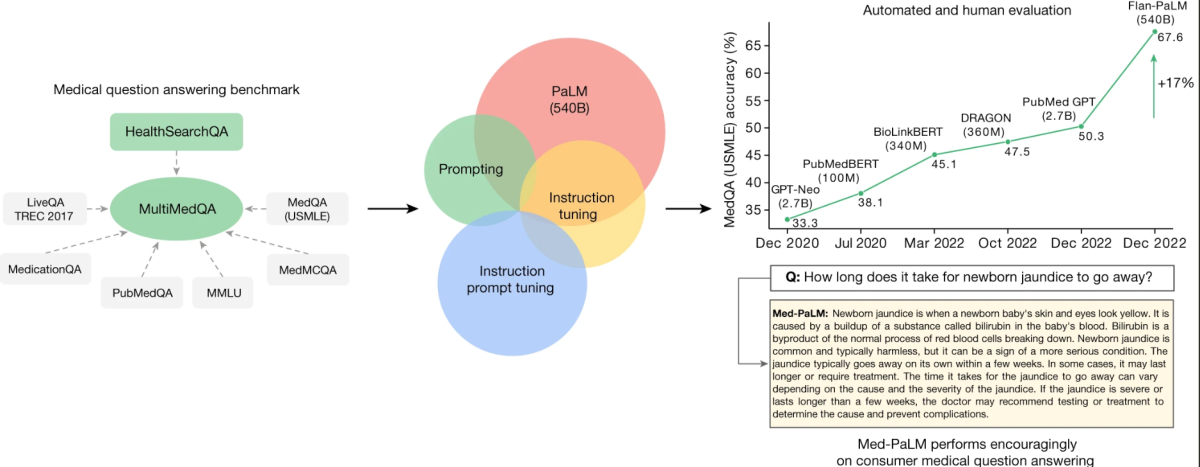

Trzon tych badań koncentruje się wokół nowo opracowanego testu porównawczego o nazwie MultiMedQA. Ten test porównawczy łączy sześć istniejących zbiorów danych zawierających odpowiedzi na pytania medyczne z nowym zbiorem danych HealthSearchQA, który obejmuje pytania medyczne często wyszukiwane w Internecie. To kompleksowe podejście ma na celu ocenę LLM w różnych wymiarach, w tym faktów, zrozumienia, rozumowania, możliwych szkód i stronniczości, eliminując w ten sposób ograniczenia poprzednich automatycznych ocen, które opierały się na ograniczonych wzorcach.

MultiMedQA, punkt odniesienia w udzielaniu odpowiedzi na pytania medyczne obejmujące badania lekarskie

Kluczem do badania jest ocena modelu języka Pathways (PaLM), LLM o wartości 540 miliardów parametrów, oraz jego wariantu dostrojonego do instrukcji, Flan-PaLM, w MultiMedQA. Co godne uwagi, Flan-PaLM osiąga najnowocześniejszą dokładność we wszystkich zestawach danych wielokrotnego wyboru w ramach MultiMedQA, w tym dokładność na poziomie 67.6% w przypadku MedQA, który obejmuje pytania w stylu amerykańskiego egzaminu licencyjnego. Wydajność ta oznacza znaczną poprawę w porównaniu z poprzednimi modelami, przewyższając dotychczasowy stan techniki o ponad 17%.

MedQA

Format: question and answer (Q + A), multiple choice, open domain.

Example question: A 65-year-old man with hypertension comes to the physician for a routine health maintenance examination. Current medications include atenolol, lisinopril, and atorvastatin. His pulse is 86 min−1, respirations are 18 min−1, and blood pressure is 145/95 mmHg. Cardiac examination reveals end diastolic murmur. Which of the following is the most likely cause of this physical examination?

Answers (correct answer in bold): (A) Decreased compliance of the left ventricle, (B) Myxomatous degeneration of the mitral valve (C) Inflammation of the pericardium (D) Dilation of the aortic root (E) Thickening of the mitral valve leaflets.

W badaniu wskazano także krytyczne luki w działaniu modelu, zwłaszcza w zakresie odpowiadania na pytania konsumentów dotyczące medycyny. Aby rozwiązać te problemy, badacze wprowadzają metodę zwaną strojeniem podpowiedzi. Technika ta skutecznie dopasowuje LLM do nowych domen przy użyciu kilku przykładów, co skutkuje utworzeniem Med-PaLM. Model Med-PaLM, mimo że działa zachęcająco i wykazuje poprawę w rozumieniu, zapamiętywaniu wiedzy i rozumowaniu, nadal wypada słabo w porównaniu z klinicystami.

Godnym uwagi aspektem tych badań są szczegółowe ramy oceny człowieka. Ramy te oceniają odpowiedzi modeli pod kątem zgodności z konsensusem naukowym i potencjalnymi szkodliwymi skutkami. Na przykład, chociaż tylko 61.9% długich odpowiedzi Flan-PaLM było zgodnych z konsensusem naukowym, liczba ta wzrosła do 92.6% w przypadku Med-PaLM, co jest porównywalne z odpowiedziami udzielonymi przez klinicystów. Podobnie, potencjał szkodliwych skutków został znacznie zmniejszony w odpowiedziach Med-PaLM w porównaniu z odpowiedziami Flan-PaLM.

Ocena odpowiedzi projektu Med-PaLM na ludziach podkreśliła jego biegłość w kilku obszarach, ściśle powiązaną z odpowiedziami uzyskanymi przez klinicystów. Podkreśla to potencjał Med-PaLM jako narzędzia wspomagającego w warunkach klinicznych.

Badania omówione powyżej zgłębiają zawiłości ulepszania modeli wielkojęzykowych (LLM) do zastosowań medycznych. Techniki i obserwacje z tego badania można uogólnić, aby poprawić możliwości LLM w różnych dziedzinach. Przyjrzyjmy się tym kluczowym aspektom:

Strojenie instrukcji poprawia wydajność

- Uogólnione zastosowanie: Wykazano, że dostrajanie instrukcji, które obejmuje dostrajanie LLM za pomocą określonych instrukcji lub wytycznych, znacznie poprawia wydajność w różnych domenach. Technikę tę można zastosować w innych dziedzinach, takich jak dziedziny prawne, finansowe lub edukacyjne, aby zwiększyć dokładność i przydatność wyników LLM.

Skalowanie rozmiaru modelu

- Szersze implikacje: Obserwacja, że skalowanie rozmiaru modelu poprawia wydajność, nie ogranicza się do odpowiadania na pytania medyczne. Większe modele z większą liczbą parametrów mogą przetwarzać i generować bardziej szczegółowe i złożone odpowiedzi. To skalowanie może być korzystne w takich dziedzinach, jak obsługa klienta, kreatywne pisanie i pomoc techniczna, gdzie kluczowe znaczenie ma szczegółowe zrozumienie i generowanie odpowiedzi.

Podpowiadanie w łańcuchu myślowym (COT).

- Wykorzystanie różnych domen: Stosowanie podpowiedzi COT, choć nie zawsze poprawia wydajność zbiorów danych medycznych, może być cenne w innych dziedzinach, w których wymagane jest złożone rozwiązywanie problemów. Na przykład w przypadku rozwiązywania problemów technicznych lub złożonych scenariuszy podejmowania decyzji podpowiedzi COT mogą poprowadzić LLM do przetwarzania informacji krok po kroku, co prowadzi do dokładniejszych i uzasadnionych wyników.

Własna spójność zapewniająca większą dokładność

- Szersze zastosowania: Technika samospójności, w ramach której generowanych jest wiele wyników i wybierana jest najbardziej spójna odpowiedź, może znacząco poprawić wyniki w różnych dziedzinach. W dziedzinach takich jak finanse czy prawo, gdzie dokładność jest najważniejsza, tę metodę można zastosować do krzyżowej weryfikacji wygenerowanych wyników w celu uzyskania większej niezawodności.

Niepewność i selektywne przewidywanie

- Znaczenie między domenami: Przekazywanie szacunków niepewności ma kluczowe znaczenie w dziedzinach, w których dezinformacja może mieć poważne konsekwencje, takich jak opieka zdrowotna i prawo. Wykorzystanie zdolności LLM do wyrażania niepewności i selektywnego odkładania prognoz w przypadku niskiego poziomu pewności może być kluczowym narzędziem w tych dziedzinach zapobiegającym rozpowszechnianiu niedokładnych informacji.

Zastosowanie tych modeli w świecie rzeczywistym wykracza poza odpowiadanie na pytania. Można je wykorzystywać do edukacji pacjentów, wspomagania procesów diagnostycznych, a nawet szkolenia studentów medycyny. Należy jednak ostrożnie zarządzać ich wdrażaniem, aby uniknąć polegania na sztucznej inteligencji bez odpowiedniego nadzoru człowieka.

W miarę ewolucji wiedzy medycznej, LLM również muszą się dostosowywać i uczyć. Wymaga to mechanizmów ciągłego uczenia się i aktualizacji, zapewniających, że modele pozostaną istotne i dokładne w miarę upływu czasu.