Sztuczna inteligencja

Mniej jest więcej: Dlaczego pobieranie mniejszej liczby dokumentów może poprawić odpowiedzi AI

Retrieval-Augmented Generation (RAG) jest podejściem do budowy systemów AI, które łączy model językowy z zewnętrznym źródłem wiedzy. W prostych słowach, AI najpierw wyszukuje dokumenty (takie jak artykuły lub strony internetowe) związane z zapytaniem użytkownika, a następnie wykorzystuje te dokumenty do wygenerowania bardziej dokładnej odpowiedzi. Ta metoda została doceniona za pomoc w utrzymaniu dużych modeli językowych (LLM) w faktach i redukcji halucynacji poprzez oparcie ich odpowiedzi w rzeczywistych danych.

Intuicyjnie, można by sądzić, że im więcej dokumentów AI pobiera, tym lepiej poinformowana będzie jego odpowiedź. Jednak niedawne badania sugerują zaskakujący zwrot: kiedy chodzi o dostarczanie informacji AI, czasem mniej jest więcej.

Mniej dokumentów, lepsze odpowiedzi

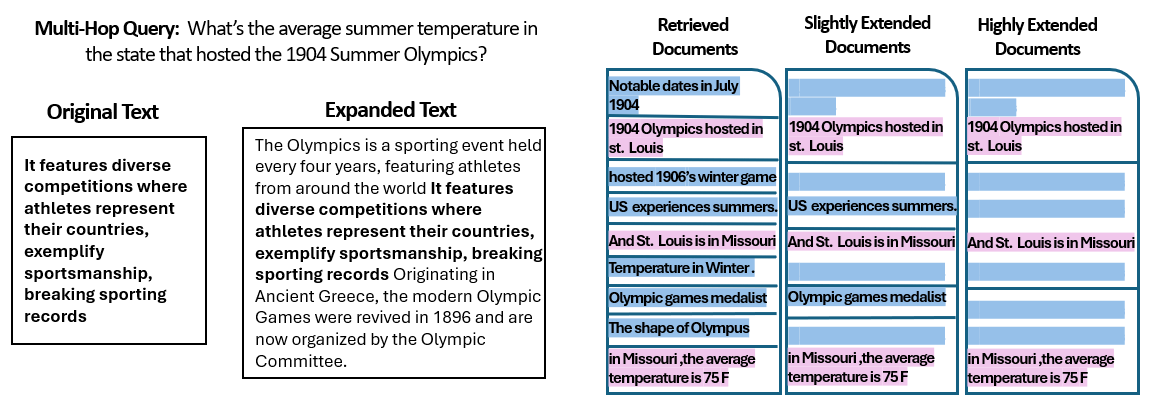

Nowe badanie przeprowadzone przez badaczy z Uniwersytetu Hebrajskiego w Jerozolimie zbadało, jak liczba dokumentów dostarczonych do systemu RAG wpływa na jego wydajność. Co istotne, utrzymano stałą ilość tekstu – jeśli dostarczono mniej dokumentów, te dokumenty były nieco rozszerzane, aby wypełnić tę samą długość, co wiele dokumentów. W ten sposób różnice w wydajności można było przypisać liczbie dokumentów, a nie tylko krótszemu wejściu.

Badacze wykorzystali zestaw danych do odpowiedzi na pytania (MuSiQue) z pytaniami z dziedziny trivia, każde z nich pierwotnie połączone z 20 akapitami z Wikipedii (z których tylko kilka zawierało odpowiedź, a reszta była rozpraszająca). Przez obcięcie liczby dokumentów z 20 do zaledwie 2-4 naprawdę istotnych – i wypełnienie ich nieco dodatkowym kontekstem, aby utrzymać stałą długość – stworzyli scenariusze, w których AI miało mniej materiałów do rozważenia, ale nadal mniej więcej tyle samo słów do przeczytania.

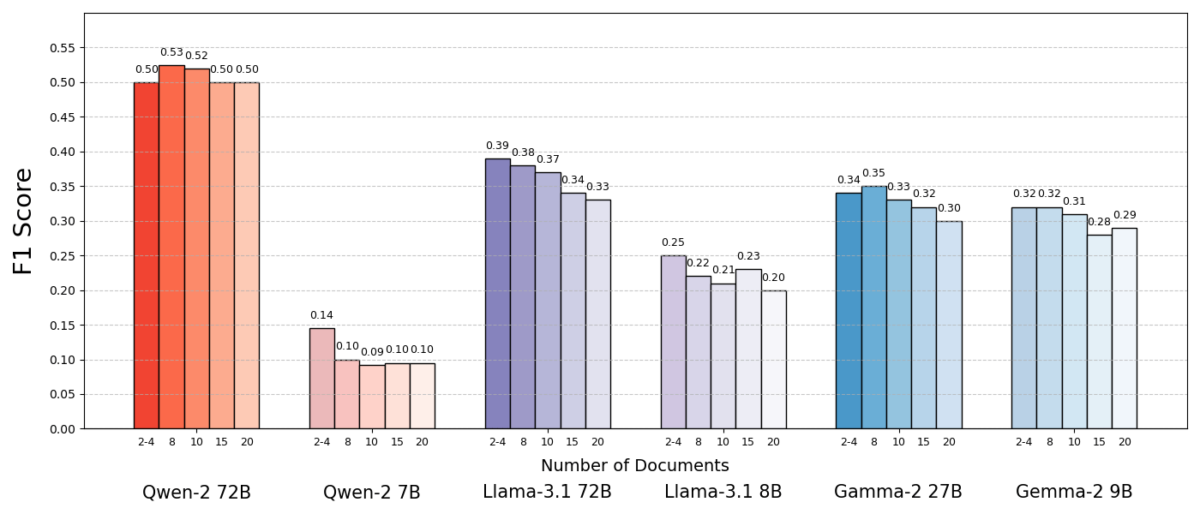

Wyniki były uderzające. W większości przypadków modele AI odpowiadały bardziej dokładnie, gdy otrzymywały mniej dokumentów niż cały zestaw. Wydajność poprawiła się znacznie – w niektórych przypadkach nawet o 10% w dokładności (wynik F1), gdy system wykorzystywał tylko garść dokumentów wspierających zamiast dużej kolekcji. Ten sprzeczny z intuicją wzrost został zaobserwowany w kilku różnych modelach językowych open-source, w tym wariantach Meta Llama i innych, co wskazuje, że zjawisko to nie jest związane z jednym modelem AI.

Jeden model (Qwen-2) był godnym uwagi wyjątkiem, który radził sobie z wieloma dokumentami bez spadku wyniku, ale prawie wszystkie przetestowane modele działały lepiej z mniejszą liczbą dokumentów. Innymi słowy, dodawanie większej liczby materiałów odniesienia poza kluczowymi kawałkami faktycznie pogarszało ich wydajność częściej, niż pomagało.

Źródło: Levy et al.

Dlaczego jest to takim zaskoczeniem? Zwykle systemy RAG są projektowane pod założeniem, że pobieranie szerszego zakresu informacji może tylko pomóc AI – przecież jeśli odpowiedź nie jest w pierwszych kilku dokumentach, może być w dziesiątym lub dwudziestym.

To badanie odwraca ten scenariusz, demonstrując, że nie rozróżnialne nakładanie dodatkowych dokumentów może się zemścić. Nawet gdy całkowita długość tekstu była utrzymana na stałym poziomie, sama obecność wielu różnych dokumentów (każdego z własnym kontekstem i cechami) sprawiła, że zadanie odpowiedzi na pytania stało się bardziej wymagające dla AI. Wydaje się, że poza pewnym punktem każdy dodatkowy dokument wprowadzał więcej szumu niż sygnału, myląc model i osłabiając jego zdolność do wydobycia poprawnej odpowiedzi.

Dlaczego mniej może być więcej w RAG

Ten „mniej jest więcej” wynik ma sens, gdy rozważymy, jak modele językowe AI przetwarzają informacje. Gdy AI otrzymuje tylko najbardziej istotne dokumenty, kontekst, który widzi, jest skupiony i pozbawiony rozpraszających elementów, podobnie jak uczeń, który dostał tylko odpowiednie strony do studiowania.

W badaniu modele działały znacznie lepiej, gdy otrzymywały tylko dokumenty wspierające, z usuniętym nieistotnym materiałem. Pozostający kontekst nie był tylko krótszy, ale także czystszy – zawierał fakty, które bezpośrednio wskazywały na odpowiedź i nic więcej. Z mniejszą liczbą dokumentów do rozważenia model mógł poświęcić swoją pełną uwagę istotnym informacjom, co sprawiło, że było mniej prawdopodobne, aby się rozproszył lub zmieszał.

Z drugiej strony, gdy pobrano wiele dokumentów, AI musiało przefiltrować mieszankę istotnych i nieistotnych treści. Często te dodatkowe dokumenty były „podobne, ale niespokrewnione” – mogły dzielić temat lub słowa kluczowe z zapytaniem, ale nie zawierały odpowiedzi. Taki materiał może mylić model. AI mogło zmarnować wysiłek, próbując połączyć kropki między dokumentami, które nie prowadzą do poprawnej odpowiedzi, lub co gorsza, mogło niepoprawnie połączyć informacje z wielu źródeł. Zwiększa to ryzyko halucynacji – przypadków, w których AI generuje odpowiedź, która brzmi prawdopodobnie, ale nie jest oparta na żadnym konkretnym źródle.

W istocie, badacze stwierdzili, że jeśli dodatkowe dokumenty były oczywiście nieistotne (na przykład losowy, niezwiązany tekst), modele były lepsze w ignorowaniu ich. Prawdziwe kłopoty pojawiają się, gdy rozpraszające dane wyglądają na istotne: gdy wszystkie pobrane teksty dotyczą podobnych tematów, AI zakłada, że powinno ich wszystkich wykorzystać i może mieć trudności z określeniem, które szczegóły są naprawdę ważne. To potwierdza obserwację badania, że losowe rozpraszacze powodowały mniej zamieszania niż realistyczne rozpraszacze w wejściu. AI może odfiltrować jawne nonsensy, ale subtelnie nieistotne informacje są pułapką – wprowadzają się pod pozorem istotności i wyhamowują odpowiedź. Poprzez ograniczenie liczby dokumentów do tylko naprawdę niezbędnych unikamy układania tych pułapek od samego początku.

Istnieje również praktyczna korzyść: pobieranie i przetwarzanie mniejszej liczby dokumentów obniża obciążenie obliczeniowe systemu RAG. Każdy dokument, który zostaje pobrany, musi być przeanalizowany (zawarty, przeczytany i rozważony przez model), co zużywa czas i zasoby obliczeniowe. Usunięcie zbędnych dokumentów sprawia, że system staje się bardziej wydajny – może znaleźć odpowiedzi szybciej i przy niższych kosztach. W scenariuszach, w których dokładność poprawiła się poprzez skupienie się na mniejszej liczbie źródeł, mamy podwójne zwycięstwo: lepsze odpowiedzi i lżejszy, bardziej efektywny proces.

Źródło: Levy et al.

Ponowne rozważenie RAG: Przyszłe kierunki

To nowe dowody, że jakość często bije ilość w pobieraniu, ma istotne implikacje dla przyszłości systemów AI, które polegają na zewnętrznej wiedzy. Sugeryzuje, że projektanci systemów RAG powinni priorytetowo traktować inteligentne filtrowanie i klasyfikowanie dokumentów nad ich ilością. Zamiast pobierania 100 możliwych fragmentów i liczenia na to, że odpowiedź jest gdzieś tam ukryta, może być mądrzejsze pobranie tylko kilku najbardziej istotnych.

Autorzy badania podkreślają potrzebę metod pobierania, które „znajdują równowagę między istotnością a różnorodnością” w informacjach, które dostarczają modelowi. Innymi słowy, chcemy zapewnić wystarczające pokrycie tematu, aby odpowiedzieć na pytanie, ale nie tak dużo, aby faktyczne informacje zostały utonęte w morzu nieistotnych tekstów.

W przyszłości badacze prawdopodobnie będą badać techniki, które pomogą modelom AI lepiej radzić sobie z wieloma dokumentami. Jednym z podejść jest rozwój lepszych systemów pobierania lub ponownej klasyfikacji, które mogą określić, które dokumenty naprawdę dodają wartość, a które wprowadzają konflikt. Innym kierunkiem jest poprawa samych modeli językowych: jeśli jeden model (jak Qwen-2) potrafił radzić sobie z wieloma dokumentami bez utraty dokładności, zbadanie, jak został wytrenowany lub zbudowany, mogłoby dostarczyć wskazówek do uczynienia innych modeli bardziej odpornymi. Może przyszłe duże modele językowe będą zawierać mechanizmy, które rozpoznają, kiedy dwa źródła mówią to samo (lub się sprzeciwiają) i będą się na tym koncentrować. Celem byłoby umożliwienie modelom wykorzystania bogatego zakresu źródeł bez wpadania w zamieszanie – efektywnie uzyskując najlepsze z obu światów (szerokość informacji i klarowność skupienia).

Warto zauważyć, że w miarę jak systemy AI zyskują większe okna kontekstowe (możliwość czytania większej ilości tekstu na raz), po prostu wrzucanie większej ilości danych do promtu nie jest srebrną kulą. Większe okno kontekstowe nie oznacza automatycznie lepszego zrozumienia. To badanie pokazuje, że nawet jeśli AI może technicznie przeczytać 50 stron na raz, dostarczanie mu 50 stron informacji o mieszanej jakości może nie dać dobrego wyniku. Model nadal korzysta z kuratorów, istotnych treści do pracy, zamiast nie rozróżnialnego zrzutu. W rzeczywistości inteligentne pobieranie może stać się jeszcze bardziej kluczowe w erze olbrzymich okien kontekstowych – aby upewnić się, że dodatkowa pojemność jest wykorzystywana do cennych informacji, a nie szumu.

Wyniki z „Więcej dokumentów, ta sama długość” (odpowiednio zatytułowanego artykułu) zachęcają do ponownego zbadania naszych założeń w badaniach AI. Czasem dostarczanie AI wszystkich danych, których dysponujemy, nie jest tak skuteczne, jak myślimy. Poprzez skupienie się na najbardziej istotnych kawałkach informacji nie tylko poprawiamy dokładność odpowiedzi generowanych przez AI, ale także sprawiamy, że systemy stają się bardziej efektywne i łatwiejsze do zaufania. To sprzeczne z intuicją nauczenie, ale z ekscytującymi konsekwencjami: przyszłe systemy RAG mogą być zarówno mądrzejsze, jak i lżejsze, poprzez staranne wybieranie mniejszej liczby, lepszych dokumentów do pobrania.