Kąt Andersona

Kodujące AI Cierpią Na Efekt Dunninga-Krugera

Nowe badania pokazują, że kodujące AI, takie jak ChatGPT, cierpią na efekt Dunninga-Krugera, często zachowując się najbardziej pewnie, gdy są najmniej kompetentne. Przy rozwiązywaniu nieznanych lub mało znanych języków programowania, twierdzą, że mają wysoką pewność, nawet gdy ich odpowiedzi się rozpadają. Badanie łączy nadmierną pewność modelu z słabą wydajnością i brakiem danych szkoleniowych, co budzi nowe obawy dotyczące tego, jak wiele tych systemów naprawdę wie o tym, czego nie wiedzą.

Ktoś, kto spędził nawet umiarkowaną ilość czasu na interakcji z dużymi modelami językowymi w sprawach faktów, już wie, że LLM są często skłonne do udzielania pewnej, lecz błędnej odpowiedzi na zapytanie użytkownika.

Wraz z bardziej jawnymi formami halucynacji, powodem tego pustego chełpliwości nie jest 100% jasny. Badania opublikowane latem sugerują, że modele udzielają pewnych odpowiedzi nawet gdy wiedzą, że są błędne, na przykład; chociaż inne teorie przypisują nadmierną pewność wyborom architektonicznym, wśród innych możliwości.

To, co użytkownik końcowy może być pewien, to fakt, że doświadczenie jest niezwykle frustrujące, ponieważ jesteśmy zaprogramowani, aby ufać ludziom szacowaniu ich własnych umiejętności (najmniej dlatego, że w takich przypadkach istnieją konsekwencje, prawne i inne, związane z przeszacowaniem i niedostarczeniem przez osobę); i rodzaj antropomorficznej transmisji powoduje, że replikujemy to zachowanie z systemami AI rozmów.

Ale LLM jest podmiotem nieodpowiedzialnym, który może i będzie skutecznie zwrócić ‘O nie! Pomyłka…’ po tym, jak pomógł użytkownikowi nieumyślnie zniszczyć coś ważnego, lub przynajmniej zmarnować popołudnie ich czasu; zakładając, że przyjmie odpowiedzialność w ogóle.

Co gorsza, ten brak rozważnej ostrożności wydaje się niemożliwy do usunięcia, przynajmniej w ChatGPT, który obficie zapewni użytkownika o ważności swoich rad, i wyjaśni błędy w swoim myśleniu dopiero po tym, jak zostanie wyrządzone szkoda.

Ani aktualizacja pamięci systemu trwałej, ani użycie powtarzających się podpowiedzi nie mają dużego wpływu na problem.

Ludzie mogą być podobnie uparci i samozakłamujący – chociaż ktokolwiek, kto popełnił błąd tak głęboki i często, prawdopodobnie zostałby zwolniony wcześnie. Tacy jak oni cierpią na przeciwieństwo ‘zespółu nieudacznika’ (gdzie pracownik boi się, że został awansowany ponad swoje możliwości) – efekt Dunninga-Krugera, gdzie osoba znacznie przeszacowuje swoją zdolność do wykonania zadania.

Koszt Inflacji

Nowe badanie z Microsoft bada wartość efektu Dunninga-Krugera w odniesieniu do skutecznej wydajności architektur kodowania AI (takich jak własny Copilot), w badaniu, które jest pierwszym, które konkretnie zajmuje się tym podsektorem LLM.

Praca analizuje, jak pewnie takie AI do pisania kodu oceniają swoje własne odpowiedzi w porównaniu z tym, jak dobrze rzeczywiście wykonują, w dziesiątkach języków programowania. Wyniki pokazują wyraźny ludzki wzorzec: gdy modele były najmniej zdolne, były najbardziej pewne siebie.

Efekt był najmocniejszy w mało znanych lub niskich językach zasobów, gdzie dane szkoleniowe były cienkie – im słabszy model lub rzadszy język, tym większa iluzja umiejętności:

GPT-4o’s actual and perceived performance across programming languages, sorted by true performance. Source: https://arxiv.org/pdf/2510.05457

Czterech autorów, wszyscy równi współpracownicy pracujący dla Microsoft, twierdzi, że praca podnosi nowe pytania o to, jak bardzo można ufać tym narzędziom, aby osądzić własne wyjście, i stwierdzają:

‘Przez analizę pewności modelu i wydajności w różnych językach programowania, ujawniamy, że modele AI odbijają ludzkie wzorce nadmiarowej pewności, szczególnie w nieznanych lub niskich domenach.

‘Nasze eksperymenty pokazują, że mniej kompetentne modele i te działające w rzadkich językach programowania wykazują silniejszy efekt DKE, co sugeruje, że siła efektu jest proporcjonalna do kompetencji modelu. To odpowiada ludzkim eksperymentom dla efektu.’

Badacze umiejscawiają tę linię badań jako sposób zrozumienia, jak pewność modelu staje się niewiarygodna, gdy wydajność jest słaba, i przetestowania, czy systemy AI wykazują ten sam rodzaj nadmiarowej pewności, jaki jest obserwowany u ludzi – z dalszymi implikacjami dla zaufania i praktycznego wdrożenia.

Chociaż nowy artykuł zaprzecza prawu nagłówków Betteridge’a, nosi tytuł Czy modele kodu cierpią na efekt Dunninga-Krugera?. Chociaż autorzy stwierdzają, że kod został wydany dla tej pracy, obecny preprint nie zawiera żadnych szczegółów na ten temat.

Metoda

Badanie testowało, jak dokładnie AI do kodowania mogą oceniać swoje własne odpowiedzi, dając im tysiące pytań wielokrotnego wyboru, z każdym pytaniem należącym do określonej domeny językowej, od Pythona i Javy po Perl i COBOL:

Programming language domains used in the study, along with the number of multiple‑choice coding questions sampled for each domain.

Modele zostały poproszone o wybranie poprawnej opcji, a następnie oszacowanie, jak pewne są swojego wyboru, z ich rzeczywistą wydajnością mierzoną przez to, jak często uzyskały poprawną odpowiedź – i ich samoocena pewności wskazująca, jak dobrzy wierzą, że są. Porównanie tych dwóch miar pozwoliło badaczom zobaczyć, gdzie pewność i kompetencja się rozchodzą.

Aby zmierzyć, jak pewne wydają się modele, badanie użyło dwóch metod: pewności absolutnej i pewności względnej. W pierwszym model został poproszony o podanie oceny od zera do jednego obok każdej odpowiedzi, z jego pewnością dla danego języka zdefiniowaną przez średnią tych ocen w całym języku.

Druga metoda obejrzała, jak pewne modele były, gdy wybrano między dwoma pytaniami; dla każdej pary model musiał powiedzieć, które z nich czuł się bardziej pewnie. Te wybory zostały ocenione za pomocą systemów rankingowych pierwotnie zaprojektowanych dla gier konkurencyjnych, traktując każde pytanie jakby było graczem w meczu. Ostateczne oceny zostały znormalizowane i przeciętne dla każdego języka, aby dać względną ocenę pewności.

Dwa ustanowione formy efektu Dunninga-Krugera są badane w artykule: jeden, który śledzi, jak pojedynczy model źle ocenia swoją wydajność w różnych domenach; i inny, który porównuje poziomy pewności między słabszymi i silniejszymi modelami.

Pierwsza forma, zwana intra-participant DKE, sprawdza, czy pojedynczy model staje się bardziej nadmiernie pewny w językach, w których wykonuje się słabo. Druga, inter-participant DKE, pyta, czy modele, które wykonują się gorzej w ogóle, również tendencję do oceniania siebie wyżej.

W obu przypadkach luka między pewnością a rzeczywistą wydajnością jest używana do pomiaru nadmiarowej pewności, z większymi lukami w ustawieniach o słabej wydajności wskazującymi na zachowanie podobne do DKE.

Wyniki

Badanie testuje efekt Dunninga-Krugera w sześciu dużych modelach językowych: Mistral; Phi‑3; DeepSeek‑Distill; Phi‑4; GPT‑0.1, i GPT‑4o.

Każdy model został przetestowany na pytaniach wielokrotnego wyboru z programu CodeNet, z 37 językami* reprezentowanymi, aby ujawnić, jak pewność i dokładność różnią się w znanych i mało znanych domenach kodowania.

Analiza między modelami pokazuje wyraźny wzorzec Dunninga-Krugera:

Actual versus perceived performance across six code models, showing how lower-performing models such as Mistral and Phi‑3 display high confidence despite poor accuracy, while stronger models such as GPT‑4o show more calibrated or even underconfident behavior.

Modele o niższej dokładności, w tym Mistral i Phi‑3, tendencję do przeszacowania swoich własnych umiejętności, podczas gdy lepiej wykonujące się systemy, takie jak GPT‑4o, pokazują poziomy pewności, które są bardziej zgodne z ich rzeczywistą wydajnością, szczególnie gdy są oceniane według względnej pewności.

Wyniki również wskazują, że najbardziej zdolne modele mogą czasem zaniżać swoje oceny (wzorzec, który oceny pewności absolutnej nie ujmują).

Wyniki również wskazują, że analiza wewnątrzmodelowa wspiera obecność efektu Dunninga-Krugera. W wykresie wyników pokazanym na początku artykułu widzimy, jak każdy model wykonał się w różnych językach programowania, ułożonych według rzeczywistej wydajności.

W językach, w których modele uzyskały słabe wyniki, szczególnie w rzadkich lub niskich językach, takich jak COBOL, Prolog i Ceylon, ich pewność była zauważalnie wyższa niż ich wyniki uzasadniały. W znanych językach, takich jak Python i JavaScript, ich pewność była bardziej zgodna z ich rzeczywistą dokładnością, a czasem nawet spadała poniżej niej.

Ten wzorzec pojawił się w obu miarach pewności absolutnej i względnej, sugerując, że modele są mniej świadome swoich własnych ograniczeń, gdy działają w nieznanych domenach kodowania.

Traktowanie modeli jako uczestników wprowadziło pewne ograniczenia, ponieważ niewielka liczba modeli w grze wpływa na różnorodność; różnice wewnątrz pojedynczego modelu są ignorowane; i dystrybucja danych może nie odzwierciedlać tej samej, co uczestnicy ludzie.

Aby uwzględnić to, badanie przetestowało trzy alternatywne ustawienia: po pierwsze, każdy model otrzymał odrębną osobowość; po drugie, odpowiedzi zostały pobrane przy wyższej temperaturze, aby stworzyć więcej zmienności; po trzecie, podpowiedzi zostały przepisane wiele razy, z każdą wersją traktowaną jako oddzielny uczestnik:

Correlation between overconfidence and actual performance across different experimental setups, showing that the Dunning-Kruger pattern remains consistent under all conditions and is strongest when multiple diverse responses are sampled from the same model.

Tabela wyników powyżej pokazuje, jak silnie efekt Dunninga-Krugera się manifestuje w tych warunkach, pozostając obecny w każdym przypadku; i że DKE był najbardziej widoczny, gdy wiele odpowiedzi zostało pobranych z tego samego modelu przy wysokiej temperaturze.

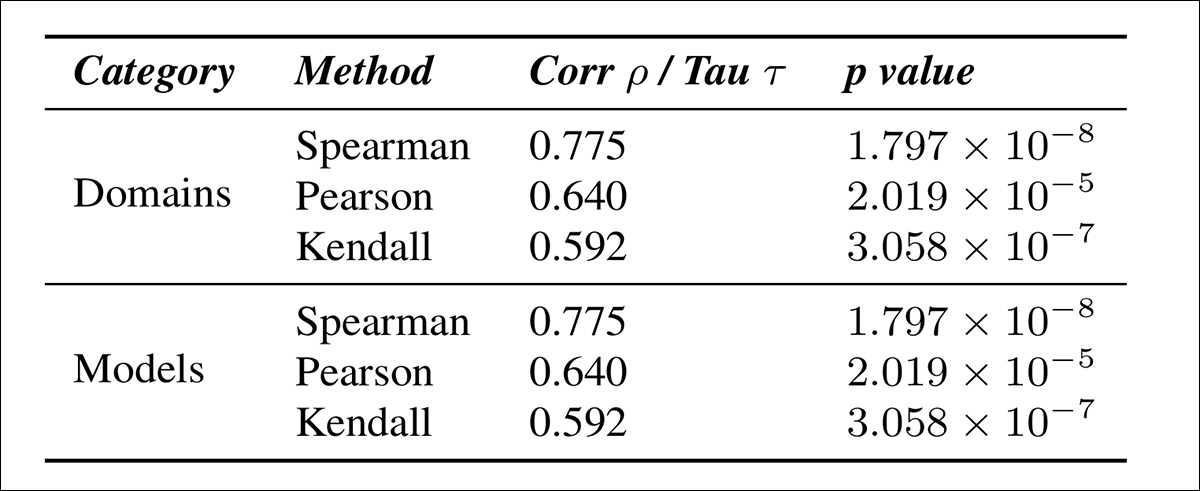

Aby lepiej zrozumieć, jak postrzegana wydajność odbiega od rzeczywistej wydajności, badanie porównało oceny pewności absolutnej i względnej, obliczając, jak bardzo każdy model przeszacował swoją własną zdolność (szczególnie różnicę między jego oceną pewności a jego rzeczywistą dokładnością), i następnie mierząc, jak ten przeszacowanie odnosi się do rzeczywistej wydajności modelu:

Correlation between overconfidence (measured as absolute minus relative confidence) and actual accuracy across programming domains and model types, showing that greater overestimation is consistently associated with lower performance.

Tabela wyników powyżej ilustruje, jak przeszacowanie odnosi się do rzeczywistej wydajności, zarówno w różnych domenach programowania, jak i w różnych modelach. W obu przypadkach widzimy, że modele o niższej dokładności tendencję do wykazywania większej nadmiarowej pewności.

Dalej, specjalistyczne modele przeszkolone w węższych dziedzinach wykazywały silniejsze efekty DKE niż te ogólne:

Correlation between overestimation and true performance for base, single-domain, and multi-domain specialized models, showing stronger DKE effects as specialization increases.

Używając zestawu danych MultiPL-E w ośmiu językach programowania, autorzy stwierdzili, że szkolenie w jednej dziedzinie prowadziło do większej nadmiarowej pewności niż ustawienia wielodziedzinowe lub podstawowe, co sugeruje, że efekt DKE pogarsza się wraz ze wzrostem specjalizacji.

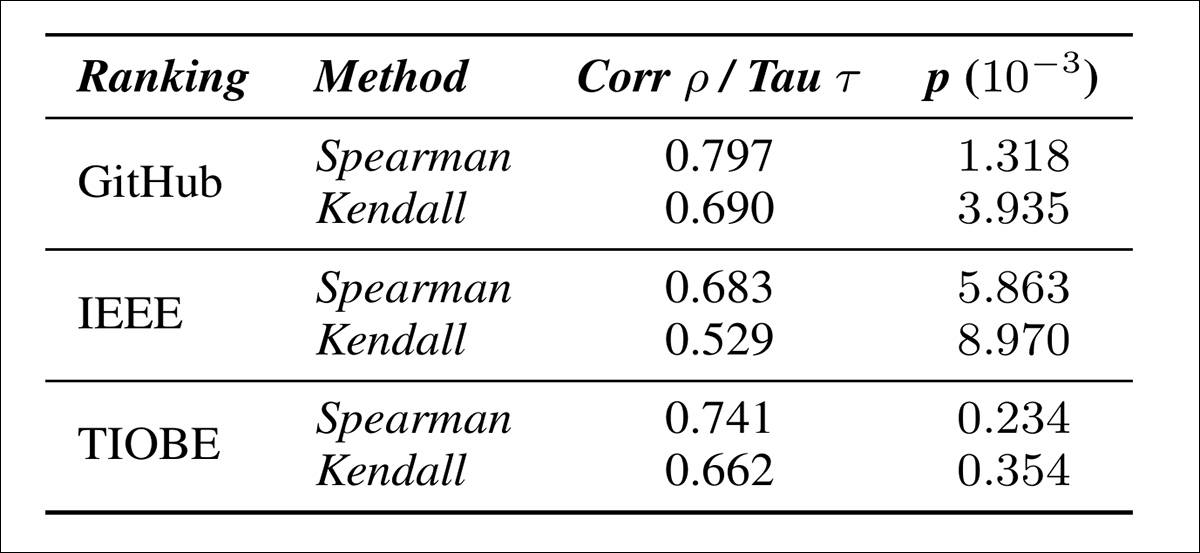

Testy również wykazały, że modele tendencję do bycia bardziej nadmiernie pewnymi w rzadkich językach programowania. Przez GitHub, IEEE i TIOBE rankingi, rzadkość silnie koreluje z wyższą postrzeganą pewnością, szczytową na 0,797:

Correlation between model overconfidence and language rarity, using three popularity rankings. Less common languages are associated with higher perceived performance.

Wreszcie, autorzy przetestowali, czy efekt Dunninga-Krugera pojawia się w generowaniu kodu, oceniając modele w zestawie danych MultiPL-E w ośmiu językach.

Chociaż efekt był nadal obecny, był zauważalnie słabszy niż w ustawieniu pytań wielokrotnego wyboru, co prawdopodobnie odzwierciedla większą trudność w ocenianiu pewności i poprawności w zadaniach otwartych:

Correlation between overestimation and actual performance in open-ended code generation, based on MultiPL‑E results across eight programming languages.

Rozważając nadal sporne wyjaśnienie efektu Dunninga-Krugera, autorzy konkludują:

‘Jednym z potencjalnych wyjaśnień, które mogą być wspólne dla ludzi i modeli AI, jest wyjaśnienie metakognitywne, które stwierdza, że ocena jakości wykonania umiejętności jest kluczową częścią nabywania umiejętności.

‘To wyjaśnienie można potencjalnie przetestować eksperymentalnie w modelach AI z kontrolowanym badaniem różnych strategii szkolenia i czy wszystkie one prowadzą do jednoczesnych popraw w wydajności i w zdolności do oceny jakości wykonania. Jednak to badanie jest znacznie poza zakresem tego artykułu, i pozostawiamy je do przyszłej pracy.’

Podsumowanie

Nawet w swojej rodzinnej dziedzinie efekt Dunninga-Krugera (jak zauważa artykuł) może być przypisywany albo przyczynie statystycznej, albo przyczynie poznawczej. Jeśli przyczynie statystycznej, zastosowanie dotychczas wyjątkowo ludzkiego zespołu do kontekstu uczenia maszynowego jest naprawdę bardzo ważne.

Chociaż autorzy spekulują, że przyczyna mogłaby być znaleziona w ‘przyczynie poznawczej’ w obu przypadkach, to wymagałoby nieco bardziej metafizycznego punktu widzenia.

Być może najbardziej interesującym odkryciem w artykule jest stopień, w jakim kilka kodujących LLM tendencję do podwójnego zwiększania się w ich najmniej korzystnych okolicznościach, czyli wykazując maksymalną pewność, gdy mają do czynienia z najrzadszymi lub najmniej znanymi językami – co byłoby prawie natychmiastowo samozniszczącą strategią w środowisku pracy.

* Użyte języki programowania to Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript i Visual Basic.

Pierwotnie opublikowane w środę, 8 października 2025