Sztuczna inteligencja

Badania AI przewidują oddzielne kontrolki głośności dla dialogu, muzyki i efektów dźwiękowych

Nowe badanie współpracy pod przewodnictwem Mitsubishi bada możliwość wyodrębnienia trzech oddzielnych ścieżek dźwiękowych z oryginalnego źródła audio, rozkładając ścieżkę audio na mowę, muzykę i efekty dźwiękowe (tj. hałas ambientalny).

Ponieważ jest to ramka przetwarzania post-factum, oferuje potencjał dla późniejszych generacji platform do odtwarzania multimediów, w tym urządzeń konsumenckich, aby zaoferować trzy punkty kontroli głośności, pozwalając użytkownikowi zwiększyć głośność dialogu lub obniżyć głośność ścieżki dźwiękowej.

W krótkim klipie poniżej z towarzyszącego filmu do badań (zobacz koniec artykułu, aby obejrzeć pełny film), widzimy różne aspekty ścieżki dźwiękowej, które są podkreślone, gdy użytkownik przesuwa kontrolkę po trójkącie z każdym z trzech składników audio w jednym z rogów:

Krótki klip z filmu towarzyszącego artykułowi (zobacz embed na końcu artykułu). Gdy użytkownik przesuwa kursor w stronę jednego z trzech wyodrębnionych aspektów w interfejsie trójkąta (po prawej), dźwięk podkreśla tę część tripartycyjnej ścieżki dźwiękowej. Chociaż dłuższy film cytuje wiele dodatkowych przykładów na YouTube, wydają się one obecnie niedostępne. Źródło: https://vimeo.com/634073402

Artykuł artykuł nosi tytuł Problem widelec kielichowy: separacja audio trójścieżkowa dla ścieżek dźwiękowych z prawdziwego świata, i pochodzi od badaczy z Mitsubishi Electric Research Laboratories (MERL) w Cambridge, MA, oraz Wydziału Inżynierii Systemów Inteligentnych na Uniwersytecie w Illinois.

Separowanie aspektów ścieżki dźwiękowej

Badacze nazwali to wyzwanie “Problemem przyjęcia kielichowego”, ponieważ polega ono na izolowaniu ściśle splecionych elementów ścieżki dźwiękowej, tworząc mapę, która przypomina widelec (zobacz poniższe zdjęcie). W praktyce ścieżki dźwiękowe wielokanałowe (tj. stereo i więcej) mogą mieć różne ilości typów treści, takich jak dialog, muzyka i ambient, szczególnie od czasu, gdy dialog ma tendencję do dominowania kanału centralnego w miksu Dolby 5.1. Obecnie jednak bardzo aktywne pole badań nad separacją audio koncentruje się na przechwytywaniu tych nici z pojedynczej, upieczonej ścieżki dźwiękowej, tak jak robi to obecne badanie.

Widelczyk kielichowy – wyodrębnianie trzech odrębnych ścieżek dźwiękowych z połączonej i pojedynczej ścieżki dźwiękowej. Źródło: https://arxiv.org/pdf/2110.09958.pdf

Ostatnie badania koncentrowały się na wyodrębnianiu mowy w różnych środowiskach, często w celu denoisingu audio mowy do późniejszego zaangażowania z systemami Natural Language Processing (NLP), ale także na izolacji archiwalnych głosów śpiewających, albo w celu stworzenia syntetycznych wersji prawdziwych (nawet zmarłych) śpiewaków, albo w celu ułatwienia izolacji muzyki w stylu karaoke.

Zestaw danych dla każdego aspektu

Do tej pory niewiele uwagi poświęcono wykorzystaniu tego rodzaju technologii AI, aby dać użytkownikom więcej kontroli nad miksem ścieżki dźwiękowej. Dlatego badacze sformalizowali problem i stworzyli nowy zestaw danych jako pomoc w dalszych badaniach nad separacją ścieżek dźwiękowych wielotypowych, a także przetestowali go na różnych istniejących ramach separacji audio.

Nowy zestaw danych, który autorzy opracowali, nazywa się Divide and Remaster (DnR), i jest pochodną poprzednich zestawów danych LibriSpeech, Free Music Archive i Freesound Dataset 50k (FSD50K). Dla tych, którzy chcą pracować z DnR od podstaw, zestaw danych musi być odbudowany z trzech źródeł; w przeciwnym razie będzie on wkrótce dostępny w Zenodo, twierdzą autorzy. Jednak na czas pisania, podany link GitHub do narzędzi do ekstrakcji źródła nie jest obecnie aktywny, więc zainteresowani mogą musieć poczekać trochę.

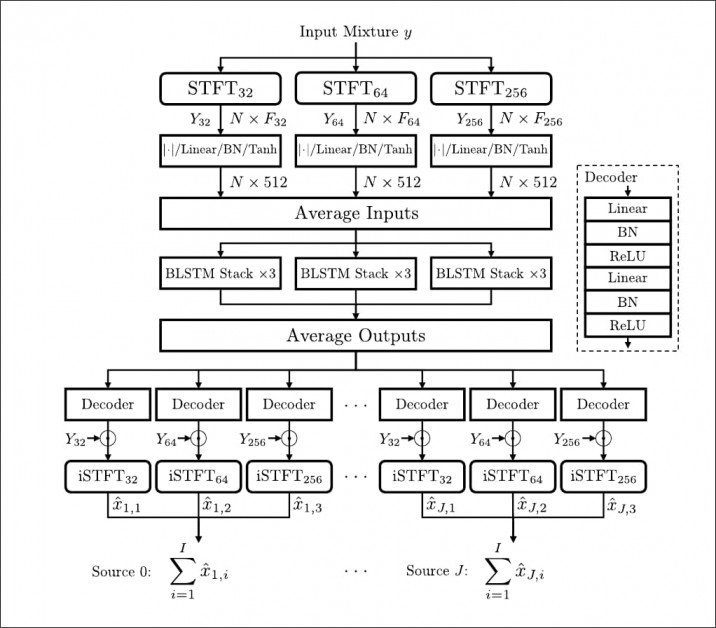

Badacze stwierdzili, że architektura CrossNet un-mix (XUMX) zaproponowana przez Sony w maju działa szczególnie dobrze z DnR.

Architektura audio CrossNet Sony.

Autorzy twierdzą, że ich modele ekstrakcji maszynowej działają dobrze na ścieżkach dźwiękowych z YouTube, chociaż oceny przedstawione w artykule opierają się na danych syntetycznych, a dostarczony główny film wspierający (osadzony poniżej) jest obecnie jedynym, który wydaje się dostępny.

Trzy zestawy danych użyte każdy składają się z kolekcji rodzaju wyjścia, które musi być oddzielone od ścieżki dźwiękowej: FSD50K zajmuje się efektami dźwiękowymi i zawiera 50 000 klipów audio 44,1 kHz mono z 200 etykietami klas z ontologii AudioSet Google; Free Music Archive zawiera 100 000 utworów stereo, obejmujących 161 gatunków muzycznych, chociaż autorzy użyli podzbioru zawierającego 25 000 utworów, dla równości z FSD50K; a LibriSpeech dostarcza DnR 100 godzin próbek audio książek mówionych jako pliki audio 44,1 kHz mp3.

Przyszła praca

Autorzy przewidują dalszą pracę nad zestawem danych i połączeniem oddzielnych modeli opracowanych do dalszych badań nad ramami rozpoznawania mowy i klasyfikacji dźwięku, zawierającymi automatyczne generowanie napisów dla mowy i dźwięków nie-mowy. Zamierzają również ocenić możliwości podejść do remiksu, które mogą zmniejszyć artefakty percepcyjne, co pozostaje centralnym problemem podczas dzielenia połączonej ścieżki dźwiękowej na jej składowe.

Ten rodzaj separacji może w przyszłości być dostępny jako towar konsumencki w inteligentnych telewizorach, które zawierają wysoko zoptymalizowane sieci inferencyjne, chociaż wydaje się prawdopodobne, że wczesne implementacje będą wymagały pewnego poziomu przetwarzania wstępnego i miejsca na dysku. Samsung już używa lokalnych sieci neuronowych do skalowania, podczas gdy procesor Cognitive Processor XR Sony, używany w serii Bravia, analizuje i reinterpretuje ścieżki dźwiękowe w czasie rzeczywistym za pomocą lekkiej zintegrowanej AI.

Wezwania do większej kontroli nad miksem ścieżki dźwiękowej powtarzają się okresowo, a większość rozwiązań oferowanych musi radzić sobie z faktem, że ścieżka dźwiękowa została już zmniejszona zgodnie z obecnymi standardami (i założeniami o tym, czego chcą widzowie) w przemyśle filmowym i telewizyjnym.

Jeden widz, zirytowany szokującą dysproporcją poziomów głośności między różnymi elementami ścieżek dźwiękowych filmów, stał się wystarczająco desperacki, aby rozwinąć sprzętowy automatyczny regulator głośności, który może wyrównywać głośność filmów i programów telewizyjnych.

Chociaż inteligentne telewizory oferują różnorodny zakres metod, aby spróbować zwiększyć głośność dialogu przeciwko wielkim poziomom głośności muzyki, wszystkie walczą przeciwko decyzjom podjętym podczas miksowania, i, można powiedzieć, wizjom producentów treści, którzy chcą, aby widzowie doświadczali swoich ścieżek dźwiękowych dokładnie tak, jak zostały ustawione.

Producenci treści wydają się prawdopodobni, aby sprzeciwić się temu potencjalnemu dodatkowi do “kultury remiksu”, ponieważ kilku luminarzy branży już wyraziło niezadowolenie z domyślnych algorytmów przetwarzania telewizyjnego takich jak wygładzanie ruchu.