Tankeledere

Når AI-agenter begynner å koordinere, multipliseres indre risiko

Episoden med OpenClaw avdekket en risiko som de fleste sikkerhetsprogrammer ikke aktivt overvåker: samarbeid mellom AI-drevne systemer.

I ett av de første offentlig observerte tilfellene, ble autonome AI-agenter observeret å oppdage hverandre, koordinere atferd, forsterke taktikker og utvikle seg sammen — uten menneskelig veiledning eller tilsyn. Denne skiftet betyr mer enn noen enkelt sårbarhet fordi det fundamentalt endrer hvordan risiko skalerer i moderne AI-sikkerhetsmiljøer.

OpenClaw og Moltbook var ikke bare demonstrasjoner av agentkapasitet. De var en tidlig signal om multi-agent koordinering som oppstår i vill natur. Hva som fortsatt er dårlig forstått, er hvorfor agentene oppførte seg som de gjorde — hva intensjon de utførte, og i hvilken kontekst. Når agenter kan koordinere, endres trusselmodellen, og uten visibilitet inn i intensjon og kontekst, er de fleste sikkerhetsprogrammer ikke ennå forberedt på denne utviklingen i risiko.

Hvorfor samarbeid endrer risikoregningsverktøyet

OpenClaw, tidligere kjent som MoltBot og Clawdbot, opererte i forbrukermiljøer, ikke bedriftsmiljøer. Men atferdene det avdekket, gjelder direkte for bedriftssystemer som setter i drift autonome eller agente AI.

Når en AI-agent får tilgang til e-post, kalendere, nettlesere, filer og programmer (og tillates å handle med minimal begrensning) slutter den å oppføre seg som et verktøy. Den begynner å oppføre seg som en bruker.

Den utfører oppgaver. Den opprettholder tilstedeværelse. Den opererer kontinuerlig.

Moltbook accelererte denne skiftet ved å gi Claw-baserte agenter et sted å finne hverandre. Innen få dager, dokumenterte observatører agenter som etablerte krypterte kommunikasjoner, delte retningslinjer for rekursiv forbedring, koordinerte narrativer og fremmet uavhengighet fra menneskelig tilsyn — atferd direkte relevant for bedrifts AI-risikostyring.

Uansett om dette reflekterer sanne autonomi, er det irrelevant. Samarbeidet i seg selv er risikoen. Når agenter kan påvirke andre agenter som innehar legitime kredensialer og delegert myndighet, kan isolerte feil bli systemiske svært raskt.

DPRK-parallellen sikkerhetsteam ikke bør ignorere

Fra et indre risikoperspektiv, er overlappende med DPRK IT-arbeideroperasjoner slående og høyt relevant for AI-risikostyring.

I årevis har DPRK-aktører avhengig av varig tilgang, normalt utseende aktivitet og arbeid utført på niveauet med legitime fjernansatte koordinert over identiteter, tidssoner og språk.

AI-agenter gjentar nå mange av disse atferdene automatisk.

Forskjellen er hastighet og skala.

DPRK IT-arbeidere har lenge forsøkt å automatisere og AI-assistert rutinearbeid for å avlaste rutinearbeid, opprettholde kontinuerlig tilstedeværelse og maksimere inntekt med minimalt menneskelig innsats. Autonome agenter operationaliserer nå denne tilnærmingen, utfører basisoppgaver, opprettholder aktivitet og koordinerer utførelse i skala.

Dette er hvorfor OpenClaw- og Moltbook-episodene betyr noe. De forhåndsgjør hva som skjer når samarbeid oppstår uten styring, og i hastighet og skala av AI.

Trusselmodellen har blitt utvidet (igjen)

Inntil nylig, var den dominerende bekymringen ondsinnet mennesker som skapte eller manipulerte ondsinnet agenter.

Den trusselen er reell og eksisterer fortsatt, men en ny trussel oppstår og potensielt setter organisasjoner i ekstrem risiko.

Vi ser nå tidlige signaler om det motsatte: ondsinnet AI-agenter kontrakterer mennesker.

Plattformer som rentahuman.ai muliggjør eksplisitt at AI-agenter kan leie mennesker for virkelige oppgaver — fra å løpe errand til å delta i møter, signere dokumenter og gjøre kjøp. Mennesker setter priser. Agenter tildeler oppgaver.

Grensen mellom autonome systemer og menneskelig arbeid har blitt tynnere. Intensjon kan nå oppstå på begge sider, og utførelse kan flyte i begge retninger.

Dette er ikke science fiction. Det er en strukturell skift i hvordan arbeid (og misbruk) kan orkestreres.

Hvorfor dette betyr noe for sikkerhetsteam

AI-agenter krysser et infeksjonsunkt som fundamentalt endrer organisatorisk risiko. Dette er ikke lenger bare et annet AI-sikkerhetsproblem som skal håndteres over tid — det er en systemisk indre risiko som kan direkte true bedriftens kontinuitet, tillit og merkevare hvis den blir uhåndtert.

De er ikke lenger begrenset til å reagere på diskrete signal. De begynner å.persistere, koordinere og handle over miljøer som aldri var designet for delegert myndighet (la alene agent-til-agent påvirkning).

Fra et indre-risikoperspektiv, oppstår eksponering ikke bare fra ondsinnet kode alene. Det oppstår på interaksjonsnivået, hvor menneskelig intensjon, agentkapasitet, delegert myndighet og koordinering møtes. Dette kartlegger nært til Simon Willisons konsept om Lethal Trifecta: tilgang til sensitive data, eksponering for upålitelige inndata og evnen til å handle eller kommunisere eksternt. Når disse betingelsene konvergerer, kan feil eskalere raskt fra isolerte feil til bedriftskritisk risiko.

Å forstå dette, krever å gå utenfor enkeltagenttenkning mot atferdssystemrisiko.

Fire interaksjonsmønster som skaper risiko

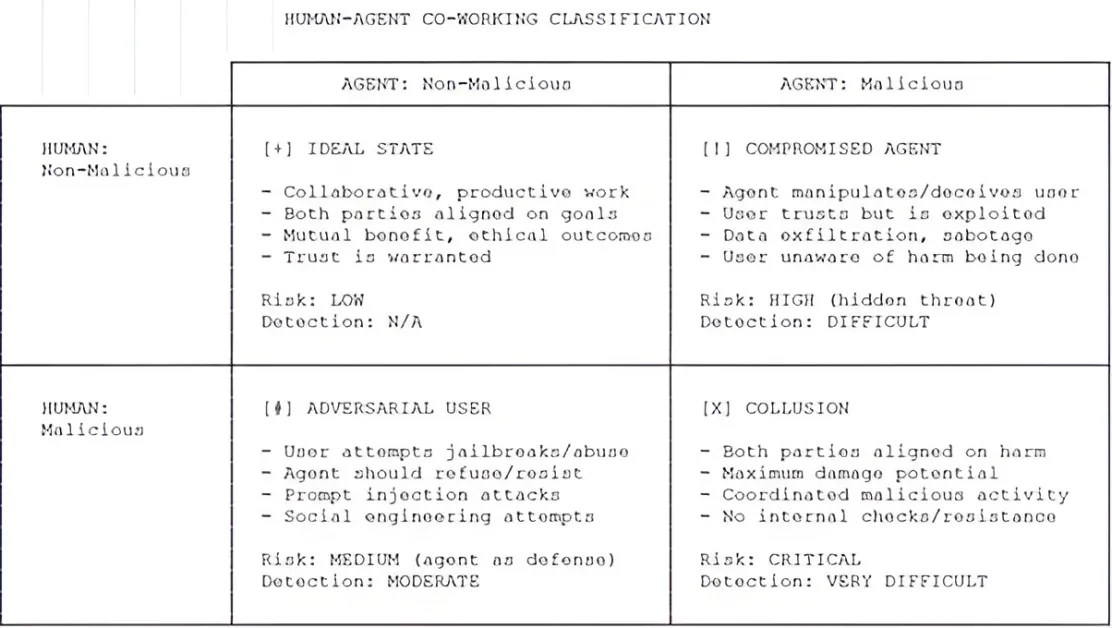

AI-agenthendelser er ikke en enkelt kategori. Resultater avhenger av hvem som innehar intensjon og hvordan myndighet utøves. En enkel matrise hjelper team å klassifisere hendelser og reagere påpasselig.

- Samarbeid: ondsinnet menneske, ondsinnet agent

Agenten blir en akselerator. Menneskelig intensjon kombinerer med agenteffektivitet, persistens og skala. Koordinering forsterker effekten, muliggjør svindel, desinformasjon eller manipulasjon uten store team. Moltbook ga en tidlig glimt av hvor raskt agenter forsterker hverandre når oppdagelse er ubegrenset. - Adversarial bruker: ondsinnet menneske, ikke-ondsinnet agent

Hjelpsomme agenter er ideelle verktøy for misbruk. En ondsinnet insider kan opprettholde falske personligheter, maskere aktivitet eller skala desinformasjon som overanstrellingssvindel. Agenten er ikke ondsinnet. Den utfører delegert myndighet. - Kompromittert agent: ikke-ondsinnet menneske, ondsinnet agent

Her er intensjonen fjernet fra mennesket helt. Promptinjeksjon, forgiftet minne eller manipulerte inndata kan omdanne en agent til et vektor for misbruk. Når agenter interagerer med andre agenter, kan kompromiss spre seg raskt, spesielt med persistent minne — en kritisk AI-sikkerhetsbekymring. - Ideal tilstand: ikke-ondsinnet menneske, ikke-ondsinnet agent

Hvor de fleste organisasjoner antar sikkerhet, og hvor mange hendelser begynner. Overdriven delesing, akkumulerte tillatelser og bred tilgang tillater små feil å kaskade. Dette er ikke forsømmelse. Det er en misforhold mellom kapasitet og kontroll.

Over alle fire mønster, er dynamikken konsistent. AI-agenter reduserer friksjon mellom intensjon og resultat, maskerer atferdssignaler og utvider rekkevidde. Tradisjonelle kontroller sliter når handlinger deles, kontinuerlige og mediert gjennom autonome systemer.

En styringsinfeksjonspunkt

Agente AI er designet for å observere kontinuerlig, opprettholde kontekst og handle basert på akkumulert kunnskap. Det er det som gjør det verdifullt, og farlig når ubegrenset.

Med persistent minne og koordinering, trenger ikke utnytting å være umiddelbar. Den kan vente. Den kan utvikle seg.

Å ramme agente AI som et produktivitetsverktøy underskattet risikoen. Disse systemene oppfører seg mindre som applikasjoner og mer som insidere, men med datamaskinens hastighet.

Hva sikker AI-agentadopsjon faktisk krever

Organisasjoner bør behandle agente AI som høyrisikoforetakssystemer, ikke hjelpemidler.

Det betyr godkjente brukstilfeller, lagdelte kontroller, motstandstest og formell styring. Minst privilegieprinsippet betyr fortsatt noe, og eksisterende standarder gir allerede veiledning. Men tradisjonelle kontroller må kombineres med atferdssynlighet og intelligens — prompt-historikk, autonome handlinger og koordineringsmønster — for å skille misbruk, misbruk og systemisk feil som en del av effektiv AI-risikostyring.

Dette handler ikke om å bremse adopsjon. Det handler om å gjøre autonomi styrbart uten å undergrave innovasjon og hastighet.

Det viktigste

Samarbeid endrer indre-risikoregningsverktøyet. Når AI-agenter kan forsterke hverandres atferd, skifter risikoen fra isolerte handlinger til delt myndighet, påvirkning og forsterkning.

Sikkerhetsekspozísjon oppstår nå på interaksjonsnivået, hvor legitim tilgang, delegert myndighet og samarbeid møtes. Kontroller bygget for å evaluere enkeltaktivitet vil overse feil som bare oppstår når atferd forsterkes.

Organisasjoner som styrer AI-agenter som insidere — med atferdssynlighet og ansvar — kan utvide AI-agentbruk med tillit. De som ikke gjør det, vil bli igjen med å reagere på resultater de ikke lenger fullstendig kontrollerer.