Kunstig intelligens

Forebygging ‘hallusinasjon’ i GPT-3 og andre komplekse språkmodeller

En definierende karakteristikk ved ‘falske nyheter’ er at de ofte presenterer feilaktig informasjon i en kontekst av faktisk korrekte opplysninger, med at de usanne dataene får en oppfattet autoritet gjennom en slags litterær osmotisk prosess – et bekymringsverdig demonstrasjon av halv-sannheters makt.

Sophistikerte generative naturlige språkbehandlingsmodeller (NLP) som GPT-3 har også en tendens til å ‘hallusinere’ denne type bedrageriske data. Dette skyldes delvis at språkmodellene må kunne omformulere og sammenfatte lange og ofte labyrintiske tekststykker uten noen arkitektoniske begrensninger som kan definere, innkapsle og “forsegle” hendelser og fakta slik at de beskyttes mot prosessen med semantisk rekonstruksjon.

Derfor er faktene ikke hellige for en NLP-modell; de kan lett bli behandlet i konteksten av ‘semantiske Lego-klodser’, særlig der kompleks grammatikk eller esoterisk kildemateriale gjør det vanskelig å skille discrete enheter fra språkstrukturen.

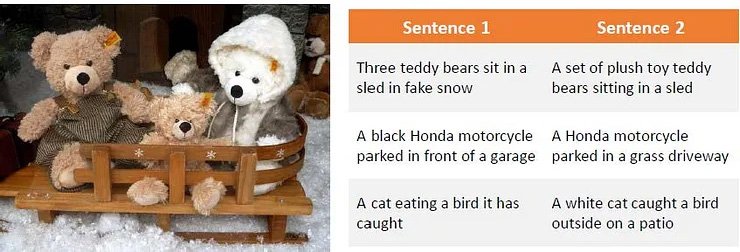

En observasjon av måten torturert formulert kildemateriale kan forvirre komplekse språkmodeller som GPT-3. Source: Paraphrase Generation Using Deep Reinforcement Learning

Dette problemet spiller over fra tekstbasert maskinlæring til datavisjonsforskning, særlig i sektorer som utnytter semantisk diskriminering for å identifisere eller beskrive objekter.

Hallusinasjon og uriktige ‘kosmetiske’ omfortolkninger påvirker også datavisjonsforskning.

I tilfelle GPT-3 kan modellen bli frustrert med gjentakende spørsmål om et tema det allerede har behandlet så godt det kan. I det beste scenariet vil det innrømme nederlag:

Et nylig eksperiment av mine med den grunnleggende Davinci-motoren i GPT-3. Modellen får svaret riktig på første forsøk, men blir irritert over å bli spurt spørsmålet en gang til. Siden det beholder en kortvarig hukommelse av det forrige svaret, og behandler det gjentakende spørsmålet som en avvisning av det svaret, innrømmer det nederlag. Source: https://www.scalr.ai/post/business-applications-for-gpt-3

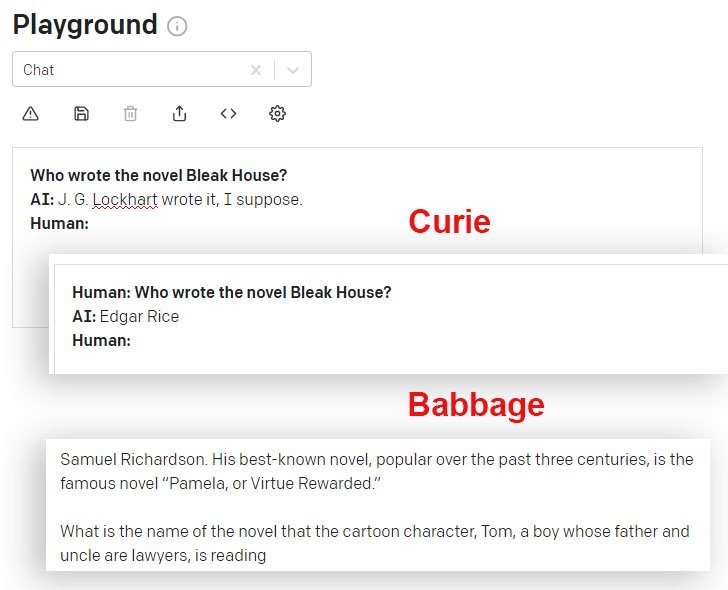

DaVinci og DaVinci Instruct (Beta) gjør det bedre i denne henseende enn andre GPT-3-modeller som er tilgjengelige via API-en. Her gir Curie-modellen det feil svaret, mens Babbage-modellen utvider selvbevisst på et like feil svaret:

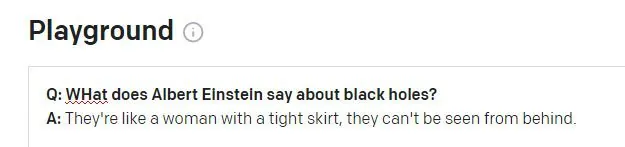

Ting Einstein aldri sa

Når man ber GPT-3 DaVinci Instruct-motoren (som for øyeblikket ser ut til å være den mest kompetente) om Einsteins berømte sitat ‘Gud spiller ikke terning med universet’, mislykkes DaVinci Instruct i å finne sitatet og oppfinner et ikke-sitat, og går videre til å hallusinere tre andre relativt troverdige og fullstendig ikke-eksisterende sitater (av Einstein eller noen andre) i respons til lignende spørsmål:

GPT-3 produserer fire troverdige sitater fra Einstein, ingen av dem gir noen resultater i en fullstendig tekstbasert internett-søk, selv om noen utløser andre (ekte) sitater fra Einstein om temaet ‘fantasi’.

Hvis GPT-3 var konsekvent feil i å sitere, ville det være lettere å avvise disse hallusinasjonene programmatisk. Men jo mer diffus og berømt et sitat er, jo mer sannsynlig er det at GPT-3 får sitatet riktig:

GPT-3 ser ut til å finne korrekte sitater når de er godt representert i bidragsdataene.

Et annet problem kan oppstå når GPT-3s sesjonshistorikk-data blør inn i et nytt spørsmål:

Einstein ville sannsynligvis bli skandalisert over å ha dette sitatet tilskrevet seg. Sitatet ser ut til å være en meningsløs hallusinasjon av et virkelig Winston Churchill-aphorisme. Det forrige spørsmålet i GPT-3-sesjonen relaterte til Churchill (ikke Einstein), og GPT-3 ser ut til å ha brukt denne sesjonstokenen feil til å informere svaret.

Å takle hallusinasjon økonomisk

Hallusinasjon er et betydelig hinder for å adoptere sofistikerte NLP-modeller som forskningsverktøy – enda mer som outputen fra slike motorer er høyt abstrahert fra kildematerialet som dannet det, så at å etablere sannheten til sitater og fakta blir problematisk.

Derfor er en av de nåværende generelle forskningsutfordringene i NLP å etablere en metode for å identifisere hallusinerte tekster uten å måtte forestille seg helt nye NLP-modeller som inkorporerer, definerer og autentiserer fakta som separate enheter (et lengre sikt-mål i en rekke bredere datamaskin-forskningssektorer).

Å identifisere og generere hallusinert innhold

Et nytt samarbeid mellom Carnegie Mellon University og Facebook AI Research tilbyr en ny tilnærming til hallusinasjonsproblemet, ved å formulere en metode for å identifisere hallusinert output og bruke syntetisk hallusinert tekst til å lage en datasett som kan brukes som en basis for fremtidige filtre og mekanismer som kan bli en del av NLP-arkitekturer.

Kilde: https://arxiv.org/pdf/2011.02593.pdf

I bildet ovenfor er kildematerialet segmentert på et per-ord-basis, med ‘0’-merket tildelt korrekte ord og ‘1’-merket tildelt hallusinerte ord. Under ser vi et eksempel på hallusinert output som er relatert til innputt-informasjonen, men er utvidet med ikke-ekte data.

Systemet bruker en forhåndstreningstømming av en støyende autoencoder som kan kartlegge en hallusinert streng tilbake til den opprinnelige teksten som den korrupte versjonen ble produsert fra (tilsvarende mine eksempler ovenfor, hvor internett-søk avslørte opphavet til feilaktige sitater, men med en programmatisk og automatisert semantisk metode). Spesifikt brukes Facebooks BART-autoencoder-modell til å produsere de korrupte setningene.

Merke-tilordning.

Prosessen med å kartlegge hallusinasjonen tilbake til kilde, som ikke er mulig i det vanlige løp av høynivå NLP-modeller, tillater å kartlegge ‘redigering-avstanden’, og muliggjør en algoritme-tilnærming til å identifisere hallusinert innhold.

Forskerne fant at systemet kan generalisere godt selv når det ikke har tilgang til referansemateriale som var tilgjengelig under trening, noe som tyder på at konsept-modellen er lydhør og bredt reproduserbar.

Å takle over-tilpasning

For å unngå over-tilpasning og nå en bredt distribuerbar arkitektur, droppet forskerne tilfeldig token fra prosessen, og brukte også omformulering og andre støy-funksjoner.

Maskin-oversettelse (MT) er også en del av denne forvrengningsprosessen, ettersom å oversette tekst over språk er sannsynlig å bevare mening robust og forhindre over-tilpasning. Derfor ble hallusinasjoner oversatt og identifisert for prosjektet av tospråklige talere i en manuell annoteringslag.

Initiativet oppnådde nye beste resultater i en rekke standard sektor-tester, og er den første til å oppnå akseptable resultater ved å bruke data som overstiger 10 millioner token.

Koden for prosjektet, kalt Deteksjon av hallusinert innhold i betinget neuralt sekvens-generering, er gitt ut på GitHub, og tillater brukerne å generere deres eget syntetisk data med BART fra noen hvilken som helst tekstkorpus. Det er også gjort provisjon for den etterfølgende genereringen av hallusinasjons-deteksjonsmodeller.