Kunstig intelligens

Hvordan AI gjør tegnspråksgjenkjenning mer presis enn noen gang

Når vi tenker på å bryte ned kommunikasjonsbarrierer, fokuserer vi ofte på språkoversettelsesapper eller taleassistenter. Men for millioner som bruker tegnspråk, har disse verktøyene ikke helt brotaket gapet. Tegnspråk er ikke bare om håndbevegelser – det er en rik, kompleks form for kommunikasjon som inkluderer ansiktsuttrykk og kroppsspråk, hvor hvert element bærer viktig mening.

Her er hva som gjør dette spesielt utfordrende: i motsetning til tale språk, som hovedsakelig varierer i vokabular og grammatikk, varierer tegnspråk verden over fundamentalt i hvordan de overfører mening. Amerikansk tegnspråk (ASL), for eksempel, har sin egen unike grammatikk og syntaks som ikke matcher tale engelsk.

Denne kompleksiteten betyr at å lage teknologi for å gjenkjenne og oversette tegnspråk i sanntid krever en forståelse av et helt språksystem i bevegelse.

En ny tilnærming til gjenkjenning

Dette er der et team ved Florida Atlantic Universitys (FAU) College of Engineering and Computer Science bestemte seg for å ta en fersk tilnærming. I stedet for å forsøke å takle hele kompleksiteten av tegnspråk på en gang, fokuserte de på å mestre en kritisk første steg: å gjenkjenne ASL-alfabetgest med utenforliggende nøyaktighet gjennom AI.

Tenk på det som å lære en datamaskin å lese håndskrift, men i tre dimensjoner og i bevegelse. Teamet bygde noe bemerkelsesverdig: en datasett på 29 820 statiske bilder som viser ASL-håndgest. Men de samlet ikke bare bilder. De merket hver bilde med 21 nøkkel punkt på hånden, og lagde en detaljert kart over hvordan hender beveger seg og danner forskjellige tegn.

Dr. Bader Alsharif, som ledet denne forskningen som en Ph.D.-kandidat, forklarer: “Denne metoden har ikke vært utforsket i tidligere forskning, og det er en ny og løftende retning for fremtidige fremgang.”

Å bryte ned teknologien

La oss dykke ned i kombinasjonen av teknologier som gjør dette tegnspråksgjenkjenningssystemet fungere.

MediaPipe og YOLOv8

Magien skjer gjennom den sømløse integreringen av to kraftfulle verktøy: MediaPipe og YOLOv8. Tenk på MediaPipe som en ekspert hånd-observerer – en dyktig tegnspråktolker som kan spore hver subtil fingerbevegelse og håndposisjon. Forsknings teamet valgte MediaPipe spesielt for dens usedvanlige evne til å gi nøyaktig hånd-landmerke-sporing, og identifisere 21 presise punkt på hver hånd, som vi nevnte ovenfor.

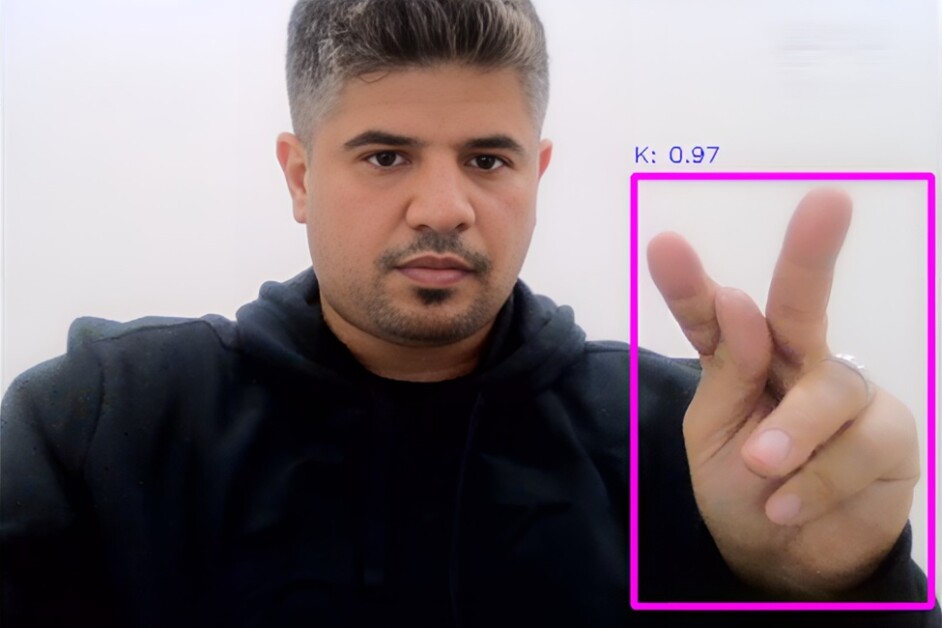

Men sporing er ikke nok – vi må forstå hva disse bevegelsene betyr. Det er der YOLOv8 kommer inn. YOLOv8 er en mønster-gjenkjenningsekspert, som tar alle disse sporede punktene og finner ut hva de representerer. Forskningen viser at når YOLOv8 prosesserer et bilde, deler det det inn i en S × S-rute, hvor hver rute celle er ansvarlig for å detektere objekter (i dette tilfelle, håndgest) innenfor sine grenser.

Alsharif et al., Franklin Open (2024)

Hvordan systemet faktisk fungerer

Prosessen er mer sofistikert enn det kan se ut på første blikk.

Her er hva som skjer bak kulissene:

Hånd-detteksjonsstadiet

Når du lager et tegn, identifiserer MediaPipe først hånden din i rammen og kartlegger de 21 nøkkel punktene. Disse er ikke bare tilfeldige punkt – de korresponderer med bestemte ledd og landemerker på hånden, fra fingertupper til håndflate.

Romlig analyse

YOLOv8 tar deretter denne informasjonen og analyserer den i sanntid. For hver rute celle i bildet, forutsier det:

- Sannsynligheten for at en håndgest er til stede

- De presise koordinatene for gestens plassering

- En konfidensscore for dens prediksjon

Klassifisering

Systemet bruker noe som kalles “bounding box-prediksjon” – tenk på å tegne en perfekt rektangel rundt håndgesten din. YOLOv8 beregner fem kritiske verdier for hver boks: x- og y-koordinater for sentrum, bredde, høyde og en konfidensscore.

Alsharif et al., Franklin Open (2024)

Hvorfor denne kombinasjonen fungerer så bra

Forsknings teamet oppdaget at ved å kombinere disse teknologiene, skapte de noe større enn summen av delene. MediaPipes presise sporing kombinert med YOLOv8s avanserte objektdeteksjon produserte merkelig nøyaktige resultater – vi snakker om en 98% presisjonsrate og en 99% F1-score.

Hva gjør dette spesielt imponerende er hvordan systemet håndterer kompleksiteten av tegnspråk. Noen tegn kan se veldig like ut for uerfarne øyne, men systemet kan spore små forskjeller.

Rekord- resultater

Når forskere utvikler ny teknologi, er den store spørsmålet alltid: “Hvordan fungerer det faktisk?” For dette tegnspråksgjenkjenningssystemet er resultatene imponerende.

Teamet ved FAU utsatte systemet for omfattende testing, og her er hva de fant:

- Systemet korrekt identifiserer tegn 98% av tiden

- Det fanger 98% av alle tegn som gjøres foran det

- Totalt prestasjonspoeng når en imponerende 99%

“Resultater fra vår forskning demonstrerer modellens evne til å nøyaktig detektere og klassifisere amerikansk tegnspråk-gestre med svært få feil,” forklarer Alsharif.

Systemet fungerer godt i hverdags situasjoner – forskjellig belysning, forskjellige håndposisjoner og sogar med forskjellige mennesker som tegner.

Dette gjennombruddet skyver grensene for hva som er mulig i tegnspråksgjenkjenning. Tidligere systemer har kjempet med nøyaktighet, men ved å kombinere MediaPipes håndsporing med YOLOv8s detekteringsmuligheter, skapte forskningsteamet noe spesielt.

“Suksessen til denne modellen er i stor grad takket være den omsorgsfulle integreringen av overføringslæring, omhyggelig datasett-oppbygging og presis justering,” sier Mohammad Ilyas, en av studiens medforfattere. Denne oppmerksomheten til detaljer betalte seg i systemets merkelige ytelse.

Hva dette betyr for kommunikasjon

Suksessen til dette systemet åpner opp spennende muligheter for å gjøre kommunikasjon mer tilgjengelig og inkluderende.

Teamet stopper ikke ved å bare gjenkjenne bokstaver. Den neste store utfordringen er å lære systemet å forstå en enda bredere rekke håndformer og gest. Tenk på de øyeblikkene når tegn ser nesten identiske ut – som bokstavene ‘M’ og ‘N’ i tegnspråk. Forskerne arbeider for å hjelpe systemet med å fange disse små forskjellene enda bedre. Som Dr. Alsharif sier: “Viktig, funn fra denne studien understreker ikke bare robustheten til systemet, men også dens potensiale til å bli brukt i praktiske, sanntidsapplikasjoner.”

Teamet fokuserer nå på:

- Å få systemet til å fungere smidig på vanlige enheter

- Å gjøre det raskt nok for sanntids samtaler

- Å sikre at det fungerer pålitelig i enhver miljø

Dekan Stella Batalama fra FAU’s College of Engineering and Computer Science deler den større visjonen: “Ved å forbedre amerikansk tegnspråk-gjenkjenning, bidrar dette arbeidet til å skape verktøy som kan forbedre kommunikasjon for døve og hørselshemmede samfunnet.”

Tenk på å gå inn i en legekontor eller å delta i en klasse hvor denne teknologien broer kommunikasjonsgapet umiddelbart. Det er det virkelige målet her – å skape teknologi som faktisk hjelper mennesker å koble til. Uansett om det er i utdanning, helsevesen eller hverdags samtaler, representerer dette systemet et skritt mot en verden hvor kommunikasjonsbarrierer blir mindre og mindre.