Kunstig intelligens

MIT: Måling av mediabias i større nyhetskilder med maskinlæring

En studie fra MIT har brukt maskinlæringsteknikker til å identifisere partiske formuleringer i omtrent 100 av de største og mest innflytelsesrike nyhetskildene i USA og ellers, inkludert 83 av de mest innflytelsesrike trykte nyhetspublikasjonene. Dette er et forskningsprosjekt som viser veien mot automatiserte systemer som potensielt kan auto-klassifisere den politiske karakteren til en publikasjon, og gi lesere en dypere innsikt i den etiske holdningen til en kanal på temaer de kan føle sterkt om.

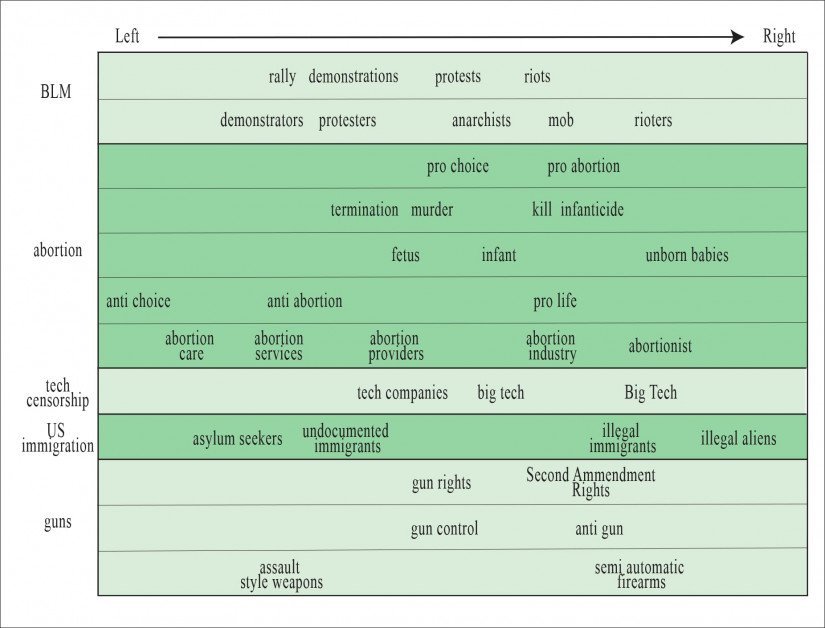

Arbeidet handler om hvordan temaer behandles med bestemte formuleringer, som f.eks. ulegal innvandrer | ulovlig innvandrer, foster | ufødt barn, demonstranter | anarkister.

Prosjektet brukte Natural Language Processing (NLP) teknikk til å trekke ut og klassifisere slike eksempler på ‘ladede’ språk (med antagelsen at tilsynelatende mer ‘nøytrale’ termer også representerer en politisk holdning) inn i en bred kartlegging som avslører venstre- og høyre-vennlig bias over mer enn tre millioner artikler fra omtrent 100 nyhetskilder, med resultat i en navigerbar bias-landskap av publikasjonene i question.

Den artikkelen kommer fra Samantha D’Alonzo og Max Tegmark ved MIT’s fysikkavdeling, og observerer at en rekke nylige initiativer rundt ‘fakta-sjekking’, i kjølvannet av tallrike ‘falske nyheter’-skandaler, kan tolkes som uærlige og som tjener interessene til bestemte grupper. Prosjektet er ment å gi en mer data-drevet tilnærming til å studere bruken av bias og ‘påvirkning’ språk i et såkalt nøytralt nyhetskontekst.

Et spekter av (bokstavelig talt) venstre-til-høyre-fraser, som er avledet fra studien. Kilde: https://arxiv.org/pdf/2109.00024.pdf

NLP-behandling

Kilde-dataene fra studien ble hentet fra den åpne kilde Newspaper3K-databasen, og bestod av 3 078 624 artikler hentet fra 100 medienyhetskilder, inkludert 83 aviser. Avisene ble valgt ut ifølge deres rekkevidde, mens nettmediekilder også inkluderte artikler fra militær nyhetsanalyse-siden Defense One og Science.

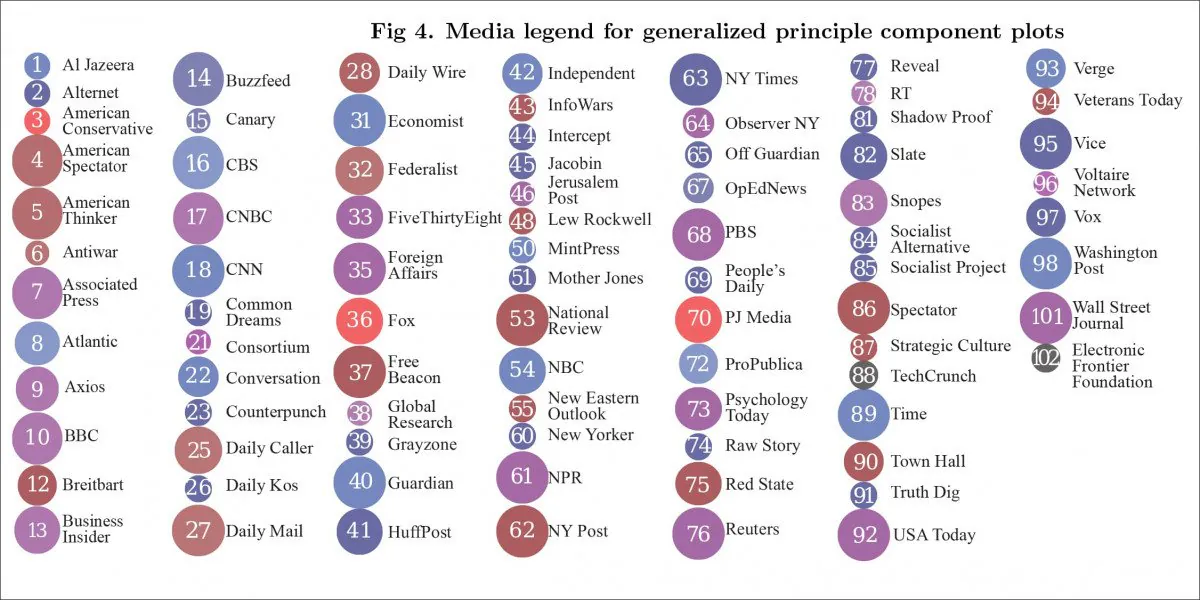

Kildene som ble brukt i studien.

Artikkelen rapporterer at den lastede teksten ble ‘minimalt’ forbehandlet. Direkte sitater ble eliminert, ettersom studien er interessert i språket valgt av journalistene (selv om sitatvalg i seg selv er et interessant felt for studier).

Britiske stavinger ble endret til amerikanske for å standardisere databasen, all punktum fjernet, og alle unntatt ordinaltall også fjernet. Initial setning stor bokstav ble konvertert til liten bokstav, men alle andre stor bokstaver beholdt.

De første 100 000 mest vanlige frasene ble identifisert, og til slutt rangert, renset og slått sammen i en fraselist. All redundante språk som kunne identifiseres (som ‘Del denne artikkelen’ og ‘artikkel gjenpublisert’) ble likvidert. Variasjoner over i hovedsak identiske fraser (f.eks. ‘stor teknologi’ og ‘Stor Teknologi’, ‘cybersikkerhet’ og ‘cyber sikkerhet’) ble standardisert.

‘Nøtteplukking’

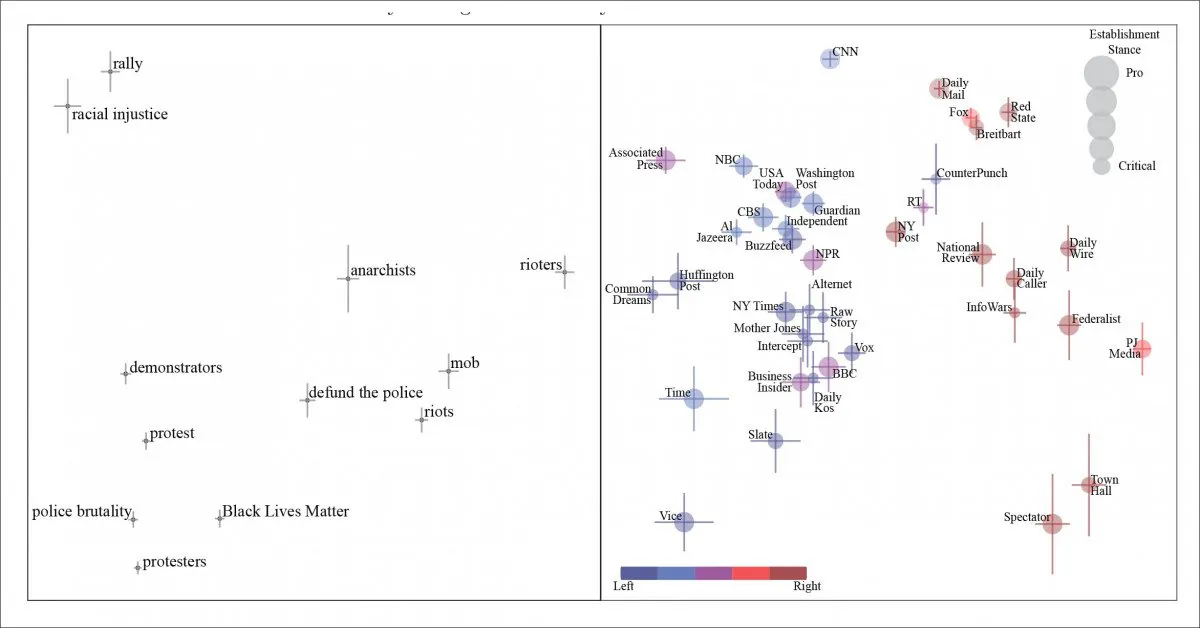

Den første testen var på tema ‘Black lives matter’, og kunne skille frase-bias og valent synonymer over dataene.

Generaliserte prinsipper for artikler om Black Lives Matter (BLM). Vi ser mennesker som deltar i sivile aksjoner karakterisert, både bokstavelig og figurativt, fra venstre til høyre, som demonstranter, anarkister og, på den høyre ende av spekteret, som ‘opløsningsagitatorer’. Avisene som opprinnelig skrev frasene er representert i høyre panel.

Mens ‘protestere’ går over fra ‘anarkister’ til ‘opløsningsagitatorer’ når vi skyver langs den politiske holdningen til kanalen i question, noterer artikkelen at NLP-uttrekk og analyseholdningen hindres av praksisen ‘nøtteplukking’ – hvor en mediekilde vil sitere en frase som anses som gyldig av en annen politisk sektor av samfunnet, og kan (apparat) stole på at dens lesere vil se frasen negativt. Artikkelen nevner ‘defund the police’ som et eksempel på dette.

Naturligvis betyr dette at en ‘venstre-vennlig’ frase opptrer i en ellers høyre-vennlig kontekst, og representerer en uvanlig utfordring for et NLP-system som avhenger av kodifiserte fraser for å fungere som tegn på politiske holdninger.

Slike fraser er ‘bi-valente’ [SIC], mens visse andre fraser har en så universelt negativ konnotasjon (f.eks. ‘barne-dråp’) at de alltid representeres som negative over en rekke kanaler.

Forskningen avslører også lignende kartlegginger for ‘hete’ temaer som abort, teknologiensensur, USAs innvandring og våpenkontroll.

Hobbyhest

Det finnes visse kontroversielle politiske holdninger i mediekilder som ikke deler seg på forutsigbar måte, som temaet om militærutgifter. Artikkelen fant ut at ‘venstre-vennlig’ CNN endte opp ved siden av høyre-vennlig National Review og Fox News på dette temaet.

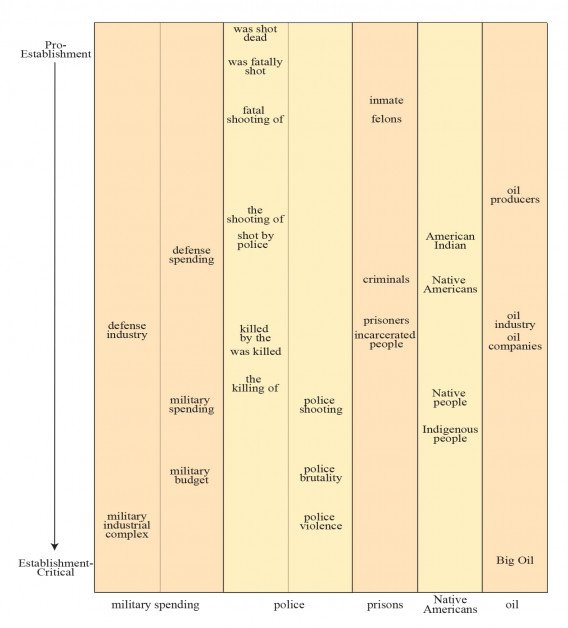

Generelt sett kan imidlertid politisk holdning bestemmes av andre fraser, som å foretrekke frasen ‘militær-industriell kompleks’ over den mer høyre-vennlige ‘forsvarsindustrien’. Resultatene viser at den førstnevnte brukes av etablissements-kritiske kanaler som Canary og Amerikansk Konservativ, mens den sistnevnte brukes oftere av Fox og CNN.

Forskningen etablerer flere andre fremgangsmåter fra etablissements-kritisk til pro-etablissements språk, inkludert skalaen fra ‘skutt og drept’ til den mer passive ‘drapet av’; ‘fange-forbrytere’ til ‘innestengte mennesker’; og ‘olje-produsenter’ til ‘stor olje’.

Valent synonymer med etablissements-bias, topp til bunn.

Forskningen erkjenner at kanaler vil ‘svinge bort’ fra deres basis-politiske holdning, enten på et språklig nivå (som bruk av bi-valente fraser), eller av andre motiver. For eksempel har den venerable høyre-vennlige britiske publikasjonen The Spectator, etablert i 1828, ofte og fremtredende presentert venstre-vennlige tenke-biter som gnager mot den generelle politiske strømmen av innholdet, enten det er gjort av en følelse av upartisk rapportering eller for å periodevis flamme opp dens kjerne-lesere til trafikk-genererende kommentar-stormer, er en sak for gjetning – og ikke en enkel sak for et maskinlæringssystem som ser etter klare og konsistente token.

Disse spesielle ‘hobbyhestene’ og tvetydige bruk av ‘sjokkerende’ synspunkter blant enkelt-nyhetsorganisasjoner forvirrer litt den venstre-høyre-kartlegging som forskningen til slutt tilbyr, selv om den gir en bred indikasjon av politisk tilknytning.

Undertrykt betydning

Selv om den er datert 2. september og publisert ved slutten av august 2021, har artikkelen fått relativt liten oppmerksomhet. Dette kan delvis skyldes at kritisk forskning rettet mot hovedstrømsmedier er usannsynlig å bli entusiastisk mottatt av dem; men det kan også skyldes at forfatterne er nølende med å produsere klare og ubestemte grafiske fremstillinger som stratifiserer hvor innflytelsesrike og kraftfulle mediepublikasjoner står på ulike temaer, sammen med aggregerte verdier som indikerer hvor mye en publikasjon heller mot venstre eller høyre. I virkeligheten ser det ut til at forfatterne tar seg tid til å dæmpe den potensielle brannende effekten av resultater.

Liksom den omfattende publiserte data fra prosjektet viser frekvens-tellinger av hendelser av ord, men ser ut til å være anonymisert, noe som gjør det vanskelig å få et klart bilde av medie-bias over publikasjonene som ble studert. Uten å operasjonalisere prosjektet på noen måte, etterlater dette bare de valgte eksemplene presentert i artikkelen.

Senere studier av denne typen ville kanskje være mer nyttige hvis de også vurderte ikke bare fraseringen brukt for temaer, men om temaet ble dekket i det hele tatt, ettersom stille taler mye, og har i seg selv en distinkt politisk karakter som ofte taler mer enn bare budsjett-begrensninger eller andre praktiske faktorer som kan informere nyhets-valg.

Likevel ser MIT-studien ut til å være den største av sin type til dags dato, og kunne danne rammen for fremtidige klassifiseringssystemer, og selv sekundære teknologier som f.eks. nettleser-utvidelser som kunne varsle tilfeldige lesere om den politiske fargen til publikasjonen de nå leser.

Bobler, bias og motreaksjon

I tillegg må det vurdere om slike systemer ville forsterke en av de mest kontroversielle aspektene ved algoritme-basert anbefalingssystemer – tendensen til å lede en seer inn i miljøer hvor de aldri ser en motsatt eller utfordrende synspunkt, som sannsynligvis vil forsterke lesarens holdning på kjerne-temaer.

Hvorvidt eller ikke en slik innhold-boble er et ‘trygt miljø’, et hinder for intellektuell vekst, eller en beskyttelse mot delvis propaganda, er en verdi-dømming – en filosofisk sak som er vanskelig å nærme seg fra den mekaniske, statistiske standpunktet til maskinlæringssystemer.

Videre, like mye som MIT-studien har tatt seg tid til å la dataene definere resultater, er klassifiseringen av den politiske verdien til fraser uunngåelig også en type verdi-dømming, og en som ikke lett kan motstå evnen til språk til omkodifisere giftig eller kontroversielt innhold til nye fraser som ikke er i håndboken, forum-reglene eller trenings-databasen.

Hvis en slik kodifisering skulle bli innbygd i populære nett-systemer, ser det ut til at en pågående innsats til å kartlegge den etiske og politiske temperaturen til større nyhetskilder kunne utvikle seg til en kald krig mellom AI’s evne til å skille bias og forleggenes evne til å uttrykke sin holdning i en evoluerende idiom designet til å jevnt utpace maskinlæringens forståelse av semantikk.

14/09/21 – 1.41 GMT+2 – Endret ‘100 aviser’ til ‘100 nyhetskilder’

4:58pm – Rettet artikkelhenvisning til å inkludere Samantha D’Alonzo, og relaterte rettelser.