Kunstig intelligens

Mistral AI: Setter nye mål beyond Llama2 i det åpne kildekodemiljøet

Store språkmodeller (LLMs) har nylig kommet i rampelyset, takket være fremragende utføring av modeller som ChatGPT. Da Meta lanserte sine Llama-modeller, ble det vekket en fornyet interesse for åpne kildekodemodeller. Målet? Å skape rimelige, åpne kildekodemodeller som er like gode som toppmodeller som GPT-4, men uten den høye prislappen eller kompleksiteten.

Denne blandingen av rimelighet og effisiens åpnet ikke bare opp nye veier for forskere og utviklere, men satte også scenen for en ny æra av teknologiske fremgang i naturlig språkbehandling.

Nylig har generative AI-startups hatt en økning i finansiering. Together samlet inn 20 millioner dollar, med mål om å forme åpen kildekode-AI. Anthropic samlet inn en imponerende 450 millioner dollar, og Cohere, i samarbeid med Google Cloud, sikret 270 millioner dollar i juni i år.

Introduksjon til Mistral 7B: Størrelse og tilgjengelighet

Mistral AI, basert i Paris og medgrunnlagt av tidligere ansatte fra Google’s DeepMind og Meta, annonserte sin første store språkmodell: Mistral 7B. Denne modellen kan enkelt lastes ned av hvem som helst fra GitHub og også via en 13,4-gigabyte torrent.

Dette startup lyktes å sikre rekordhøy seed-finansiering før de hadde et produkt ute. Mistral AI sin første modell med 7 milliarder parameter overgår ytelsen til Llama 2 13B i alle tester og slår Llama 1 34B i mange mål.

I sammenligning med andre modeller som Llama 2, tilbyr Mistral 7B lignende eller bedre evner, men med mindre beregningsmessig overhodet. Mens grunnleggende modeller som GPT-4 kan oppnå mer, kommer de til en høyere pris og er ikke like brukervennlige siden de hovedsakelig er tilgjengelige gjennom API-er.

Når det gjelder kodingsoppgaver, gir Mistral 7B CodeLlama 7B en kjør for pengene. Pluss, den er kompaktnog til å kjøre på standardmaskiner.

I tillegg har Mistral 7B Instruct, som er tilpasset spesifikt for instruksjonsdatasett på Hugging Face, vist stor ytelse. Den overgår andre 7B-modeller på MT-Bench og står skulder til skulder med 13B chat-modeller.

Hugging Face Mistral 7B Eksempel

Ytelsesbenchmarking

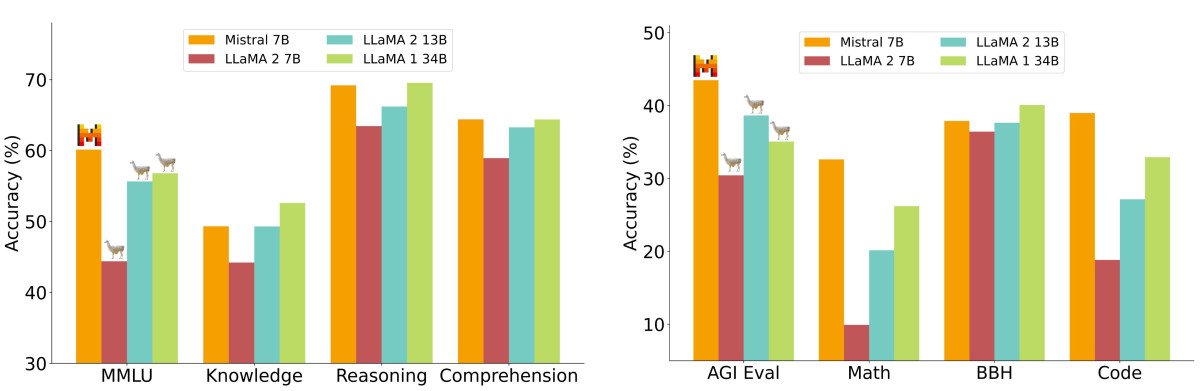

I en detaljert ytelsesanalyse ble Mistral 7B målt mot Llama 2-familien modeller. Resultatene var klare: Mistral 7B overgikk betydelig Llama 2 13B på alle benchmark. Faktisk, den matchet ytelsen til Llama 34B, spesielt i kode og resonneringstester.

Benchmarkene ble organisert i flere kategorier, som for eksempel Commonsense Reasoning, World Knowledge, Reading Comprehension, Math og Code, blant andre. En særlig verdifull observasjon var Mistral 7B sin kost-ytelsesmåling, betegnet som “ekvivalent modellstørrelse”. I områder som resonnering og forståelse, viste Mistral 7B en ytelse lik en Llama 2-modell tre ganger sin størrelse, hvilket indikerer potensielle besparelser i minne og en økning i gjennomstrømming. Imidlertid, i kunnskapsbenchmark, lignet Mistral 7B nært Llama 2 13B, hvilket sannsynligvis skyldes dens parameterbegrensninger som påvirker kunnskapskomprimering.

Hva gjør egentlig Mistral 7B-modellen bedre enn de fleste andre språkmodeller?

Forenkling av oppmerksomhetsmekanismer

Mens detaljene i oppmerksomhetsmekanismer er tekniske, er deres grunnleggende ide relativt enkel. Forestill deg å lese en bok og highlighte viktige setninger; dette er analogt med hvordan oppmerksomhetsmekanismer “highlighter” eller gir viktighet til bestemte datapunkter i en sekvens.

I sammenheng med språkmodeller, gjør disse mekanismene det mulig for modellen å fokusere på de mest relevante delene av inndata, og sikre at utdata er kohorent og kontekstuell korrekt.

I standard transformatorer beregnes oppmerksomhetsscorene med følgende formel:

Formelen for disse scorene inneholder en kritisk steg – matrisemultiplikasjon av Q og K. Utfordringen her er at når sekvenslengden øker, utvides begge matriser i henhold til, og det blir en beregningsmessig intens prosess. Dette skalerbarhetsproblemet er en av de viktigste grunnene til at standard transformatorer kan være langsomme, spesielt når det gjelder lange sekvenser.

Flervalgsoppmerksomhet (MQA) akselererer ting ved å bruke ett sett “nøkkel-verdi”-hoder, men ofrer noen ganger kvalitet. Nå, du kan lur på, hvorfor ikke kombinere hastigheten til MQA med kvaliteten til flervalgsoppmerksomhet? Det er der Gruppe-forespørselsoppmerksomhet (GQA) kommer inn.

Gruppe-forespørselsoppmerksomhet (GQA)

GQA er en midtpunkt-løsning. I stedet for å bruke bare ett eller flere “nøkkel-verdi”-hoder, grupperer den dem. På denne måten oppnår GQA en ytelse nær den detaljerte flervalgsoppmerksomheten, men med hastigheten til MQA. For modeller som Mistral, betyr dette effektiv ytelse uten å ofre for mye kvalitet.

Glidevinduoppmerksomhet (SWA)

Glidevinduet er en annen metode som brukes til å prosessere oppmerksomhetssekvenser. Denne metoden bruker et faststørrelse oppmerksomhetsvindu rundt hver token i sekvensen. Med flere lag som stablet denne vinduet-oppmerksomheten, får de øverste lagene til slutt en bredere perspektiv, som omfatter informasjon fra hele inndata. Denne mekanismen er analog til de respektive feltene som ses i Convolutional Neural Networks (CNNs).

På den andre siden, “dilatert glidevinduoppmerksomhet” i Longformer-modellen, som konseptuelt er lignende glidevindu-metoden, beregner bare noen diagonaler av matrisen. Denne endringen resulterer i at minnebruk øker lineært i stedet for kvadratisk, og gjør det til en mer effektiv metode for lengre sekvenser.

Mistral AI sin åpenhet vs. sikkerhetsbekymringer i desentralisering

I deres annonsering, betonet Mistral AI også åpenhet med uttalelsen: “Ingen triks, ingen proprietær data.” Men samtidig er deres eneste tilgjengelige modell for øyeblikket ‘Mistral-7B-v0.1’ en forhåndsrent base-modell, og derfor kan den generere en respons til enhver forespørsel uten moderering, hvilket raiser potensielle sikkerhetsbekymringer. Mens modeller som GPT og Llama har mekanismer for å bestemme når de skal svare, kan Mistral sin fullstendig desentraliserte natur utnyttes av dårlige aktører.

Imidlertid har desentraliseringen av store språkmodeller sine fortjener. Mens noen kan misbruke det, kan folk utnytte dens kraft for samfunnets beste og gjøre intelligensen tilgjengelig for alle.

Deploy-fleksibilitet

En av høydepunktene er at Mistral 7B er tilgjengelig under Apache 2.0-lisensen. Dette betyr at det ikke er noen reelle barrierer for å bruke det – enten du bruker det for personlige formål, et stort selskap eller selv en regjering. Du trenger bare riktig system for å kjøre det, eller du må kanskje investere i skytjenester.

Mens det finnes andre lisenser som den enklere MIT-lisensen og den kooperative CC BY-SA-4.0, som krever kreditt og lignende lisensiering for derivater, gir Apache 2.0 en solid grunnlag for store prosjekter.

Slutt-tanker

Oppblomstringen av åpne kildekodemodeller som Mistral 7B markerer en avgjørende skifte i AI-industrien, og gjør høykvalitets språkmodeller tilgjengelige for et bredere publikum. Mistral AI sin innovative tilnærming, som Gruppe-forespørselsoppmerksomhet og Glidevinduoppmerksomhet, lover effektiv ytelse uten å ofre for mye kvalitet.

Mens den desentraliserte naturen til Mistral stiller visse utfordringer, understreker dens fleksibilitet og åpen kildekodelisensiering potensialet for å demokratisere AI. Etterhvert som landskapet utvikler seg, vil fokuset uunngåelig være på å balansere kraften til disse modellene med etiske overveielser og sikkerhetsmekanismer.

Hva er neste skritt for Mistral? 7B-modellen var bare begynnelsen. Teamet planlegger å lansere enda større modeller snart. Hvis disse nye modellene matcher 7B sin ytelse, kan Mistral raskt stige som en toppspiller i industrien, allerede i deres første år.