Kunstig intelligens

Komplett guide til Gemma 2: Googles nye åpne store språkmodell

Gemma 2 bygger på sin forgjenger, og tilbyr forbedret ytelse og effisiens, sammen med en rekke innovative funksjoner som gjør den spesielt attraktiv for både forskning og praktiske anvendelser. Det som skiller Gemma 2 fra andre modeller er dens evne til å levere ytelse som er sammenlignbar med mye større proprietære modeller, men i en pakke som er designet for bredere tilgjengelighet og bruk på mer beskjedne maskinvareoppsett.

Da jeg dykket ned i de tekniske spesifikasjonene og arkitekturen til Gemma 2, ble jeg stadig mer imponert over designets ingeniøritet. Modellen inkorporerer flere avanserte tekniker, inkludert nye oppmerksomhetsmekanismer og innovative tilnærminger til treningstabilitet, som bidrar til dens bemerkelsesverdige evner.

I denne omfattende guiden, vil vi utforske Gemma 2 i dybden, og undersøke dens arkitektur, nøkkel funksjoner og praktiske anvendelser. Uansett om du er en erfaren AI-utøver eller en entusiastisk nykommer i feltet, har denne artikkelen som mål å gi verdifulle innsikter i hvordan Gemma 2 fungerer og hvordan du kan utnytte dens kraft i dine egne prosjekter.

Hva er Gemma 2?

Gemma 2 er Googles nyeste åpne språkmodell, designet for å være lettvekt og kraftfull. Den er bygget på samme forskning og teknologi som ble brukt til å skape Googles Gemini-modeller, og tilbyr toppkvalitet på ytelse i en mer tilgjengelig pakke. Gemma 2 kommer i to størrelser:

Gemma 2 9B: En 9 milliarder parametermodell

Gemma 2 27B: En større 27 milliarder parametermodell

Hver størrelse er tilgjengelig i to varianter:

Base-modeller: Forhåndstrengt på en enorm mengde tekstdata

Instruction-tuned (IT)-modeller: Feinjustert for bedre ytelse på bestemte oppgaver

Tilgang til modellene i Google AI Studio: Google AI Studio – Gemma 2

Les papiret her: Gemma 2 Teknisk Rapport

Nøkkel funksjoner og forbedringer

Gemma 2 introduserer flere betydelige forbedringer over sin forgjenger:

1. Økt treningdata

Modellene er trent på betydelig mer data:

Gemma 2 27B: Trenet på 13 billioner token

Gemma 2 9B: Trenet på 8 billioner token

Denne utvidede datasetten, hovedsakelig bestående av webdata (hovedsakelig engelsk), kode og matematikk, bidrar til modellens forbedrede ytelse og fleksibilitet.

2. Sliding Window Attention

Gemma 2 implementerer en ny tilnærmingsmetode for oppmerksomhetsmekanismer:

Hver andre lag bruker en sliding window-oppmerksomhet med en lokal kontekst på 4096 token

Alternativt lag anvender full kvadratisk global oppmerksomhet over hele 8192 token-konteksten

Denne hybride tilnærmingsmetoden har som mål å balansere effisiens med evnen til å fange lange avhengigheter i innputt.

3. Soft-Capping

For å forbedre treningstabilitet og ytelse, introduserer Gemma 2 en soft-capping-mekanisme:

def soft_cap(x, cap): return cap * torch.tanh(x / cap) # Applied to attention logits attention_logits = soft_cap(attention_logits, cap=50.0) # Applied to final layer logits final_logits = soft_cap(final_logits, cap=30.0)

Denne teknikken forhindrer at logits vokser for stor uten hard trunkering, og vedlikeholder mer informasjon samtidig som den stabiliserer treningprosessen.

- Gemma 2 9B: En 9 milliarder parametermodell

- Gemma 2 27B: En større 27 milliarder parametermodell

Hver størrelse er tilgjengelig i to varianter:

- Base-modeller: Forhåndstrengt på en enorm mengde tekstdata

- Instruction-tuned (IT)-modeller: Feinjustert for bedre ytelse på bestemte oppgaver

4. Knowledge Distillation

For 9B-modellen, anvender Gemma 2 kunnskapsdestillasjons-teknikker:

- Forhåndstrening: 9B-modellen lærer fra en større lærermodell under initialtrening

- Ettertrening: Begge 9B- og 27B-modellene anvender on-policy-destillasjon for å forfine sine prestasjoner

Denne prosessen hjelper den mindre modellen til å fange evnene til større modeller mer effektivt.

5. Model Merging

Gemma 2 anvender en ny modell-sammenslåings-teknikk kalt Warp, som kombinerer flere modeller i tre stadier:

- Exponential Moving Average (EMA) under forsterkning av fine-tuning

- Spherical Linear intERPolation (SLERP) etter fine-tuning av flere politikker

- Linear Interpolation Towards Initialization (LITI) som en siste steg

Denne tilnærmingsmetoden har som mål å skape en mer robust og kapabel slutmodell.

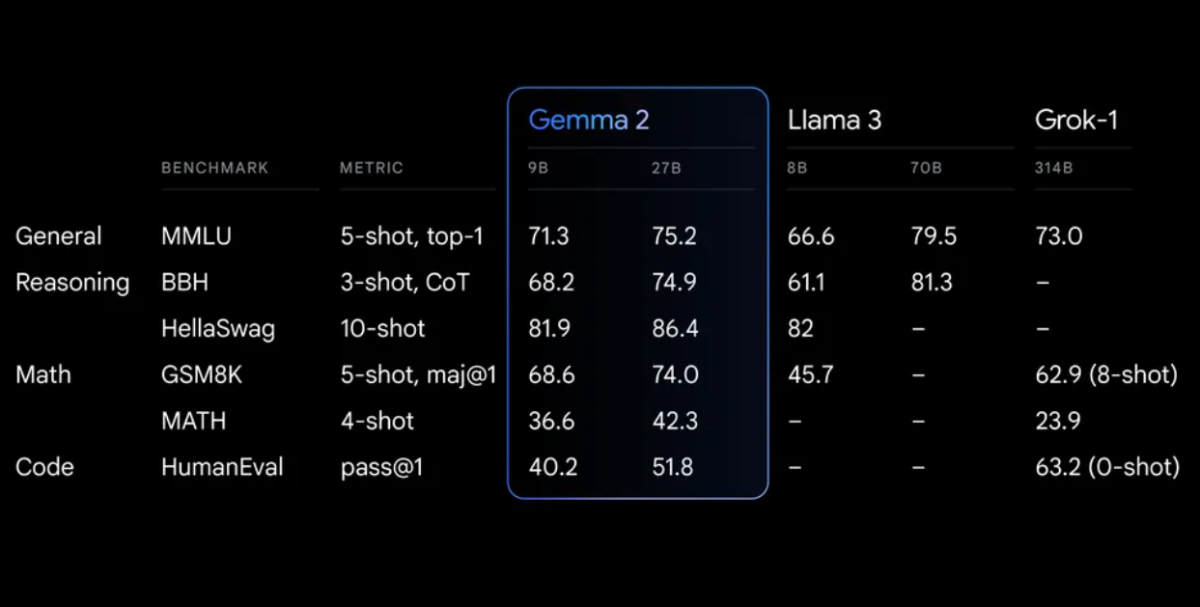

Ytelsesbenchmarks

Gemma 2 demonstrerer imponerende ytelse på ulike benchmarks:

Komme i gang med Gemma 2

For å begynne å bruke Gemma 2 i dine prosjekter, har du flere alternativer:

1. Google AI Studio

For rask eksperimentering uten krav til maskinvare, kan du tilgang Gemma 2 gjennom Google AI Studio.

2. Hugging Face Transformers

Gemma 2 er integrert med den populære Hugging Face Transformers-biblioteket. Her er hvordan du kan bruke det:

<div class="relative flex flex-col rounded-lg"> <div class="text-text-300 absolute pl-3 pt-2.5 text-xs"> from transformers import AutoTokenizer, AutoModelForCausalLM # Last inn modellen og tokenisatoren model_name = "google/gemma-2-27b-it" # eller "google/gemma-2-9b-it" for den mindre versjonen tokenizer = AutoTokenizer.from_pretrained(model_name) model = AutoModelForCausalLM.from_pretrained(model_name) # Forbered innputt prompt = "Forklar konseptet om kvantum-entanglement på enkel måte." inputs = tokenizer(prompt, return_tensors="pt") # Generer tekst outputs = model.generate(**inputs, max_length=200) response = tokenizer.decode(outputs[0], skip_special_tokens=True) print(response)

3. TensorFlow/Keras

For TensorFlow-brukere er Gemma 2 tilgjengelig gjennom Keras:

import tensorflow as tf

from keras_nlp.models import GemmaCausalLM

# Last inn modellen

model = GemmaCausalLM.from_preset("gemma_2b_en")

# Generer tekst

prompt = "Forklar konseptet om kvantum-entanglement på enkel måte."

output = model.generate(prompt, max_length=200)

print(output)

Avansert bruk: Bygging av en lokal RAG-system med Gemma 2

En kraftfull anvendelse av Gemma 2 er i bygging av et Retrieval Augmented Generation (RAG)-system. La oss skape et enkelt, fullstendig lokalt RAG-system som anvender Gemma 2 og Nomic-embeddings.

Steg 1: Setting opp miljøet

Først, sikre at du har de nødvendige bibliotekene installert:

pip install langchain ollama nomic chromadb

Steg 2: Indexering av dokumenter

Opprett en indexeringsklasse for å prosessere dine dokumenter:

import os

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain.document_loaders import DirectoryLoader

from langchain.vectorstores import Chroma

from langchain.embeddings import HuggingFaceEmbeddings

class Indexer:

def __init__(self, directory_path):

self.directory_path = directory_path

self.text_splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=200)

self.embeddings = HuggingFaceEmbeddings(model_name="nomic-ai/nomic-embed-text-v1")

def load_and_split_documents(self):

loader = DirectoryLoader(self.directory_path, glob="**/*.txt")

documents = loader.load()

return self.text_splitter.split_documents(documents)

def create_vector_store(self, documents):

return Chroma.from_documents(documents, self.embeddings, persist_directory="./chroma_db")

def index(self):

documents = self.load_and_split_documents()

vector_store = self.create_vector_store(documents)

vector_store.persist()

return vector_store

# Bruk

indexer = Indexer("path/to/your/documents")

vector_store = indexer.index()

Steg 3: Setting opp RAG-systemet

Nå, la oss skape RAG-systemet som anvender Gemma 2:

from langchain.llms import Ollama

from langchain.chains import RetrievalQA

from langchain.prompts import PromptTemplate

class RAGSystem:

def __init__(self, vector_store):

self.vector_store = vector_store

self.llm = Ollama(model="gemma2:9b")

self.retriever = self.vector_store.as_retriever(search_kwargs={"k": 3})

self.template = """Bruk følgende kontekst for å svare på spørsmålet i slutten.

Hvis du ikke vet svaret, bare si at du ikke vet, ikke prøv å finne på et svar.

{context}

Spørsmål: {question}

Svar: """

self.qa_prompt = PromptTemplate(

template=self.template, input_variables=["context", "question"]

)

self.qa_chain = RetrievalQA.from_chain_type(

llm=self.llm,

chain_type="stuff",

retriever=self.retriever,

return_source_documents=True,

chain_type_kwargs={"prompt": self.qa_prompt}

)

def query(self, question):

return self.qa_chain({"query": question})

# Bruk

rag_system = RAGSystem(vector_store)

response = rag_system.query("Hva er hovedstaden i Frankrike?")

print(response["result"])

Dette RAG-systemet anvender Gemma 2 gjennom Ollama for språkmodellen, og Nomic-embeddings for dokument-gjenfinning. Det lar deg stille spørsmål basert på indekserte dokumenter, og gir svar med kontekst fra relevante kilder.

Feinjustering av Gemma 2

For bestemte oppgaver eller domener, kan du ønske å feinjustere Gemma 2. Her er et enkelt eksempel som anvender Hugging Face Transformers-biblioteket:

from transformers import AutoTokenizer, AutoModelForCausalLM, TrainingArguments, Trainer

from datasets import load_dataset

# Last inn modellen og tokenisatoren

model_name = "google/gemma-2-9b-it"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(model_name)

# Forbered datasett

dataset = load_dataset("your_dataset")

def tokenize_function(examples):

return tokenizer(examples["text"], padding="max_length", truncation=True)

tokenized_datasets = dataset.map(tokenize_function, batched=True)

# Sett opp trening-argumenter

training_args = TrainingArguments(

output_dir="./results",

num_train_epochs=3,

per_device_train_batch_size=4,

per_device_eval_batch_size=4,

warmup_steps=500,

weight_decay=0.01,

logging_dir="./logs",

)

# Initialiser Trainer

trainer = Trainer(

model=model,

args=training_args,

train_dataset=tokenized_datasets["train"],

eval_dataset=tokenized_datasets["test"],

)

# Start feinjustering

trainer.train()

# Lagre den feinjusterte modellen

model.save_pretrained("./fine_tuned_gemma2")

tokenizer.save_pretrained("./fine_tuned_gemma2")

Husk å justere trening-parameterne basert på dine spesifikke krav og beregningsressurser.

Etiske overveielser og begrensninger

Selv om Gemma 2 tilbyr imponerende evner, er det viktig å være klar over dens begrensninger og etiske overveielser:

- Bias: Som alle språkmodeller, kan Gemma 2 reflektere bias som er til stede i dens treningdata. Vurder alltid kritisk utgangene.

- Faktisk nøyaktighet: Selv om Gemma 2 er svært kapabel, kan den noen ganger generere feil eller inkonsistente opplysninger. Verifiser viktige fakta fra pålitelige kilder.

- Kontekstlengde: Gemma 2 har en kontekstlengde på 8192 token. For lengre dokumenter eller samtaler, kan du trenge å implementere strategier for å håndtere konteksten effektivt.

- Beregningsressurser: Spesielt for 27B-modellen, kan betydelige beregningsressurser være nødvendige for effektiv inferens og feinjustering.

- Ansvarlig bruk: Hold deg til Googles ansvarlige AI-praksis og sikre at din bruk av Gemma 2 er i samsvar med etiske AI-prinsipper.

Konklusjon

Gemma 2s avanserte funksjoner som sliding window-oppmerksomhet, soft-capping og nye modell-sammenslåings-teknikker gjør den til et kraftfullt verktøy for en rekke naturlige språkbehandlingsoppgaver.

Ved å anvende Gemma 2 i dine prosjekter, enten gjennom enkel inferens, komplekse RAG-systemer eller feinjusterte modeller for bestemte domener, kan du utnytte kraften til SOTA AI samtidig som du beholder kontroll over dine data og prosesser.