Andersons vinkel

Kodings-AIer lider av Dunning-Kruger-effekten

Nye studier viser at kodings-AIer, som ChatGPT, lider av Dunning-Kruger-effekten, og ofte oppfører seg mest selvbevisst når de er minst kompetente. Når de takler ukjente eller obskure programmeringsspråk, hevder de høy sikkerhet, selv om svarene deres faller fra hverandre. Studien kobler modellens overmot til både dårlig ytelse og mangel på treningdata, og dette fører til nye bekymringer om hvor mye disse systemene virkelig vet om det de ikke vet.

Hver enkelt som har brukt en moderat mengde tid på å samhandle med store språkmodeller om faktiske spørsmål, vil allerede vite at LLM-er ofte er utsatt for å gi en selvbevisst feil respons til en brukerspørring.

I tillegg til mer åpenbare former for hallusinasjoner, er årsaken til denne tomme selvgodheten ikke 100 % klar. Forskning publisert over sommeren antyder at modellene gir selvbevisste svar selv når de vet at de er feil; selv om andre teorier tilskriver overmot til arkitektoniske valg, blant andre muligheter.

Hva sluttbrukeren kan være sikker på, er at opplevelsen er usedvanlig frustrerende, siden vi er hardkodet til å ha tillit til personers estimater av deres egne evner (ikke minst fordi det finnes konsekvenser, både juridiske og andre, hvis en person lover for mye og leverer for lite); og en form for antropomorf overføring gjør at vi tenderer til å gjenta dette mønsteret med konversasjonelle AI-systemer.

Men en LLM er en uregistrert enhet som kan og vil effektivt returnere en ‘Ooops! Butterfingers…’ etter at den har hjulpet brukeren til å uforvarende ødelegge noe viktig, eller i det minste kaste bort en ettermiddag av deres tid; antar at den vil inneholde ansvar overhode.

Verre, denne mangelen på forsiktig omsorg ser ut til å være umulig å fremkalle, i det minste i ChatGPT, som vil overflodig trygge brukeren på gyldigheten av sin råd, og forklare feilene i sin tenkning bare etter at skaden er skjedd. Hverken oppdatering av systemets varige minne, eller bruk av repetitive spørringer, synes å ha mye innvirkning på problemet.

Mennesker kan være like obstinate og selvbedragende – selv om noen som feiler så dypt og ofte sannsynligvis ville blitt sagt opp tidlig. Slike mennesker lider av motsatt av ‘impostersyndromet’ (hvor en ansatt frykter at de er blitt forfremmet over sine evner) – Dunning-Kruger-effekten, hvor en person betydelig overvurderer sin evne til å utføre en oppgave.

Kostnaden av inflasjon

En ny studie fra Microsoft undersøker verdien av Dunning-Kruger-effekten i forhold til effektiv ytelse av AI-basert kodestruktur (slik som Redmonds eget Copilot), i en forskningsinnsats som er den første til å spesifikt behandle denne undersektoren av LLM-er.

Arbeidet analyserer hvordan selvbevisst kodings-AIer vurderer sine egne svar mot hvor godt de faktisk utfører, på tvers av dusinvis av programmeringsspråk. Resultatene viser en tydelig menneske-lignende mønster: når modellene var minst kompetente, var de mest selvbevisste.

Effekten var sterkest i obskure eller lav-resurs-språk, hvor treningdata var tynn – jo svakere modellen eller sjeldnere språket, jo større illusjonen av ferdighet:

GPT-4o’s faktiske og opplevde ytelse på tvers av programmeringsspråk, sortert etter faktisk ytelse. Kilde: https://arxiv.org/pdf/2510.05457

De fire forfatterne, alle likeverdige bidragsytere som arbeider for Microsoft, hevder at arbeidet reiser nye spørsmål om hvor mye disse verktøyene kan bli betrodd til å dømme sin egen utgang, og de uttaler:

‘Ved å analysere modell-selvbevissthet og ytelse på tvers av et diversifisert sett av programmeringsspråk, avdekker vi at AI-modeller speiler menneskelige mønster av selvbevissthet, spesielt i ukjente eller lav-resurs-domener.

‘Våre eksperimenter demonstrerer at mindre kompetente modeller og de som opererer i sjeldne programmeringsspråk, utviser sterkere DKE-lignende bias, hvilket antyder at styrken av biasen er proporsjonal med kompetansen til modellene. Dette stemmer overens med menneskelige eksperimenter for bias.’

Forskerne kontekstualiserer denne linjen av studier som en måte å forstå hvordan modell-selvbevissthet blir uansvarlig når ytelsen er svak, og å teste om AI-systemer viser den samme type selvbevissthet som ses hos mennesker – med nedstrøms implikasjoner for tillit og praktisk utrulling.

Selv om den nye artikkelen trosser Betteridges lov om overskrifter, er den likevel tittelen Har kode-modeller Dunning-Kruger-effekten?. Selv om forfatterne uttaler at koden er utgitt for arbeidet, inneholder den nåværende forhåndsutgaven ingen detaljer om dette.

Metode

Studien testet hvordan nøyaktig kodings-AIer kunne dømme sine egne svar ved å gi dem tusenvis av multiple-valg programmeringsspørsmål, med hvert spørsmål tilhørende et bestemt språkdomene, fra Python og Java til Perl og COBOL:

Programmeringsspråk-domener brukt i studien, sammen med antall multiple-valg kodningsspørsmål samplet for hvert domene.

Modellene ble bedt om å velge det riktige alternativet, og deretter estimere hvor selvbevisst de var i sitt valg, med deres faktiske ytelse målt av hvor ofte de fikk svaret riktig – og deres selv-vurderte selvbevissthet indikerte hvor god de trodde de var. Å sammenligne disse to målene tillot forskerne å se hvor selvbevissthet og kompetanse skilte seg.

For å måle hvor selvbevisst modellene syntes å være, brukte studien to metoder: absolutt selvbevissthet og relativ selvbevissthet. I den første, ble modellen bedt om å gi en score fra null til en sammen med hvert svar, med dens selvbevissthet for et bestemt språk definert av gjennomsnittet av disse scorene på tvers av spørsmål i det språket.

Den andre metoden så på hvor selvbevisst modellen var når de valgte mellom to spørsmål; for hvert par, måtte modellen si hvilket de følte seg mer sikre på. Disse valgene ble deretter scoret ved hjelp av rangeringssystemer opprinnelig designet for konkurranse-spill, behandling hver spørsmål som om det var en spiller i en kamp. De endelige scorene ble normalisert og gjennomsnittlig for hvert språk for å gi en relativ selvbevissthetsscore.

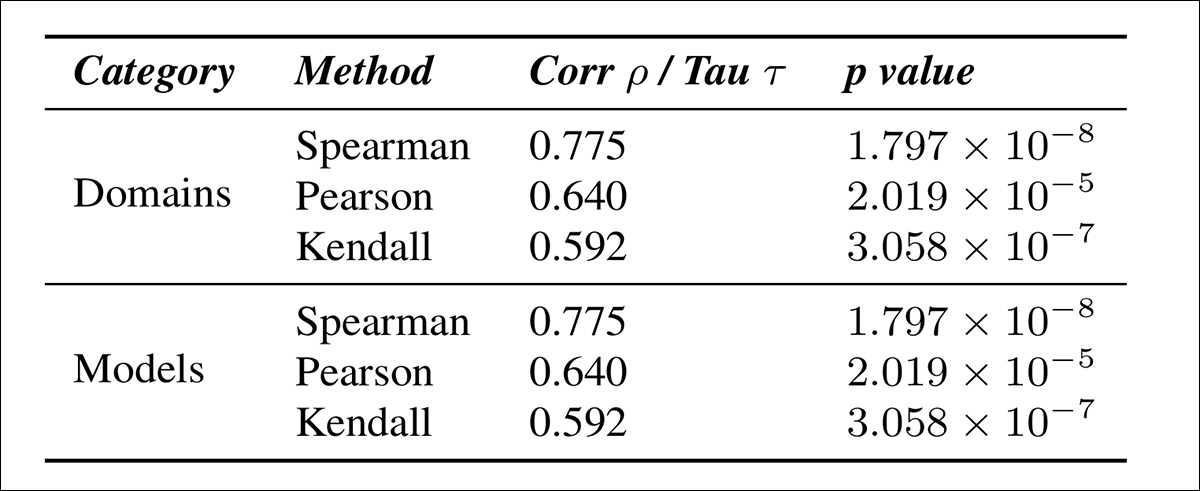

To etablerte former for Dunning-Kruger-effekten blir undersøkt i artikkelen: en som sporer hvordan en enkelt modell misdømmer sin egen ytelse på tvers av ulike domener; og en annen som sammenligner selvbevissthet mellom svakere og sterkere modeller.

Den første formen, kalt intra-deltager DKE, ser på om en enkelt modell blir mer selvbevisst i språk hvor den utfører dårlig. Den andre, inter-deltager DKE, spør om modeller som utfører dårligere også tenderer til å vurdere seg selv høyere.

I begge tilfeller, brukes gapet mellom selvbevissthet og faktisk ytelse til å måle selvbevissthet, med større gap i lav-ytelsessettinger som peker på DKE-lignende atferd.

Resultater

Studien tester for Dunning-Kruger-effekten på tvers av seks store språkmodeller: Mistral; Phi-3; DeepSeek-Distill; Phi-4; GPT-0.1, og GPT-4o.

Hver modell ble testet på multiple-valg programmeringsspørsmål fra det offentlig tilgjengelige CodeNet-datasettet, med 37 språk* representert for å avdekke hvordan selvbevissthet og nøyaktighet varierte på tvers av kjente og obskure kodingsdomener.

Den inter-modell-analysen viser en tydelig Dunning-Kruger-mønster:

Faktisk versus opplevd ytelse på tvers av seks kode-modeller, som viser hvordan lavere-utførende modeller som Mistral og Phi-3 viser høy selvbevissthet til tross for dårlig nøyaktighet, mens sterkere modeller som GPT-4o viser mer kalibrert eller til og med under-selvbevisst atferd.

Modeller med lavere nøyaktighet, inkludert Mistral og Phi-3, tenderte til å overvurdere sine egne evner, mens høyere-utførende systemer som GPT-4o viste selvbevissthet som mer nærmet seg deres faktiske ytelse, spesielt når dømt av relativ selvbevissthet.

Resultatene indikerer også at de mest kompetente modellene kan noen ganger undervurdere seg selv (et mønster som absolutt selvbevissthetsscore ikke fanger).

Resultatene indikerer også at intra-modell-analysen også støtter tilstedeværelsen av Dunning-Kruger-effekten. I resultatene som vises i starten av artikkelen, ser vi hvordan hver modell utførte seg på tvers av ulike programmeringsspråk, ordnet etter faktisk ytelse.

I språk hvor modellene scoret dårlig, spesielt i sjeldne eller lav-resurs-språk som COBOL, Prolog og Ceylon, var deres selvbevissthet merkbart høyere enn deres resultater berettiget. I kjente språk som Python og JavaScript, var deres selvbevissthet mer i linje med deres faktiske nøyaktighet, og noen ganger til og med lavere enn den.

Dette mønsteret dukket opp i både absolutt og relativ selvbevissthet, og antyder at modeller er mindre bevisste på sine egne begrensninger når de opererer i ukjente kodingsdomener.

Å behandle modeller som deltakere innførte noen begrensninger, siden det lille antallet modeller i spill påvirker mangfold; forskjeller innen en enkelt modells utgang ignorerer; og datafordelingen kan ikke reflektere den som er funnet hos virkelige menneskelige deltakere.

For å kompensere for dette, testet studien tre alternative oppsett: først, ble hver modell gitt en distinkt personlighet; andre, ble svarene samplet ved en høyere temperatur for å skape mer variasjon; tredje, ble spørringene parafrasert flere ganger, med hver versjon behandlet som en separat deltaker:

Korrelasjon mellom selvbevissthet og faktisk ytelse på tvers av ulike eksperimentelle oppsett, som viser at Dunning-Kruger-mønsteret forblir konsistent under alle betingelser og er sterkest når multiple diverse svar samples fra samme modell.

For å bedre forstå hvordan opplevd ytelse skiller seg fra faktisk ytelse, sammenlignet studien absolutt og relativ selvbevissthet, ved å beregne hvor mye hver modell overvurderte sin egen evne (spesifikt, forskjellen mellom dens selvbevissthetsscore og dens faktiske nøyaktighet), og deretter måle hvordan denne overvurderingen relaterte til modellens faktiske ytelse:

Korrelasjon mellom selvbevissthet (målt som absolutt minus relativ selvbevissthet) og faktisk nøyaktighet på tvers av programmeringsspråk og modelltyper, som viser at større overvurdering er konsistent assosiert med lavere ytelse.

Forskningene viser også at spesialiserte modeller trent på smalere domener viste sterkere DKE-effekter enn generalister:

Korrelasjon mellom overvurdering og faktisk ytelse for basis-, enkelt-domene- og multi-domene spesialiserte modeller, som viser sterkere DKE-effekter når spesialisering øker.

Ved å bruke MultiPL-E-datasettet på tvers av åtte programmeringsspråk, fant forfatterne at enkelt-domene-trening ledet til større selvbevissthet enn multi-domene eller basis-oppsett, og antyder at DKE forverres med økt spesialisering.

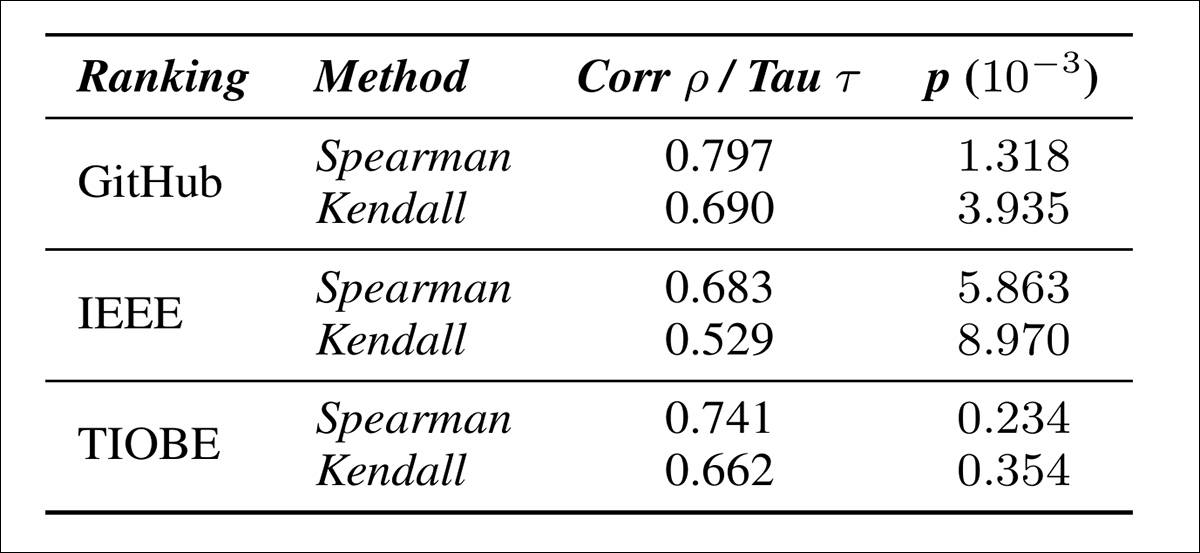

Testene fant også at modeller tenderer til å være mer selvbevisste i sjeldne programmeringsspråk. På tvers av GitHub, IEEE og TIOBE-rangliste, korrelerte sjeldenhet sterkt med høyere opplevd selvbevissthet, med et toppnivå på 0,797:

Korrelasjon mellom modell-selvbevissthet og språk-sjeldenhet, ved hjelp av tre popularitets-rangeringer. Mindre vanlige språk er assosiert med høyere opplevd ytelse.

Til slutt testet forfatterne om Dunning-Kruger-effekten viser seg i kode-generering, ved å evaluere modeller på MultiPL-E-datasettet på tvers av Ada, Dart, Prolog, Swift, C++, Python, C# og Elixir-språkene.

Selv om effekten fortsatt var til stede, var den merkbart svakere enn i multiple-valg-spørsmål-innstillingen, sannsynligvis på grunn av den større vanskeligheten i å vurdere selvbevissthet og korrekthet i åpne oppgaver:

Korrelasjon mellom overvurdering og faktisk ytelse i åpne kode-genereringsoppgaver, basert på MultiPL-E-resultater på tvers av åtte programmeringsspråk.

Ved å vurdere den fortsatt omdiskuterte forklaringen for Dunning-Kruger-effekten, konkluderer forfatterne:

‘En mulig forklaring som kan være felles for både mennesker og AI-modeller er den meta-kognitive forklaringen, som sier at vurdering av kvaliteten på en ytelse av en ferdighet er en avgjørende del av å tilegne seg en ferdighet.

‘Denne forklaringen kan potensielt testes eksperimentelt i AI-modeller med en kontrollert studie av ulike treningstrategier og om de alle fører til samtidige forbedringer i ytelse og evne til å vurdere kvalitet på ytelse. Men denne studien er betydelig utenfor denne artikkelen, og vi lar den til fremtidig arbeid.’

Konklusjon

Selv i sin native domene, kan Dunning-Kruger-effekten (som artikkelen påpeker) være tilskrevet enten en statistisk eller kognitiv årsak. Hvis til en statistisk årsak, er anvendelsen av et tidligere unikt menneskelig syndrom til en maskinlæringskontekst faktisk ganske gyldig.

Selv om forfatterne spekulerer i at årsaken kan være ‘kognitiv’ i begge tilfeller, ville det kreve en litt mer metafysisk standpunkt.

Kanskje den mest interessante funnet i artikkelen er omfanget av hvilken grad flere kodings-LLM-er tenderer til å doble ned i sine minst gunstige omstendigheter, dvs. ved å vise maksimal selvbevissthet når de håndterer de sjeldneste eller minst kjente språkene – noe som ville være en nesten umiddelbar selv-destruktiv strategi i en virkelig arbeidsmiljø.

* De programmeringsspråkene som ble brukt, var Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript og Visual Basic.

Først publisert onsdag, 8. oktober 2025