Andersons vinkel

Å bringe en luktesans til AI-utvikling

En ny AI-dataset lar maskiner lukte ved å assosiere luktedata med bilder, og lar modellene sammenligne lukter med objekter, scener og materialer.

Kanskje fordi lukte-utstyr har så en blandet historie, er luktesansen en ganske forlatt sans i AI-forskning. Med mindre du planla å produsere enda en innføring i den lange rekken (mer enn ett århundre, til dags dato) smell-o-vision saga, har brukstilfeller alltid syntes ganske ‘nisje’ i sammenligning med muligheten for å utnytte bilde-, lyd- og video-datasett, og AI-modellene som er trent fra dem.

I virkeligheten vil muligheten for å automatisere, industrialisere og popularisere det type av detekteringsfasiliteter som tilbys av bombhunder, likhunder, sykdoms-neshunder og diverse andre typer av hundesnusenhet, ville være en merkbart fordel i kommunale og sikkerhetstjenester. Til tross for høyt etterspørsel, langt over tilgang, er trening og vedlikehold av detekteringshunder en dyrt forretning som ikke alltid tilbyr god verdi for pengene.

Inntil nå har det meste av forskningen som innlemmer dette området av studier vært begrenset til et laboratorium, med kurerte samlinger som vanligvis består av eksempler med håndlagde funksjoner – en profil som er mer rettet mot håndlagde løsninger enn industrialiserte applikasjoner.

Fremover med en nese

Inn i denne ganske støvete klima kommer en interessant ny akademisk/industriell samarbeid fra USA, hvor et team av forskere tilbrakte flere måneder med å katalogisere diverse lukter i innendørs og utendørs miljøer i New York City – og, for første gang, samlet inn bilder assosiert med de fangete lukter:

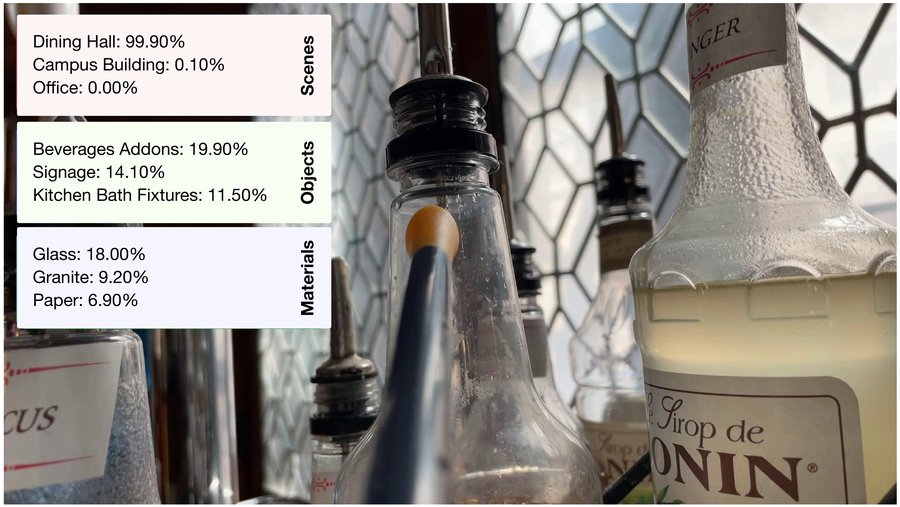

Nota den sentrale sensoren, ‘nosen’ på lukte-enheten. Trening bare på lukte, modellen gjetter om den lukter granitt, plast eller lær – og identifiserer også rommet den er i, uten å se et enkelt piksel. Kilde

Dette forskningen har ledet forfatterne av den nye studien til å utvikle en variasjon av den svært populære Contrastive Language-Image Pretraining (CLIP)-rammeverket, som kobler tekst og bilder, i form av Contrastive Olfaction-Image Pretraining (COIP) – som kobler lukter og bilder.

Top: synkronisert video og luktesensor data er fanget i naturlige innstillinger ved å bruke en kamera-e-nese-rigg. Bottom left (b): en felles innlegg er lært gjennom cross-modal selv-overvåking. (c): systemet henter visuelle sammenstillinger basert bare på en spørgsmålslukt. (d): enkeltluktsprøver brukes til å klassifisere miljø, objekt og materialekategorier. (e): svært like lukter, som to typer gress, er skilt uten visuell innputt. Kilde

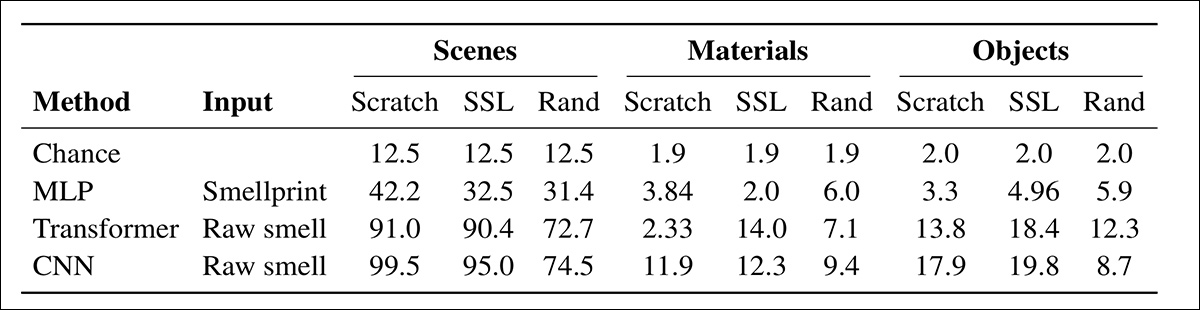

Den nye datasetten, tittelen New York Smells, inneholder 7 000 lukte-bilde-par med 3 500 forskjellige objekter. Når trent i tester, ble den nye datafunn til å overgå de populære håndlagde funksjonene i den relativt lille antallet lignende tidligere datasett.

Forfatterne håper at deres første utgave vil åpne veien for senere og følgende arbeid mot luktedetekteringssystemer designet til å fungere i villmarken, på samme måte som snuskhunder gjør:

‘Vi ser på denne datasetten som et skritt mot i villmarken, multimodal lukte-persepsjon, samt et skritt mot å koble syn med lukt. Mens luktesansen tradisjonelt har vært nærmet i begrensede innstillinger, som kvalitetsikring, er det mange applikasjoner i naturlige innstillinger.

‘For eksempel, som mennesker, bruker vi konstant vår luktesans til å vurdere kvaliteten på mat, identifisere farer og detektere usynlige objekter.

‘I tillegg viser mange dyr, som hunder, bjørner og mus, overmenneskelige lukteevner kapasiteter, som antyder at menneske lukte-persepsjon er langt fra grensen for maskinens evner.’

Selv om den nye artikkelen, tittelen New York Smells: A Large Multimodal Dataset for Olfaction, lover at data og kode vil bli utgitt, er en 27GB datafil allerede tilgjengelig via artikkelen prosjekt-side. Artikkelen ble produsert av ni forskere over Columbia University, Cornell University og Osmo Labs.

Metode

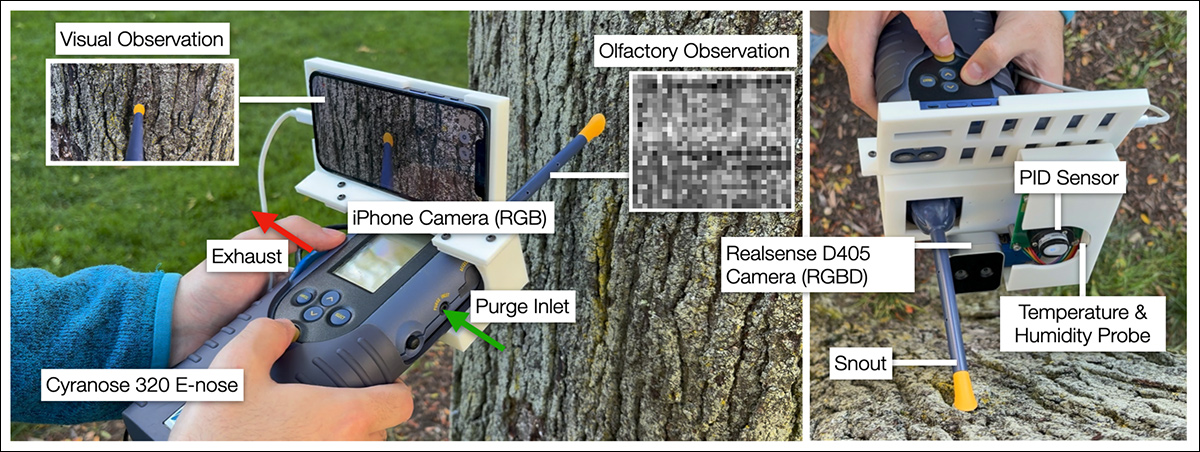

For å samle materiale for den nye samlingen, brukte forskerne Cyranose 320 elektronisk nese, med en iPhone montert over fremre inntak for å fange visuelt hva lukter som ble registrert:

En håndholdt sensor-rigg samler parrede video- og luktedata ved å montere en iPhone-kamera på en Cyranose 320 e-nese. Snuten er rettet mot objekter mens eksos og purge-inngangen håndterer luftstrøm under sampling. En RGB‑D-kamera fanger dybde, mens Volatile organic compound (VOC)-konsentrasjon, temperatur og fuktighet blir registrert gjennom integrerte sensorer, inkludert en Proportional-integral-derivative (PID)-modul og miljø-sonde.

Denne forskningen har ført til at forfatterne har utviklet en variasjon av den svært populære Contrastive Language-Image Pretraining (CLIP)-rammeverket, som kobler tekst og bilder, i form av Contrastive Olfaction-Image Pretraining (COIP) – som kobler lukter og bilder.

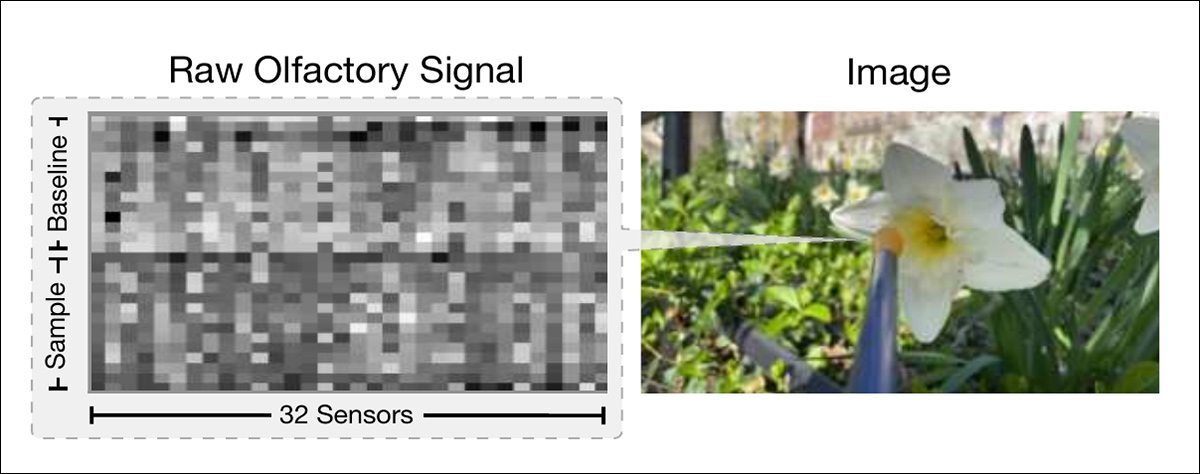

Top: synkronisert video og luktesensor data er fanget i naturlige innstillinger ved å bruke en kamera-e-nese-rigg. Bottom left (b): en felles innlegg er lært gjennom cross-modal selv-overvåking. (c): systemet henter visuelle sammenstillinger basert bare på en spørgsmålslukt. (d): enkeltluktsprøver brukes til å klassifisere miljø, objekt og materialekategorier. (e): svært like lukter, som to typer gress, er skilt uten visuell innputt. Kilde

Den nye datasetten, tittelen New York Smells, inneholder 7 000 lukte-bilde-par med 3 500 forskjellige objekter. Når trent i tester, ble den nye datafunn til å overgå de populære håndlagde funksjonene i den relativt lille antallet lignende tidligere datasett.

Forfatterne håper at deres første utgave vil åpne veien for senere og følgende arbeid mot luktedetekteringssystemer designet til å fungere i villmarken, på samme måte som snuskhunder gjør:

‘Vi ser på denne datasetten som et skritt mot i villmarken, multimodal lukte-persepsjon, samt et skritt mot å koble syn med lukt. Mens luktesansen tradisjonelt har vært nærmet i begrensede innstillinger, som kvalitetsikring, er det mange applikasjoner i naturlige innstillinger.

‘For eksempel, som mennesker, bruker vi konstant vår luktesans til å vurdere kvaliteten på mat, identifisere farer og detektere usynlige objekter.

‘I tillegg viser mange dyr, som hunder, bjørner og mus, overmenneskelige lukteevner kapasiteter, som antyder at menneske lukte-persepsjon er langt fra grensen for maskinens evner.’

Selv om den nye artikkelen, tittelen New York Smells: A Large Multimodal Dataset for Olfaction, lover at data og kode vil bli utgitt, er en 27GB datafil allerede tilgjengelig via artikkelen prosjekt-side. Artikkelen ble produsert av ni forskere over Columbia University, Cornell University og Osmo Labs.

Metode

For å samle materiale for den nye samlingen, brukte forskerne Cyranose 320 elektronisk nese, med en iPhone montert over fremre inntak for å fange visuelt hva lukter som ble registrert:

En håndholdt sensor-rigg samler parrede video- og luktedata ved å montere en iPhone-kamera på en Cyranose 320 e-nese. Snuten er rettet mot objekter mens eksos og purge-inngangen håndterer luftstrøm under sampling. En RGB‑D-kamera fanger dybde, mens Volatile organic compound (VOC)-konsentrasjon, temperatur og fuktighet blir registrert gjennom integrerte sensorer, inkludert en Proportional-integral-derivative (PID)-modul og miljø-sonde.

Denne forskningen har ført til at forfatterne har utviklet en variasjon av den svært populære Contrastive Language-Image Pretraining (CLIP)-rammeverket, som kobler tekst og bilder, i form av Contrastive Olfaction-Image Pretraining (COIP) – som kobler lukter og bilder.

Top: synkronisert video og luktesensor data er fanget i naturlige innstillinger ved å bruke en kamera-e-nese-rigg. Bottom left (b): en felles innlegg er lært gjennom cross-modal selv-overvåking. (c): systemet henter visuelle sammenstillinger basert bare på en spørgsmålslukt. (d): enkeltluktsprøver brukes til å klassifisere miljø, objekt og materialekategorier. (e): svært like lukter, som to typer gress, er skilt uten visuell innputt. Kilde

Den nye datasetten, tittelen New York Smells, inneholder 7 000 lukte-bilde-par med 3 500 forskjellige objekter. Når trent i tester, ble den nye datafunn til å overgå de populære håndlagde funksjonene i den relativt lille antallet lignende tidligere datasett.

Forfatterne håper at deres første utgave vil åpne veien for senere og følgende arbeid mot luktedetekteringssystemer designet til å fungere i villmarken, på samme måte som snuskhunder gjør:

‘Vi ser på denne datasetten som et skritt mot i villmarken, multimodal lukte-persepsjon, samt et skritt mot å koble syn med lukt. Mens luktesansen tradisjonelt har vært nærmet i begrensede innstillinger, som kvalitetsikring, er det mange applikasjoner i naturlige innstillinger.

‘For eksempel, som mennesker, bruker vi konstant vår luktesans til å vurdere kvaliteten på mat, identifisere farer og detektere usynlige objekter.

‘I tillegg viser mange dyr, som hunder, bjørner og mus, overmenneskelige lukteevner kapasiteter, som antyder at menneske lukte-persepsjon er langt fra grensen for maskinens evner.’

Selv om den nye artikkelen, tittelen New York Smells: A Large Multimodal Dataset for Olfaction, lover at data og kode vil bli utgitt, er en 27GB datafil allerede tilgjengelig via artikkelen prosjekt-side. Artikkelen ble produsert av ni forskere over Columbia University, Cornell University og Osmo Labs.

Metode

For å samle materiale for den nye samlingen, brukte forskerne Cyranose 320 elektronisk nese, med en iPhone montert over fremre inntak for å fange visuelt hva lukter som ble registrert:

En håndholdt sensor-rigg samler parrede video- og luktedata ved å montere en iPhone-kamera på en Cyranose 320 e-nese. Snuten er rettet mot objekter mens eksos og purge-inngangen håndterer luftstrøm under sampling. En RGB‑D-kamera fanger dybde, mens Volatile organic compound (VOC)-konsentrasjon, temperatur og fuktighet blir registrert gjennom integrerte sensorer, inkludert en Proportional-integral-derivative (PID)-modul og miljø-sonde.

Denne forskningen har ført til at forfatterne har utviklet en variasjon av den svært populære Contrastive Language-Image Pretraining (CLIP)-rammeverket, som kobler tekst og bilder, i form av Contrastive Olfaction-Image Pretraining (COIP) – som kobler lukter og bilder.

Top: synkronisert video og luktesensor data er fanget i naturlige innstillinger ved å bruke en kamera-e-nese-rigg. Bottom left (b): en felles innlegg er lært gjennom cross-modal selv-overvåking. (c): systemet henter visuelle sammenstillinger basert bare på en spørgsmålslukt. (d): enkeltluktsprøver brukes til å klassifisere miljø, objekt og materialekategorier. (e): svært like lukter, som to typer gress, er skilt uten visuell innputt. Kilde

Den nye datasetten, tittelen New York Smells, inneholder 7 000 lukte-bilde-par med 3 500 forskjellige objekter. Når trent i tester, ble den nye datafunn til å overgå de populære håndlagde funksjonene i den relativt lille antallet lignende tidligere datasett.

Forfatterne håper at deres første utgave vil åpne veien for senere og følgende arbeid mot luktedetekteringssystemer designet til å fungere i villmarken, på samme måte som snuskhunder gjør:

‘Vi ser på denne datasetten som et skritt mot i villmarken, multimodal lukte-persepsjon, samt et skritt mot å koble syn med lukt. Mens luktesansen tradisjonelt har vært nærmet i begrensede innstillinger, som kvalitetsikring, er det mange applikasjoner i naturlige innstillinger.

‘For eksempel, som mennesker, bruker vi konstant vår luktesans til å vurdere kvaliteten på mat, identifisere farer og detektere usynlige objekter.

‘I tillegg viser mange dyr, som hunder, bjørner og mus, overmenneskelige lukteevner kapasiteter, som antyder at menneske lukte-persepsjon er langt fra grensen for maskinens evner.’

Selv om den nye artikkelen, tittelen New York Smells: A Large Multimodal Dataset for Olfaction, lover at data og kode vil bli utgitt, er en 27GB datafil allerede tilgjengelig via artikkelen prosjekt-side. Artikkelen ble produsert av ni forskere over Columbia University, Cornell University og Osmo Labs.

Konklusjon

Selv om luktesyntese synes å være et uløst problem noen vei inn i fremtiden, har et effektivt og rimelig i villmarken lukte-analyse-system enormt potensiale, ikke bare for politi, sikkerhet og medisinske formål, men også for kvalitet på livet og overvåking av byer.

For øyeblikket er utstyret involvert nisje og vanligvis ganske dyrt; derfor synes virkelig fremgang i ‘lukte-AI’ for detektering å kreve en visjonær og rimelig sensor i Raspberry PI-ånden.

* Min konvertering av forfatterens inline-citater til hyperlenker.

** Vær vennlig å merk at ytterligere illustrasjoner (figur 8) er tilgjengelig i kilde-artikkelen, men er best sett i den sammenhengen.

Først publisert fredag, 28. november 2025