Andersons vinkel

AI ville heller lese boken enn se filmen

Det er overraskende vanskelig å få AI-modeller til å se og kommentere på faktisk videoinnhold, selv om de er laget for oppgaven. De er mer interesserte i det skrevne ordet.

Hvis du noensinne har prøvd å laste opp en liten video-klipp til ChatGPT, eller til en lignende populær visjon/språkmodell, kan du kanskje ha blitt overrasket over å innse at de faktisk ikke kan tolke video. Mens modeller som ChatGPT-4o+ er i stand til å analysere enkeltbilder – i form av bilder, som JPEG og PNG – foretrekker de at brukeren selv trekker ut sine egne bilder og laster dem opp som bilder (som de er forberedt til å kommentere).

I tilfelle OpenAI GPT-serien kan man, ganske møysommelig, trekke ut en fullstendig rekke med bilder fra en video-klipp og mate dem til ChatGPT, for eksempel for å generere en AI-creert narrativ spor for videoen:

![Bilder og kode fra en OpenAI-tutorial på å parsere flere uttrukne bilder for å utvikle en AI-generert kommentar for en video-klipp. [ Kilde ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Bilder og kode fra en OpenAI-tutorial på å parsere flere uttrukne bilder for å utvikle en AI-generert kommentar for en video-klipp. Kilde

Men det er opp til brukeren å gjøre omformingen fra video til bilder, enten ved å kalle funksjoner i en større rutine, som i eksempelet ovenfor, eller trekke ut bildene med FFMPEG eller forskjellige gratis og betalte video-redigeringsløsninger.

Til en viss grad, kanskje til og med en stor del, henger begrensningene på videoanalyse i stor-skala produkter som ChatGPT sammen med ressursbruk: bare å utstyre én AI-eksemplar med et utvalg av de mest populære video-kodekene, og å binde compute-ressurser til den disk-tunge og CPU-throttling-prosessen med uttrekk, er ingen liten overveielse, hvis hundredvis av millioner av brukere bestemmer seg for å begynne å bruke disse fasilitetene hver dag.

I tillegg kan temporær analyse male en helt annen bilde enn et enkeltbilde (forestall at noen går inn i et hus i en glad stemning og deretter oppdager en lik); derfor er det å vurdere hele den temporale ‘checksum’ av selv en kort video-klipp en krevende og ressurs-intensiv oppgave – samt et spesialisert område av forskningslitteraturen, for eksempel med den pågående utviklingen av rammer som Optical Flow – som essensielt ‘folder ut’ en lengde av video så at den kan betraktes og håndteres som om den var en statisk dokument:

![Optiske flow-diagrammer viser hvordan bevegelse spores over bilder i en video-sekvens, med grønne vektorer som viser bevegelsesretning og intensitet. Disse kartene gir den temporale kontinuitet som trengs for VLM-er og kan også tjene som strukturelle veiledere i VFX-arbeidsflyter. [ Kilde ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Optiske flow-diagrammer viser hvordan bevegelse spores over bilder i en video-sekvens, med grønne vektorer som viser bevegelsesretning og intensitet. Disse kartene gir den temporale kontinuitet som trengs for VLM-er og kan også tjene som strukturelle veiledere i VFX-arbeidsflyter. Kilde

Slå seg til ro med Cliff’s Notes

Likevel, siden modeller som Google’s Notebook LM og de nyere ChatGPT-inngangene kan lese assosiert metadata (dvs. innbygget tekstinnhold som kontekstualiserer videoen på en eller annen måte), nektar de ikke video-filopplasting; og noen ganger vil de sogar forsøke å tolke en video som ikke har noen slik data.

I følgende tilfelle lastet jeg opp en 6-sekunders tilfeldig klipp fra den italienske filmen Guds hånd (2021) til NotebookLM, og sikret meg at klippet inneholdt null nyttig tekst, hverken i metadata eller i filnavnet.

NotebookLM gikk deretter videre til å elaborert hallucinere materiale helt uavhengig av videoen*, komplett med en nonsensisk og uavhengig fem-minutters head-to-head-podcast:

En hverdagsøyeblikk i en 6-sekunders klipp fra en italiensk film blir vilt misfortolket av NotebookLM. Kilde: Google NotebookLM

Selv om Notebook, som ChatGPT, vil akseptere en YouTube-video som innputt, vil de bare gjøre det hvis videoen har en tolkbar tekst-lag-annotasjon og/eller undertekster (ikke rasteriserte undertekster som er brent inn i videoen).

På denne måten har det harde arbeidet med å faktisk se på og lytte til videoens innhold og utføre semantisk tolkning av det (en lovmessig nødvendighet for YouTube, på grunn av dens copyright-beskyttelsesmessige tiltak, og dens kommende identitetsbeskyttelsessystem), har blitt gjort på fritiden etter at brukeren lastet opp, når og når klippet kunne bli tildelt de nødvendige prosesseringsressursene.

Ekte video-tolkning er dyrt og utmattende, og det viser seg at selv modeller som er trent spesifikt for å utføre denne oppgaven, heller vil lese tekst enn faktisk se på video.

TL;DW

Dette, ifølge en ny artikkel fra Storbritannias University of Bristol, med tittelen En video er ikke verdt tusen ord, hvor de to forfatterne konkluderer at nåværende state-of-the-art vision language-modeller (VLM-er) – modeller som er ment å kunne analysere video på en mer innsatsfull måte, og å delta i video-spørsmål-svar (VQA) – også faller tilbake til tekst-basert informasjon når de kan.

Når de blir gitt både bevegelige bilder og skrevne spørsmål og flervalgsvar, fant artikkelforfatterne at modellene vanligvis baserte sine valg på mønster i teksten, snarere enn noe som skjer på skjermen – i mange tilfeller utførte de like godt selv når spørsmålet var tatt bort helt.

I hva som synes å være en vanlig form for skjøt eller juks, hva som betydde mest for de fleste modellene, var å kunne spore mønster i de mulige svarene; bare når oppgaven ble gjort vanskeligere, ved å legge til flere svarene, begynte AI-ene å betale nærmere oppmerksomhet til videoen.

Forfatterne ga VQA-tester under en rekke betingelser til seks VLM-modeller av diverse kontekstlengder, på fire egnete datasett; og fant at resultater indikerte modellenes avhengighet av tekst over video-innhold.

![Eksempel fra studien som viser hvordan en video-analysemodell vekter hva den ser versus hva den leser. Klippet viser en person som vever bambus, men modellen tilordner mye mer viktighet til den skrevne spørsmåls- og svarteksten enn til video-rammene selv. Blå høydepunkter markerer elementer som støtter det valgte svaret, mens røde markerer de som trekker det i motsatt retning, og viser hvordan modellens resonnering sentrerer seg rundt formuleringen snarere enn de bevegelige bildene. [Kilde] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Eksempel fra studien som viser hvordan en video-analysemodell vekter hva den ser versus hva den leser. Klippet viser en person som vever bambus, men modellen tilordner mye mer viktighet til den skrevne spørsmåls- og svarteksten enn til video-rammene selv. Blå høydepunkter markerer elementer som støtter det valgte svaret, mens røde markerer de som trekker det i motsatt retning, og viser hvordan modellens resonnering sentrerer seg rundt formuleringen snarere enn de bevegelige bildene. Kilde

Metode

For å forstå hvor mye hver del av innputt bidrar til modellens beslutning, bruker det nye arbeidet en metode fra spillteori kalt Shapley-verdier. Opprinnelig designet for å dele en utbetaling rettferdig blant spillere i en koalisjon, tilordner Shapley-verdier kreditt til hver ‘spiller’ basert på deres individuelle innvirkning.

Effektivt sett er ‘spillerne’ i denne scenariet enten video-rammene eller tekst-komponentene (annotasjoner, undertekster, kapsler osv.) av en VQA-oppgave; og ‘utbetalingen’ er modellens endelige svar. Ved å systematisk teste hva som skjer når hver del blir lagt til eller fjernet, avslører teknikken hvor viktig hvert element var i å nå det valgte svaret.

I tilfelle det nye prosjektet ble Shapley-verdier tilpasset for å håndtere blandede modaliteter, med video- og tekst-komponenter behandlet diskret, og deres varierende innvirkning på modellens utdata målt, og avslørte om video-innholdet ble faktisk tolket, eller om skrevne hint ble brukt som skjøt.

Mål

To enkle mål ble definert for å sammenligne hvor mye hver modalitet (dvs. video, spørsmål eller svar) bidro til modellens beslutning: Modalitet-bidrag måler hvor mye av den totale forklaringen kom fra hver type innputt; her blir alle tilgjengelige Shapley-verdier summert opp, og andelen som tilhører hver modalitet beregnet som en prosentdel av totalen.

For det andre korrigerte Per-Feature-bidrag for det faktum at noen modaliteter, som video, inneholder mange flere funksjoner enn andre. I stedet blir den gjennomsnittlige Shapley-verdien beregnet for hver funksjon, og disse gjennomsnittene sammenlignet for å bestemme hvilken modalitets innvirkning er dominant.

Data og tester

Forfatterne testet tilnærmingen på seks VLM-er med en rekke karakteristika designet for å sikre at testenes prinsipper var bredt anvendelige og generaliserbare. Derfor ble modellene valgt for forskjellige kontekstlengder, forskjellige aldre (dvs. hvor lenge siden rammen ble lansert), og forskjellige arkitektur-konfigurasjoner.

Kandidatene var FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (som utnytter Qwen2); og LongVA (også med Qwen2).

Med det samme målet om divers variasjon ble de fire mål-datasett valgt EgoSchema, et VQA-dataset designet for å være umulig å fullføre uten full visning av de tilknyttede videoene; HD-EPIC, et kjøkken-fokusert datasett med noen usedvanlig lange videoer; MVBench, en kuratert samling av bidrag fra andre datasett; og LVBench, som stiller VQA-spørsmål for svært lange videoer.

Fra disse utviklet forfatterne 60 spørsmål – ti fra hver spørsmålstype.

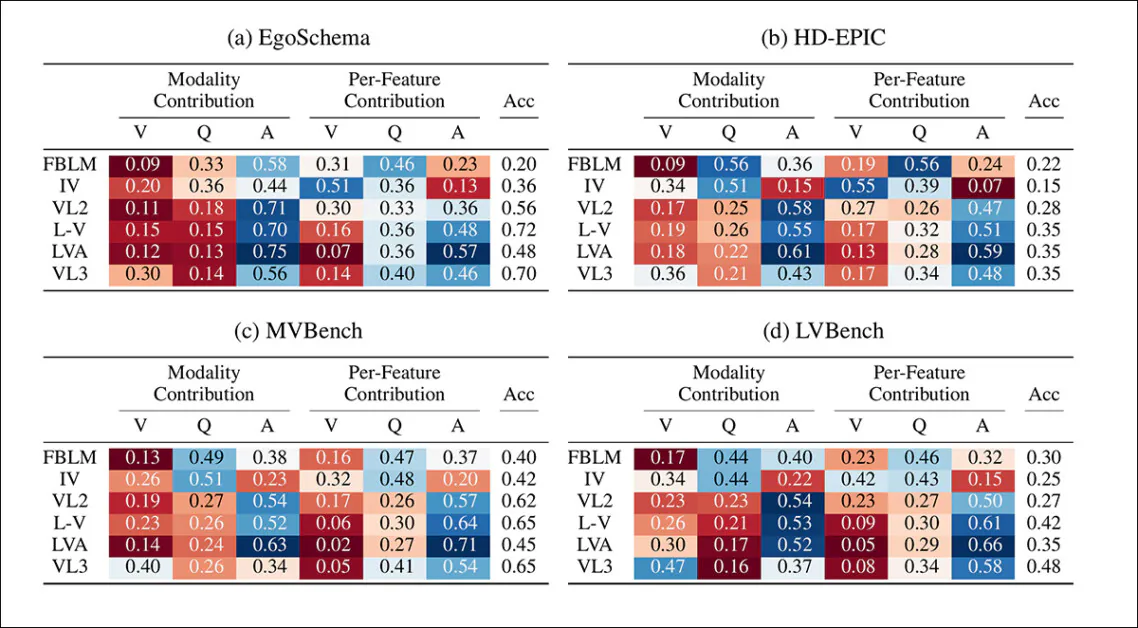

Bidrags-målene gjorde det klart at de fleste modellene avhengig av tekst mer enn video, spesielt når de ble dømt ramme for ramme. Selv der video gjorde en rimelig god figur i totalt bidrag, var dens per-funksjons-innvirkning ofte minimal, hvilket antyder at selv om modellen kanskje bruker videoen i aggregat, betaler den liten oppmerksomhet til enkelt-rammer. VideoLLaMA3 var hoved-avvikeren her, med en tyngre visuell avhengighet, spesielt på de lengre sekvensene i LVBench:

Modalitet-bidrag (MC) og Per-Feature-bidrag (PFC) poeng over modeller og datasett, som viser den relative vekten av video (V), spørsmål (Q) og svar (A) innputt. Kaldere farger indikerer sterkere bidrag; varmere farger indikerer svakere eller ubetydelig innvirkning. Over de fleste innstillinger er språk tydelig dominant, med video ofte sidelagt – spesielt i per-ramme-innvirkning.

Som for teksten, tenderte spørsmålet til å bety mer enn svaret, spesielt i sterke modeller. Dette var mest åpenbart i datasett som EgoSchema, hvor spørsmålene var lengre og mer naturalistiske, mens svarene var korte og noen ganger skjematiske. MVBench reverserte dette noe, siden dens binært-svar-struktur inflaterer den åpenbare viktigheten av svar-tokenene.

Over alle modeller og datasett var likevel visjon konsekvent sidelagt, med språk som gjorde det meste av det tungt arbeidet.

Artikkelen sier:

‘[For] lange kontekst-modeller, viser video en kraftig reduksjon i bidrag, noe som betyr at per-ramme Shapley-verdiene er mye mindre enn deres tekst-funksjons- motstykker.

‘Video som en hel modalitet er fortsatt svært relevant, men dette er bevis på at Shapley-verdiene av dens enkelt-rammer er mer sentrert rundt null, og at modellens oppmerksomhet på dem er mye mindre rettet enn for teksten.’

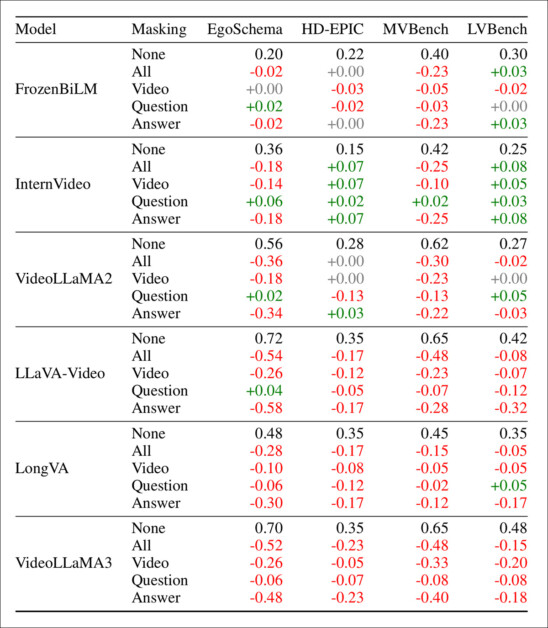

For å teste hvor mye hver del av innputt bidrar til modellens nøyaktighet, utførte forskerne ytterligere tester med maskering – bevisst skjule ett eller flere deler av innputt, og se hvor mye modellens nøyaktighet endrer seg som følge.

Hvis ytelsen faller skarpt når en bestemt innputt fjernes, er det sannsynlig at innputt er viktig; hvis modellen utfører omtrent like godt, antyder det at den manglende delen ikke ble sterkt avhengig av. På denne måten er maskeringstester en form for iterativ ablasjonstudie.

Ytelses-påvirkning av maskering av video-, spørsmål- eller svar-innputt over fire VQA-benchmark. Poengene viser endring fra den umaskerte baseline. Rødt betyr lavere nøyaktighet, grønt høyere. Modeller beholdt ofte høye poeng uten video, men tapte mer når (tekst) svaret ble fjernet. Spørsmålet kunne vanligvis maskeres med minimal effekt.

Resultatene (visualisert ovenfor) indikerer at svarene (tekst-svarene i flervalgsdata) bærer den største vekten over hele linjen. Maskering av svaret forårsaker vanligvis den største nedgangen i nøyaktighet, ofte reduserer modellene til nær-tilfeldig ytelse.

Imidlertid hadde maskering av spørsmålet vanligvis mye mindre effekt, hvilket støtter den tidligere funn at modellene ofte undervurderer spørsmålet.

I noen tilfeller forbedret nøyaktigheten når spørsmålet ble fjernet, hvilket antyder at modellene noen ganger bare matchet svarene til visuelle eller tekst-baserte hint, snarere enn å korrekt vurdere spørsmålet.

Modellene varierte i sin avhengighet av video: noen beholdt rimelig nøyaktighet uten det, og bekreftet på nytt den begrensede bidraget fra video-funksjoner i mange nåværende oppsett.

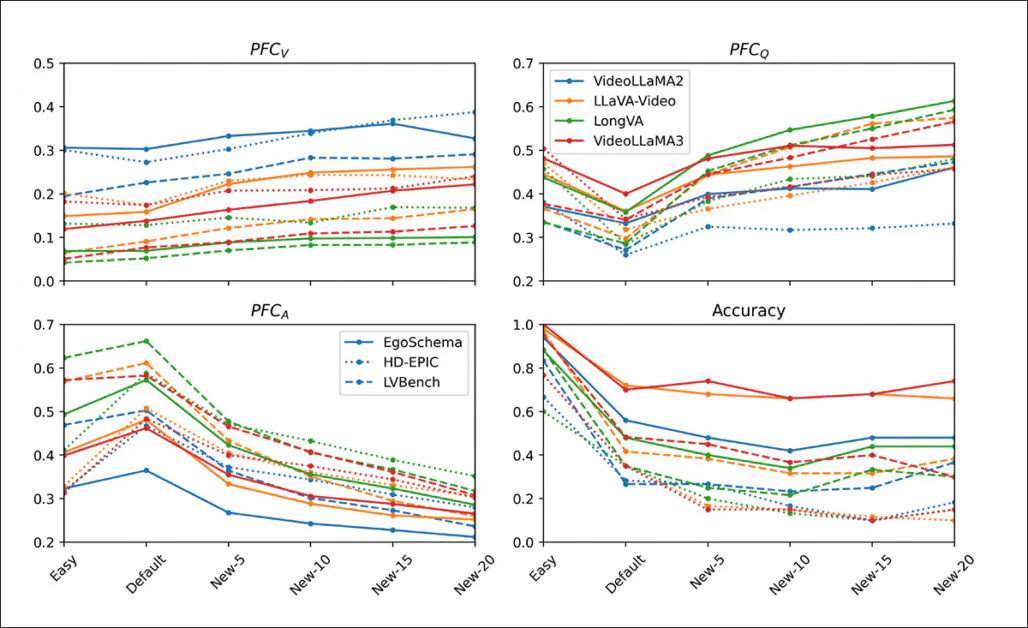

Forfatterne testet deretter om modellene kunne bli tvunget til å avhenge av video ved å legge til ekstra feil svarene til flervalgs-alternativene.

Når distraktorene var enkle og gjenbrukt fra andre spørsmål, forbedret ytelsen, da modellene matchet tekst-mønster uten mye resonnering. Men med ti eller flere ubeslektede svarene, begynte de å avhenge mer av videoen og spørsmålet:

Per-funksjons-bidrag og nøyaktighet for video-, spørsmål- og svar-innputt, når ekstra feil svare legges til hver VQA-test, som viser at økning av antall distraktorer reduserer tekst-dominans og øker den relative innvirkningen av visuelle og spørsmåls-funksjoner.