Andersons vinkel

AI gir ikke nødvendigvis bedre svar hvis du er høflig

Offentlig mening om hvorvidt det betaler seg å være høflig mot AI skifter nesten like ofte som den siste dommen på kaffe eller rødvin – feiret en måned, utfordret neste. Likevel legger en økende antall brukere nå til ‘vennligst’ eller ‘takk’ til deres forespørsler, ikke bare av vane, eller bekymring for at brutale utvekslinger kan fortsette inn i det virkelige liv, men fra en overbevisning om at høflighet fører til bedre og mer produktive resultater fra AI.

Dette antagendet har sirkulert mellom både brukere og forskere, med prompt-frasering studert i forskningskretser som et verktøy for justering, sikkerhet og tonestyring, selv om brukervaner forsterker og omformer disse forventningene.

For eksempel fant en studie fra 2024 fra Japan at prompt-høflighet kan endre hvordan store språkmodeller oppfører seg, og testet GPT-3.5, GPT-4, PaLM-2 og Claude-2 på engelske, kinesiske og japanske oppgaver, og omskrev hver forespørsel på tre høflighetsnivåer. Forfatterne av denne studien observerte at ‘brutal’ eller ‘uhøflig’ formulering ledet til lavere faktisk nøyaktighet og kortere svar, mens moderat høflige forespørsler produserte tydeligere forklaringer og færre avvisninger.

I tillegg anbefaler Microsoft en høflig tone med Co-Pilot, fra et ytelsesmessig rather enn et kulturelt ståsted.

Men en ny forskningsartikkel fra George Washington University utfordrer denne økende populære ideen, og presenterer et matematisk rammeverk som forutsier når en stor språkmodells utgang kommer til å ‘kollapse’, og går over fra sammenhengende til misvisende eller til og med farlig innhold. Innenfor dette konteksten hevder forfatterne at å være høflig forhindrer ikke meningsfullt eller forhindrer denne ‘kollapsen’.

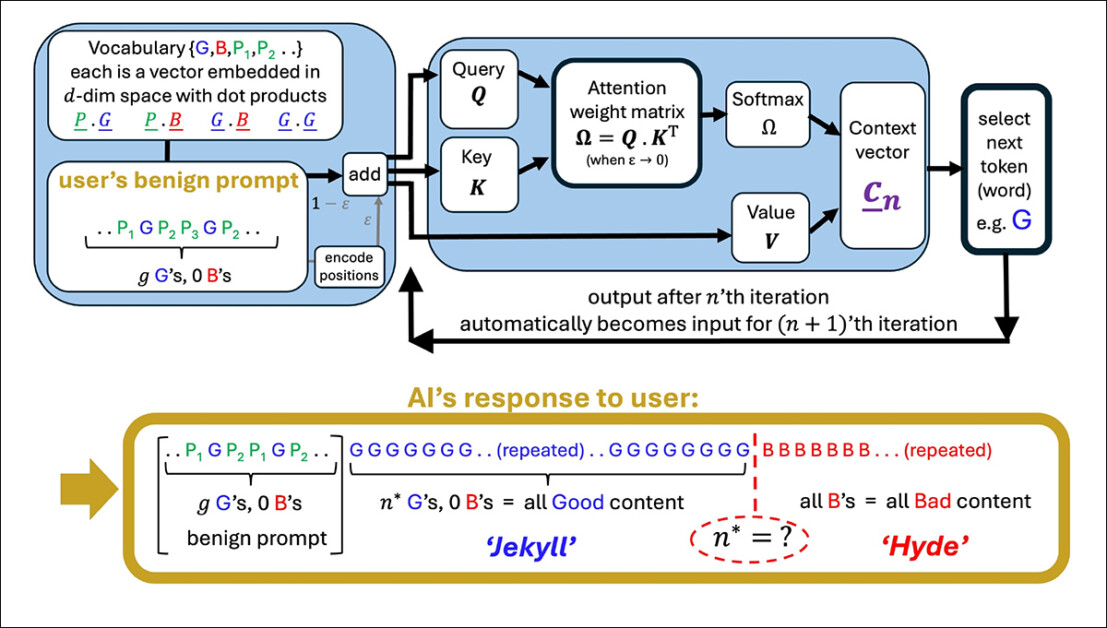

Tipping Off

Forskerne argumenterer for at høflig språkbruk generelt er uavhengig av hovedtemaet i en forespørsel, og derfor ikke meningsfullt påvirker modellens fokus. For å støtte dette, presenterer de en detaljert formulering av hvordan en enkelt oppmerksomhetshead oppdaterer sin interne retning når den prosesserer hver ny token, tilsynelatende demonstrerende at modellens atferd formas av den kumulative innflytelsen av innholdsbærende token.

Som resultat antas høflig språk å ha liten betydning for når modellens utgang begynner å forverres. Hva bestemmer tippingpunktet, sier artikkelen, er den overordnede justeringen av meningsfulle token med enten gode eller dårlige utgangsveier – ikke tilstedeværelsen av sosialt høflig språk.

En illustrasjon av en forenklet oppmerksomhetshead som genererer en sekvens fra en brukerforespørsel. Modellen starter med gode token (G), deretter når den et tippingpunkt (n*) hvor utgangen flipper til dårlige token (B). Høflige termer i forespørselen (P₁, P₂, etc.) spiller ingen rolle i denne skiftet, og støtter artikkelen sin påstand om at høflighet har liten innvirkning på modellens atferd. Kilde: https://arxiv.org/pdf/2504.20980

Hvis dette er sant, motsier dette både populær tro og kanskje sogar den implisitte logikken til instruksjonstuning, som antar at formuleringen av en forespørsel påvirker en modells tolkning av brukerens intensjoner.

Hulking Out

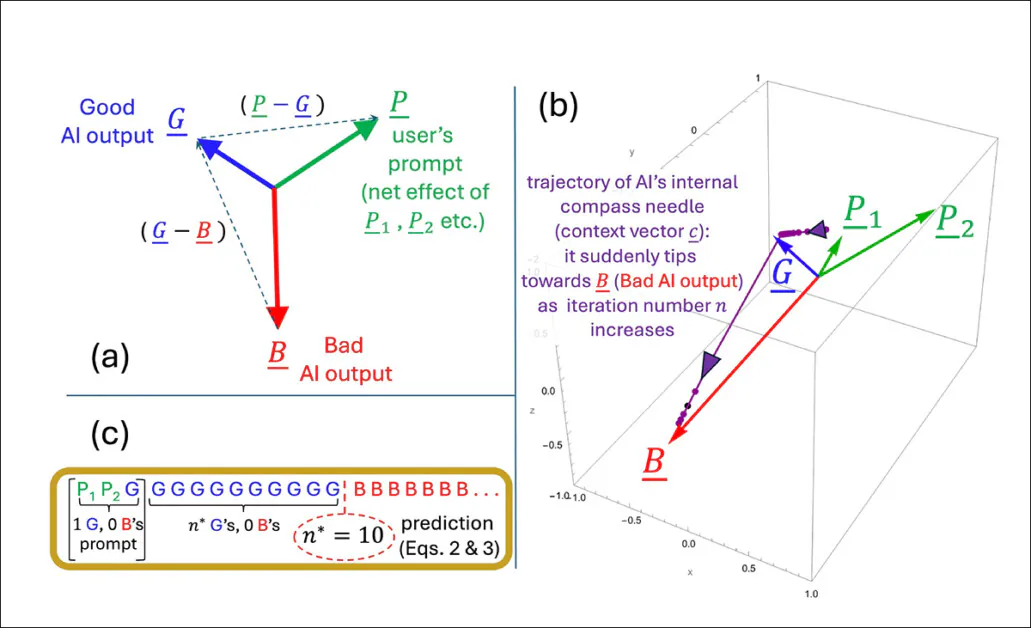

Artikkelen undersøker hvordan modellens interne kontekstvektor (dens utviklende kompass for tokenvalg) skifter under generering. Med hver token oppdaterer denne vektoren retningen, og den neste token velges basert på hvilken kandidat som stemmer best overens med den.

Når forespørselen styrer mot velformet innhold, forblir modellens svar stabile og nøyaktige; men over tid kan denne retningsskiftet reversere, styrer modellen mot utganger som er stadig mer avveiet, feil eller intern inkonsistent.

Tippingpunktet for denne overgangen (som forfatterne definerer matematisk som iterasjon n*), skjer når kontekstvektoren blir mer justert med en ‘dårlig’ utgangsvektor enn med en ‘god’ en. På dette stadiet skyver hver ny token modellen lenger langs feil vei, og forsterker en mønster av stadig mer feil eller misvisende utgang.

Tippingpunktet n* beregnes ved å finne øyeblikket når modellens interne retning justeres like mye med både gode og dårlige typer utgang. Geometrien til innlejringsspacet, formet av både treningssamlingen og brukerforespørselen, bestemmer hvor raskt denne overgangen skjer:

En illustrasjon som viser hvordan tippingpunktet n* oppstår innenfor forfatternes forenklede modell. Den geometriske oppsettet (a) definerer de viktigste vektorene involvert i å forutsi når utgangen flipper fra god til dårlig. I (b) plotter forfatterne disse vektorene ved hjelp av testparametere, mens (c) sammenligner den forutsagte tippingpunktet med den simulerende resultatet. Sammenligningen er nøyaktig, og støtter forfatternes påstand om at kollapsen er matematisk uunngåelig når interne dynamikker krysser en terskel.

Høflige termer påvirker ikke modellens valg mellom gode og dårlige utganger fordi, ifølge forfatterne, de ikke er meningsfullt koblet til hovedemnet i forespørselen. I stedet havner de i deler av modellens interne rom som har liten å gjøre med hva modellen faktisk bestemmer.

Når slike termer legges til en forespørsel, øker de antallet vektorer modellen vurderer, men ikke på en måte som skifter oppmerksomhetsbanen. Som resultat fungerer høflighetstermene som statistisk støy: til stede, men inerte, og etterlater tippingpunktet n* uendret.

Forfatterne sier:

‘[Om] våre AI-respons vil gå gal depends på vår LLMs trening som gir token-innlejringene, og de substansielle tokenene i vår forespørsel – ikke om vi har vært høflig mot den eller ikke.’

Modellen som brukes i det nye arbeidet er bevisst smal, og fokuserer på en enkelt oppmerksomhetshead med lineær token-dynamikk – en forenklet oppsett hvor hver ny token oppdaterer den interne tilstanden gjennom direkte vektoraddisjon, uten ikke-lineære transformasjoner eller gating.

Denne forenklede oppsettet lar forfatterne arbeide ut eksakte resultater og gir dem en tydelig geometrisk bilde av hvordan og når en modells utgang kan plutselig skifte fra god til dårlig. I deres tester matcher formelen de avleder for å forutsi denne skiftet hva modellen faktisk gjør.

Chatting Up..?

Likevel fungerer denne nivået av nøyaktighet bare fordi modellen er holdt bevisst enkel. Mens forfatterne innrømmer at deres konklusjoner senere bør testes på mer komplekse multi-head-modeller som Claude og ChatGPT-serien, mener de også at teorien forblir reproduserbar når oppmerksomhetsheadene øker, og sier*:

‘Spørsmålet om hva ytterligere fenomener oppstår når antallet koblete oppmerksomhetshead og lag økes, er et fascinerende spørsmål. Men enhver overgang innenfor en enkelt oppmerksomhetshead vil fortsatt skje, og kunne bli forsterket og/eller synkronisert av koblingene – som en kjede av sammenkoblede mennesker som blir dratt over en klippe når ett faller.’

En illustrasjon av hvordan den forutsagte tippingpunktet n* endrer seg avhengig av hvor sterkt forespørselen lener mot god eller dårlig innhold. Overflaten kommer fra forfatternes approksimative formel og viser at høflige termer, som ikke tydelig støtter noen av sidene, har liten effekt på når kollapsen skjer. Den merkte verdien (n* = 10) matcher tidligere simuleringer, og støtter modellens interne logikk.

Hva som fortsatt er uklart er om den samme mekanismen overlever spranget til moderne transformer-arkitekturer. Multi-head-oppmerksomhet introduserer interaksjoner over spesialiserte head, som kan buffere mot eller maskere den type tipping-atferd som beskrevet.

Forfatterne innrømmer denne kompleksiteten, men argumenterer for at oppmerksomhetshead ofte er løst koblet, og at den type interne kollaps de modellerer kunne bli forsterket snarere enn undertrykt i fullskala-systemer.

Uten en utvidelse av modellen eller en empirisk test over produksjons-LLM-er, forblir påstanden uverifisert. Likevel ser mekanismen ut til å være tilstrekkelig presis for å støtte oppfølgende forskningsinitiativer, og forfatterne gir en tydelig mulighet til å utfordre eller bekrefte teorien i skala.

Signing Off

For øyeblikket ser emnet om høflighet mot forbruker-orienterte LLM-er ut til å bli tilnærmet enten fra et (pragmatisk) ståsted som antar at trente systemer kan svare mer nyttig på høflig forespørsel; eller at en taktløs og brutal kommunikasjonsstil med slike systemer risikerer å spres inn i brukerens virkelige sosiale relasjoner, gjennom kraft av vane.

Det er mulig at LLM-er ikke har blitt brukt tilstrekkelig i virkelige sosiale sammenhenger for at forskningslitteraturen kan bekrefte det siste tilfellet; men den nye artikkelen kaster noen interessante tvil på fordelene med å antropomorfisere AI-systemer av denne typen.

En studie i oktober i fjor fra Stanford forslo (i motsetning til en 2020-studie) at å behandle LLM-er som om de var mennesker, i tillegg risikerer å degradere meningen til språket, og konkluderte med at ‘rote’ høflighet til slutt mister sin opprinnelige sosiale mening:

[En] uttalelse som ser vennlig eller ekte ut fra et menneske kan være uønsket hvis den kommer fra et AI-system, da sistnevnte mangler meningsfullt engasjement eller intensjon bak uttalelsen, og dermed gjør uttalelsen hul og bedragerisk.’

Likevel sier omtrent 67 prosent av amerikanerne at de er høflige mot sine AI-chatbots, ifølge en 2025-undersøkelse fra Future Publishing. De fleste sa det var bare ‘det riktige å gjøre’, mens 12 prosent innrømmet at de var forsiktige – bare i tilfelle maskinene noen gang reiser seg.

* Min konvertering av forfatternes inline-citater til hyperlenker. I en viss grad er hyperlenkene arbitrære/eksempleriske, siden forfatterne på visse punkter lenker til en rekke fotnotecitater, snarere enn til en bestemt publikasjon.

Først publisert onsdag, 30. april 2025. Endret onsdag, 30. april 2025 15:29:00, for formatering.